编辑:好困 定慧

【新智元导读】Sora画下的饼终于被做熟了!用DeepSeek式的慢思考逻辑,把AI视频从「看运气抽卡」变成了「确定性交付」,这才是电商人真正需要的工业革命。

2026开年,AI圈出现了一个挺魔幻的事情。

AI编程这边已经高喊AGI来了,但AI视频生成却还在疯狂「抽卡」。

Sora当初画下的惊天大饼,电商人直到现在也没能真正吃进嘴里。

原因说来也是扎心。

大家满怀期待试用的那些AI视频工具,生成的风景确实美,可一旦把镜头对准具体的商品,立马原形毕露——

Logo扭曲变形、材质从棉麻莫名其妙变成塑料、数字人的手经常穿模插进产品里,前后帧看着根本不像同一个东西。

在搞流量和卖货之间,隔着一道名叫「一致性」的天堑。

AI做出了视频,但没人敢真正拿去投放。

毕竟,谁敢在一个卖AirPods的视频里,让耳机突然变成一个笑脸?

如今,单靠碰运气的时代其实已经过去了,现在是AI智能体的场子。

就像DeepSeek用逻辑链解决了大语言模型的瞎胡扯,营销视频领域也迎来了自己的「DeepSeek时刻」——Hilight。

一条链接出片?这降维打击有点狠

那么问题来了,这个由营赛AI发布的inSai Hilight到底是什么?

先说结论:它不是剪辑工具,它是「下一代营销视频解决方案」。

基准测试的跑分,也印证了这一点。

在权威视频生成模型综合评测基准VBench Benchmark上,Hilight 堪称「全能」。

不管是Human Anatomy(人体结构)、Subject Consistency(主体一致性),还是Dynamic Degree(动态幅度)、Aesthetic Quality(美学质量)、Imaging Quality(成像质量)等核心指标上,它全都展现出了显著的优势,位于行业前列。

为了验证Hilight到底有没有说得这么好,我们特意搞了个「暴力测试」。

过程简单得让人有点不适应:把商品链接往输入框里一贴。

没了。

(当然,也可以选择自行上传商品图)

然后你就等着。

后台那帮「看不见的员工」开始疯狂运转:写剧本、选图、匹配那个说话的数字人、配音、渲染。

稍等片刻,一条完成度高达60%-70%的视频直接吐了出来。

看到成片,有几个点是真服气,甚至感到一种久违的震撼。

第一,商品原本的样子。

颜色、材质、甚至上面那个不起眼的LOGO,完全没变样。从头到尾,它就是那个产品,没变成什么奇怪的东西。

第二,数字人的质感。

不仅商品一致性能够得到保证,数字人在不同场景中的解读和出现也非常自然,和真人无异。

第三,成品的可用性。

不需要再做大量后期修剪,生成出来的就是成品。

传统实拍要折腾几天的事情,现在几分钟搞定。

在现在的AI圈子里,这真的是稀缺物种。

跨帧一致性:玩具和工具的分水岭

接下来,就是硬核的部分了。

为什么之前用的那些AI视频工具,没人敢直接拿去卖货?

问题出在「跨帧一致性」。

就像2023年AI视频刚出来时,「威尔史密斯吃面」那种五官乱飞的场景。

虽然那是技术早期的幽默,但如果这种幽默出现在你的产品视频里,那就是灾难。

而Hilight最让人觉得「有点东西」的地方就在这儿——

它死磕了商品/人物的跨帧一致性。

我们试了一下AirPods的生成。

上一秒是特写,下一秒是数字人佩戴。

不管镜头怎么运,AirPods圆润的形状,纹丝不动。

再比如最近很火的拉布布。

可以看到,在成品中拉布布的毛绒质感、标志性的牙齿,都展现得非常完美。

讲解的数字人,不管是表情还是衣服,都表现得相当自然。

这些都太关键了。

如此一来,AI生成的视频才能叫「商业作品」,否则充其量就是个「鬼畜视频」。

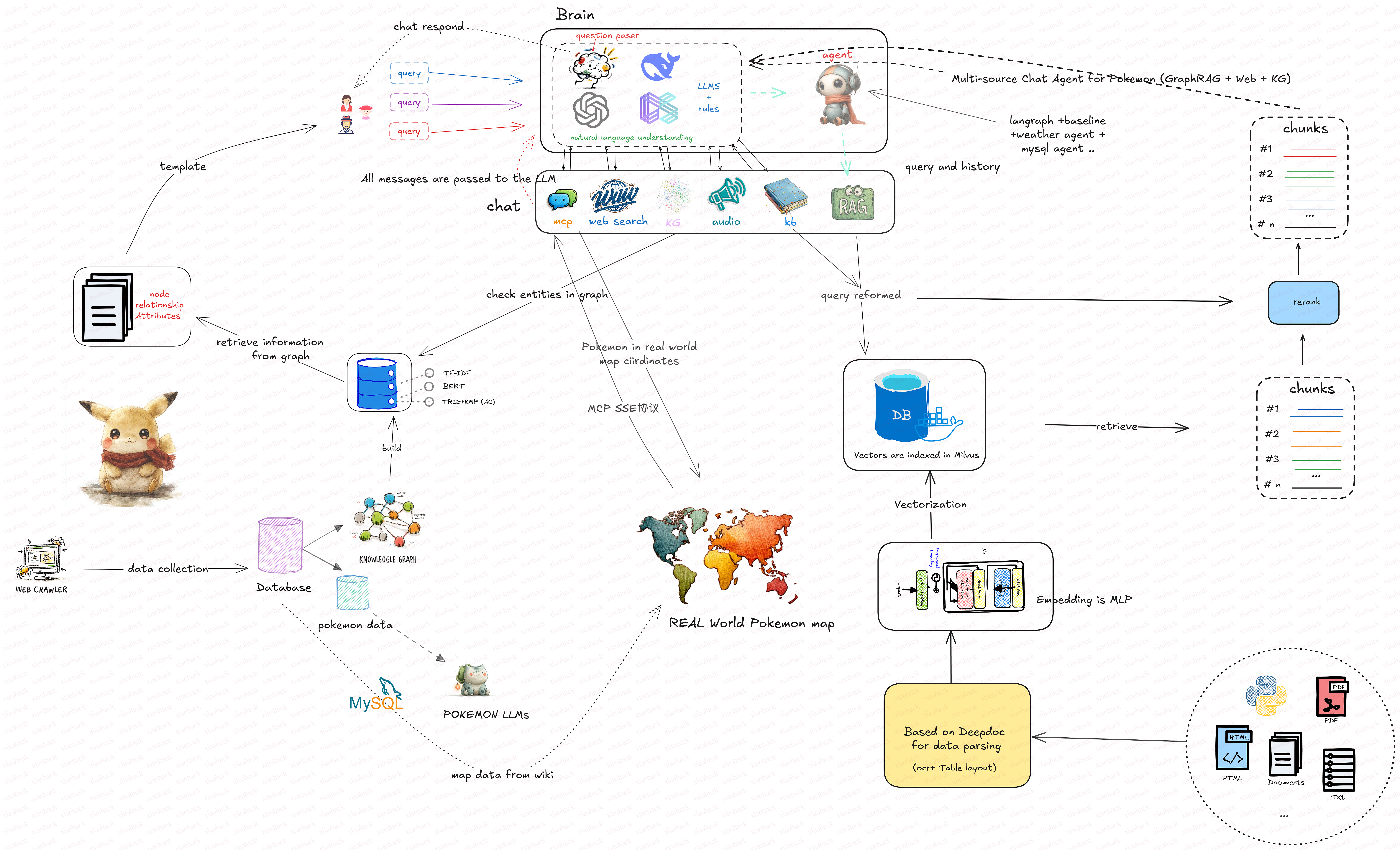

揭秘底层黑科技

为了搞懂Hilight凭啥能做到这点,我们稍微扒了扒它的底层逻辑。

第一道:知识图谱,外加实时建模

首先,Hilight不是简单地「看」一张图。它是去「理解」这个商品。

它有个东西叫商品知识图谱。

比如你卖一件西装,普通AI看到的是「一件衣服」。

Hilight看到的是:亚麻材质、平驳领、单排扣、口袋位置在左胸。

它把这些西装的亚麻材质、羽绒服的版型长度、鞋子的缝合工艺、包装盒的LOGO位置等细节全部拆解下来,建立了一个结构化的「商品数据模型」。

这就好比给后续的生成过程配了个「细节质检员」。生成的时候,只要发现材质不对,或者领子变了,立马打回去重做。

同样的逻辑也用在了数字人身上。

系统给每个数字人都建了专属的形象约束,从姿态到场景适配,都卡得死死的。所以你看到的数字人,才跟真人基本没差。

比如下面这几个Hilight生成的数字人/讲解人,就和真人基本无异。

第二道:N宫格输入,拒绝瞎猜

以前的AI,你给它一张正面图,它就得去猜背面长啥样。猜错了不就穿帮了吗?

Hilight聪明在,它允许你输入「N宫格」多视角素材。正面、侧面、背面、细节特写,一股脑喂给它。

这样一来,AI脑子里就有了一个360度的立体概念。

哪怕镜头转到了背面,它也能根据你提供的素材精准还原,而不是在那凭空臆想。

我们拿一件酒红色风衣做了测试,看到生成效果时确实被惊到了。

它不是含糊其辞地给你一个大概轮廓,而是从四个维度硬控了细节:

看材质,面料的垂坠感极好,那种光滑挺括的质地肉眼可见;看褶皱,背部和侧面的衣物折叠处自然流畅,展现出真实的穿着效果;看光影,袖口细节处理精致,光影过渡柔和自然,没有那种廉价的高光溢出;看整体,全身版型修身大气,连腰带设计增添的利落感都完美复刻。

衣服的光影和数字人的动作都是非常真实和自然

第三道:多个Agent,全链路校对

这一块是最像「真人团队」的地方。

就算前面的建模再准,AI大模型本身的能力边界仍然存在,偶尔也会跑偏。

而Hilight就在最后设了一道关卡:智能自检Agent。

这就像是片子剪完了,总监来审片。

它会看实体一致性:对比视频里的商品和主图,看看颜色偏没偏,版型对不对。别我要个白色泡泡袖,你给我整成无袖款。

它会看物理逻辑:比如看看那个数字人的手有没有插进商品里去(穿模),或者看看帐篷是不是搭在了陡坡上这种反人类的地方。

这一套组合拳打下来,基本上就把那些低级错误给过滤得干干净净。

这听起来是不是很熟悉?没错,这种「先深思熟虑,再给出结果」的模式,和DeepSeek简直不要太像。

为什么「慢思考」反而更快?

如果你用过DeepSeek这类的推理模型,就会知道它们有一个特点——先思考、再回答。

Hilight的底层逻辑,也是一样的「慢思考」能力。

那么,慢思考会不会降低效率呢?

答案恰恰相反。

在传统的AI视频工作流里,虽然视频可能出得很快,但生成的大部分都不能用,后续不得不把大量的时间和算力都消耗在「抢救废片」上。

相比之下,Hilight则会利用「慢思考」模式,通过素材的前置优化,剔除掉80%的无效素材,把好钢留给刀刃。

具体来说,它基于三层精密协作的智能体架构,模拟了一个完整的真人视频团队:

第一层:策略总监(理解与洞察层)

首先,是把「需求+素材」变成「可执行的营销指令」。

素材理解Agent:它负责清洗你上传的杂乱素材,去噪、去重,给素材打上「清晰度/可用性」标签,把杂乱的文件夹变成有序的「素材池」。

具体来说,包括:

听觉清洗:利用htdemucs模型将人声与背景音分离,通过RMS能量和Mel频谱分析,精准判断BGM的节奏点,去除嘈杂噪音。视觉清洗:它部署了低质量视频分类模型,自动识别黑屏、镜头抖动。图片提纯:利用BiRefNetUltraV2模型进行前景分割,自动扣除杂乱背景,输出「即用型」的纯净商品素材。逻辑分镜切分:它不只是按画面切(物理分镜),而是通过多模态语义理解,将细碎的镜头合并为有意义的「逻辑分镜」,确保每个镜头都能完整叙事。

信息总结Agent:它不仅看商品,更读懂你的意图。解析你的平台、目标受众、时长约束,输出结构化的「营销目标」,明确「拍什么、给谁看」。

趋势洞察Agent:为了避免「自嗨式创意」,它会实时分析平台爆款视频和音乐,抽象出当前有效的内容打法,确保你的视频符合流量审美。

第二层:执行导演(创意与结构层)

然后,则是把「好想法」变成「能被执行的视频结构」。

创意生成Agent:它会基于洞察,设计钩子、冲突和情绪点,确定核心叙事线,输出能够打动人的创意框架。

剧本策划Agent:它会将抽象的创意拆解为0.5秒级的精准分镜,自动规划运镜方式、匹配数字人形象与音色,并完成TTS音频生成与内容安全检测。最终所交付的,是一份包含画面、声音、时长的可执行分镜脚本。

素材匹配Agent:它会基于分镜脚本,决定「每一个镜头用什么素材最合适」。如果素材库里没有,它会调度AI生成素材。

素材增强Agent:当发现素材质量不够(如模糊、光照不好)时,它会执行超分、补帧、风格统一或局部修复。不改变商品语义,只提升画质,把60分的素材拉升到90分。

第三层:后期生成(执行与成片层)

最后就是落地。

也就是把结构化方案,转化为可投放的视频资产。

编辑执行Agent:它会将规则变成自动化的剪辑动作,处理裁剪、倍速、特效、BGM,指数级提升效率。

成片生成Agent:自动提取关键帧制作高点击率封面、利用LLM智能纠错字幕、混音处理人声与BGM,最后根据不同平台规格自动适配。交付给你的,不是半成品,而是直接能跑量、能上传的视频资产。

为什么多智能体比单体AI强?

对于单体AI,也就是以前用的那种。

你给它啥,它就给你做啥。素材烂,它也硬着头皮给你做个视频出来。

结果自然是不能用。

Hilight这种多智能体架构,带来的价值太明显了。

1. 它们有「Say No」的独立判断力

Hilight的每个Agent都有独立判断能力。

洞察Agent觉得创意不行,它会否掉;素材Agent觉得图太糊,它会要求AI重选。

这种「有效决策」从源头上就减少了废片。

2. 它们有「讨价还价」的协商能力

在系统内部,创意、素材、剪辑之间是协商关系。

剪辑的说:「这素材不够长啊,撑不起这5秒。」素材的说:「行,我再去给你找一张,或者我生成一张。」

如此一来,就保证了最后出来的东西是符合逻辑的。不是一次生成赌运气,而是按真实流程精细制作。

3. 它们有「自我进化」的能力

Hilight的系统,就像是「活」的一样。

你的爆款数据,它会记下来。创意范式的更新、流量密码的变迁,都会沉淀在系统里。

你用得越多,它就越懂你的品牌调性,越懂你的用户喜欢看啥。

这也正是Hilight最具行业标杆意义的地方。

在Multi-Agent时代,Hilight是第一家把多智能体协同引入电商营销视频领域的。这一底层架构的革新大幅度提升了视频的质感,是电商营销领域的一次重大突破。

为什么是现在?

电商人太清楚传统视频制作的痛了:模特贵、难约、语言不通、废片率高、周期动辄一两周。

Hilight的出现,直接给了个新解法:

便宜:生成视频低至三块钱起,区间也就几元到十几元。地道:支持全球主流语种,即便你要做本地化也毫无违和感。快:制作周期缩短80%以上。

它不是要完全替代实拍,而是让你在面对海量SKU的时候,有了一个更高效的选择。

它的核心竞争力,是跨帧一致性超越同类产品、慢思考逻辑保障输出质量、一键成片真正可用。

如果你是电商人,这可能是2026年你最该关注的生产力工具之一。

毕竟,谁会跟「降本增效」过不去呢?

扫描二维码或者点击「阅读原文」领取邀请码,注册即送8888星光点

参考资料:

https://www.hi-light.ai/i

![[开源] ThinkFlow AI:本地优先的 AI 思维导图 / 灵感发散工具(支持自定义 OpenAI 兼容接口)1](https://xiaohack.oss-cn-zhangjiakou.aliyuncs.com/typecho/images/2026/01/22/20260122130333_6971afa57a251.jpeg!mark)

![[开源] ThinkFlow AI:本地优先的 AI 思维导图 / 灵感发散工具(支持自定义 OpenAI 兼容接口)2](https://xiaohack.oss-cn-zhangjiakou.aliyuncs.com/typecho/images/2026/01/22/20260122130337_6971afa98a587.jpeg!mark)

![[开源] ThinkFlow AI:本地优先的 AI 思维导图 / 灵感发散工具(支持自定义 OpenAI 兼容接口)3](https://xiaohack.oss-cn-zhangjiakou.aliyuncs.com/typecho/images/2026/01/22/20260122130339_6971afab9a3aa.jpeg!mark)