埃隆・马斯克:特斯拉重启的Dojo3将用于 “天基AI计算”

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

编者按: 英伟达财报的营收神话是否掩盖了其现金流恶化的现实?而在“循环融资”的质疑声中,OpenAI 与甲骨文等关键客户的供应链“去英伟达化”浪潮,又将如何重塑 AI 硬件的竞争格局? 我们今天为大家带来的这篇文章,作者的观点是:英伟达目前的高速增长依赖于激进的库存策略和宽松的信用条款,但其最大客户正通过定制芯片和直接采购关键组件来构建独立的供应链,这导致双方关系正从深度捆绑走向潜在的激烈竞争。 作者 | Philippe Oger 编译 | 岳扬 过去 48 小时,我完全沉浸在对英伟达 2026 财年第三季度财报[1]的深度研究中。如果你只看新闻标题,一切看起来都完美无缺:营收同比增长 62 %,达到 570 亿美元,黄仁勋还在大谈“AI 的良性循环”。 但我想弄清楚光鲜数据下的真实情况,于是深挖了资产负债表,并将其与围绕 OpenAI 和 Oracle 的所有新闻进行了交叉验证。 我并不是华尔街的专业分析师,但即便仅凭自己梳理线索(并借助了 Gemini 的帮助),我也开始看到这个所谓的“AI 联盟”出现了一些裂痕。就在英伟达创下业绩纪录的同时,他们最大的客户似乎正在悄悄武装自己,准备另起炉灶。 以下是我对硬件市场、OpenAI 与英伟达之间“亦敌亦友”的关系,以及包括迈克尔·贝瑞(Michael Burry)在内大家都在讨论的“循环融资(circular financing)”理论的一些看法。 表面看来,英伟达无疑是 AI 时代的绝对王者 —— 数据中心业务已占据公司总营收近九成,这一事实无可辩驳。然而,当我深入研读财报细节时,发现了三处值得警惕的“红色信号” : 我的个人判断?英伟达正通过透支现金流来囤积库存,将全部赌注押在 Blackwell 架构[2]能在第四季度被市场瞬间消化。 我想说清楚一点:接下来这部分内容并不是我最先发现的。最近财经新闻到处都在讨论这件事,而且如果你关注迈克尔·巴里(就是那位电影《大空头》里的“大空头”原型人物),你很可能已经看到他发推文警告所谓的“循环融资”和可疑的收入确认(Revenue Recognition)[3]行为。 我尝试自行理清这其中的关系,看看大家究竟在争论什么。巴里最近分享了一张图表,把这一系列交易描绘成一张交易“关系网”,其结构大致如下: 巴里的核心论点(也是据传美国司法部等监管机构介入调查的原因[4])在于:这套模式形同“资金空转”。这引发了一个尖锐的问题:如果英伟达停止向 OpenAI 投资,OpenAI 还有足够现金去和甲骨文(Oracle)签下那笔大单吗?而甲骨文又是否还会采购那些芯片? 如果答案是“不会”,那么部分营收数据的稳固性可能远不如表面看来那样坚实。 我近期一直在关注的另一个重大转变,是 OpenAI 的战略转向。他们曾是英伟达最耀眼的“模范客户”,如今却越来越像一个潜在的竞争对手。一方面,他们仍与 NVIDIA 保持紧密合作 —— 部署 10 吉瓦(gigawatts)的基础设施用于训练 GPT-6;但另一方面,他们似乎正在构建一条能彻底摆脱黄仁勋(Jensen Huang)掌控的供应链。 如果你有所留意,相关迹象其实已经相当明显。 “星门计划”(Project Stargate) 不仅仅是个数据中心,更是一项包含定制硬件在内的庞大基础设施计划。据多家媒体报道(例如此处[5]、此处[6]、此处[7],并在 Hacker News 上引发了激烈的讨论[8]),OpenAI 已直接从三星和 SK 海力士(全球两大 HBM 内存供应商)采购 DRAM 晶圆,绕开了英伟达的供应链。 此外,人才流向也透露出关键信号:OpenAI 已从数个行业巨头处挖走多名芯片人才,包括 2023 年招揽了谷歌前 TPU 负责人 Richard Ho,以及近期从苹果挖走的约 40 名硬件工程师。 结合 OpenAI 与博通(Broadcom)的合作[9],我推测其策略是:用英伟达 GPU 构建智能模型,但最终在自家的定制芯片上运行推理任务 —— 以此大幅削减高昂的运营成本,或押注类似谷歌 Edge TPU 的专用芯片(NPU)来处理推理负载。 但关键问题来了:OpenAI 打算用谁的钱来支持这项事业?而英伟达对其未来规划又究竟有多大影响力? 而且,所谓“英伟达向 OpenAI 投资 1000 亿美元”的说法,至今尚未得到官方证实(如此处[10]所述)。 眼下所有人都在讨论推理成本问题(Inference costs) —— 也就是实际运行 ChatGPT 或其他大语言模型(LLM)的花销,远比训练它们更昂贵。我最近在关注 Groq 这家初创公司,他们明确宣称在推理任务上比英伟达更快、更便宜。其创始人乔纳森·罗斯(Jonathan Ross)[11]曾是谷歌 TPU 团队的负责人,甚至可以说是 TPU 概念的最初提出者。 但还有一层情况,我认为被大多数人忽视了:OpenAI 直接采购晶圆所引发的 HBM 短缺问题。 据我所知,目前英伟达最大的瓶颈之一就是 HBM(高带宽内存)。 HBM 由专业内存代工厂生产,而这些产线早已完全超负荷运转。然而,Groq 的架构依赖的是 SRAM(静态随机存储器)。 由于 SRAM 通常是在逻辑制程代工厂(比如台积电 TSMC)中与处理器本身一同制造的,理论上它不会遭遇与 HBM 相同的供应链紧张问题。 综合这些因素,我觉得甲骨文真该认真考虑一下收购 Groq。拿下 Groq 不仅意味着获得更快的芯片,更关键的是 —— 当其他芯片全都售罄时,Groq 的芯片可能仍然有货。这本质上是一种供应链对冲(supply chain hedge)。 对甲骨文的最大客户 OpenAI 而言,这也将带来巨大的优势:更快、更便宜的推理能力。 再结合此前的传闻:甲骨文出租英伟达芯片的利润率极其微薄[12],据传低至 14%,那这笔收购就显得更加合理。通过控股 Groq,甲骨文不仅能摆脱“英伟达税”(NVIDIA Tax),改善自身利润空间,还能彻底绕过 HBM 短缺的困局。 据 Groq 在 2025 年 9 月的最近一轮融资披露[13],其估值约为 69 亿美元。即便支付溢价,以甲骨文的财力也完全有能力完成这笔收购。 但问题是:英伟达会允许这事发生吗? 如果答案是否定的,那又说明了什么?是否意味着当前这套“循环融资(circular financing)”体系中存在某种利益交换 —— 比如,英伟达承诺向 OpenAI 投资 1000 亿美元,条件是甲骨文必须只能使用英伟达芯片? 进入 2026 年,观察英伟达、OpenAI 与甲骨文之间的博弈,这场三方角力正陷入彼此钳制的僵局。我无从得知英伟达是否事先知晓 OpenAI 与内存厂商之间的晶圆供应协议,亦或其中存在任何合谋?英伟达是否正在极力维持自己在“星门计划”(Stargate)中训练和推理环节的独家地位?而 OpenAI 又到底打算打造什么样的芯片?是类似 TPU/LPU 的架构?还是更偏向 Edge TPU 那样的边缘推理芯片? 迈克尔·巴里(Michael Burry)正在全面做空这套体系[14]。 至于我,只是个读财报的普通人,无力揣测市场走向。但我非常确定一点:AI 硬件市场比以往任何时候都更炽热,未来几个季度的风云变幻必将精彩绝伦。 免责声明:我偶尔会发表些真知灼见,但更多时候说的都是蠢话。阅读本文时请务必谨记这一点。 END 本期互动内容 🍻 ❓如果“循环融资”属实,谁最可能成为这个链条中最先断裂的一环? 文中链接 [1]https://nvidianews.nvidia.com/ [2]https://www.nvidia.com/en-us/data-center/technologies/blackwe... [3]https://www.investing.com/news/stock-market-news/michael-burr... [4]https://m.economictimes.com/news/international/us/nvidia-reje... [5]https://openai.com/index/samsung-and-sk-join-stargate/ [6]https://www.asiafinancial.com/samsung-sk-hynix-building-starg... [7]https://www.kedglobal.com/artificial-intelligence/newsView/ke... [8]https://news.ycombinator.com/item?id=46169224#46170844 [9]https://openai.com/index/openai-and-broadcom-announce-strateg... [10]https://fortune.com/2025/12/02/nvidia-openai-deal-not-signed-... [11]https://www.linkedin.com/in/ross-jonathan/ [12]https://www.fool.com/investing/2025/12/02/michael-burry-just-... [13]https://groq.com/newsroom/groq-raises-750-million-as-inferenc... [14]https://www.techradar.com/pro/security/could-the-ai-bubble-be... 本文经原作者授权,由Baihai IDP编译。如需转载译文,请联系获取授权。 原文链接: https://philippeoger.com/pages/deep-dive-into-nvidias-virtuou...01 英伟达财报:完美表象下的隐忧

02 拆解“资金空转”传闻的虚实

03 OpenAI 正在采取行动降低对英伟达的依赖

04 甲骨文一个有趣的思路:收购 Groq

05 Final Thoughts

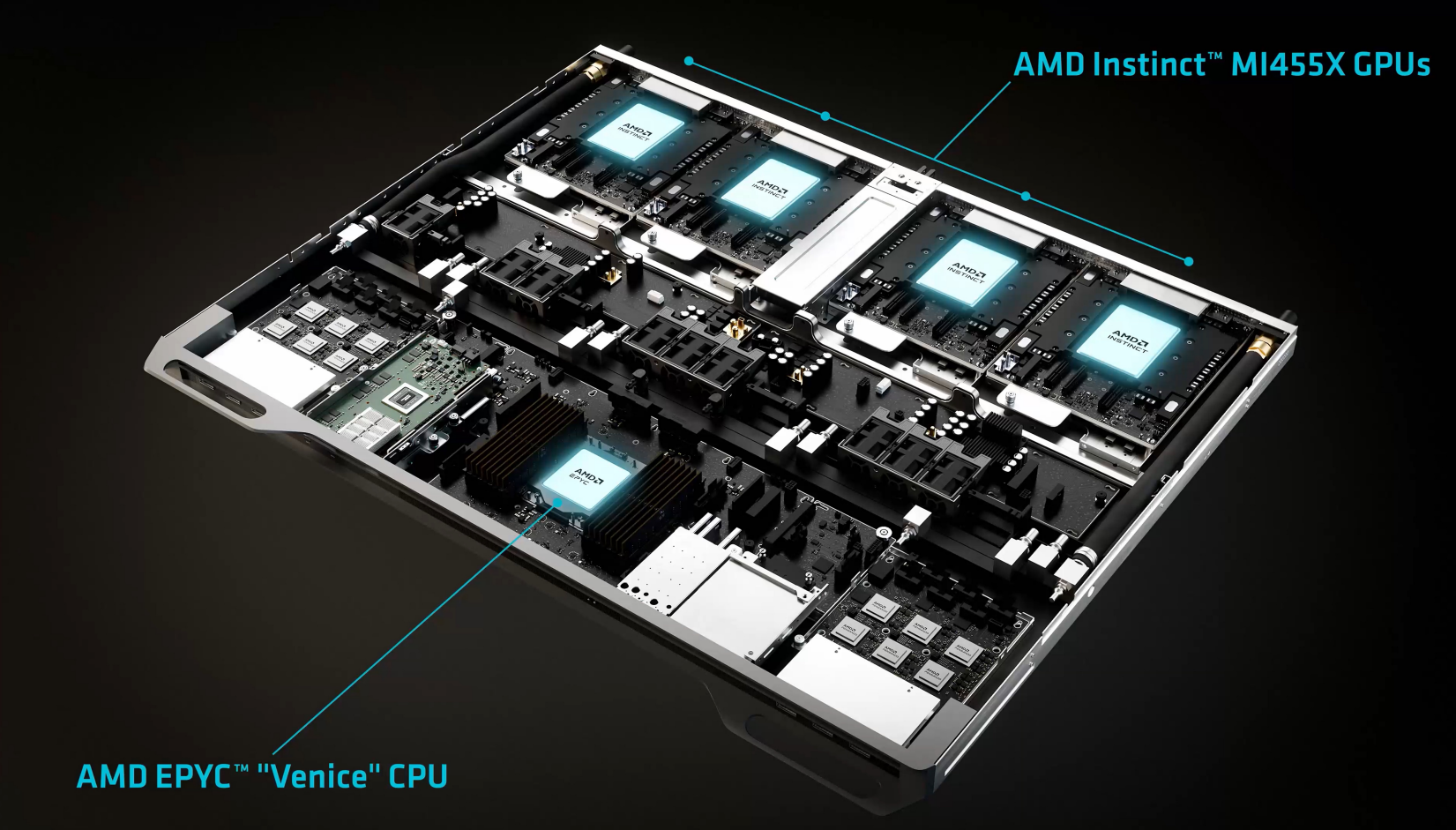

今年的 CES 真可谓是八仙过海,黄仁勋、苏姿丰、陈力武等“经典面孔”齐亮相; 不过台上谈的已不只限于显卡、算力和制程,还在于 AI 接下来要被带去哪里。 在 AMD 的专场演讲中,苏妈甩出一个大胆判断: “未来五年内,将有 50 亿人每天使用 AI,超过世界人口的一半。” ——什么概念?就是这个增长速度将远超互联网早期阶段,自 ChatGPT 在 2022 年底发布以来,AI 活跃用户已从 100 万暴涨至 10 亿+。 值得一提的是,这场演讲还请来了“AI 教母”李飞飞。 李飞飞并不是来站台新品的,她和苏妈主要探讨空间智能和世界模型,这也是她已耕深 20 余年的领域。 此外,OpenAI 总裁兼联合创始人 Greg Brockman 也登台助阵,指出行业痛点:“计算能力,仍然是 AI 走向通用智能的最大瓶颈。世界需要的 GPU 数量,远超我们现在拥有的规模。” 而这正是 AMD 接下来要解决的事情,他们希望能补齐 AI 普及所需的算力基础设施。在苏姿丰描述的未来世界里,AI 将无处不在,算力将人人可及——她这次在 CES 上抛出的,不只是几块更强的 GPU,而是一套完整的 AI 版图。 对于云端,基于下一代 MI455 GPU 的 Helios 机架级平台成为全场焦点:单机架集成 72 块 AI GPU,算力高达 2.9 ExaFLOPS,可通过成千上万个机架拼接成超大训练集群,直指千亿参数大模型的核心战场。 谈到云端算力的未来,苏姿丰毫不掩饰 AMD 的野心: “全球人工智能运行在云端,而云端运行在 AMD 平台上。” 另外,她还指出,下一代 Instinct 数据中心 AI 加速器平台 MI500 系列,将在 2027 年推出并全面转向 2nm 工艺,并放出狠话:希望借此在四年内 AI 芯片性能提升 1000 倍(远超摩尔定律啊...)。 与此同时,AMD 还在推动把 AI 从云端下放到本地,而他们的一个很核心的落点,是 AIPC。 Ryzen AI 通过内置 NPU(神经网络处理单元,一种专门为 AI 推理设计的处理器)让 AI 本地运行、离线可用。 在数据中心这一 AI 算力的核心战场,AMD 开始卖“一整个机架”的算力方案 Helios,一个几乎重新定义“数据中心硬件形态”的存在。 Helios,是 AMD 面向 YottaFLOPS 级 AI 的下一代机架级平台,也是本场 AMD 发布会的“镇场之作”。 所谓 YottaFLOPS 级 AI,就是算力达到 10²⁴ 次浮点运算/秒 的人工智能系统。直观地说,它不只是“更快的 AI”,而是能在极短时间内模拟、理解和优化极其复杂的世界系统,如全球气候、全人类基因等,能力规模远超今天任何单一 AI 模型。 Helios 从一开始就按大模型需求设计,用开放的 OCP 机架标准做底座,并与 Meta 合作开发,强调模块化、可扩展、能快速堆出大集群。 Helios 的核心是一种全新的算力组织方式,能将 72 颗芯片协同工作。 其中的系统设计是通过高速互联和软件栈,把这些 GPU 组织成一个可以统一调度的算力池,让它们更像一个整体,而不是“72 个独立设备”。在 FP4 这种推理常用的低精度口径下,单台 Helios 机架式服务器可提供高达 2.9 ExaFLOPS 的算力,并搭载 31TB 容量的 HBM4。 如果再把数千个 Helios 机架互联起来,就能搭建出面向万亿参数模型训练和推理的超大规模集群。 至于 Helios 的算力底座,是 AMD 最新一代 Instinct MI455 GPU,也是 AMD 历史上跨代提升幅度最大的 Instinct GPU。 这颗芯片拥有超过 3000 亿个晶体管,相比 MI300 系列提升约 70%,推理与训练综合性能最高可达 10× 提升。 AMD 对 MI455 GPU 的定位非常明确:它要解决大模型训练和推理里最棘手的瓶颈“内存墙”。大模型跑不动,很多时候不是算力不够,而是数据喂不进去、内存带宽跟不上。 这颗加速器芯片采用 2nm 与 3nm 混合工艺打造,再配上先进的 3D 小芯片封装技术,并搭载新一代 HBM4 高带宽内存。 更重要的是,MI455 并不是孤立地“做一颗更强的 GPU”,它在计算托盘层面就与 EPYC 服务器 CPU、Pensando 网络芯片深度集成,让 CPU、GPU、网络协同成为平台能力,而不再是分散组件的简单拼接。 苏姿丰打了个生动的比方:“Helios 是个庞然大物般的货架,它不是普通的货架,而是双倍宽度的设计,重量接近 7000 磅。”她指出,这个机架的重量超过两辆小型轿车的总重量。 时至今日,AI 的推理能力已被推到聚光灯下,其特点是调用频率高、负载长期持续,进一步带来更明显的算力缺口。 苏姿丰分享称,AMD 下一代 MI500 系列正在开发中,计划全面转向 2nm 工艺,发布时间定在 2027 年。按照 AMD 给出的路线图,从 MI300 到 MI500 的四年周期内,其 AI 计算性能目标提升幅度达到 1000 倍。 她将这一跨代跃迁称为“公司历史上幅度最大的一次性能提升规划”,并将其视为支撑下一阶段超大模型训练和推理需求的关键基础。 在数据中心之外,AMD 还把另一张牌打到终端侧:把原本只能在云端完成的 AI 工作,搬到个人电脑上。 Ryzen AI Max 400 系列(代号 Strix Halo)正是这一策略的核心载体。AMD 给它的定位并不含糊:面向 AI 开发者和高端创作者,做一颗“能真正干活”的本地 AI 芯片。 与 Ryzen AI 300 一样,Ryzen AI Max 400 系列依然是 Zen 5 和 RDNA 3.5,但支持更快内存速度。 简单来说,Ryzen AI 400 是一颗为 AI 笔记本打造的高性能处理器,最高配备 12 核 CPU,同时集成了 更强的核显 和 最高 60 TOPS 的专用 AI 引擎。再加上对高速内存的支持,让它在多任务、创作以及本地 AI 应用中运行得更流畅。 但相比传统性能参数,更关键的是它的系统设计:芯片同时集成 XDNA 2 NPU,并采用统一内存架构,CPU 与 GPU 之间可共享最高 128GB 内存。 这也是能否跑大模型的前提条件。对本地 AI 来说,算力是否够强是一回事,模型能不能完整装进内存、数据能不能顺畅流动,往往才是决定成败的关键。 AMD 用一场直观的演示给出了答案:一台搭载 Ryzen AI 的设备,在完全离线的情况下,流畅运行了一个 700 亿参数的医疗大模型。 这意味着,开发者可以直接在笔记本上调试生成式模型;医疗、金融等行业,也可以在不把数据上传云端的前提下,完成模型推理和分析。本地终端不再只是“调用云端 AI”,而是开始真正承载模型本身。 摆数据:在高端笔记本形态下,Ryzen AI Max 在 AI 与内容创作类应用中的表现,快于最新一代 MacBook Pro;在小型工作站场景中,成本明显低于英伟达的 DGX Spark,而且原生支持 Windows + Linux。 AMD 还贴心地发布了一个本地 AI 参考平台:Ryzen AI Halo 。 官方将其称为“世界上最小的 AI 开发系统”,可在完全离线的条件下运行多达 2000 亿参数模型,面向需要随时随地进行模型开发和部署的专业用户。 那些过去只能在数据中心机房里完成的工作,正在被压缩进一个可以随身携带的设备。 前文提到“AI 教母”李飞飞也亮相了;其实在这种聚焦硬件与平台发布的商业舞台上,李飞飞不常露面,她更常被视为学术界和公共讨论中的“定锚者”。 李飞飞此次在 AMD 的专场讲演登台,强调 AI 不仅要生成内容,更要理解并参与真实世界。 在这一点上,苏姿丰的判断高度一致,她表示,过去几年,大语言模型的出圈(LLM)推动了 AI 的爆发,但无论是人类还是机器,智能并不只来自“看和说”,真正连接“感知 → 推理 → 行动”的关键能力,是空间智能(Spatial Intelligence)。 过去这几年,GPU 的快速发展已让画质起飞了,但 3D 和 4D 世界却还在慢慢搭,往往需要团队花费数月甚至数年完成;而现在 AI 正在改变这种节奏。 李飞飞表示,她认为 AI 正进入一个新阶段:从语言智能,迈向具备空间理解与行动能力的生成式 AI: “AI 在过去几年取得了巨大突破,我在这个领域工作了二十多年,从未像现在这样,对未来的发展感到如此兴奋。” 她也介绍了自己创业公司 World Labs 的核心动向: World Labs 正在训练新一代世界模型(World Model) 目标不是还原二维像素,而是直接学习 3D / 4D 结构;物体之间的空间关系;深度、尺度、物理一致性 已炼成的关键能力,包括仅凭几张照片,甚至单张图片,模型即可补全被遮挡区域、推断物体背后的结构,然后生成一致、持久、可导航的 3D 世界。 不是照片也不是视频,而是真正保持几何一致性的三维空间,具备“空间补全与想象”能力,而非拼贴。 李飞飞指出,过去需要数月才能完成的 3D 场景建模,现在可以在几分钟内完成。 她举例说明潜在影响:创作者:实时“在世界中创作”;机器人 / 自动驾驶:在物理一致的虚拟世界中训练,再进入现实;设计师 / 建筑师:直接“走进”设计,而不是看平面图。 她还特别强调了一个常被忽略的点:世界模型并不是“离线生成完就结束”,它需要实时响应、即时编辑,连续保持空间一致性。 这意味着:极高的内存需求,大规模并行计算,非常快的推理速度,否则世界就无法“活起来”。 谈及算力,李飞飞也透露称:World Labs 的世界模型已运行在 AMD 的 MI325X GPU 与 ROCm 软件栈之上,并在短短几周内实现了 超过 4 倍的推理性能提升。 她还提到,随着 MI450 等后续平台 推出,更大规模世界模型的训练与实时运行将成为可能。 游戏和消费级显卡: 在消费级图形领域,AMD 本次带来的主要新品是 Radeon RX 9070 和 Radeon RX 9070 XT。 这两张显卡均搭载了 AMD 的全新 RDNA 4架构,以及最新 AI 图像技术(包括 FSR 4),将游戏体验推向“AI 加速 + 实时渲染”双驱动的新时代。 其中 RX 9070 XT 的 64 个计算单元、较高频率设计,让其在多款 3A 游戏中表现强劲,在 4K 最高设置下帧率表现明显领先前代,在 30 多款游戏中平均比 RX 7900 GRE 快 42% 而 RX 9070 的规格稍低一些(但同样 16 GB 显存),其光追与 AI 能力也因较少计算单元略弱,不过仍能在高画质下保持流畅体验,在 30 多款游戏中平均比 RX 7900GRE 的帧率快 21%。 综合来看,这两款显卡延续了 RDNA 4 在 高效能比、AI 支持(如 FSR 4)、光追性能提升 上的特性,适用于 1440p 到 4K 游戏场景。 AI 专用 CPU: EPYC Venice 是 AMD 为“AI 数据中心时代”打造的下一代服务器 CPU。 它采用 2nm 工艺,最多可集成 256 个 Zen 6 高性能核心,定位不只是“算得更快”,而是专门为 AI 集群服务。 相比上一代 EPYC,Venice 的内存带宽和 GPU 带宽都实现了翻倍,核心目标只有一个:在机架级规模下,持续、稳定地把数据“喂”给 MI455X 等 AI GPU。 换句话说,它不追求抢 GPU 的计算活,而是负责调度、通信和数据供给,避免 GPU 因“等数据”而空转。 为了支撑这种规模,EPYC Venice 还配套 800G 以太网,并结合 Pensando Volcano / Selena 网络芯片,面向万级机架规模的横向扩展。 在 AMD 的设计中,Venice 不只是服务器 CPU,而是 AI 机架级系统里的“中枢处理器”,决定整个集群能否高效运转。 参考链接: https://www.youtube.com/watch?v=UbfAhFxDomE&list=TLGGBbam0h3MCckwNjAxMjAyNg&t=3063s https://www.amd.com/content/dam/amd/en/documents/corporate/events/amd-ces-2026-distribution-deck.pdf

Helios 机架级平台和 AIPC

和李飞飞同台聊空间智能

其他亮眼新品

整理 | 华卫 1 月 1 日,百度旗下 AI 芯片子公司昆仑芯已于向香港联合交易所秘密递交上市申请,为分拆独立上市铺平了道路。 据称,IPO 规模和结构在内的细节尚未最终确定。知情人士透露,为数据中心服务器提供动力的芯片制造商昆仑芯的估值至少为 30 亿美元(约合 210 亿元人民币)。 百度表示,分拆上市能更好体现昆仑芯的价值,吸引专注于通用 AI 计算芯片及相关软硬件系统业务的投资者群体,提升其在客户、供应商及潜在战略合作伙伴中的形象,提高其协商及争取更多业务的地位。 昆仑芯仍将是百度旗下子公司。据报道,百度持有昆仑芯约 59%的股份。分拆还将使昆仑芯能在未来有需要时直接且独立地进入股权及债务资本市场,百度集团能更有效地配置财务资源等。 此举仍需获得包括中国证监会在内的监管机构批准。百度强调,分拆计划能否最终完成尚无保证。 Counterpoint Research 副总监 Brady Wang 表示,“在市场上,昆仑芯被视为中国最实用、应用最广泛的 AI 芯片之一。”他还补充说,这家芯片制造商的主要优势之一在于软件。“昆仑芯芯片不会强迫用户采用封闭系统,而是能够很好地与常见的 AI 框架兼容,从而更容易将工作负载从英伟达迁移过来。” 去年底,摩根大通分析师预测,昆仑芯的芯片销售额到 2026 年将增长六倍,达到 80 亿元人民币。 受此消息影响,百度集团港股当日大涨。

IT 之家 1 月 4 日消息,半导体与 AI 行业研究分析公司 SemiAnalysis 北京时间昨日表示,AI 企业 Anthropic 将直接从博通采购近 100 万颗 TPU v7p “Ironwood” AI 芯片,本地部署在其控制的数据中心中。

换句话说,博通将直接向 Anthropic 供应基于 TPU v7p 的机架级 AI 系统,“绕过” TPU 芯片的另一开发参与方谷歌。不过谷歌预计仍可从 Anthropic 同博通的交易中取得 IP 授权收入。

博通 CEO 陈福阳此前在 2025 年 12 月确认,Anthropic 已累计向博通下达了价值 210 亿美元的 AI 系统订单。

在 Anthropic 的自有 TPU 算力系统中,TeraWulf 等三家企业供应基础设施,Fluidstack 则将负责现场部署服务。