Clawdbot 详解

Clawdbot 是什么?

Clawdbot 是一个开源的个人 AI 助手,你可以运行在自己的设备上。它通过你已有的通讯渠道与你交流:

- WhatsApp, Telegram, Slack, Discord

- Google Chat, Signal, iMessage, Microsoft Teams

- 语音交互( macOS/iOS/Android )

- WebChat 界面

核心特点

| 特性 |

说明 |

| 本地优先 |

数据完全由你控制,不需要依赖云服务 |

| 多平台支持 |

macOS, Linux, Windows (WSL2), Raspberry Pi |

| 多 Agent 系统 |

可以运行多个隔离的 AI 代理 |

| 浏览器控制 |

自动控制 Chrome/Chromium 浏览器 |

| Canvas |

AI 驱动的可视化工作区 |

| 语音唤醒 |

持续语音对话功能 |

| 技能扩展 |

可安装/自定义技能插件 |

为什么这么火?

| 原因 |

说明 |

| 隐私优先 |

本地运行,数据不泄露 |

| 功能强大 |

集成浏览器控制、文件操作、多平台通讯 |

| 完全开源 |

MIT 许可证,社区活跃 |

| 部署灵活 |

从树莓派到云服务器都能跑 |

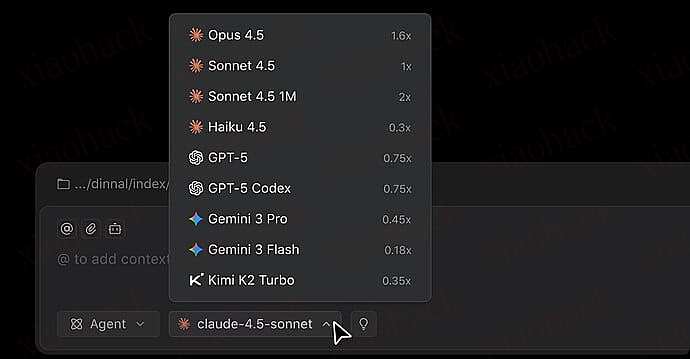

| Claude 深度集成 |

优先推荐使用 Claude Opus 4.5 |

| AI Agent 体验 |

让 AI 真正"干活",不只是聊天 |

部署需求

硬件需求(官方)

| 配置 |

最低要求 |

推荐配置 |

| RAM |

512MB - 1GB |

2GB+ |

| CPU |

1 核 |

2 核+ |

| 磁盘 |

~500MB |

更多(日志/媒体) |

| 网络 |

稳定互联网 |

24/7 在线 |

软件需求

| 组件 |

要求 |

| Node.js |

≥22 |

| 系统 |

macOS, Linux, Windows (WSL2) |

4090 显卡够吗?

结论:4090 完全足够,甚至有点"杀鸡用牛刀"

为什么?

Clawdbot 本身不需要显卡运行 LLM。它是一个网关/控制层,实际的 AI 推理通过 API 调用完成(如 Anthropic API 、OpenAI API )。

4090 的使用场景

如果你想让 Clawdbot 使用本地 LLM 模型(不调用云端 API ),4090 可以用来运行:

- Ollama 本地模型

- vLLM 推理服务

- 其他本地推理框架

部署选项

┌─────────────────────────────────────────────────────────┐

│ 你的 4090 机器 │

│ ┌─────────────┐ ┌─────────────┐ ┌─────────────┐ │

│ │ Clawdbot │────│ Ollama/ │────│ 本地 LLM │ │

│ │ (网关) │ │ vLLM │ │ (4090 推理) │ │

│ └─────────────┘ └─────────────┘ └─────────────┘ │

│ │ │ │

│ └───────────────────────┬───────────────────┘ │

│ ▼ │

│ 或使用云端 API (Claude/OpenAI) │

└─────────────────────────────────────────────────────────┘

推荐配置

方案 A:纯 API 模式(最简单)

- Clawdbot 直接调用 Claude/OpenAI API

- 不需要本地 GPU

- 4090 可以用于其他任务

方案 B:混合模式(推荐)

- 4090 运行本地模型( Ollama + Qwen/Llama 等)

- Clawdbot 配置使用本地推理端点

- 省钱 + 隐私

方案 C:轻量本地模型

- 使用量化模型(如 Qwen-7B-Int4 )

- 4090 可以同时跑多个实例

快速开始

# 安装 Clawdbot

npm install -g clawdbot@latest

# 运行向导

clawdbot onboard --install-daemon

# 启动网关

clawdbot gateway --port 18789

Sources