神同步OpenAI!中国团队Deep Principle领衔发布LLMs for Science评测,引爆外网 |

神同步OpenAI!中国团队Deep Principle领衔发布LLMs for Science评测,引爆外网

神同步OpenAI!中国团队Deep Principle领衔发布LLMs for Science评测,引爆外网

作者丨论文团队

编辑丨ScienceAI

最近,一篇由中国团队领衔全球 24 所 TOP 高校机构发布,用于评测 LLMs for Science 能力高低的论文,在外网炸了!

当晚,Keras (最高效易用的深度学习框架之一)缔造者 François Chollet 转发论文链接,并喊出:「我们迫切需要新思路来推动人工智能走向科学创新。」

AI 领域 KOL Alex Prompter 分享论文核心摘要后,NBA 独行侠队老板 Mark Cuban 跟帖转发,硅谷投资人、欧洲家族办公室、体育媒体同时涌进评论区。

仅一夜,累计阅读量逼近 200 万。

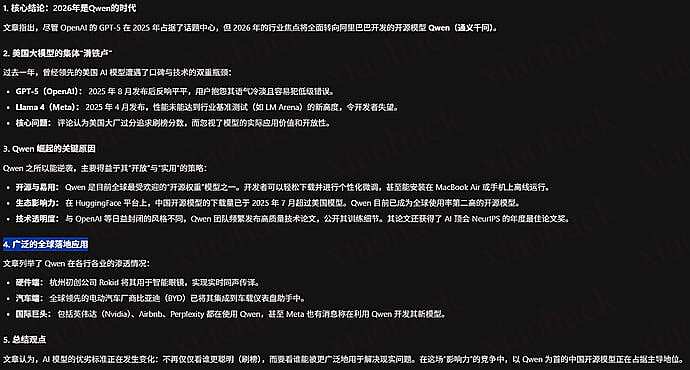

值得一提的是,同一时间窗里,OpenAI 也发布了对于 AI 在科学发现领域能力评测的论文《FrontierScience: Evaluating Al's Ability to Perform Scientific Research Tasks》概述,指出现有评测标准在 AI for Science 领域失灵。

神同步 OpenAI、海外讨论出圈,究竟是什么样的一份工作成果,搅动了全球 AI 舆论场?

AI 距离可以助力科学发现还有多远?

前段时间,美国推出「创世纪计划」,号称要调动「自阿波罗计划以来最大规模的联邦科研资源」,目标是在十年内将美国科研的生产力和影响力翻倍。

但在人工智能估值泡沫隐现、能耗与产出比饱受质疑的当下,一面是资本的狂欢,另一面却是 AI 能力困于「文生图」等表层应用的尴尬;一面是各类大语言模型频繁霸榜 GPQA、MMMU 等题库式 Benchmark 的层出不穷,另一面却是现有 LLMs 还无法准确解析简单核磁图谱的尴尬现状。

人们不禁要问:能在题库拿高分,就能助力科学发现吗?现在的模型距离科学发现还有多远?究竟什么样的 AI 模型可以胜任,拓宽人类的生存边界?这些讨论,在中美 AI 竞争白热化的当下变得愈发浓烈。

在此背景下,由中国 AI for Science 领域的初创企业「深度原理 Deep Principle」领衔麻省理工学院、哈佛、普林斯顿、斯坦福、剑桥、牛津等全球 24 所科研院校共同发布的《Evaluating LLMs in Scientific Discovery》论文,正式回答该时代之问。

论文推出了 LLM for Science 首套评测体系 SDE(Scientific Discovery Evaluation),从科学问题到研究项目,对 GPT-5、Claude-4.5、DeepSeek-R1、Grok-4 等全球主流大语言模型在生物、化学、材料、物理领域的科学研究与发现能力完成摸底。

同以往评测体系不同的是,SDE 对模型能力的考量,从简单的问答式,引向了具体的「假设 -> 实验 -> 分析」实验场景。

研究发现,GPT-5、Claude-4.5、DeepSeek-R1、Grok-4 平均准确率 50–70%,远低于它们在 GPQA、MMMU 等题库上的 80–90%;在 86 道「SDE-Hard」难题中,最高分不足 12%,共同暴露出多步推理、不确定性量化和实验与理论闭环的短板。

更值得警惕的是,模型规模与推理能力的提升已呈现明显的「边际效益递减」。

GPT-5 相较于前一代模型,参数规模和推理算力显著增加,但在 SDE 基准的四大科学领域中,平均准确率仅提升 3%-5%,部分场景(如 NMR 结构解析)甚至出现性能下滑。

换句话说,当前大语言模型在推动科学发现方面的表现,还不如一个普通的本科生。

能领衔 24 所顶尖科研院校发布的背后团队是谁?

《Evaluating LLMs in Scientific Discovery》论文通讯作者段辰儒,是「深度原理 Deep Principle」创始人兼 CTO。早在 2021 年,在 MIT 攻读化学博士期间,他就已在图灵奖得主 Yoshua Bengio 的支持下,发起了 AI for Science 社区的建立,并在 NeurIPS 上举办 AI for Science workshop。

2024 年初,他与 MIT 物理化学博士贾皓钧回国,共同创立「深度原理 Deep Principle」。贾皓钧任 CEO,段辰儒任 CTO,两人虽为 95 后,但已在全球 AI for Science 创业领域小有名气。

创业一年半以来,其已获得线性资本、高瓴创投、蚂蚁集团等多家知名机构的投资,且与晶泰科技、深势科技等 AI for Science 领域的知名企业建立战略合作关系。

「深度原理 Deep Principle」从创立之初,就带着全球 AI for Science 头部研究者们的期待。目前「深度原理 Deep Principle」已深入全球材料研发中的第一线,将生成式人工智能同量子化学结合起来,致力于推动材料发现等领域进入新纪元。

在过去的一年中,他们在 Nature 大子刊和 JACS 等顶级期刊上不断扔出重磅成果,宣告着他们的技术领先和开放交流的「95 后创业公司」心态。从开拓扩散生成模型(Diffusion Models)在化学反应的生成,证明「不止要生成材料,更需要生成材料的合成路径」,到机器学习势(Machine Learning Potentials, MLPs)和扩散生成模型的直接对比,证明传统的机器学习势不是「万能」的,再到现在组织各大顶级学者和高校推出 SDE,证明传统一问一答的 Benchmark 不能带领我们走向科学超级智能,精准切入 AI for Science 领域的核心冲突。

但同时,对于所有的 AI4S 公司而言,在商业真金白银的检验中,AI 能否真正解决新产品研发问题、满足客户期待,是日复一日必须面对的拷问。

随着与行业头部客户的商业化合作落地,「深度原理 Deep Principle」的数据库中已经汇聚了来源于客户与自己实验室、大量来自第一线的真实工业研发场景数据和模型应用经验。

学术圈的深耕与在 AI for Science 商业化第一线的积累,让「深度原理 Deep Principle」在提出要构建一把新尺子评测 LLMs for Science 能力时,一呼百应,摇来了 23 家全球 TOP 科学发现机构的 50 余位科学家,成立了制定 SDE 的「梦之队」。

这其中,不乏活跃在 LLM 领域的大牛学者们,比如:

孙欢(Huan Sun),MMMU 发起人,俄亥俄州立教授

杜沅岂(Yuanqi Du),康奈尔博士,AI4Science 社区「运营大管家」

王梦迪,普林斯顿最年轻教授,AI+Bio Safety 先驱者

Philippe Schwaller,IBM RXN 之父,EPFL 教授

而「深度原理 Deep Principle」前期积累的科学发现场景,成为了后来 SDE 评测体系的前身。

在经历近 9 个月的跨高校跨学科跨时区的协作后,《Evaluating LLMs in Scientific Discovery》论文正式发布,通讯单位赫然写着:深度原理,杭州,中国。

自此,汇聚着全球顶级科学发现机构的集体智慧,来自中国的创业团队「深度原理 Deep Principle」,和大洋彼岸的 OpenAI,同时站在了向 AI for Science—— 这一人类通往终极 AGI 顶峰攀登的起跑线。

或许千百年后,当人类回望 AGI 时代,在 21 世纪的四分之一结束的当口,这场由中美团队共同呼应的,对于 AI for Science 的严肃讨论,把 LLMs 在各类问答式榜单上的内卷,向真正科学发现的星辰大海推近了一步。

至于怎么通往彼岸,段辰儒表示:「当大语言模型在各种科学问答榜单表现饱和,但还不能有效支持科学发现时,就像『考试成绩好』不等于『顶级研究者』,说明我们需要新的评测体系与训练路径。」

「深度原理 Deep Principle」与 20 多所机构的 50 多位合作者的研究证明了,目前 LLM 的发展路径并不能「顺便攻克」科学发现。

这条通往科学超级智能之路,需要更多有识之士共同并肩而行。