【k8s】arm架构从零开始使用containerd部署k8s1.30.14+KubeSphere

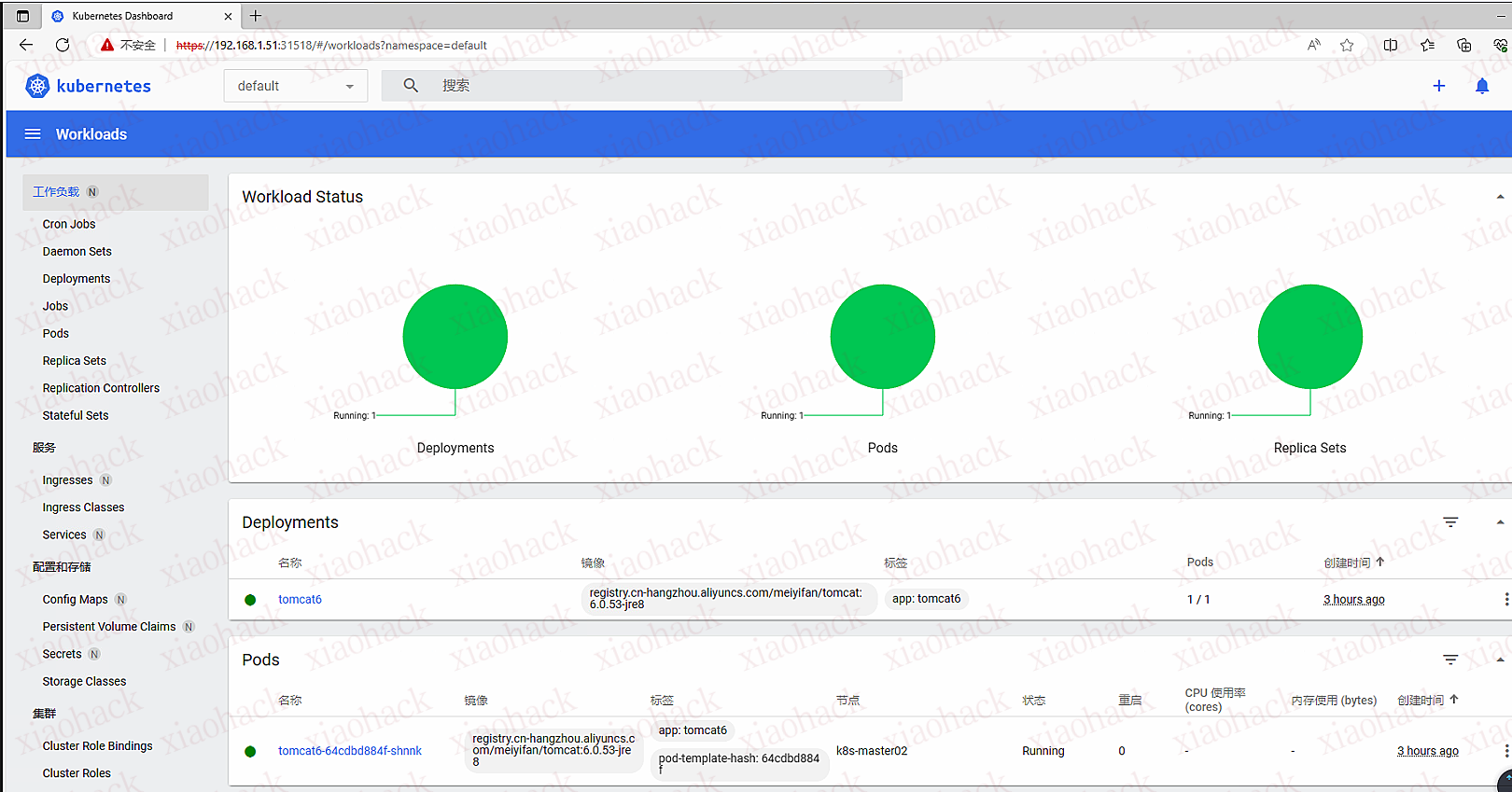

本文在 kt新增功能点 离线环境部署增强。常用国际和国产操作系统依赖,内置到安装包中。已适配芯片和操作系统如下 支持开启防火墙,只暴露 kt版本更新和下载地址 服务器基本信息 <!-- 这是一张图片,ocr 内容为: --> 操作系统不需要安装docker,不需要设置selinux,swap等操作,全新的操作系统即可。 将离线制品、配置文件、kt和sh脚本上传至服务器其中一个节点(本文以master为例),后续在该节点操作创建集群。本文使用kt: <!-- 这是一张图片,ocr 内容为: --> 根据实际服务器信息,配置到生成的 解压 该命令 <!-- 这是一张图片,ocr 内容为: --> 此命令会在 <!-- 这是一张图片,ocr 内容为: --> <!-- 这是一张图片,ocr 内容为: --> <font style="background-color:rgb(255,245,235);">说明:</font> <font style="background-color:rgb(255,245,235);">Harbor 管理员账号:</font><font style="background-color:rgb(255,245,235);">admin</font><font style="background-color:rgb(255,245,235);">,密码:</font><font style="background-color:rgb(255,245,235);">Harbor@123</font><font style="background-color:rgb(255,245,235);">。密码同步使用配置文件中的对应password</font> <font style="background-color:rgb(255,245,235);">harbor 安装文件在 /opt/harbor<font style="background-color:rgb(255,245,235);"> 目录下,可在该目录下对 harbor 进行运维。</font> 创建 Harbor 项目 <!-- 这是一张图片,ocr 内容为: --> 此命令kt会自动将离线制品中的镜像推送到 执行后会有如下提示,输入 <!-- 这是一张图片,ocr 内容为: --> 等待一段时间,直至出现熟悉的等待安装完成的小箭头>>---> <!-- 这是一张图片,ocr 内容为: --> 期间可以另开一个窗口用以下命令查看部署日志 继续等待一段时间,可以看到在内核3.10.0上面使用containerd成功部署了1.30.14版本+ks <!-- 这是一张图片,ocr 内容为: --> <!-- 这是一张图片,ocr 内容为: --> ps: 登录页面 <!-- 这是一张图片,ocr 内容为: --> 集群管理 <!-- 这是一张图片,ocr 内容为: --> 集群节点 <!-- 这是一张图片,ocr 内容为: --> 监控告警 <!-- 这是一张图片,ocr 内容为: --> 集群信息 <!-- 这是一张图片,ocr 内容为: --> 节点情况 <!-- 这是一张图片,ocr 内容为: --> 配置文件默认只安装了监控,如果需要安装其他组件,可以自行在自定义资源中开启 <!-- 这是一张图片,ocr 内容为: -->鲲鹏920和openEuler,从0开始使用Containerd部署k8s1.30.13+Ks。1.说明

关于kt

kt是基于kk二次开发的产物,具备kk的所有功能。二开主要为适配信创国产化环境、简化arm部署过程和国产化环境离线部署。支持arm64和amd64架构国产操作系统,已适配芯片+操作系统 如下。./kt init-os 一条命令完成操作系统依赖安装和初始化操作。30000-32767端口,其他k8s端口添加到节点白名单。./kt firewall 一条命令自动获取节点信息开白名单和防火墙。2.环境准备

主机名 架构 OS 配置 IP master arm64 openEuler 2核4G 192.168.0.101 node arm64 openEuler 2核4G 192.168.0.133 harbor arm64 openEuler 2核4G 192.168.0.232 2.1 上传离线制品

3.1.13.1版本

2.2 修改配置文件

config-sample.yaml中kind: Cluster

metadata:

name: sample

spec:

hosts:

- {name: master, address: 192.168.0.101, internalAddress: 192.168.0.101, user: root, password: "123213", arch: "arm64"}

- {name: node1, address: 192.168.0.133, internalAddress: 192.168.0.133, user: root, password: "123213", arch: "arm64"}

- {name: harbor, address: 192.168.0.232, internalAddress: 192.168.0.232, user: root, password: "123213", arch: "arm64"}

roleGroups:

etcd:

- master

control-plane:

- master

worker:

- node1

# 如需使用 kt 自动部署镜像仓库,请设置该主机组 (建议仓库与集群分离部署,减少相互影响)

# 如果需要部署 harbor 并且 containerManager 为 containerd 时,由于部署 harbor 依赖 docker,建议单独节点部署 harbor

registry:

- harbor

controlPlaneEndpoint:

## Internal loadbalancer for apiservers

internalLoadbalancer: haproxy

domain: lb.kubesphere.local

address: ""

port: 6443

kubernetes:

version: v1.30.14

clusterName: cluster.local

autoRenewCerts: true

containerManager: containerd

etcd:

type: kubekey

network:

plugin: calico

kubePodsCIDR: 10.233.64.0/18

kubeServiceCIDR: 10.233.0.0/18

## multus support. https://github.com/k8snetworkplumbingwg/multus-cni

multusCNI:

enabled: false

registry:

type: harbor

registryMirrors: []

insecureRegistries: []

privateRegistry: "dockerhub.kubekey.local"

namespaceOverride: "kubesphereio"

auths: # if docker add by `docker login`, if containerd append to `/etc/containerd/config.toml`

"dockerhub.kubekey.local":

username: "admin"

password: Harbor@123 # 此处可自定义,kk3.1.8新特性

skipTLSVerify: true # Allow contacting registries over HTTPS with failed TLS verification.

plainHTTP: false # Allow contacting registries over HTTP.

certsPath: "/etc/docker/certs.d/dockerhub.kubekey.local"

addons: []2.3 系统初始化

kt-centos.tar.gz文件后执行./kt init-os -f config-sample.yaml 已适配操作系统和架构见1.说明kt会根据配置文件自动判断操作系统和架构以完成所有节点的初始化配置和依赖安装。

3 创建 Harbor私有仓库

3.1 创建镜像仓库

./kt init registry -f config-sample.yaml -a artifact-arm-k8s13014-ks3.4.1.tar.gzharbor节点自动安装docker和docker-compose

3.2 创建harbor项目

chmod +x create_project_harbor.sh && ./create_project_harbor.sh

4 创建k8s和KubeSphere

./kt create cluster -f config-sample.yaml -a artifact-arm-k8s13014-ks3.4.1.tar.gzharbor 私有仓库yes/y继续执行

kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l 'app in (ks-install, ks-installer)' -o jsonpath='{.items[0].metadata.name}') -f

5 验证

default-http-backend那个pod显示:ImagePullBackOff,没啥用,不需要理会。