AI 手机隐私数据出端风险分析

引子

云端大模型正日益提升人类生产力,与此同时,端侧智能领域也在不断突破技术瓶颈。现在,端侧大模型已成功落地手机终端,可在本地处理隐私数据,提供总结、命名等实用功能。但端侧智能的能力仍有提升空间,手机暂时无法完全摆脱对云端大模型的依赖,端云协同的范式仍然是未来很长一段时间内端侧智能的主旋律。

在这种背景下,当隐私数据需要上传至云端处理时,手机厂商该如何保障用户的数据安全呢?

让我们看看隐私保护领域的标杆——苹果的解决方案。2024年,苹果就已经推出了隐私云计算(Private Cloud Compute,简称PCC)的概念:

Apple Intelligence 是为 iPhone、iPad 和 Mac 带来强大生成模型的个人智能系统。对于需要使用大模型处理复杂数据的高级功能,我们创建了私有云计算 (PCC),这是一个专为私有 AI 处理而设计的突破性云智能系统。私有云计算首次将 Apple 设备业界领先的安全性和隐私保护扩展到云端,确保发送到 PCC 的个人数据除了用户本人之外,任何人都无法访问——甚至 Apple 也无法访问。PCC 采用定制的 Apple 芯片和专为隐私保护而设计的强化操作系统构建,我们相信它是迄今为止部署用于大规模云 AI 计算的最先进的安全架构。

看起来这确实是化解隐私数据出端被泄露风险的好办法。但关键在于,这项技术是否已经真正落地到苹果手机里?我们在使用云端的 AI 时,发送出去的内容真的只有我们自己能看到吗?

本文带大家分析 BH USA 2025/Defcon33 的议题:AppleStorm - Unmasking the Privacy Risks of Apple Intelligence,分析Siri 隐私数据出端可能导致的隐私泄露风险。

抓包

想要知道哪些数据被传输到云端了,我们必须能够抓到数据包。

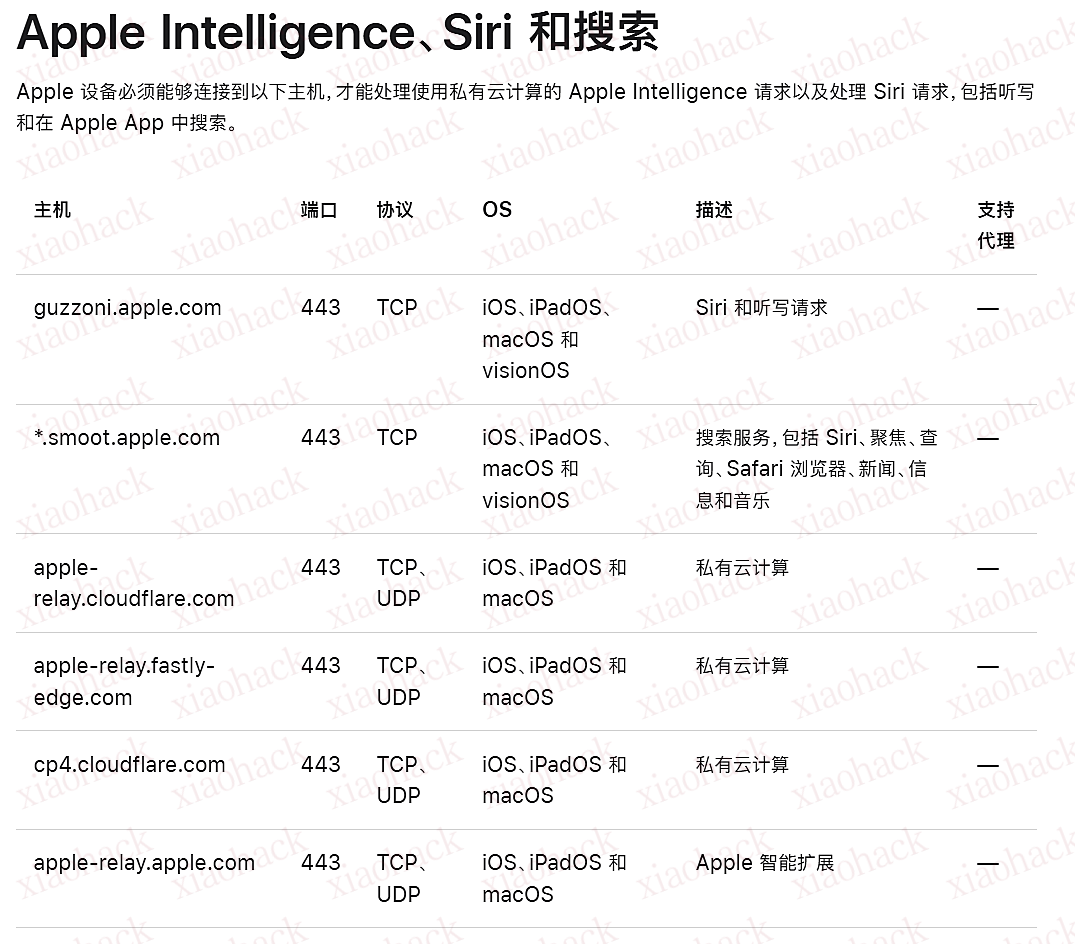

从这里可以看到,苹果 AI 相关服务器的一些主机地址:

大家可能发出疑问:为什么私有云计算和 Siri 是不同的主机地址?隐私云计算不就是为了保护Siri 的上云请求吗?这个问题的答案我们放在后面揭晓。

作者研究发现发送给 guzzoni.apple.com的数据包被做了多层防护,除了证书锁定,苹果还使用了自定义的名为ACE的通信协议,作者花了很大功夫进行协议解析,并且魔改了mitmproxy才成功抓到数据包。工具已开源。

在数据包都能抓到以后,我们来看看不同的场景下,都有哪些数据被 Siri 上传到云端了,以及传输是否做好了加密。

隐私数据出端泄露风险

在开始测试之前,作者预先关闭了系统中的"学习应用习惯以提供智能建议"等个性化功能,避免非必要请求干扰测试,确保在使用 Siri 时捕获的数据包为最小必要集合。

场景一:上云功能

以天气查询为例,询问 Siri What is the weather in Las Vegas?,手机所在的经纬度位置、手机里的天气相关的 APP名称(甚至如果手机里安装了虚拟机,里面天气相关的 APP 都会被找出来)、手机播放列表正在播放的内容信息都会被发送给搜索服务的主机:api-glb-ause1c.smoot.apple.com。此外,手机里当前打开的 APP列表会被发送到听写请求服务器:guzzoni.apple.com。

一个简单的天气询问,提供给云端的信息量已经远远超出于解决该问题所需的内容。

上述这些隐私数据,用户只能控制位置信息是否提供给 Siri,其他的隐私数据都是被悄悄发送到云端了。除了天气搜索外,在使用 Siri 进行计算、在线搜索、文章搜索时,也都会上传类似的数据。

上述这些隐私数据,用户只能控制位置信息是否提供给 Siri,其他的隐私数据都是被悄悄发送到云端了。除了天气搜索外,在使用 Siri 进行计算、在线搜索、文章搜索时,也都会上传类似的数据。

并且,这些请求并没有经过隐私云计算处理,攻击者拦截到数据后可以轻易查看其中的内容。

场景二:端侧功能

对于发送消息、邮件、日历这些端侧功能,Siri 总没有必要再把数据传到云端了吧?

抓包发现,手机里当前打开的 APP列表和当前播放内容的信息仍然会被发送到 guzzoni.apple.com 这个听写服务器。更要命的是,在使用 Siri 发送消息的功能时,像发送 iMessage、发送消息到 WhatsApp,发送的信息的内容以及目标联系人,都会发送给 guzzoni.apple.com 一份。

风险总结如下:

风险来源与消解措施

隐私数据为什么上云?为什么 PCC 没落地?

苹果官方的回应是:上述 smoot 和 guzzoni 服务是给 Siri 用的,而不是 Apple Intelligence,PCC 是用来保护 Apple Intelligence的,像 Writing Tools、Extensions-ChatGPT这些功能。

PS:可是 Siri也能调用 Apple Intelligence的功能,这样同一个 APP有两条上云链路、两套隐私保护政策,本身就很不合理。

使用 Siri 发消息,为什么会传给云端?

实验证明是苹果给开发者提供的 SiriKit导致的问题,苹果后续将考虑修复该问题。

如何消解风险?

guzzoni听写服务对正常功能没有影响,可以屏蔽掉相关的请求(如果可能的话)。

启发

像苹果 Siri这种不安全的传输用户隐私数据的风险,应该是智能手机当前面临的共同问题。不管是为了提高用户的智能体验,亦或仅仅是上传了日志,都有可能在使用 AI 时不安全的上传了用户的隐私数据。

不管是苹果手机还是安卓手机,对系统级别 APP 抓包的管控越来越严格,安全研究人员和普通用户在使用 AI 时,对隐私数据使用透明化的需求越来越高。希望手机厂商在未来做好AI隐私数据使用的透明化和安全保护。

声明

本文所有内容仅供安全研究、教育和防御性安全测试使用。使用者需:

1遵守当地法律法规

2仅在授权环境中进行测试

3不得用于非法入侵或恶意攻击

4对使用后果自行承担责任

参考资料

3AppleStorm-Unmasking the Privacy Risks of Apple Intelligence