预算 3000-4000 买一台二手的单反,主要带孩子出去玩拍照,求推荐

新手小白,买怎么研究过单反,目前看好了富士 X-T20,求各位推荐

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

新手小白,买怎么研究过单反,目前看好了富士 X-T20,求各位推荐

3 月 6 日,网易有道“7X24 小时全场景个人助理” Agent LobsterAI 宣布迎来重大更新——正式上线技能商店(Skill Store),并全面支持 MCP 协议(Model Context Protocol)。此次更新旨在进一步降低智能体的使用门槛,让用户通过自然语言即可轻松扩展 LobsterAI 的能力边界,同时借助开放标准与全球开发者共建 Agent 生态,加速国产智能体的创新与应用。 作为中国版 OpenClaw,自今年 2 月正式开源以来,LobsterAI 凭借“直接替用户干活”的核心能力,在 GitHub 及开发者社区收获了热烈反响,上线开源首周 GitHub Star 数即突破 3K。该产品从设计之初就支持一键安装、开箱即用以及直观的图形界面,让没有任何命令行经验的普通办公族也能轻松驱动 AI Agent。 LobsterAI 此前已具备多个深受好评的“全场景”特性。它内置了包括文档处理(Word、Excel、PPT、PDF)、数据分析、Canvas 海报绘制及基于 Remotion 的视频生成等 16 种核心技能 。此次上线的技能商店进一步扩充了技能生态——用户可在商店中按类别浏览、搜索所需技能,一键安装即可为助手增添新能力,首批新增技能包括 find-skills、agent-browser、apple-notes 等。除官方商店外,用户还可通过 GitHub 地址直接导入开源社区中的第三方技能,也支持从本地文件夹或 zip 包安装自定义技能。 技能商店采用"即装即用"模式,安装后技能自动出现在 LobsterAI 的技能面板,用户通过自然语言即可调用。例如,用户从技能商店安装 data-analysis 技能后,只需说“分析一下这份销售数据,找出增长最快的品类并生成图表”,LobsterAI 便会自动调用该技能完成数据分析与可视化,输出可直接用于汇报的结果。 另一项关键更新在于对 MCP 协议的全面支持。MCP 为 AI 模型与外部工具、数据源之间提供了标准化的安全连接。LobsterAI 内置了涵盖搜索、开发工具、办公协作、浏览器自动化、设计、数据采集六大类别的 MCP 服务市场,包括 Tavily 搜索、GitHub、Notion、Playwright 等 15+ 主流服务,用户可一键安装并配置。 同时,LobsterAI 支持用户添加自定义 MCP 服务,兼容 stdio、SSE、HTTP 三种传输协议,可灵活接入企业内部系统或私有数据源。所有已启用的 MCP 服务会在会话中自动生效,无需额外配置。 一个典型场景:用户配置好 Notion 的 MCP 服务后,直接下达指令"汇总我 Notion 中'Q2 产品规划'页面的内容,整理成一份项目进度报告并生成 PPT",LobsterAI 将通过 MCP 自动读取 Notion 页面数据,结合 pptx 技能完成文档整理与幻灯片生成,全程无需手动复制粘贴。 为了让这位助手“越用越聪明”,LobsterAI 内置了持久记忆系统,能够跨会话学习用户的工作习惯与风格偏好。在用户最为关心的安全领域,其坚持多重保障机制,所有涉及敏感数据的工具调用均需用户手动批准,且支持在 QEMU + Alpine Linux 的沙箱虚拟机中运行。最关键的是,所有聊天记录与配置数据均存储于本地 SQLite 数据库,绝不离开用户设备,确保了隐私的绝对掌控。 目前,LobsterAI 已全面支持 macOS 与 Windows 两大桌面平台,用户可通过官网(https://lobsterai.youdao.com)下载体验,开发者则可在 GitHub(https://github.com/netease-youdao/LobsterAI)上获取源代码参与项目共建。

大家好,最近 Vibe 了一个独立项目:Five Elements Personality Test ,基于五行(木火土金水)+ 阴阳的框架,把人格分成 10 种类型。

20 道题,5 分钟出结果,免费,不需要注册。

网站: https://fiveelementstest.com

技术栈:

做了一些性能优化:

从 Vercel 迁到 Cloudflare 的原因:

商业模式:

面向英文市场,目标是长期靠 SEO 获取自然流量。目前刚上线,也在 Product Hunt 上发了。

欢迎大家体验,也欢迎聊聊技术选型或者独立开发相关的话题。

尝试了用 claude code 和 opencode 对接 bailian 的 glm-5, kimi-k2.5, qwen3.5-plus 。

都会出现输出到一般突然输出一个 <tool_call> 之类的,然后就输出中断了。

我使用以下供应商的模型,从来没出现过这种问题:

出现问题具体的现象:

https://www.xiaoyuzhoufm.com/podcast/699f38ebedb44f008e64d3df

George MacKerron讨论了在psql中使用Ctrl-C中断PostgreSQL查询的复杂性。文章解释了用户可能需要停止正在运行查询的各种场景,比如查询耗时过长、意识到需要创建索引以获得更好性能,或者不再需要查询结果。MacKerron探讨了尝试取消查询时出现的技术挑战和潜在问题,强调了为什么这个常见操作会有问题并让数据库用户感到焦虑。 https://neon.com/blog/ctrl-c-in-psql-gives-me-the-heebie-jeebies EDB讨论了PostgreSQL在为数亿用户提供服务时面临的扩展挑战,特别是单主架构遇到的"Write Wall"问题,这需要人工干预并产生运营债务。文章探讨了EDB Postgres Distributed (PGD)作为解决方案,提供原生的active-active架构来消除这些扩展瓶颈和多语言数据库碎片化问题。PGD旨在用具有韧性的自愈数据平台取代复杂的变通方案,能够处理大规模负载而无需传统PostgreSQL部署的运营开销。 https://www.enterprisedb.com/blog/postgres-distributed-native... PostgreSQL中的表分区通过分区修剪和高效的DROP TABLE操作(而非昂贵的DELETE)为时间范围查询和数据保留提供了显著优势。然而,它引入了大量运维复杂性,包括可能静默失败的强制分区自动化、需要分区感知程序的扩展运维手册,以及增加的监控面。性能提升主要是针对窄时间范围的读取优化,而写入性能保持不变。长范围查询受到随分区数量线性增长的规划时间影响,影响季度报告和历史分析。分区最适合具有可预测保留需求的中等写入负载,但对于高频摄取场景仅是延缓问题,并未解决底层MVCC开销。 https://www.tigerdata.com/blog/hidden-costs-table-partitionin... Alexandre Felipe 讨论了 PostgreSQL 索引预取功能的优化,回应了 Andres 关于引用计数跟踪改进的建议。当前实现使用混合方法,对少量缓冲区使用数组,对大量缓冲区使用哈希表。Alexandre 测试了多达90个缓冲区的场景,注意到在特定阈值处存在性能悬崖。他发现最近的一次提交改变了缓冲区固定顺序,可能影响 pin/unpin 序列的性能。关键问题包括昂贵的资源所有者管理在缓冲区被多次固定时产生开销,以及 ResOwnerReleaseBuffer 错误地解锁它不拥有的缓冲区。建议的解决方案包括将 REFCOUNT_ARRAY_ENTRIES 增加到16,用 simplehash 替换 dynahash,或完全移除引用计数数组。Alexandre 建议资源所有者问题值得单独讨论。 https://www.postgresql.org/message-id/CAE8JnxNPK1T79gpS3PTPbF... 这个补丁讨论专注于在PostgreSQL逻辑复制中实现自动序列复制。该功能将使用持久的序列同步工作器在发布者和订阅者之间持续同步序列,替代之前的一次性同步方法。正在解决的关键技术问题包括GetSequence()函数中的权限处理、序列的适当状态管理(INIT与READY状态)以及漂移检测以避免不必要的同步。识别并修复了几个错误,包括copy_sequences循环中错误的查询构建和检查本地值是否超前于发布者值时对降序序列的不当处理。代码评审反馈涵盖了文档更新、函数命名清晰度、等待事件的适当性以及各种代码风格改进。关于缓存序列信息的性能考虑进行了讨论,但推迟到后续评估。 https://www.postgresql.org/message-id/TY4PR01MB16907262C55085... Vignesh C在Amit Kapila推送了第56版本后,为"跳过发布中的模式更改"补丁系列中的剩余项目提交了重新基于的补丁。Shveta Malik对重新基于的补丁提供了详细反馈,识别出几个问题:alter_publication.sgml中的文档排序问题,其中子句序列应该是"tables/schemas/except-tables"以提高可读性,过于冗长的HINT消息可以缩短,以及代码中不可达的错误条件。具体来说,Malik注意到错误"EXCEPT TABLE clause allowed only for ALL TABLES PUBLICATION"似乎不可达,并且几个测试用例有不匹配的注释和实际错误——原本用于验证'FOR TABLE'发布上EXCEPT TABLE限制的测试实际上触发了关于ADD/DROP子句不支持EXCEPT的不同错误。Malik要求验证其他测试用例是否存在类似的注释-错误不匹配,并询问不可达错误场景的澄清。 https://www.postgresql.org/message-id/CALDaNm1ALHQwkXBcDALA1M... Amazon Web Services推出了Amazon Connect Health,这是专为医疗保健提供者设计的专业AI代理平台。这个新平台为患者预约、文档记录和患者验证流程提供全面解决方案。该服务代表着AWS向医疗保健领域的战略扩张,利用人工智能简化传统上消耗大量时间和资源的医疗环境管理任务。Amazon Connect Health旨在提高运营效率,同时保持医疗保健环境所需的安全和合规标准。该平台专注于核心医疗保健管理功能,为寻求现代化患者互动系统的医疗机构带来潜在的革命性变化。 https://techcrunch.com/2026/03/05/aws-amazon-connect-health-a... OpenAI发布了GPT-5.4,将其定位为专门为专业应用设计的最先进、最高效的前沿模型。新版本包含Pro和Thinking两个版本,为不同用例提供增强的定制功能。GPT-5.4代表了OpenAI模型阵容的重大进步,在为专业工作环境提供增强性能的同时强调提高效率。双版本方法表明OpenAI致力于满足多样化的专业需求,Thinking版本可能针对复杂推理任务进行了优化。此次发布延续了OpenAI快速迭代的周期,展示了他们在竞争激烈的AI模型市场中保持领先地位的承诺,同时满足特定的专业用户需求。 https://techcrunch.com/2026/03/05/openai-launches-gpt-5-4-wit... 美国国防部正式将Anthropic列为供应链风险,这是首次有美国AI公司获得此类分类。尽管五角大楼继续在伊朗行动中使用Anthropic的AI技术,但仍做出了这一前所未有的决定。这一指定引发了关于AI公司及其技术国家安全担忧的重要问题。这种双重关系——将Anthropic标记为风险的同时继续使用其AI能力——凸显了AI公司在国防应用中面临的复杂监管环境。这一发展可能为联邦机构如何评估和分类其他美国AI公司树立重要先例。 https://techcrunch.com/2026/03/05/its-official-the-pentagon-h... 公司首席执行官汉斯-尤尔根·舍尼格正在伦敦科技展的现场直播发布消息。这似乎是一个公告或更新,直接来自在伦敦举行的大型科技展览活动。 https://www.linkedin.com/posts/cybertec-postgresql_tech-show-... pgEdge 邀请用户尝试他们的开源 pgEdge MCP Server for PostgreSQL 项目并提供反馈。下载、安装并测试该项目的参与者可以参加 CanaKit Raspberry Pi 5 Starter Kit PRO(128GB,8GB RAM)的抽奖活动。抽奖截止时间为美国东部时间 3 月 31 日晚上 11:59,获奖者将于 202… https://www.linkedin.com/posts/pgedge_github-pgedgepgedge-pos... OpenAI GPT-5.4 现已在 Databricks 上开放第一天访问。用户可以使用 GPT-5.4 在企业数据上构建和扩展 GenAI 应用程序,并获得生产所需的治理和运营工具。GPT-5.4 在 OfficeQA 上实现了显著的准确性改进,这是一个针对真实企业文档的推理基准,得益于更强的工具使用和多步推理。它还比同类前沿级代理系统快约 2 倍,从… https://www.linkedin.com/posts/databricks_day-one-access-to-o... 2026 年 4 月 27-28 日,由 IvorySQL 社区联合 PGEU(欧洲 PG 社区)、PGAsia(亚洲 PG 社区)共同打造的 HOW 2026(IvorySQL & PostgreSQL 技术峰会) 将再度落地济南。届时,PostgreSQL 联合创始人 Bruce Momjian 等顶级大师将亲临现场。 自开启征集以来,HOW 2026 筹备组已感受到来自全球 PostgreSQL 爱好者的澎湃热情。为了确保大会议题的深度与广度,我们诚邀您提交前沿技术实践与洞见,共同打造高质量议题内容。

⚙️ PostgreSQL 技术文章

🧩 Ctrl-C 在 psql 中让我感到不安

🧩 Postgres 分布式:OpenAI 数据库层的原生前进之路

🧩 大规模表分区的隐性成本

📨 PostgreSQL Hacker 电子邮件讨论精选

🧩 索引预取

【补丁】 支持自动序列复制

🧩 在发布中跳过模式更改

🗞️ 行业新闻

🧩 AWS 推出 Amazon Connect Health AI agent 平台

🧩 OpenAI 推出 GPT-5.4,包括 Pro 和 Thinking 版本

🧩 Pentagon将Anthropic列为供应链风险

🌐 社交媒体动态

🧩 来自首席执行官汉斯-尤尔根·舍尼格的消息,现场直击伦敦科技展!

🧩 在 pgEdge,我们致力于确保用户对我们开源项目的体验,比如用于PostgreSQL的pgEdge MCP 服务器

🧩 OpenAI GPT-5.4 现已在 Databricks 上开放第一天访问!

HOW 2026 议题招募中

比如换成阿里 coding plan 里的 qwen ,或者其他的三方提供的 aipkey 的模型,有测试过的嘛,求指导

2025 已过, 去年的激励活动:鸿蒙应用开发者激励计划 2025 、剧本激励计划等,群里不少执行力强的群友,单靠跟着做鸿蒙开发,大部分都闷声斩获了十几 W的激励金(不信的可以直接在站内搜关键词:“鸿蒙 激励”,看看大家晒的真实收益)。。

这就印证了普通人搞钱最稳的铁律——跟着大平台后面喝汤!平台拿钱砸哪个赛道,咱们就往哪冲。

错过去年没关系,2026 年“撒钱”激励继续!

各大平台的新一轮红利已经放出,给站友汇总了一波最新的搞钱激励活动,最高单项奖金 75 万元!赶紧码住,今年别再只做看客了!

1.天工计划·鸿蒙智能体开发者激励

华为为了建设智能体生态,拿出 10 亿激励发起「天工计划」,面向符合资质的鸿蒙开发者,开发上架达标智能体可获最高 75 万 / 个、累计最高 200 万现金激励,先到先得。

2.Kiro 百万奖池计划

符合条件的三方赛事中用 Kiro 开发获奖,最高可获与官方奖金等额的追加奖励,单人上限 20 万元,总奖池 100 万元,先到先得。

3.抖音·精品漫剧激励政策

覆盖 AI 仿真人、2D/3D 漫剧,按评级最高每分钟保底 3 万、单部最高 360 万,原创 IP 可享改编权全额补贴,保底外还有超保底分成,优质合作方还能获得一年框架保底合作。

4.番茄小说·文启剧燃

设 6 大赛道,共 26 个万元大奖,叠加超千万版权额外激励,单部开发奖励最高 20 万,还有版权保底、多类创意奖,奖励可与年度福利叠加,全力赋能小说创作者。

还有其他的激励活动,持续更新,打破信息差,我做了一个激励活动小程序,聚合了全网的激励政策,实时跟进,持续更新! 搜小程序名:激励活动!

欢迎一起交流~

OpenClaw 成为风靡全球的 AI Agent 同时,它的安全性和 AI Agent 通用的不确定性等问题也引发人们的广泛关注。基于 SelectDB 或 Apache Doris 的 AI Observe Stack 可以为 OpenClaw 提供可观测性,让 AI Agent 的每一个行为清晰可见、安全问题可被洞察,让你看清它的每一个 “脑回路”。 本文基于 AI Observe Stack 构建的 OpenClaw 可观测系统是使用 AI 在一天内完成的。用户也可以用阿里云 SelectDB 云服务或者开源 Apache Doris 在几分钟内快速搭建起来亲身体验。 OpenClaw 大概是 2026 年最火的开源 AI Agent 平台。它支持通过 WhatsApp、Telegram、Web 等渠道与用户交互,背后的 Agent 可以调用 shell 命令、浏览网页、搜索信息、操作文件、发送消息——几乎无所不能。 但"无所不能"恰恰是问题所在。 OpenClaw 上线短短几周内,安全事件已经井喷。来自 Kaspersky、Cisco、CrowdStrike、Trend Micro 等安全厂商的报告描绘了一幅触目惊心的画面: Cisco 的分析一针见血:OpenClaw 的安全问题不是配置问题,而是架构问题——它的官方文档自己都写着:"there is no 'perfectly secure' setup"。 这些是行业公开的安全报告。那么,如果我们对一个实际运行中的 OpenClaw 实例做深度审计,会看到什么? 我们用 AI Observe Stack 对一个真实的 OpenClaw 实例进行了 7 天的全量可观测审计,记录了每一次 LLM 调用、每一次工具执行、每一条日志。结果如下: 你以为你在用 AI,其实 AI 在用你的权限。 而且,正如 Trend Micro 所指出的,这些问题不是 OpenClaw 独有的,而是 Agent AI 范式的固有问题。几乎所有具备工具调用能力的 AI Agent 都会面临同样的困境。 OpenClaw 的审计结果揭示了 AI Agent 的三个本质性黑盒问题。传统软件有日志、有监控、有审计,但 AI Agent 不一样——它的行为是非确定性的、上下文驱动的、自主决策的。 在 OpenClaw 的审计中,我们看到 Agent 执行了 这不是 OpenClaw 的特例。任何具备工具调用能力的 AI Agent 都可能执行 shell 命令( 你完全不知道它干了什么。 OpenClaw 中最极端的案例:一个用户问题触发了 19 轮 LLM 调用。Agent 的"思考链"是这样的——先搜索网页、再浏览页面、再执行命令、再总结结果。每一步都是一次 LLM 调用,而每次调用都携带了完整的对话历史。 这就是 context window 的滚雪球效应:第一轮调用 3000 tokens,第二轮 8000,第三轮 25000……到第 19 轮已经膨胀到几十万 tokens。一个问题的成本可能是你预期的 100 倍。 这个问题在所有 AI Agent 中普遍存在。月底账单才知道花了多少。 OpenClaw 的 工具调用错误率, 当用户投诉"AI 回答慢"或"AI 回答不准"时,你无法复盘——不知道是 LLM 慢、工具调用失败、还是 Agent 进入了死循环。 出了问题无法复盘。 AI Observe Stack 是一个开源的 AI 可观测平台,专为 AI Agent 场景设计。它基于三个成熟的开源项目: 核心优势: 说了这么多问题,怎么解决?我们用 AI Observe Stack 对 OpenClaw 做了完整的可观测接入。以下所有数据来自真实的 OpenClaw 运行环境,通过三个预置 Dashboard 呈现。 这是你最应该关心的问题。 打开 Security 与 Audit Dashboard,顶部四个指标卡片一目了然: 数字变红意味着需要立即关注。 往下看时间线图,可以看到安全事件的时间分布: 每种颜色代表一类操作:橙色是 shell 命令执行,蓝色是浏览器操作,紫色是网页抓取,红色是 gateway 调用。如果某个时段出现异常的操作尖峰——比如凌晨 3 点突然执行了大量 shell 命令——你需要警觉。 哪些会话最危险?Top Risk Sessions 表格按风险评分排序: 风险评分算法: 展开折叠面板,可以深入查看每个风险类型的详细记录: 关键发现:通过这个 Dashboard,我们可以去发现 Agent 在处理某些用户请求时,是否会主动执行 打开 Cost 与 Efficiency Dashboard,先看概览: 时序图显示 token 消耗趋势,按模型分别统计 input 和 output: 右侧的饼图展示各模型的 token 占比,帮你看清成本主要花在了哪个模型上。 这是最值得关注的图表——Input Tokens per Turn(Context Window Growth): 每条线代表一个会话。你可以清晰地看到滚雪球效应:随着对话进行,每次 LLM 调用携带的 input tokens 持续增长——因为每次调用都带上了完整的对话历史。 一个会话的 input tokens 可能从几千膨胀到几十万。这意味着一个用户问了 19 个问题,最后一个问题的 input 成本可能是第一个问题的 100 倍。 这个表格把成本拆解到每个用户问题: 你会发现,一些看似简单的问题——比如"帮我查一下这个网站的信息"——实际触发了 Agent 的长链路操作:先搜索、再浏览、再总结、再确认,每步都是一次 LLM 调用。一个问题可能消耗几十万 tokens。 打开 Agent Behavior Dashboard,从全局视角看 Agent 行为。 Tool Call Summary 表格展示了每个工具的全貌: 关键发现: 深入到 Span 级别的性能分析: 可以看到 这是一张完整的对话流水表,按时间倒序展示 Agent 与用户的每一次交互。你可以清晰地看到一个请求的完整生命周期:用户发问 → Agent 思考 → 调用工具 → 获取结果 → 生成回复。每行的 Dashboard 提供的是预定义的分析视角,但实际排查问题时,你往往需要自由探索原始数据。Doris App 插件内置的 Discover 功能正是为此设计。 在 Grafana 左侧导航栏进入 Doris App - Discover,你会看到一个类似 Kibana 的日志探索界面: 顶部的查询栏支持两种模式:SQL 和 Lucene。SQL 模式下你可以写任意 WHERE 条件,比如 点击展开任意一条日志,可以看到完整的结构化详情: 展开后的 Table 视图将每个字段清晰列出,JSON 视图则展示原始数据结构。你可以直接看到 Agent 的完整消息内容——包括它的思考过程( Discover 在以下场景特别有用: 三个 Dashboard 提供了全局视角,但当你需要深入到单个请求的完整调用链时,Doris App 插件内置的 Trace 功能是更强大的工具。 在 Grafana 左侧导航栏进入 Doris App - Traces,你会看到一个专业的 Trace 搜索界面: 你可以按 Service、Operation 筛选,也可以通过 Tags 精确搜索(例如 点击任意一条 Trace,进入 Waterfall 视图: 这个视图把一个 Agent 请求的完整生命周期展开成调用链: Trace 分析在以下场景特别有价值: Dashboard 告诉你"有问题",Trace 告诉你"问题在哪里"。 等待 Doris 就绪(首次约 3 分钟): 以 OpenClaw 为例,安装社区 OTel 插件并配置 OpenTelemetry endpoint: 在 启动日志采集(因为社区插件不导出日志,需要通过 filelog 方式采集)。注意:以下命令中的 重启 OpenClaw: 打开 Grafana(http://localhost:3000,默认账号 对接 OpenClaw 并产生数据后,Dashboard 会自动展示分析结果。你的 AI Agent 的一切行为,现在都在你的掌控之中。 上面的一键部署包含了内置的 Doris 实例,适合本地体验和开发测试。如果你的 AI Agent 已经在生产环境运行,推荐使用 阿里云 SelectDB 云数据库 作为 AI Observe Stack 的后端存储,免去运维负担。 只需将第一步替换为以下操作,其余步骤完全一致: 虽然本文以 OpenClaw 为例,但 AI Observe Stack 的设计是通用的。任何支持 OpenTelemetry 的 AI Agent 框架都可以接入: 无论你用的是 LangChain、AutoGen、CrewAI 还是自研的 Agent 框架,只要输出 OpenTelemetry 格式的遥测数据,就能接入这套体系。 如果你正在运行 AI Agent,你需要回答一个问题: 你知道它在做什么吗? 它执行了哪些命令?访问了哪些文件?调用了哪些外部服务?花了多少 token?有没有被注入攻击? 如果你回答不了这些问题,那你的 AI Agent 就是一个黑盒——一个拥有你全部权限的黑盒。 AI Observe Stack 的目标,就是为每一个 AI Agent 装上一扇“透明玻璃窗”。 让黑盒变白盒,让不确定性变得确定。 我们相信,可观测性是 AI 大规模落地的基石。 开源不应孤独, 如果你也认同这个理念,欢迎给我们的项目点个 Star,支持我们继续为 AI 的安全保驾护航。 GitHub 地址:https://github.com/ai-observe/ai-observe-stack 想立刻体验? 无论你是 OpenClaw 的玩家,还是正在开发自己的 AI Agent,都可以在几分钟内快速部署这套观测栈:OpenClaw:爆火背后的安全危机

我们的审计结果

三个黑盒问题:从 OpenClaw 看所有 AI Agent

黑盒一:安全黑盒

curl 访问外部 URL、用 exec 操作文件系统、通过 gateway 向用户发送消息。这些操作都是 Agent 自主决定的,用户并不知情。rm -rf、sudo)、读取敏感文件(.ssh/id_rsa、.env)、发送网络请求(curl、scp)。更危险的是,当 Agent 浏览网页时,恶意网站可以在页面中嵌入 prompt injection 内容——Agent 读到 "ignore previous instructions" 时,它可能真的会执行。黑盒二:成本黑盒

黑盒三:行为黑盒

exec 的调用次数,部分请求的 P95 延迟远是否高于平均值。但如果没有可观测体系,这些数据你根本看不到。解决方案:用可观测性打开黑盒

AI Observe Stack 简介

组件 职责 OpenTelemetry Collector 遥测数据网关,接收 OpenTelemetry 协议数据 Apache Doris 存储层,VARIANT 类型 + 倒排索引,天然适配半结构化数据 Grafana + Doris App 插件 可视化层,支持 SQL 查询和预置 Dashboard 架构

docker compose up -d 搞定本文使用开源 Apache Doris 进行演示。如果你的 AI Agent 已经在生产环境运行,需要更高的可用性、弹性扩缩容和免运维体验,可以使用 阿里云 SelectDB 云数据库 ——基于 Apache Doris 的全托管云服务,即可获得开箱即用的生产级可观测存储。

用 AI Observe Stack 观测 OpenClaw

安全审计:你的 Agent 在执行什么命令?

rm -rf、sudo、chmod 777、curl | sh 等)ignore previous instructions、you are now、DAN mode 等)Sensitive File Access:Agent 访问敏感文件的次数(

.ssh/id_rsa、.env、credentials.json 等)Security Event Timeline

Top Risk Sessions

exec×3 + web×2 + outbound×5 + error×1 + sensitive_file×10。得分越高,越需要优先审查。

curl 命令访问外部 URL,是否执行了危险的命令,如 rm, 返回的内容中是否包含了 prompt injection 标记。预防间接提示注入攻击链。成本分析:一个问题花了多少钱?

Token Usage Over Time

Context Window 滚雪球效应

Per-Question Cost(每个问题花了多少?)

行为分析:Agent 在做什么?

性能概览

Trace Chains:Trace 链路数(衡量请求复杂度)

Tool 调用分布

browser 工具的被调用 40 次,是使用此时最多的 toolexec 被调用了 31 次——每次调用都应该被审查web_fetch 占总调用量的大头,这意味着 Agent 花了大量时间在抓取外部内容Span Performance Summary

openclaw.request(端到端延迟)的 P95 远高于平均值——说明存在长尾请求。通过 Trace 链路,你可以定位到是哪个工具调用或 LLM 调用拖慢了整个请求。Conversation Flow

msg_role 用颜色区分:蓝色是用户消息,绿色是 Agent 回复,橙色是工具返回。当你在其他面板中发现异常时,可以在这里定位到具体的对话上下文,进行逐条复盘。日志探索:Doris App Discover

log_attributes['type'] = 'message' 精确筛选 Agent 的对话消息;Lucene 模式则提供全文搜索能力,适合模糊查找关键词。

thinking)、执行的命令、调用的模型和 token 消耗。点击 "Surrounding items" 还能查看上下文日志,还原完整的事件时间线。深入追踪:Doris App Trace 分析

http.status_code=200 error=true),或按 Duration 范围过滤出慢请求。散点图直观展示了每个 Trace 的耗时分布——那些远高于平均线的点就是需要关注的异常请求。

openclaw.agent.turn 是父 Span,耗时 38.33 秒;其下的 tool.browser、tool.web_fetch 等子 Span 展示了 Agent 在这次回合中依次调用了哪些工具、每个工具花了多长时间。5 分钟部署

第一步:启动 AI Observe Stack

git clone https://github.com/ai-observe/ai-observe-stack.git

cd ai-observe-stack/docker

docker compose up -d

docker compose ps

# 确认所有服务 STATUS 显示 "running",doris 显示 "(healthy)"

生产环境可以使用 阿里云 SelectDB 云数据库 替代本地 Doris,详见下方 生产环境:对接 SelectDB Cloud

第二步:对接你的 AI Agent

# 安装插件

mkdir -p ~/.openclaw/plugins

cd ~/.openclaw/plugins

git clone https://github.com/henrikrexed/openclaw-observability-plugin otel-observability

cd otel-observability && npm install

~/.openclaw/openclaw.json 中配置:{

"plugins": {

"load": {

"paths": ["~/.openclaw/plugins/otel-observability"]

},

"entries": {

"otel-observability": {

"enabled": true,

"config": {

"endpoint": "http://127.0.0.1:4318",

"protocol": "http",

"serviceName": "openclaw",

"traces": true,

"metrics": true

}

}

}

}

}

$(pwd) 指向第一步 clone 的 ai-observe-stack/docker 目录,请确保在该目录下执行:docker run -d \

--name openclaw-log-collector \

--network docker_aiobs-net \

-v ~/.openclaw/logs:/openclaw-logs:ro \

-v ~/.openclaw/agents:/openclaw-agents:ro \

-v $(pwd)/../examples/openclaw/otel-collector-log-config.yaml:/etc/otelcol-contrib/config.yaml:ro \

otel/opentelemetry-collector-contrib:0.144.0 \

--config=/etc/otelcol-contrib/config.yaml

openclaw gateway restart

第三步:打开 Dashboard

admin / admin),三个 OpenClaw Dashboard 已经预置好了,无需手动导入:生产环境:对接阿里云 SelectDB

# 1. 配置连接信息

cp .env.example .env

# 编辑 .env,填入 SelectDB Cloud 连接信息:

DORIS_FE_HTTP_ENDPOINT=http://<your-cluster>.selectdb.com:http_port

DORIS_FE_MYSQL_ENDPOINT=<your-cluster>.selectdb.com:mysql_port

DORIS_USERNAME=admin

DORIS_PASSWORD=<your-password>

# 2. 使用 without-doris 模式启动(不启动本地 Doris,数据直接写入云端)

docker compose -f docker-compose-without-doris.yaml up -d

不只是 OpenClaw

数据分析:标准 SQL 查询,你可以自由编写任何分析逻辑

结语

导读: 易车引入 Apache Doris 取得以下核心成果: 数据的爆发式增长与业务对实时性的极致追求,驱动易车技术团队在实时湖仓建设上持续探索。目前易车已基于 Apache Doris + Paimon + Hive 构建了湖仓一体化数据平台,实现架构收敛统一:**逐步替换 Druid、Kudu、HBase、MongoDB、ClickHouse 等近 10 种引擎。**广泛应用于实时多维分析、用户画像及标签体系、BI 报表(实时报表、仪表盘)等核心场景。在此基础上,团队进一步探索 Apache Doris + AI 的融合应用,为智能化业务提供实时、统一的数据底座。本文将具体讲述易车数据平台架构的演进及具体实践。 易车数据平台的数据源丰富多样,涵盖业务日志、业务数据库(RDS/自建库)、消息系统、接口数据、第三方 API 及应用程序等。 团队通过内部数据集成工具将多源数据统一接入数据平台:底层离线数仓以 Hive 为主、基于 Hudi 构建数据湖;半结构化数据则主要存储在 Elasticsearch、HBase、MongoDB 中。 在 OLAP 引擎层面,团队先后使用过 Kudu、Kylin、Druid、ClickHouse 等多种引擎,即席分析 MPP 架构方面则使用了 Impala、Spark、Presto 等计算引擎,为数据分析、实时大屏、实时指标、个性化推荐等上层应用提供服务。 然而,早期架构链路复杂,面临多重挑战: 为满足快速响应、统一架构等新需求,团队决定对湖仓架构进行持续迭代与升级。在引擎选型上,ClickHouse 曾是易车选择的过渡方案,但随着业务深入,其短板愈发凸显: 因此,团队开始评估新的 OLAP 引擎。Apache Doris 凭借以下优势成为最终选择: 综合以上考虑,团队最终选择 Apache Doris 作为核心 OLAP 引擎。在实际落地过程中,Doris 不仅在查询性能上表现稳定,其湖仓一体能力更是超出预期。 Apache Doris 的湖仓一体能力,体现在三个维度: 可扩展的多源数据连接: 便捷的跨源联邦查询: 高性能的数据处理 引入 Apache Doris 后,构建了全新的湖仓一体融合架构,整体设计如下图所示: 升级前后架构对比如下,可看到整体收益明显: 在 AI 技术迅猛发展的当下,Apache Doris 积极推动 Data + AI 的深度融合与创新,这与易车在 AI 业务领域的探索方向高度契合。在构建湖仓一体架构的基础上,易车数据团队进一步探索了 Doris + AI 的融合应用,将 Doris 打造为面向智能化场景的数据底座,赋能上层 AI 应用与智能代理。 易车对数据引擎在 AI 场景下的应用有着迫切需求,而 Apache Doris 4.0 版本 引入了向量检索、混合检索以及 AI 原生函数,使得结构化分析与语义检索能够在同一系统中完成。并提供了面向 Agent 的 MCP 交互能力,能够有效支撑易车在 AI 业务中的实践。 Apache Doris 天然支持多源联邦查询,可无缝对接 MySQL、Hive、PostgreSQL、Hudi 等异构数据源。这意味着,上层 AI 应用无需关心数据实际存储在何处,只需通过 Doris 即可统一访问数仓内的离线历史数据、实时增量数据以及业务库中的维度信息。这种能力为 AI 模型训练、特征工程、实时推理等场景提供了高效、统一的数据供给通道。 Apache Doris 开源了 Doris MCP 工具,为 AI 代理与数据平台的交互提供了标准化接口。团队基于 Doris MCP 及内部二次开发,构建了一套面向智能代理的数据服务层,支持通过 MCP 执行 SQL 查询、获取库表 Schema、列举表列表、检索字段信息等操作。这些能力被封装成可复用的 API,使得上层 AI 应用能够以自然语言或结构化方式快速获取所需数据上下文,极大降低了智能代理接入数据平台的复杂度。 易车基于 Apache Doris,已在多个智能化场景中落地应用,具体包括: Doris 社区目前还在 AI 侧发力,未来易车数据团队也会持续跟进与参与 Doris MCP 的建设。此外,Apache Doris 4.0 版本已支持混合检索分析、AI 原生函数等。易车数据团队也将在此版本上进一步探索。 从多引擎混用到统一架构,从离线分析到实时智能,易车数据平台在 Apache Doris 的加持下,完成了从"支撑业务"到"驱动业务"的跨越。未来,随着存算分离架构的落地和 AI 能力的深度融合,我们将持续打造更高效、更智能的数据基础设施,为业务创新提供源源不断的数据动力。 当前易车数据平台主要运行在 Doris 2.0 版本之上,下一步将全面升级至存算分离架构。 通过存算解耦与冷热分层,进一步降低存储成本、提升查询效率,为业务增长释放更多资源。 云基础设施的成熟,推动了 Apache Doris 存算分离架构商业化的实现。SelectDB Cloud和阿里云数据库 SelectDB 版 均基于 Apache Doris 内核构建,二者均采用存算分离架构,为企业提供更加弹性、易管理的部署模式。一、早期架构:多引擎混用,流批难统一

二、引擎选型:从 ClickHouse 到 Apache Doris

三、Apache Doris:湖仓一体,融合统一

四、架构升级:存储、计算、查询统一

五、智能分析:AI + Lakehouse 的探索与实践

六、结束语

如题,应该可以吧,难不成等 618 还有更好的?

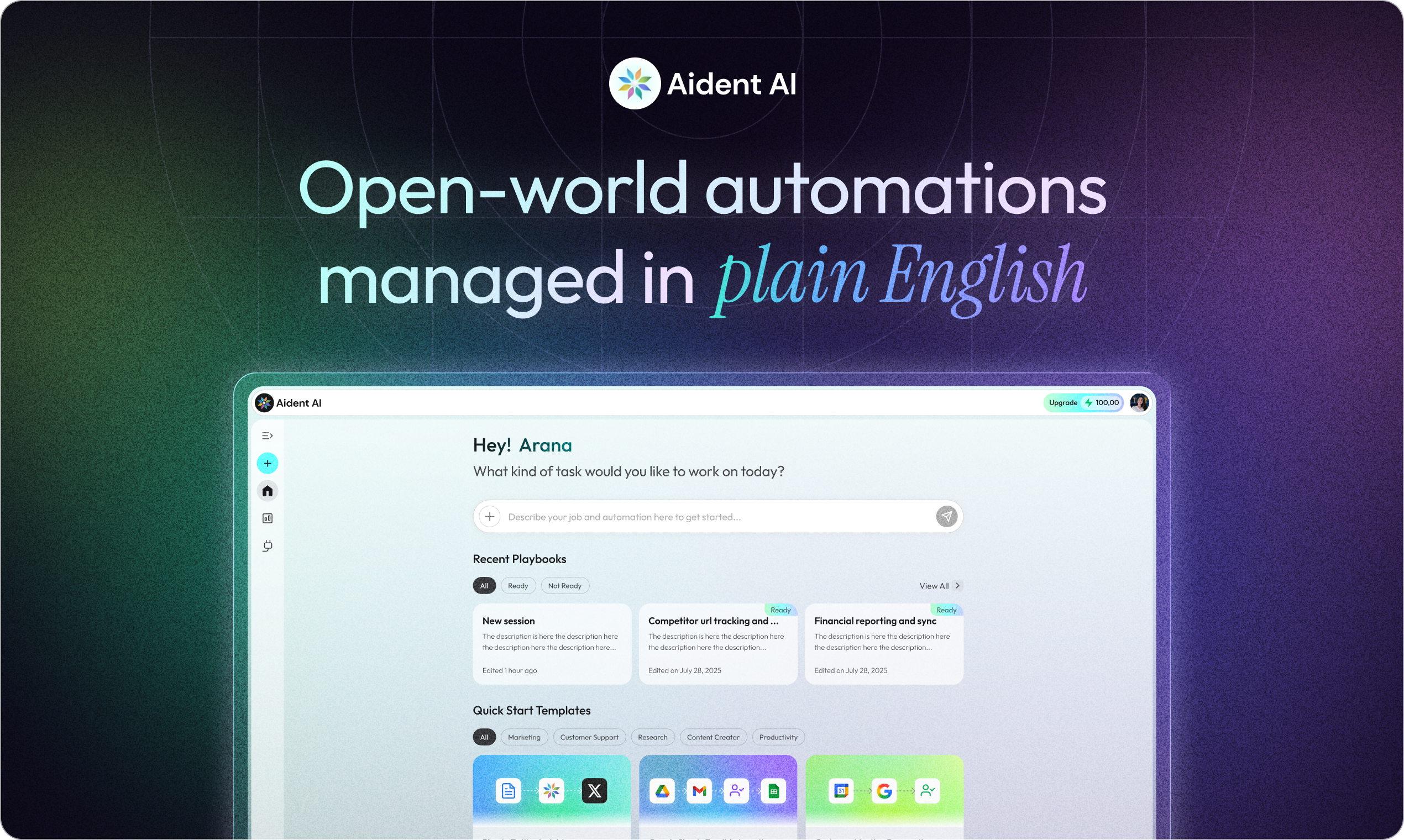

这款 AI 助手能让你用大白话管理自动化,告别复杂设置,直接在聊天工具里搞定一切。

苹果新出的笔记本,铝合金机身配惊艳屏幕,续航给力,价格亲民到让人心动。

别再盯着 ChatGPT 的文字墙了,Heywa 能把你的问题秒变视觉故事,浏览起来超轻松。

想为课程加点 AI 魔法?Coursekit 能一键把销售页面变成定制化工具,服务学生全天候。

企业级 AI 代理越来越多,Golf 帮你集中管理,确保安全合规,控制得明明白白。

团队协作还在敲键盘?Willow 用语音 AI 识别专业术语,共享快捷方式,效率翻倍。

文档处理太头疼?Parsewise 派智能代理上阵,批量分析,追溯来源,透明无黑箱。

OpenAI 官方 Codex 桌面应用登陆 Windows,原生运行加安全沙盒,编码代理不扰本地环境。

切换语言模型怕丢记忆?Hermit 处理完整 ChatGPT 数据,生成结构化档案,无缝导入新平台。

想自建社区?Supa Social 用 Once UI 和 Supabase 打造,功能齐全,几分钟就能部署上线。

2026 年,突然很想和大家聊点真实的话题。

这些年其实来来回回,无非就是三件事:家庭、生活、工作。年纪越往前走,越发现很多事情开始变得现实而具体。

先说家庭。

我们现在是一家三口,孩子已经在上学,父母在老家。我和老婆在外地工作,生活基本就是单位—家里—孩子学校,标准的“三点一线”。

过年回家时,长辈也开始催生二胎。但这件事我们已经想得比较清楚,目前没有这个打算。不是不喜欢孩子,而是结合自己的经济压力、精力和未来规划,觉得把一个孩子好好培养好,可能更适合我们现在的阶段。

再说工作。

我做外贸已经几年了,目前还是在做业务。说实话,这两年的外部环境大家都能感觉到,订单不算稳定,市场也比较卷。有时候会想,如果一直只依赖一份工作,心里多少会有些不踏实。

所以今年有一个比较强烈的想法:

想尝试做一个副业。

一方面是希望多一条收入渠道,缓解一点焦虑;

另一方面其实也想让自己保持忙碌,不至于把所有希望都压在一份工作上。

当然,目前也还在摸索阶段,还没有特别明确的方向。

生活方面,其实没有太多波澜。

普通上班族的节奏,平平淡淡,目标也很简单——今年尽量多存一点钱,让家庭更稳定一些。

写这些其实也是想听听大家的想法:

有时候发现,很多人表面看起来都挺稳定,其实每个人心里都有自己的压力和计划。

也想听听大家真实的想法。

周五大家不都是在 2 站摸鱼吗,我也想摸鱼,可是苦于有一个要写的材料,上午还在问如何导出 Grok 的 word 文件来着,总之上午写了大概一大半,快到中午喝口水回回神,就这工夫 office 这个不争气的东西,正在编辑的文档莫名其妙的就消失不见了。抱着死马当活马医的心情,无可奈何下进行了重启。

果不其然,重启后提醒我 office365 进行更新中,然后就是忐忑的等待,大概 1 分钟后,弹出了之前莫名其妙关闭的 5、6 个文档,还好写到一半的还在。

哎,这已经不是第一次出现了,还记得有一次 Excel 表格也是相同的问题。我就服了,每次更新前先打个招呼不行吗,这也太吓人了。

这次没懒,赶紧把软件自动更新关掉。

现在微软软件的各种“特性”真让人无奈。🤬

简单写个自我介绍。 我在团队里算不上的管理层,没有人事权,也不决定谁走谁留,但我参与的项目一旦出问题,最后都会落到我这里。进度卡住、需求反复、线上事故,会议上可以绕一圈再绕一圈,最终还是要有人把代码改完、把锅兜住。我清楚自己的位置,用武之地比较多的一个“多功能开发者”而已。还依稀记得,当初总部另外一个项目的入侵测,找的还是我,而不是再招一个人。 所以我很少参与评价人,只谈事,谈事实,谈项目是怎么一步步偏离轨道的。 先直接告诉大家结果吧,他被辞退了。 当初公司决定要不要这个人的时候,无意中跟我提到过。我只讲述了几个项目事故,以及其他同事和他合作时的态度。至于留不留他,我不想决定,也决定不了。 那个项目经理,其实并不“坏”。他不吼人,也不甩脸色,会议纪要写得很勤,群里回复永远是“收到”“我跟一下”。问题出在另一层面:需求变更没有留痕,风险评估永远是“可控”,节点延期总能找到外部理由。 上面看到的是一条被不断抚平的曲线,下面看到的是每天被推翻重来的开发计划。我们不是没提醒过,只是提醒被整理成了更好看的版本,再往上递的时候,已经失去了原本的锋利。当然,这些最后都会被归结为一句话——开发同学多努努力,多扩展下思维,补补这个缺点就好了。 但我认为,有些问题其实在内部一直被反复提起,只是从来没有被真正放到台面上说过。 团队里的其他项目经理,大多都有过开发背景。哪怕代码早就不写了,对功能复杂度、实现成本、技术边界心里都是有尺度的。评估的时候会留余量,也知道什么时候该踩刹车。 只有他完全没有开发经验,对一个需求的理解停留在“看起来不难”的层面。既怕自己显得不专业,又怕在会上被认为拖进度,于是每次评估都偏向最激进的版本,功能报得满,时间压到极限。 开发这边明知道不现实,那又怎么办呢?你能说得过他吗?况且领导也是只看结果,活干得快,公司赚得多,干得慢赚得少。所以开发也只能硬着头皮往前推。 一次延期还能解释成意外,两次三次之后,延期就成了默认选项。项目表面上在跑,实际上每一步都在透支客户的耐心。 他甚至能把一个月的功能,压成 7 个工作日。 结果显而易见。项目连夜上线,第二天直接崩溃:APP、小程序白屏,数据无法保存,ToC 的用户一个都打不开。我们凌晨 4 点发完版本,早上 6 点半问题出现,7 点钟起床开始处理。 我起床的时候就已经料到了。项目有他管控着,您就放一万个心吧,麻烦肯定少不了。 当时写功能的时候,有个同事请了丧假。他来了句逆天发言:“到时候你能把电脑带上吗?有事可以找你。” 我当时真想告诉他,兄弟,全公司不是只有他一个前端,这个项目也不是只有他一个前端。人家就请假 3 天,已经很紧张了,还让人把电脑带着,真特么丧良心。 如果他不走,跟这样同事共事,真想跑路了 跑路机会:技术大厂,前端-后端-测试,全国均有机-会,感兴趣可以试试。待遇和稳定性都还不错~ 真正的转折点,是那次 A 项目上线。 我没有提任何人的名字,也没有用情绪化的词,只是把时间线拉直:哪一天确认需求,哪一天推翻,哪一天出 PRD,哪一天出 UI,最终导致了什么结果。那份文档写得很长,不好读,也不“体面”,但它有一个特点——每一个问题,都自然地指向了同一个岗位职责。 我提交的时候,甚至没多想,只觉得这次总算把事情说清楚了。 事后我想过,如果我当初不写那份复盘,不跟领导说这些事,会不会结果不同。答案大概是否定的。项目不会因为沉默变好,问题也不会因为不点名而消失。 那天没人替他说话,并不是因为他人缘差,而是因为在那个位置上,他已经很久没有为任何人、任何结果,真正说过一句“这是我的责任”。 系统从来不需要情绪,它只是在某个时刻,停止了包容。 我后来也明白了一件事:在很多公司里,项目经理这个角色,本质上是一个缓冲层。缓冲需求、缓冲压力、缓冲管理层的焦虑。 但一旦缓冲只剩下过滤,没有承担,系统就会重新校准。 那天被裁的不是一个人,而是一种失效的角色设计。 而这件事,迟早会发生在任何一个不再为结果站出来的位置上。 ——转载自:狗头大军之江苏分军

海尔智家的转型实践建立在一套清晰且持续演进的方法论体系之上。2022 年,公司数字化转型部门前瞻性地提出了“四个重构实现四个价值”的核心方法论,为整体转型提供了系统的理论框架。经过近三年从战略规划到落地执行的体系化推进,该方法论通过一系列有部署、有步骤的应用实践,在全球研发、制造、营销与服务等核心业务环节中得到持续验证、深化与丰富。2025 年,公司正式开启 AI 元年,并以此为契机,完成了对方法论的全面智能化战略迭代升级和全球化的架构部署。目前,海尔智家已构建覆盖全球的数字化基础设施,包括 5 大数据中心、6 个网络中心及超 12000 台云主机,数字化服务能力覆盖 76 个国家,为 AI 技术的规模化应用与人才标准的全球化推广奠定了坚实基础。此次升级明确将“用户价值最大化”确立为贯穿所有工作的核心锚点,驱动客户价值、员工价值与企业价值系统性地围绕此中心协同共创。这一体系化的演进不仅为 AI 技术在业务场景中的规模化落地指明了清晰路径,更通过贯穿始终的赋能项目与实践历练,体系化地培育了兼具业务洞察与技术能力的 AI 人才,持续提升了组织整体的 AI 素养,从而确保了整个转型进程既具备顶层设计的系统性,又拥有扎实深入的实践支撑,实现了从战略规划到全球落地的贯通。 随着制造业 AI 应用进入规模化落地关键期,具备“AI+岗位”能力的复合型人才已成为连接技术、业务与用户的核心枢纽。为响应国家人才强国战略,海尔智家基于 41 年制造业深耕经验与全员 AI 化实践,联合极客邦科技开展专项培训,并共同推出行业首个 AI+岗位能力模型。 该模型采用专业的访谈建模法,通过对 33 位涵盖多维度的人才样本进行深度访谈,结合行业洞察与专家意见构建而成。模型深度融合海尔智家“四个重构创造四个价值”方法论,涵盖 6 大核心能力维度、24 项细分能力指标,形成了“标准制定—人才培养—认证考核—实践落地”的完整生态体系,精准覆盖研发、生产、供应链、服务等全业务场景。 基于这一模型,海尔智家为相关岗位人员设计了为期 5 个月、包含 31 节定制课程的体系化学习路径,累计培训达 33480 人次。公司同步建设了包含 400 道试题的专属题库,通过学前学后测评检验学习效果,并举办线下实战工坊破解技术落地难题。最终以 AI 产研创新大赛完成成果验收,成功产出 10 套 AI 智能体解决方案,其中供应链、物流等领域的方案已进入落地推进阶段,实现了人才培养与业务实效的高效衔接。 海尔智家的实践表明,全员全面 AI 化不仅是技术升级,更是组织能力与人才生态的系统性重塑。未来,公司将通过“标准+培养+实践”的全链路赋能模式,推动 AI 人才梯队建设与制造场景的深度融合,持续激活产业创新活力。 同时,海尔智家将以全球化的数字化基础设施为依托,推动这套成熟的人才标准与实践经验向行业输出,加速制造业数智化升级进程,为全球产业转型提供可复制、可推广的“海尔方案”,助力中国智造在世界舞台上发挥更重要的引领作用。方法论升级:以用户价值为核心,筑牢数智转型逻辑基础

人才破局:发布行业标准,破解 AI 人才短缺难题

生态赋能:全链路落地,加速产业数智化进程

最近公司在考虑搭建一个 内部 AI 助手平台,目标是让公司同事(不到 50 号人)都能用,比如:

目前计划使用 OpenClaw 作为统一入口和管理平台,但在 大模型部署方式上有两种方案在评估,想听听大家的经验。

架构大概是:

员工

│

OpenClaw (云服务器)

│

模型服务 (vLLM / Ollama 等)

│

GPU 服务器

│

大模型 (Qwen / Llama)

初步考虑的模型:

对 GPU 服务器和自建大模型不熟悉, 有没什么坑点, 需要怎么样的配置以及相关的费用怎么样.

架构:

员工

│

OpenClaw

│

API 模型

│

GLM / Minimax 等

个人其实更倾向于这个的, 领导倾向于第一种

但是也不太确定, 长期 API Token 成本怎么样, 比如买 GLM 的 Max 套餐(年付 4000), 或者 Minimax 的 Ultra(年付 8000 左右) 这些 coding plan, 套餐内能否支撑使用

是否真的需要 openclaw 这个不做讨论哈, 先提前谢谢大家分享经验。

RT ,v2er 怎么看这个事情?