UDP 上行限速,真是运营商最阴损的德行了,槽!

TCP 测速有很多方法,我也测试了都是正常的。UDP 的测速问了几个 AI ,都是推荐 iperf3 ,但是这玩意没有任何有公信力的服务器,测速结果截下来给客服会不会被承认另说,要找到一个能用服务器非常难,我已经问死好几个大模型了。不得不说对比江苏移动的简单粗暴,上海移动真是“聪明”得多。

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

目前订阅了 gpt pro ,codex 一次也没用过。。。主要是不知道咋在服务器上用,我一般是用 codex 的插件

服务器不能科学上网

网卡是 rtl8127, 用 iperf3 测速,在 host 上测速可以达到 9.42 Gbits/sec ,在 lxc 里测速只有 3.25 Gbits/sec ,造成这么大差异的原因是在 lxc 里发送的数据包被拆成了 1.5KB 的小包(也就是 mtu 的大小),而在 host 上发送的数据包是几十 KB 的大包,我想知道如何让 lxc 里发送的数据包也是几十 KB 的大包,有 v 友对这个问题感兴趣愿意一起研究一下吗?

在 host 上运行 iperf3 发包时 sar 的输出如下:

d@develop:~/test$ sar -n DEV 1 | awk '/IFACE/ && !header_done {print; header_done=1} /enp9s0/'

04:57:43 PM IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s %ifutil

04:57:44 PM enp9s0 19111.00 45161.00 1231.95 1152255.61 0.00 0.00 0.00 94.39

04:57:45 PM enp9s0 19174.00 45152.00 1235.82 1152169.69 0.00 0.00 0.00 94.39

04:57:46 PM enp9s0 19072.00 45156.00 1229.25 1152220.90 0.00 0.00 0.00 94.39

04:57:47 PM enp9s0 18963.00 45156.00 1222.37 1152153.47 0.00 0.00 0.00 94.38

在 lxc 内运行 iperf3 发包时 sar 的输出如下:

d@develop:~/test$ sar -n DEV 1 | awk '/IFACE/ && !header_done {print; header_done=1} /enp9s0/'

04:58:51 PM IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s %ifutil

04:58:52 PM enp9s0 15288.00 277668.00 985.45 410535.09 0.00 0.00 0.00 33.63

04:58:53 PM enp9s0 15290.00 277542.00 985.64 410400.17 0.00 0.00 0.00 33.62

04:58:54 PM enp9s0 15228.00 277660.00 981.49 410523.23 0.00 0.00 0.00 33.63

04:58:55 PM enp9s0 15265.00 277582.00 983.97 410409.32 0.00 0.00 0.00 33.62

用 txkB/s 除以 txpck/s 就能计算出数据包的大小。

我还试了在 linux 虚拟机(使用 tap 设备,桥接网络)里用 iperf3 测发送的速度, 结果和 lxc 里一样被拆成了小包,但是在虚拟机里用 scp 把本机文件拷贝到其他机器时是大包,而 lxc 里 scp 也是小包,另外更奇怪的是如果是 win11 虚拟机,iperf3 发送的数据包是大包。

我还试了用 macvlan 替代 veth ,结果 lxc 里不管是 iperf3 还是 scp 都不会拆成小包了,但是如果虚拟机用 macvtap ,不管是 iperf3 还是 scp 都全拆成小包了。

这个问题不仅仅出现在 rtl8127 网卡上,rtl8126 和 rtl8125 网卡都一样,只不过在万兆网络下大包和小包两种情况速度的差距更大。

这个问题我已经让 chatgpt plus 和 gemini 3 pro 分析了很多次了,AI 给的方法全都试了都不起作用,AI 只会让我去调整 tso gso gro 以及 mtu 等等参数,都试了都不起作用,感觉现阶段 AI 还是没有能力分析这种非常复杂的问题。

有人往 IETF 发布了个 IPv8 草案:Internet Protocol Version 8 (IPv8)

知乎的中文翻译:互联网协议第 8 版( IPv8 )

号称兼容 IPv4,但同样需要使用新的 IPv8 Header 。

地址格式是:r.r.r.r.n.n.n.n ,前面的 r 是扩展新空间,后面的 n 是现有 IPv4 地址范围。

还再附加一大堆配套内容。

附加内容当中有一堆十分奇怪的提议,其中之一居然要求交换机强制做 VLAN 硬件 OAuth2 验证。

原文:Three independent enforcement layers provide defence in depth: NIC firmware ACL8, Zone Server gateway ACL8, and switch port OAuth2 hardware VLAN enforcement.

不清楚这是否等于要求交换机必须无条件开启 VLAN 功能,如果是,那么纯二层交换机的地位尴尬了。

至于为什么怀疑这是用 AI 聊天 Vibe 出来,是因为草案有这么一句:draft-thain-wifi8-00 WiFi8 Protocol

提案中的“WiFi8”是指“用于 IPv8 的无线网络协议扩展”

https://www.thenetworkdna.com/2026/04/internet-protocol-version-8-ipv8.html

但在现实中,WiFi 8 特指 WiFi 联盟正在设计、仍未完成的 IEEE 802.11bn 。

当下 IT 从业人员,尤其是网络行业从业人员,不可能不知道未来有 WiFi 8 。

再说了,既然现在有 WiFi 4 、WiFi 5 、WiFi 6 、WiFi 7 ,那么很自然地会推导出将来大概率会有 WiFi 8 ,从而主动使用其他字词以避免造成歧义。

所以这下就有两个可能:要么是作者纯手写+不知道 WiFi8 ,要么是跟 AI 聊出来的 Vibe 草案+作者没检查。

提到兼容 IPv4,提案说 IPv8 does not require dual-stack operation 。不需要双栈?那么怎么互通?靠的是“8to4 隧道”。似曾相识,IPv6 也有 6to4 隧道。

还有一点我个人觉得是夸大其词的:No modification to IPv4 application required (现有 IPv4 应用程序无需修改)

IPv4 应用程序在新版系统运行接收到 IPv8 地址,但大量程序内部的sin_addr大小早就固定了的,没办法容纳 IPv8 地址,想存都存不下啊。除非继续写入到后面的 padding 区间。

而且新麻烦不止这一个。htonl()和 ntohl()是 32bit integer 的函数,大量程序早就写死使用 uint32 变量接受返回值,一旦传入 IPv8 地址就只能截断。

#define ngx_http_huff_encode_buf(dst, buf) \

(*(uint32_t *) (dst) = htonl(buf))

#define ngx_http_v2_write_uint32_aligned(p, s) \

(*(uint32_t *) (p) = htonl((uint32_t) (s)), (p) + sizeof(uint32_t))

这么一来,“No modification”也不太可能。

你好,我是冴羽。 如果有人问你 JS,大部分人可能还停留在 async/await、Promise、ES6 那个年代。 但 JavaScript 一年一个版本,语言早就不是原来的样子了。 还有框架、运行时、构建工具……整个生态都在快速演进。 本篇带你看看 2026 年的 JavaScript 和生态到底是什么样的。 这里重点说几个真正能改变你写代码方式的新特性。 ❌ 旧方式:每一步都创建新数组 ✅ 新方式:惰性求值,算到第 3 个就停 使用迭代器助手,大数据量下内存占用大幅降低,而且不只数组能用,Set、Map、生成器都可以。 这组方法解决了一个很实际的问题,那就是两个集合之间该怎么比较: 以前要写一堆循环才能算出来的东西,现在一行代码搞定。 假设你正在构建一个搜索功能,用户输入搜索词,你想用正则表达式来实现这个功能。 这可能存在一个风险,那就是用户输入的一些字符,比如 通常你需要先做转义处理,经过 15 年了,JS 终于提供了原生的方法: 一个函数可能抛同步异常,也可能返回 Promise 拒绝态,以前要写两个错误处理分支: 现在一个 catch 搞定: 代码是不是清爽了很多? 不过这里要注意:如果 import JSON 失败了,会让整个模块一起崩溃。建议用动态 import 加 try-catch 来兜底: 以后不再需要 Moment.js、Day.js 了: 最经典的血案莫过于计算 1 月 31 日再加一个月了: 用 Temporal 就正确了: Safari 目前是最后一个还没支持的浏览器,但已经在 Technical Preview 阶段了,正式支持不远了。 Node.js 里的文件句柄、数据库连接,用完还要手动关,这一直是个老大难问题。 ES2026 引入了 using 关键字,作用域结束自动调用清理逻辑: 多个资源要用 DisposableStack: 这就是 RAII 模式在 JavaScript 里的落地。 React 19 在 2024 年底发布,带来了 3 个核心概念: 但也要提醒:这些技术去年经历了两次严重的安全漏洞事件,如果你在用 RSC,务必关注官方安全公告。 Vue 3.5 稳定运行,3.6 已经在 Alpha 阶段,最大的看点是 Vapor Mode,作为一种全新的编译策略,据说性能可以和 Solid、Svelte 5 比肩。 另外,Vite 的亲爸爸 VoidZero 收购了 NuxtLabs,Nuxt 4.0 也已经发布。 Vue 生态正在往更统一、更完善的方向走。 Svelte 5 带来了全新的 Runes API,实现了更细粒度的响应式,实际效果就是更高效、更快。 有意思的是,Svelte/SvelteKit 也是 Vercel 旗下的产品。 从 Node 22.18.0 开始,不用再加任何实验性 flag: 直接跑 TypeScript 文件。注意它只是剥离类型,不做类型检查——所以生产环境还是要单独跑 tsc。 Node 这几年的方向很清晰:减少依赖、提升安全性、靠拢浏览器 API。原生测试运行器、内置 SQLite、权限模型……这些功能让它越来越像一个“开箱即用的平台”。 Bun 1.3 带来了更顺滑的 DX 体验——直接对着 HTML 文件跑,就能得到一个完整的开发服务器: 最重磅的消息是:Bun 被 Anthropic(Claude 的公司)收购了。有了一个资金充裕的稳定靠山,这对 Bun 的长期发展是好事。 速度依然是 Bun 的核心竞争力,只是稳定性方面偶尔会有一些问题。 Deno 最大的优势是安全——默认情况下没有文件系统访问、网络连接、环境变量读取权限,必须显式授权。 如果你要运行不受信任的代码,或者做边缘部署,Deno 是最让人放心的选择。 Vite 8 是近期最大的版本升级,不再依赖第三方打包工具 Rollup,而是用自己开发的 Rolldown。这一改变让整个工具链更统一、可预测。 Vite 还在往“全家桶”方向走,推出了 Vite+ 概念:一个工具链覆盖开发服务器、格式化、lint、测试、类型检查、打包。同时还在做 Void 平台——一个基于 Cloudflare 的部署平台,数据库、KV、AI 推理、认证、队列……全都内置了。 现在的格局是:几乎所有主流框架都在用 Vite——Astro、SolidStart、SvelteKit、Nuxt、Vue。 唯一的例外是 Next.js,它用 webpack,正在迁移到 Turbopack。 Next.js v16 把 Turbopack 设为默认打包器了。Turbopack 是 Vercel 用 Rust 写的,据说比 webpack 快 5-10 倍。不过实际迁移过程中,确实有一些兼容性问题需要处理。 webpack 虽然被很多人吐槽“太复杂”,但它依然是大量项目的基础。官方已经发布了 2026 年改进计划,目标就是简化 loader 配置、降低使用门槛。 TypeScript v6 刚刚发布,v7 预计 2026 年中期发布,v7 才是真正的大版本。 v6 主要做的是铺路工作:为 v7 换用 Go 语言重写的编译器做准备。 有几个关键变化: 最后一条影响很大:不再自动拉 @types,包体积和类型检查速度能提升 20-50%,但很多老项目会因此报错,值得提前关注。 另外一个大趋势:TypeScript 已经登顶 GitHub 第一大语言,年同比增长 66%,而且 92% 的开发者在用 AI 写代码——AI 对 TypeScript 的掌握度是最高的。 Vitest 基于 Vite 的测试框架,正在快速取代 Jest——它兼容 Jest 的写法,迁移成本低,性能却好很多,而且支持浏览器模式,可以跑真实的浏览器环境。 Playwright 在端到端测试领域的优势也越来越明显,比起 Puppeteer 和 Cypress,它的稳定性和跨浏览器支持都好出一个档次。 写这篇文章的时候,我最大的感受是: JavaScript 生态正在经历一个“收敛”的阶段。 以前要装几十个包才能干的事,现在语言本身、运行时、框架都在往“内置”方向走。TypeScript 直接跑、内置 SQLite、内置测试运行器…… 这当然是一种好的收敛——不是说包不重要,而是那些基础能力,越来越不需要自己搭了。 作为前端工程师,我们的精力应该放在理解这些工具的能力边界上,然后专注真正重要的事:解决用户问题。 我是冴羽,10 年笔耕不辍,专注前端领域,更新了 10+ 系列、300+ 篇原创技术文章,翻译过 Svelte、Solid.js、TypeScript 文档,著有小册《Next.js 开发指南》、《Svelte 开发指南》、《Astro 实战指南》。 欢迎围观我的“网页版朋友圈“,关注我的公众号:冴羽(或搜索 yayujs),每天分享前端知识、AI 干货。2026 年的 JavaScript 已经不是你认识的 JavaScript 了

1. 语言新特性

1.1 Iterator Helpers:链式操作不再创建中间数组

const result = array

.map(x => x * 2)

.filter(x => x > 10)

.slice(0, 3);const result = Iterator.from(array)

.map(x => x * 2)

.filter(x => x > 10)

.take(3)

.toArray();2. Set 家族新方法:集合运算

const 你会的 = new Set(["JS", "Python", "CSS", "SQL"]);

const 岗位要求 = new Set(["JS", "TypeScript", "Python"]);

// 共同技能

你会的.intersection(岗位要求); // Set {"JS", "Python"}

// 技能差距

岗位要求.difference(你会); // Set {"TypeScript"}

// 你会但岗位不需要的

你会的.difference(岗位要求); // Set {"CSS", "SQL"}

// 两者并集

你会的.union(岗位要求); // Set {"JS", "Python", "CSS", "SQL", "TypeScript"}

// 有没有一种"知己知彼"的感觉?3. RegExp.escape():正则转义

$ 在正则表达式中属于特殊字符,这就会导致搜索出错。const query = "$5.00 (off!)";

// ❌ 旧方式:各种特殊字符要逐个转义

const badRe = new RegExp(query, "g"); // 崩了

// ✅ ES2025:一行搞定

const goodRe = new RegExp(RegExp.escape(query), "g");4. Promise.try():同步异常和异步拒绝,一个 catch 搞定

// ❌ 旧方式:两个错误路径

let p;

try {

p = loadUser(id); // 同步 throw 在这里捕获

} catch (e) {

handleError(e);

}

p?.catch((e) => handleError(e)); // 异步 reject 在这里捕获// ✅ ES2025:一个入口,一个 catch

Promise.try(() => loadUser(id))

.then((user) => render(user))

.catch((err) => showError(err)); // 同步异常和异步拒绝都在这5. Import Attributes:直接 import JSON 和 CSS

// 直接导入 JSON,不用再 fetch + parse 了

import data from "./file.json" with { type: "json" };

// 直接导入 CSS,配合 Web Components 使用

import sheet from "./styles.css" with { type: "css" };try {

const { default: data } = await import(url, {

with: { type: "json" },

});

} catch (error) {

// 降级逻辑

}6. Temporal API:以后时间处理就用这个了

// 获取特定时区的当前时间

const now = Temporal.Now.zonedDateTimeISO("America/New_York");

console.log(now.toLocaleString());const date = new Date(2026, 0, 31);

date.setMonth(date.getMonth() + 1);

console.log(date.toDateString()); // "Sun Mar 03 2026" ❌ 跳到 3 月了const jan31 = Temporal.PlainDate.from("2026-01-31");

const feb = jan31.add({ months: 1 });

console.log(feb.toString()); // "2026-02-28" ✅7. Explicit Resource Management:不用手动写 cleanup 了

async function saveData() {

await using file = new FileHandle("output.txt");

await file.write("hello world");

// file 自动 flush + close,就算中间抛出异常也会执行

}async function runJob() {

await using stack = new AsyncDisposableStack();

const db = stack.use(await openDatabase());

const file = stack.use(new FileHandle("output.txt"));

const tmpDir = stack.defer(async () => removeTempDir("/tmp/job"));

// ... 业务逻辑

// 退出时自动按逆序清理,三个资源全关掉

}8. 一些值得关注的小改进

2. 框架生态:React、Vue、Svelte 各有新动作

2.1. React 生态系统

2.2. Vue 生态系统

2.3. Svelte 生态系统

3. JavaScript 运行时:Node 继续领跑,Bun 有了大靠山

3.1. Node.js:终于能直接跑 TypeScript 了

node my-script.ts3.2. Bun:被 Anthropic 收购了

bun './**/*.html'3.3. Deno 2.0:最安全的选择

// Deno 默认安全:

// 不写 --allow-read,就读不了文件

// 不写 --allow-net,就发不了网络请求4. 构建工具:Vite 统治一切,Webpack 在努力追赶

4.1. Vite:v8 了,还出了个 Vite+

4.2. Turbopack: Next.js v16 的默认打包器

4.3. webpack:2026 年有改进计划

5. TypeScript:v6 打基础,v7 是大招

6. 测试工具:Vitest + Playwright 组合越来越主流

最后

找到搬瓦工 全程跟着 Gemini 搭建起来 Mac 上建好了

美国 - 洛杉矶 DC9 CN2GIA (USCA_9) **49.99 美元/3 个月 Alipay

Ubuntu-22.04-x86_64 机房 USCA_9 (DC9)

**20 GB SSD / 1 GB RAM / 1 TB 流量每月 / 2.5G 带宽

各位评价一下怎么样

摄影写真特色站

游戏特色站

全站 HR 产生 H&R 记录的条件从完成下载 100% 调整为下载量达到 30% 即开始产生。消除 H&R 的方式仍然是 720 小时内做种达到 48 小时,或分享率超过 3.0。

全站 HR

需要的留邮箱地址和预注册名,不要玩死。

下面给你一份可直接用于开发、解析、入库的 1688 图片搜索 API 完整解析,包含标准返回结构、关键字段、解析要点、常见坑。 一、接口基本信息 接口名:1688.item_search_img 作用:通过图片 url 搜索相似商品,平台外图片地址可先用 taobao.upload_img 接口进行转换。 必传参数: 请求参数:imgid=1465008666331338751 参数说明:imgid:图片 id(图片上传接口获取) 二、关键字段解析(开发必存) 1688 图片搜索获取商品标题、价格、SKU、库存、详情、等全量结构化数据,核心分为两套体系: 辅助接口:支持价格库存、SKU 规格、商品搜索等补充采集需求。 核心接口涵盖接入与配额: 平台提供多款接口,分为竞品内容监测,用户画像与细分群体分析,舆情监控与危机预警,市场趋势与热点预测,内容创作辅助,商业情报收集等场景,需要 o0b.cn/opandy ,无需自主申请接口(如添加 Taobaoapi2014),直接调用封装 API,一键获取已封装好的数据 API 采集,适合批量查询、中小卖家使用。 三、AI 赋能:让数据从“可采”到“可用” API 解决数据采集问题,AI 实现数据价值升级,核心能力包括: 智能处理:自动清洗数据、解析商品卖点、识别图文信息、挖掘评论情感与用户需求; 核心应用:爆款预测、竞品监控预警、舆情风控、动态定价、跨境铺货优化。

刚才打开出现弹窗,选择您的语言 -> 简体中文。

AI Coding 时代,vscode 的职责基本只剩下了:

但为了这些功能专门去开启一个 vscode 实在有点不值,于是我就整了个终端版的集成了这些功能的 TUI 来取代 vscode 的作用,占用小,速度快,并发跑 Coding Agent 更友好。

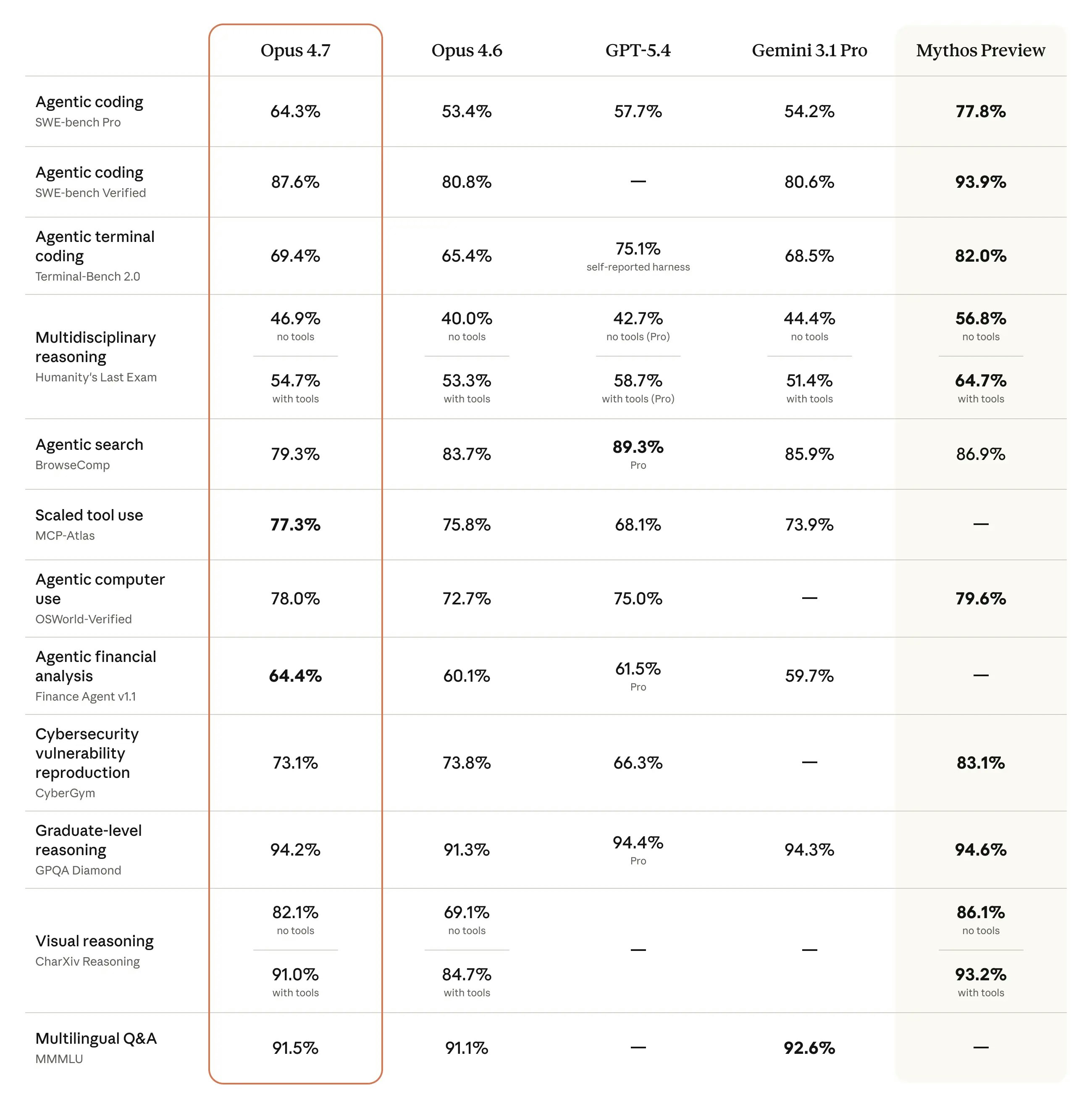

这款 AI 模型是推理和编码的顶尖高手,能处理长时间任务,精准执行指令,帮你搞定复杂项目。

热度:🔺468

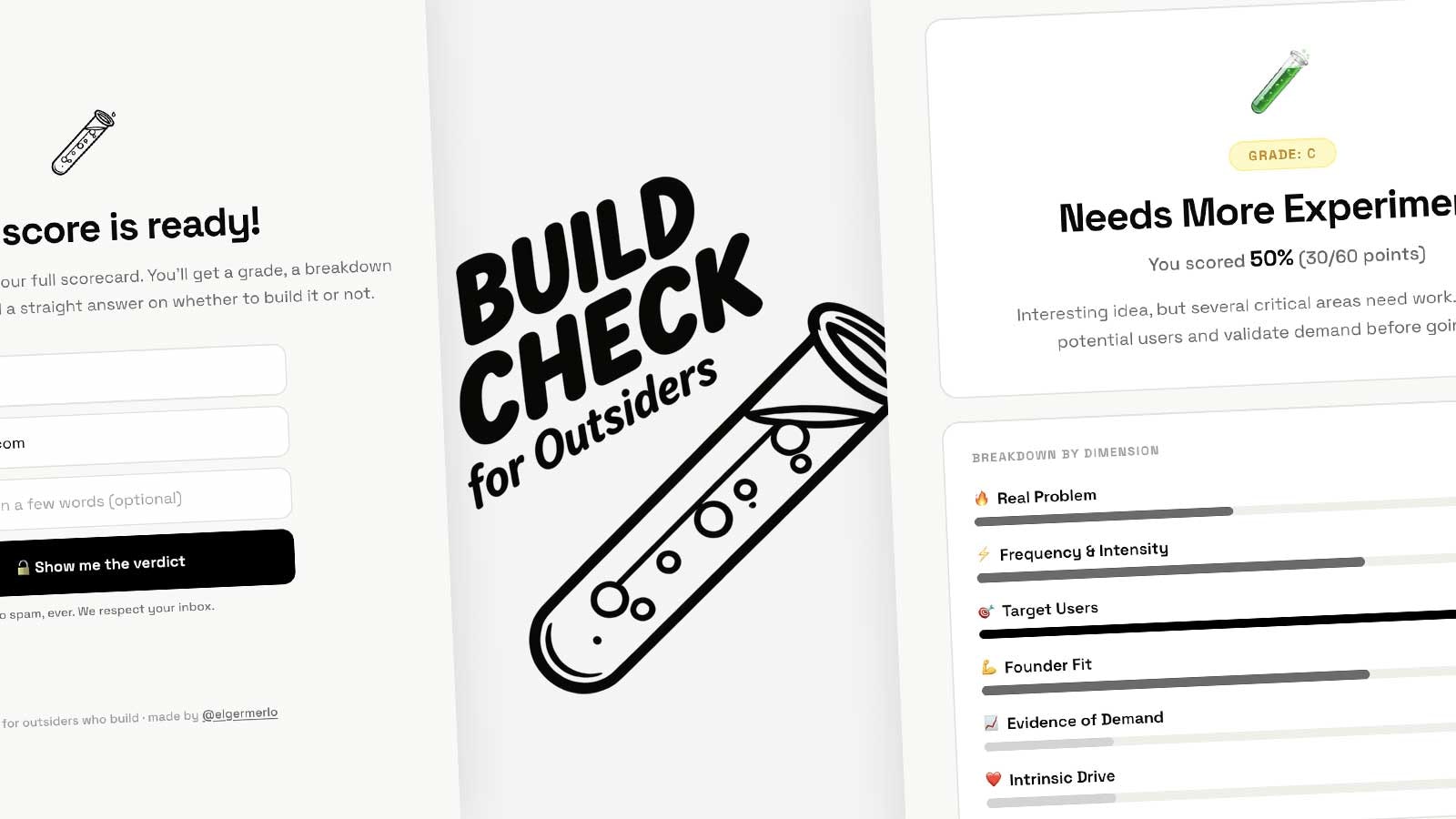

你的应用想法真的值得开发吗?这个免费测评帮你快速评估,避免浪费几周时间。

热度:🔺398

Codex 进化成全能 AI 工作助手,不仅能写代码,还能操作电脑、自动化任务,连接各种工具。

热度:🔺296

这款 AI 助手旨在整合你的日常生活,用一个订阅取代所有待办事项、日历、健身等工具。

热度:🔺230

专为创作者设计的一站式 AI 启动平台,帮你规划、执行和追踪产品发布,一键生成文案。

热度:🔺209

Canva 变身对话式创意平台,能记住你的风格,连接工具,从想法到发布全程协助。

热度:🔺169

别再切换多个应用了,在聊天窗口里管理所有生产力任务,Aria 能自动转换语音为待办事项。

热度:🔺163

可编程的日历同步工具,让人类和 AI 都能轻松过滤、转换和路由事件,发送真正邀请。

热度:🔺151

把邮箱变成 AI 代理的原生界面,让代理能直接发送、接收和处理邮件,简化多渠道体验。

热度:🔺147

这款 AI 思维画布结合了写作工具的结构和设计画布的自由,让你用 Markdown 层级与 AI 共同发展想法。

热度:🔺136

几乎所有深度使用QClaw的人都会遇到同一个问题:刚安装的时候秒开秒响应,执行任务行云流水,可随着使用时间的推移,速度会越来越慢,点一下要等好几秒才有反应,简单的指令也要处理半天。绝大多数人遇到这种情况,第一反应就是自己的电脑配置不够,于是咬牙升级内存、更换固态硬盘,甚至直接换一台更高配置的电脑。但我身边很多朋友换了顶配电脑之后,用了不到两个月,QClaw又开始变得卡顿,这说明问题根本不在硬件本身,而在于我们的使用方式和默认配置的不合理性。我自己也曾经被这个问题困扰了很久,花了整整三周的时间,测试了几十种不同的优化方案,终于找到了五个立竿见影的性能优化技巧,不需要花一分钱升级硬件,只需要调整几个设置和使用习惯,就能让QClaw的运行速度直接翻倍,甚至比刚安装的时候还要流畅。 很多人不知道,QClaw卡顿的最大元凶其实是全量模型加载机制。默认情况下,QClaw会把整个模型的所有参数全部加载到内存中,这样虽然能获得最快的单次响应速度,但也会占用大量的内存资源,尤其是对于大模型来说,全量加载会占用十几GB甚至几十GB的内存。当内存不足的时候,系统就会开始使用虚拟内存,也就是把一部分硬盘空间当作内存来使用,而硬盘的读写速度比内存慢得多,这就会导致QClaw的运行速度急剧下降。更糟糕的是,当你同时打开其他程序的时候,内存会更加紧张,QClaw甚至会出现长时间无响应的情况。我之前就是因为一直使用全量加载模式,导致电脑只要一打开QClaw,就不能再打开任何其他大型程序,否则整个系统都会变得非常卡顿。解决这个问题的核心方法是采用分层加载策略,这也是目前行业内最先进的本地模型运行技术。简单来说,就是把模型分成多个不同的层,只把最常用的核心层加载到内存中,而把不常用的辅助层暂时存放在固态硬盘上,只有当需要用到这些层的时候,才会临时从硬盘加载到内存中,使用完之后再自动卸载。这样一来,内存占用会大幅降低,通常只有全量加载的三分之一到二分之一,同时对响应速度的影响非常小,几乎感觉不到任何延迟。我自己测试过,采用分层加载策略之后,QClaw的内存占用从原来的16GB降到了6GB,运行速度不仅没有变慢,反而因为内存充足,多任务处理能力提升了好几倍,同时打开十几个网页和文档,QClaw依然能流畅执行任务。 第二个容易被忽视的性能杀手是无限增长的上下文窗口。QClaw为了保持对话的连贯性,会默认保留所有的历史对话上下文,每一次新的指令,都会把之前所有的对话内容全部输入到模型中进行推理。随着使用时间的推移,上下文会变得越来越长,推理所需的计算量也会呈指数级增长,这就是为什么QClaw会越用越卡的重要原因。很多人用了几个月之后,上下文长度已经达到了几万甚至几十万字,这时候即使是最简单的指令,模型也需要处理很长时间才能给出结果。我之前就遇到过这种情况,一条简单的文件重命名指令,QClaw竟然处理了整整十秒钟,后来我查看了上下文历史,发现里面竟然保留了我三个月以来所有的对话记录。针对这个问题,我总结出了一套动态上下文裁剪规则,既能保持对话的连贯性,又能有效控制上下文的长度。首先,我会关闭QClaw的全局上下文保留功能,改为按任务隔离上下文,每个新的任务都会创建一个独立的上下文环境,任务完成之后,上下文就会自动清理。其次,对于需要长期保留的任务,我会设置一个上下文长度上限,当上下文超过这个上限的时候,QClaw会自动删除最早的非关键对话内容,只保留最近的关键指令和执行结果。最后,我会定期手动清理所有已经完成的任务上下文,彻底释放模型的推理资源。采用这套规则之后,QClaw的推理速度提升了三倍以上,即使是复杂的多步骤任务,也能在几秒钟内给出结果。 第三个优化技巧是任务队列的批量合并处理。很多人使用QClaw的时候,喜欢想到什么就发什么,同时给QClaw下达很多个不同的任务,导致任务队列严重堆积。QClaw默认是串行执行任务的,每个任务都要等待前一个任务完成之后才能开始执行,而且每个任务都需要单独加载和卸载模型资源,这会浪费大量的时间在资源切换上。更糟糕的是,频繁的任务切换会导致CPU和内存的利用率忽高忽低,系统无法进行有效的资源调度,进而影响整体的运行效率。我之前就经常犯这个错误,同时发十几个不同的文件整理任务,结果每个任务都要等很久才能完成,总耗时比一个一个执行还要长。正确的做法是把相似的任务合并成一个批量任务,让QClaw一次性处理所有的相似任务。这样一来,模型只需要加载一次资源,就能连续执行所有的任务,大大减少了资源切换的时间开销。同时,批量处理还能让系统更有效地调度CPU和内存资源,提高资源的利用率,进而提升整体的处理速度。我自己测试过,把十个相似的文件整理任务合并成一个批量任务之后,总耗时从原来的二十分钟降到了七分钟,效率提升了将近三倍。另外,我还会给QClaw设置一个任务队列长度上限,当任务队列超过这个上限的时候,新的任务会自动进入等待状态,避免任务过多导致系统过载。 第四个技巧是本地缓存的精细化管理。QClaw为了提升运行速度,会自动缓存很多常用的资源,比如模型权重、文档索引、执行结果、网页内容等等。这些缓存确实能在一定程度上提升QClaw的响应速度,但时间长了,缓存会变得越来越大,甚至会占用几十GB的磁盘空间。当缓存过大的时候,磁盘的读写速度会变慢,QClaw读取缓存的时间反而会比重新生成资源的时间还要长,这就会导致QClaw的运行速度不升反降。而且,很多缓存内容都是过时的,已经没有任何使用价值,只会白白占用磁盘空间。我之前就发现,我的QClaw缓存文件夹竟然有32GB之大,里面很多都是一年前的缓存内容。我现在采用的是分级缓存管理策略,把缓存分成了短期缓存、中期缓存和长期缓存三个等级。短期缓存保存最近一周使用的资源,中期缓存保存最近一个月使用的资源,长期缓存保存经常使用的核心资源。每天凌晨,QClaw会自动清理过期的短期缓存,每周日会自动清理过期的中期缓存,每个月会手动清理一次长期缓存中不再使用的资源。同时,我还设置了缓存的总大小上限,当缓存超过这个上限的时候,系统会自动删除最久未使用的缓存内容。采用这套策略之后,我的QClaw缓存文件夹大小一直保持在5GB以内,磁盘读写速度明显提升,QClaw的启动速度和运行速度都有了很大的改善。 第五个也是最容易被忽略的优化技巧是后台进程的资源隔离。QClaw在运行的时候,会启动多个后台辅助进程,这些进程负责处理不同的任务,比如文件操作、网页浏览、语音识别等等。默认情况下,这些后台进程和主进程共享相同的系统资源,优先级也相同。当某个后台进程出现资源占用过高的情况时,就会抢占主进程的资源,导致主进程运行卡顿。很多时候,你觉得QClaw卡,其实并不是主进程卡,而是某个后台进程占用了大量的CPU和内存资源,导致主进程无法获得足够的资源来执行任务。我之前就遇到过这种情况,QClaw的主进程只占用了20%的CPU,但有一个后台进程竟然占用了70%的CPU,导致整个QClaw都变得非常卡顿。解决这个问题的方法是利用系统自带的资源管理工具,对QClaw的进程进行资源隔离和优先级调整。首先,给QClaw的主进程设置最高的优先级,确保主进程能优先获得系统资源。其次,给每个后台进程设置单独的资源限制,限制它们的CPU和内存占用上限,防止某个后台进程占用过多的系统资源。最后,关闭一些不常用的后台功能,比如自动更新、数据统计、错误报告等等,这些功能不仅会占用系统资源,还会影响QClaw的运行速度。我自己调整之后,QClaw的后台进程总资源占用降低了60%,主进程的资源利用率大幅提升,即使后台有其他程序在运行,QClaw也能流畅地执行各种任务。 很多人都在追求更大的模型、更高的配置,认为只有这样才能获得更好的使用体验,但实际上,大多数人都没有充分发挥现有硬件和软件的潜力。我见过很多人用着顶配的电脑,却因为错误的使用方式和默认配置,导致QClaw运行得非常卡顿。而通过上面这五个简单的优化技巧,不需要花一分钱升级硬件,只需要调整几个设置和使用习惯,就能让QClaw的运行速度直接翻倍,甚至比刚安装的时候还要流畅。这些技巧不仅适用于QClaw,也适用于其他所有本地运行的智能体工具,掌握了这些技巧,你就能用最低的成本,获得最好的使用体验。当然,性能优化是一个持续的过程,没有最好,只有更好。随着QClaw的不断更新和升级,会出现新的性能问题,也会有新的优化方法。我会继续深入研究QClaw的性能优化技术,把更多实用的技巧分享给大家。同时,我也希望大家能养成良好的使用习惯,不要过度依赖硬件升级,而是学会通过优化软件配置和使用方式来提升性能。只有这样,我们才能真正发挥智能体工具的潜力,让它们成为我们工作和学习的得力助手,而不是拖累我们效率的负担。

大多数程序员终其职业生涯都在与重复劳动对抗,我们花费大量时间在文件整理、环境配置、文档生成和流程审批上,真正用于思考和创造的时间不足三分之一。很多人试图用各种脚本和工具来解决这个问题,但最终却陷入了维护工具本身的泥潭,花在写脚本上的时间比节省的时间还要多。直到接触到QClaw之后,我才真正意识到,自动化的未来不是写更多的代码,而是让智能体理解我们的意图并自动执行操作。这种从"指令式"到"意图式"的转变,正在从根本上改变我们的工作方式。QClaw与传统对话式AI的本质区别在于,它不是一个只会回答问题的聊天机器人,而是一个具备系统级执行能力的智能体。它可以直接操作你的电脑文件、浏览器和各种应用程序,将你的自然语言指令转化为实际的电脑操作。更重要的是,所有的数据处理和推理过程都在本地完成,不会上传到云端,这对于处理敏感的项目代码和商业数据来说至关重要。这种"本地执行+自然语言交互"的模式,完美解决了效率和安全之间的矛盾,让我们可以放心地将各种重复性工作交给智能体处理。 很多人使用QClaw的方式都错了,他们只是把它当成一个高级的语音助手,让它做一些简单的文件重命名或者网页搜索。但QClaw真正强大的地方在于,它可以将各种原子能力按照逻辑顺序串联起来,形成完整的自动化工作流。比如,当你需要研究一个新的技术领域时,你只需要告诉它关键词和研究范围,它就会自动搜索相关的学术论文和技术文档,下载并整理到指定的文件夹,提取每篇文章的核心观点和创新点,最后生成一份结构化的研究报告。整个过程不需要任何人工干预,你只需要等待最终的结果即可。事件驱动是QClaw最容易被忽视但却最强大的功能之一。它可以监控文件系统的变化,当某个特定的文件被创建、修改或者删除时,自动触发一系列预设的操作。我用这个功能搭建了一套完全自动化的开发环境,每当我将一个新的项目文件保存到指定目录时,QClaw就会自动识别项目类型,创建对应的虚拟环境,安装必要的依赖包,初始化版本控制系统,并生成标准的项目结构和README文件。这不仅节省了大量的环境配置时间,还保证了所有项目的结构一致性,便于团队协作和后期维护。 远程异步执行能力彻底打破了空间和时间的限制,让我们可以随时随地处理工作任务。通过微信绑定之后,你可以在任何有网络的地方向你的电脑发送指令,让QClaw帮你完成各种操作。比如,当你在地铁上突然想到一个好的想法时,你可以直接用微信告诉QClaw创建一个新的项目分支,并将你的想法记录在项目文档中。当你在开会时,你可以让QClaw自动下载客户发来的需求文档,并提取其中的关键信息和时间节点,整理成待办事项列表发送给你。这种"人机分离"的工作模式,让我们可以充分利用碎片化时间,提高工作效率。持续学习和个性化适配是QClaw区别于其他自动化工具的核心优势。它会不断学习你的工作习惯和偏好,逐渐成为最了解你的专属助手。比如,它会记住你喜欢的代码风格、文档格式和命名规范,在生成代码和文档时自动遵循这些规则。它会记住你经常访问的网站和常用的工具,在执行相关任务时优先使用这些资源。随着使用时间的增加,QClaw会变得越来越聪明,越来越懂你,最终成为你工作中不可或缺的一部分。 当然,QClaw也不是万能的,它不能替代程序员进行创造性的思考和复杂的逻辑设计。但它可以帮我们从繁琐的重复性工作中解放出来,让我们有更多的时间和精力去做那些真正有价值的事情。在使用QClaw的过程中,我逐渐意识到,未来的程序员不再是代码的编写者,而是智能体的训练师和指挥官。我们的工作将从"告诉电脑怎么做"转变为"告诉电脑做什么",而电脑则会自动完成所有的细节工作。这种转变不仅会提高我们的工作效率,还会改变我们的职业发展方向。那些能够熟练掌握智能体工具,善于将复杂任务分解为可执行步骤的程序员,将会在未来的职场中占据绝对的优势。而那些只会埋头写代码,不愿意接受新技术的程序员,将会逐渐被时代淘汰。所以,现在正是开始学习和使用QClaw的最佳时机,让我们一起拥抱智能体时代,重构我们的开发流程,释放我们的创造力。

360驱动大师 是一款集驱动检测、安装、备份与恢复于一体的工具。 核心优势:界面简洁、操作简单,支持一键式驱动安装,能快速识别缺失或不兼容的硬件驱动,有效解决电脑因驱动问题导致的蓝屏、无法上网、声音异常等情况。 安装包下载:https://pan.quark.cn/s/a4c75c013780 1. 启动工具 找到【360驱动大师】程序图标 → 右键点击 → 选择【以管理员身份运行】。 2. 进入主界面 软件启动后,首页将自动扫描硬件设备并展示驱动状态(如下图所示)。 (此处插入软件首页截图) 一、工具简介

二、使用步骤

我发现从 V 站开始,有很多社区是没有私信功能的比如本站、middlefun、过早客等,当然没有私信这个功能倒并没有太大的不便,反而促进了 base64 编码的普及。其实社区的私信功能确实用的不多,比如有一次上 V 站有问题时,也没想有没有私信的事,也是给 Livid 发邮件处理。但也有例外,比如 L 站就是有私信功能,不知是否跟框架的选择有关。

不过还是有些疑惑,因为像一些传统论坛,比如 Hipda、NGA、52pojie 等都是有私信功能的。有的时候也会用。

就是想了解一下,站长们在设计社区的时候,私信功能在不在考虑范围,是由于框架的原因无法支持,还是由于政策的要求,或者是从社区交互的方面考虑。