像一个弥留之际的老人一样使用 claude

每天一张开眼,打开 claude ,发现又活了一天。

就好像,一个弥留之际的老人,发现自己又活了一天一样。

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

每天一张开眼,打开 claude ,发现又活了一天。

就好像,一个弥留之际的老人,发现自己又活了一天一样。

一、工具简介 安装包下载:https://pan.xunlei.com/s/VOqU-ImW07NahgQzOjAMHshTA1?pwd=i3tx# 二、使用步骤 右键点击【FastStone Capture】压缩包 → 选择【解压到“FastStoneCapture”】。 将解压后的【FastStone Capture】文件夹拖动到需要安装的磁盘(例如 D 盘)。 双击打开移动后的【FastStone Capture】文件夹。 右键点击【FSCapture】主程序。 选择【发送到】→【桌面快捷方式】。 双击桌面生成的【FastStone Capture】图标。 成功进入 FastStone Capture 主界面,表示工具已就绪,可开始截图或录屏。

FastStone Capture 是一款轻量级、功能强大的屏幕捕捉工具,支持滚动截图、屏幕录制、图像编辑等功能。

2025 年 12 月 13 日,VeloxCon China 2025 在北京成功举办。作为 Velox 项目首次在中国举办的线下技术大会,汇聚了来自Meta、IBM、蚂蚁集团、阿里云、腾讯、小米、小红书等企业的数十位核心贡献者与一线工程师。 大会通过 18 场演讲将 Velox 置于真实业务场景之中,系统展示了其在架构演进、AI 数据处理、湖仓加速、流批融合等方向的最新实践。这些分享不仅直面性能、稳定性与兼容性等落地挑战,也反应了开发者社区对构建可靠、可扩展、可协同的数据基础设施的共同探索,彰显了中国开发者在全球高性能分析生态中的工程深度与协作广度。 夯实底座,突破能力边界 在明确了社区与架构演进的总体方向后,大会议题迅速深入到如何利用 Velox 构建高性能计算引擎的具体实践中。阿里云 EMR Serverless Spark 技术负责人周克勇系统阐述了“可组合性”在数据计算领域的实践。他详细解析了阿里云如何深度集成并贡献于 Apache Celeborn、Paimon、Velox 及 Gluten 等开源组件,通过模块化组装构建出高性能湖仓一体引擎。他指出,基于该架构,阿里云 EMR Serverless Spark 成功创造了 TPC-DS 100TB 规模性能测试的世界新纪录,实现性能翻倍与性价比大幅提升。 接着,Meta 软件工程师 Masha Basmanova 阐述了现有查询引擎在跨语言通信、优化器能力与开发体验上面临的挑战,并介绍了基于 C++ 的统一前端框架 Axiom。该框架将 SQL 解析、逻辑优化与物理执行融为一体,通过内置的强大优化器与 Velox 运行时无缝对接,能够实现更高效、可扩展的查询处理。演讲最后,她积极展示了 Axiom 的开源路线图,并欢迎全球开发者加入,共同推动该项目的演进。 强大的执行框架,最终需要服务于极具挑战性的数据场景,特别是爆发式增长的 AI 数据。Meta 软件工程师孟晓烜则在之后的演讲中,深入阐述了应对AI训练数据规模激增与成本挑战的解决方案。他重点介绍了 Meta 如何通过数据归一化技术剥离重复特征,并构建可索引的序列存储系统。依托 Velox 技术栈,团队在训练数据的加载、生成与探索三大环节实现了端到端优化,显著提升了处理效率与资源利用率。 在 Meta 多位工程师从框架演进、可组合架构、数据标准化等角度深入分享后,蚂蚁集团高级技术专家黄叶伟也从企业落地实践层面分享了基于 Velox 的 Spark 加速实践。他重点介绍了基于 Gluten 与 Velox 构建的向量化引擎如何通过任务级 Fallback、Spill 优化、Shuffle 优化等关键技术,在混合部署场景下显著提升 Spark 性能与稳定性。他表示,该方案目前已实现日均数十万任务覆盖,平均节省资源超30%,并将在算子优化与架构扩展方面持续演进。 作为连接 Spark 生态与原生加速的关键中间层,Apache Gluten 的进展同样备受关注。来自 IBM 的莫芮与周渊聚焦 Apache Gluten与 Velox 的深度集成,阐述了其如何在大数据分析中驱动创新。他们介绍,Gluten 在保持对 Spark/Flink 作业透明加速能力的同时,正逐步增强对多后端引擎和复杂业务场景的适配能力。目前,该方案已在 Pinterest、顺丰科技及多个内部集群完成规模化验证,有效支撑了从日志分析到物流调度等多样化负载的性能提升与成本优化。 随着向量化加速在通用场景日趋成熟,针对特定存储格式的深度优化成为新的效能突破口。腾讯大数据开发工程师陈锦海分享了微信基于 Velox 加速 lceberg 湖仓分析的优化与实践,重点介绍了原生分桶方案。据他介绍,该方案通过动态识别表元信息自动设置分区数,能有效缓解 AQE 引发的写入倾斜,结合空闲资源灰度发布策略,可保障大规模作业的稳定上线。 扎根场景,释放协同效能 面对海量数据挑战,全球科技公司也在探索相似的演进路径。Meta 软件工程经理 Stanley Yao 在演讲中分享了公司基于 Velox 推进 Spark 向量化改造的整体策略。他表示,团队通过从定制化方案到开源架构的持续演进,已实现关键业务管线向 Gluten(Flare)的平稳迁移,并获得显著的效率提升。未来,Meta 计划进一步扩大该架构的应用规模。 在 CPU 向量化趋于普及的同时,利用异构硬件挖掘更高性能成为新的前沿。IBM 研究院资深软件工程师 Zoltán Arnold Nagy 展示了基于 Velox 与 Presto 的 GPU 加速数据处理方案。他介绍道,Velox 通过与 cuDF 集成,可在 GPU 上高效执行算⼦,并针对多 GPU 分布式场景优化通信与数据交换。此外,为突破 I/O 瓶颈,团队正在探索结合 GPUDirect 存储与缓存层的加速策略。 对性能与稳定性的追求,也驱动着查询引擎架构本身的融合与创新。Meta 软件工程师谭家梁与大家分享了 Native Presto-on-Spark 的规模化应用。该架构以 Presto 查询优化、Spark 资源调度与容错机制以及 Velox 原生向量化执行为核心,实现了性能与可靠性的显著提升。他表示,目前该方案已在生产环境中取得成效,并将在未来持续推进全栈原生化演进。 对于国内庞大的云上业务,Velox 同样在支撑着关键数据服务平台。 阿里云高级工程师王彬与范阿冬系统介绍了Velox在阿里云日志服务中的深度集成与应用。他们指出,基于 Velox 构建的高性能查询引擎,通过混合执行、表达式下推、自动增量物化视图及免 Schema 分析等核心技术,可显著提升平台在处理海量实时数据时的查询效率与资源利用率。他们还强调,该架构不仅为日志分析、智能运维等场景提供了稳定支撑,也为面向 AI 的云原生数据平台演进奠定了坚实基础。 除了通用的日志与湖仓分析,Velox 也在向更垂直的时序数据场景渗透。腾讯高级工程师李兆龙分享了基于 Velox 构建云原生时序数据库的落地经验。他表示,通过在 Velox 中实现时序数据去重优化与存储写入增强,系统在应对高频写入与实时查询场景时,可显著提升吞吐效率与响应性能。目前该方案已有效支持物联网、实时监控等业务场景,未来还将进一步完善缓存与压缩机制,持续优化时序数据处理的整体效能。 IBM 软件工程师刘平接着分享了 Velox 在 Iceberg 数据写入能力上的突破性进展。他表示,目前 Velox 对 Iceberg 的支持以读取为主,其写入功能的完善将填补该方向的关键能力空白,为基于 Presto 与 Spark 的数据湖架构提供更统一、高效的数据摄入层。这一进展也标志着 Velox 正从查询加速向数据全链路处理拓展。 接着,来自阿里云的毕岩与周滔分享了 Velox 与 Apache Paimon 深度集成的解决方案,为提升引擎与存储的协同效率提供了另一种集成思路。在他们看来,现有方案存在表类型支持受限、缺乏可移植性等瓶颈, 但可以建立 C++ 原生 Paimon 库,通过其统一的数据协议与插件化设计,使 Paimon 能够被 Velox、StarRocks 等多种计算引擎直接高效调用,从而提升数据读写性能,并为湖仓格式的跨引擎协同提供新的基础支撑。 在批处理场景之外,流计算框架的向量化也正成为新的热点。蚂蚁集团技术专家刘勇介绍了基于 Velox 为 Flink 构建的统一向量化执行引擎 Flex。他表示,Flink 作为流批一体架构的核心,其原生向量化能力的补足至关重要。Flex 通过将 Velox 的高性能算子能力引入 Flink,同时结合自动化验证、可视化计划与精细化回退机制,现已实现了作业性能的显著提升,并支撑多条核心业务链路平稳运行。 随着 Velox 赋能的应用场景日益广泛和复杂,确保其在不同引擎和版本间的整体质量与可靠性变得至关重要。Meta 软件工程师 Eric Liu 阐述了在 AI 数据基础架构下,保障 Velox 多引擎版本可靠性的系统化方法。他指出,面对不同引擎与存储格式交织带来的复杂性,关键在于建立跨引擎测试框架与合成数据工厂。这一实践能有效提前发现全栈潜在问题,从而确保底层变更在大规模生产环境中的稳定与高效。 针对向量化引擎中窗口运算符内存溢出的典型难题,来自英特尔的贾柯分享了她的见解。她认为,通过为 Velox 引入流式窗口处理机制,可使计算随数据到达逐步执行并即时释放内存,从而从架构层面化解多数场景下的内存风险,显著提升复杂查询的稳定性。 最后,小红书 Native Engine 团队技术负责人魏秀利也分享了向量化引擎在公司业务中规模化落地的经验。据他介绍,通过将写入异步化并构建原生 Avro 读取能力,小红书在不增加业务复杂度的前提下,成功缓解了端到端延迟,印证了“执行与存储协同优化”在湖仓场景中的关键价值。 从底层执行引擎的持续创新,到日志分析、湖仓写入、流批融合等复杂场景的稳定运行,在本届 VeloxCon China 上,我们看到 Velox 的技术价值已在真实业务中不断被验证和拓展。同时我们也很高兴看到中国开发者成为这一进程的重要推动者。期待未来有更多志同道合者加入 Velox 开源社区,共建高性能分析基础设施。个weibo.com/ttarticle/p/show?id=2309405288842847977841 weibo.com/ttarticle/p/show?id=2309405288843204231171 weibo.com/ttarticle/p/show?id=2309405288843564941797 weibo.com/ttarticle/p/show?id=2309405288843942691105 weibo.com/ttarticle/p/show?id=2309405288844286623928 weibo.com/ttarticle/p/show?id=2309405288844743541010 weibo.com/ttarticle/p/show?id=2309405288845079347417 weibo.com/ttarticle/p/show?id=2309405288845414629830 weibo.com/ttarticle/p/show?id=2309405288845750174140

会议伊始,Velox 项目联合发起人 Pedro 发表开幕致辞。他回顾了 Velox 开源项目的发展历程,从项目启动、开源发布到建立技术治理结构,展示了 Axiom 架构、GPU 支持、PyVelox 等关键进展,强调了社区协作与工程严谨性是项目持续演进的核心动力。他特别提到,Velox 已建立了正式的技术治理机制,并迎来来自 IBM、Intel、NVIDIA、Microsoft 等多家企业的新增维护者,标志着项目正迈向更加开放和可持续的阶段。

午餐后的议程更加聚焦 Velox 在真实业务中的集成深度与生产韧性,回应了开发者们对兼容性、稳定性与端到端效能等规模化落地的核心关切。

小米计算平台计算引擎负责人王胜杰分享了公司在 Spark 向量化升级中的规模化落地经验。面对业务迁移中的兼容性与稳定性挑战,他表示,小米通过自动兼容校验、双跑结果比对及内存异常感知的三级资源升级机制,已成功推动向量化改造在数十万作业中平稳落地。

Cyber Triage 3.17 发布 - 使用生成式 AI 增强并生成 DFIR 数字痕迹报告 Cyber Triage 3.17 for Windows - 面向事件响应的数字取证软件 Digital Forensics Specialized For Incident Response 请访问原文链接:https://sysin.org/blog/cybertriage-3/ 查看最新版。原创作品,转载请保留出处。 作者主页:sysin.org 唯一专门用于事件响应的数字取证工具 Cyber Triage 是一款自动化的数字取证与事件响应(DFIR)软件,旨在帮助安全运营中心(SOCs)、托管安全服务提供商(MSSPs)、顾问和执法机构快速调查网络入侵事件,如恶意软件、勒索软件和账户接管等。 Cyber Triage 3.17: Use AI to Enrich and Report your DFIR Artifacts Cyber Triage 3.17:使用 AI 增强并生成 DFIR 数字痕迹报告 2026 年 4 月 16 日 Cyber Triage 3.17.0 已发布,允许你将 AI 集成到调查过程中,从而更快得出结论。你现在可以使用 Claude 作为一个只读的 AI 助手,用于增强 Cyber Triage 的分析结果、生成报告以及发现新的线索。 这是我们首次将生成式 AI(GenAI)集成到 Cyber Triage 中。在本文中,我们将介绍 MCP Server 以及你可以利用它实现的功能。 此次 Cyber Triage 的核心新增功能是 MCP Server。它允许 MCP 客户端(例如 Claude Desktop)连接并查询数据。简单来说,可以将 MCP 理解为一个可供 LLM 调用以获取数据的 REST API。 数据流如下:你在本地计算机上运行 Claude Desktop 和 Cyber Triage,Claude Desktop 随后可以与 Anthropic 的服务器或 AWS / Azure / GCP 等平台上的 LLM 进行通信。 实际上,你可以使用任何 MCP 客户端,LLM 服务器也可以部署在任意位置。我们之所以重点介绍 Claude Desktop,是因为它目前最为流行。 完成连接后,你可以借助 LLM 的能力,加快调查速度: 例如,你可以让系统生成一份重要活动时间线: 或者生成入站和出站登录的网络拓扑图: 或者提出增强类问题,例如某个文件名是否常见: AI 有时表现惊艳,有时也会令人沮丧。我们正在以渐进且透明的方式,将生成式 AI 引入 Cyber Triage。 在本次版本中,需要注意以下几点: 我们提供了一段简短视频,展示如何完成设置并使用该功能。 该功能原本属于 Cyber Triage 企业版的一部分,但我们将其开放给所有用户使用,截止日期为 2026 年 9 月 1 日。 生成式 AI 正在迅速发展,大家都在积极探索。我们希望鼓励大家尝试,并与你一同学习哪些提示词有效,哪些效果不佳。 Cyber Triage 3.17: Use AI to Enrich and Report your DFIR Artifacts Apr 16 2026 更多:HTTP 协议与安全

快速、准确和简单地完成入侵调查新增功能

通过 MCP 将 Claude Desktop 与 Cyber Triage 集成

与你的 DFIR 数据对话

DFIR + AI 使用注意事项

快速设置视频

面向所有用户的企业级功能

立即体验

IPv6 这么多年推不动,难道就没有人觉得 IPv6 协议丑陋无比吗,那一坨地址看着就不想用啊

二十年了,IETF 终于醒悟了,改 IPv8 全面兼容 IPv4

r.r.r.r.n.n.n.n 如果 r 全部为 0 ,自动识别为 IPv4

终于看的顺眼了

IPv6 说明世界真是个草台班子

参考代码 STM32F103控制的两路PWM输出 www.youwenfan.com/contentsfa/103639.html CubeMX配置流程: Keil工程结构:一、硬件连接方案

1. 引脚分配(以TIM3为例)

通道 默认引脚 重映射引脚 适用场景 CH1 PA6 PB4 电机控制/LED调光 CH2 PA7 PB5 伺服电机/呼吸灯 2. 电路设计要点

二、软件实现代码

1. 定时器初始化(TIM3双通道PWM)

#include "stm32f10x.h"

void TIM3_PWM_Init(u16 arr, u16 psc) {

GPIO_InitTypeDef GPIO_InitStructure;

TIM_TimeBaseInitTypeDef TIM_TimeBaseStructure;

TIM_OCInitTypeDef TIM_OCInitStructure;

// 使能时钟

RCC_APB1PeriphClockCmd(RCC_APB1Periph_TIM3, ENABLE);

RCC_APB2PeriphClockCmd(RCC_APB2Periph_GPIOA | RCC_APB2Periph_AFIO, ENABLE);

// 引脚重映射配置

GPIO_PinRemapConfig(GPIO_PartialRemap_TIM3, ENABLE); // PA6→PB4, PA7→PB5

// GPIO初始化

GPIO_InitStructure.GPIO_Pin = GPIO_Pin_4 | GPIO_Pin_5;

GPIO_InitStructure.GPIO_Mode = GPIO_Mode_AF_PP; // 复用推挽输出

GPIO_InitStructure.GPIO_Speed = GPIO_Speed_50MHz;

GPIO_Init(GPIOB, &GPIO_InitStructure);

// 定时器基础配置

TIM_TimeBaseStructure.TIM_Period = arr; // 自动重装载值

TIM_TimeBaseStructure.TIM_Prescaler = psc; // 预分频系数

TIM_TimeBaseStructure.TIM_ClockDivision = 0;

TIM_TimeBaseStructure.TIM_CounterMode = TIM_CounterMode_Up;

TIM_TimeBaseInit(TIM3, &TIM_TimeBaseStructure);

// PWM模式配置

TIM_OCInitStructure.TIM_OCMode = TIM_OCMode_PWM1; // PWM模式1

TIM_OCInitStructure.TIM_OutputState = TIM_OutputState_Enable;

TIM_OCInitStructure.TIM_OCPolarity = TIM_OCPolarity_High;

// 通道1配置

TIM_OCInitStructure.TIM_Pulse = 0; // 初始占空比0%

TIM_OC1Init(TIM3, &TIM_OCInitStructure);

TIM_OC1PreloadConfig(TIM3, TIM_OCPreload_Enable);

// 通道2配置

TIM_OCInitStructure.TIM_Pulse = 0;

TIM_OC2Init(TIM3, &TIM_OCInitStructure);

TIM_OC2PreloadConfig(TIM3, TIM_OCPreload_Enable);

// 使能定时器

TIM_Cmd(TIM3, ENABLE);

}2. 占空比动态调整

// 设置通道1占空比(0-100%)

void Set_PWM1_DutyCycle(u8 percent) {

u16 compare_val = (arr + 1) * percent / 100;

TIM_SetCompare1(TIM3, compare_val);

}

// 设置通道2占空比(0-100%)

void Set_PWM2_DutyCycle(u8 percent) {

u16 compare_val = (arr + 1) * percent / 100;

TIM_SetCompare2(TIM3, compare_val);

}3. 主函数示例

int main(void) {

// 初始化PWM(周期20ms,频率50Hz)

TIM3_PWM_Init(19999, 71); // 72MHz/(72)=1MHz → 1MHz/(19999+1)=50Hz

while(1) {

// 通道1从0%到100%渐变

for(u8 i=0; i<=100; i++) {

Set_PWM1_DutyCycle(i);

Delay_ms(10);

}

// 通道2从100%到0%渐变

for(u8 i=100; i>=0; i--) {

Set_PWM2_DutyCycle(i);

Delay_ms(10);

}

}

}三、关键参数计算

1. PWM频率公式

频率 = 72MHz / (预分频系数 + 1) / (自动重装载值 + 1)2. 占空比计算

占空比(%) = (CCR值 / (ARR+1)) × 100四、调试技巧

1. 示波器观察要点

2. 常见问题解决

现象 原因 解决方案 无输出 GPIO未正确映射 检查AFIO时钟和重映射配置 占空比失真 中断干扰 关闭相关中断或提高优先级 频率漂移 系统时钟异常 验证PLL配置和外部晶振 五、扩展功能实现

1. 输入捕获同步

// 配置TIM3_CH1为输入捕获(用于编码器)

TIM_ICInitTypeDef TIM_ICInitStructure;

TIM_ICInitStructure.TIM_Channel = TIM_Channel_1;

TIM_ICInitStructure.TIM_ICPolarity = TIM_ICPolarity_Rising;

TIM_ICInitStructure.TIM_ICFilter = 10;

TIM_ICInit(TIM3, &TIM_ICInitStructure);2. 硬件PWM刹车

// 紧急停止时强制输出低电平

void PWM_Brake() {

GPIO_ResetBits(GPIOB, GPIO_Pin_4 | GPIO_Pin_5);

}六、完整工程配置

Project/

├── Core/

│ ├── Inc/ (头文件)

│ └── Src/ (源文件)

├── Drivers/

│ ├── CMSIS/

│ └── STM32F1xx_HAL_Driver/

└── Middlewares/

└── USB_Device/

在隔壁 NS 看到有佬分享的图文教程这款 0 元开卡、0 月租的德国 O2 eISM 卡。

跟着教程走了一遍,难度不大,全程挂的德国住宅 IP ,没触发视频验证,整个搞完差不多 20 分钟左右。

⚠️注意:网上很多说不用住宅 IP 也成功的,视频验证了换个邮箱继续注册也可。所以看来住宅 IP 不是必要条件,封控还没有沃达丰那么严格

就是 wise 充值要等 2 天才到,测试下来其他没啥问题。

tg 、WhatsApp 都正常注册。

目前德国沃达丰、德国 O2 都算低成本保号的海外手机号了,以后政策变了也没啥,反正成本低。

号段还挺好用的。

我是冲了 1 欧进去,半年发次短信。

图片教程看起来有些步骤还是不清楚,自己做了个视频教程,欢迎佬围观。

视频教程: https://youtu.be/iblx9nfkKrU?si=M-AVibZLgH8v93UN

其实现在 plus 一些卡密渠道是不贵的,很多人可以自己搞几个,成本很低。

使用 CC 开发一个中国功夫详细介绍的网站,包括中国传统功夫和古典武侠介绍。

https://gf.zorezoro.com/

MCP 这个协议刚出来的时候我感觉它到处透露着过度设计的味道,难用又难写,工作需要又不得不用,几乎就是捏着鼻子写。看到社区现在几乎一边倒地嫌弃它,要用 api 和 cli 替代掉它的时候我还有点幸灾乐祸。

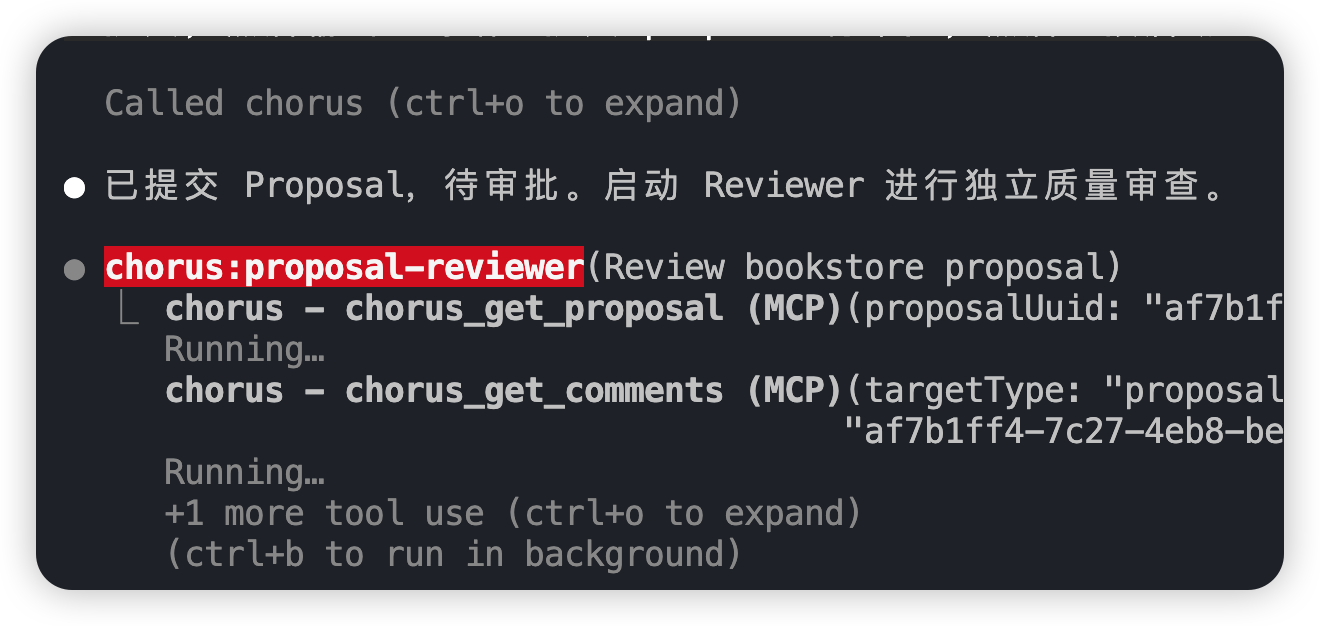

但我在开发自己的 Harness 项目 Chorus 的时候又发现一些场景下没办法替换掉 MCP ,主要的原因是通过 MCP 可以更好地感知 Agent 的意图。有点抽象,让我给大伙把我碰到的问题展开唠唠。

首先说说我想达到什么效果吧,Chorus 是一个用来让 Claude Code 这样的 Coding Agent 能自主推进从需求到设计最后到交付流程的 Harness ,前端看起来大概是这样,能跟踪 Agent 的工作到底到哪了

![]()

在这个流程里的关键节点,比如 Proposal 或者 Task 提交审批,就需要在 claude code 里启动一个独立的 Agent 去替人类审,揪出问题,用对抗的方式让 Agent 自己迭代出没有太大问题的结果

那么问题来了:我应该如何让 Claude Code 在这几个关键节点稳定地启动 Reviewer Agent 呢?

这是最简单的方式,直接在 Skill 里写清楚,“你必须在 XXX 节点调用 XXX Agent , 根据反馈然后去做 XXX” 非常简单但不靠谱,现在的 Agent 大家调过 PE 也知道,在 Skill 里写的真的会一致遵从吗?尤其是一个小迭代它自己跑上半小时,一开始的 PE 都忘得差不多了,这个方案只是锦上添花但是不解决问题

既然放在 Skill 里不靠谱,能不能在要启动 Reviewer 的时间点直接给 CC 注入 Prompt 呢?最简单的做法就是上一步动作,比如提交审批这个调用的返回结果里提醒 CC 你该启动一个 Agent 去 review 结果了。其实这个手法是有效的,但存在几个问题:

大多数成熟的 Coding Agent 都支持 Hooks ,这也是这类 Agent 的插件系统里最有用的机制,其实就是利用 AOP 的思想去在某一个关键节点上做一些操作。比如我现在的需求,只需要在提交审批这个动作之后去读取本地 Claude Code 配置,如果启用了 Reviewer Agent ,启动它就好。下一个问题是:我如何才能知道 Claude Code 触发了提交审批这个动作,并且提取参数( Proposal ID 等)来让 Reviewer Agent 知道自己到底要去看哪个资源?

拿 Claude Code 举例子,它的 Hook 机制大多数是围绕自己的生命周期流程的,比如SubagentStart, SessionStart等。如何才能知道它在 Chorus 上调用了提交审批这个动作呢?很明显用PostToolUse这个钩子。

如果我的服务用 CLI 或者 API 去暴露接口,那么对应的 tool use 其实是bash或者fetch等等通用的命令/网络操作调用,你想在其中解析出意图不是不可能,但非常不可靠。Claude Code 今天心情好给你直接调用,明天心情不好也许写了一个 py 脚本调用,你怎么去抓呢,参数匹配能出的幺蛾子就更多了。

对比之下用 MCP 去匹配意图简直是手拿把掐,因为 CC 暂时不支持配置本地工具,MCP 就是唯一能把调用固定成一个确定工具名的手法。大家有兴趣可以看下源码我是如何定义这个 Hook 的,简单地说用通配就行

"PostToolUse": [

{

"matcher": ".*chorus_pm_submit_proposal",

"hooks": [

{

"type": "command",

"command": "${CLAUDE_PLUGIN_ROOT}/bin/on-post-submit-proposal.sh"

}

]

},

这样我不仅能完全感知到 Claude Code 的意图,还能很好地提取参数去注入到一个 Reviewer Agent 的上下文中,省得 Agent 不靠谱地去帮我用生成 Token 的方式传递了。

当然我不是 MCP 的拥趸,这个协议设计得实在太难用了。MCP 真正不可替代的地方在于它把 Agent 的每一次调用都变成了带语义的、确定性的意图信号,前面提到的接口污染和意图捕获问题本质上都是因为这一点。更关键的是 MCP 是跨 Agent 的,不管哪个框架,不管支不支持本地工具定义,只要接了 MCP ,你就有了一个稳定的锚点去感知意图、围绕意图构建 Harness 。让我稳定感知 Agent 意图的协议,似乎只是目前只有 MCP 能做到?如果大家有更好的方法,务必评论给我。

奶奶 88 岁了,不用拄拐能简单的走动,老家的机场不大,柜台到候机厅就十几米的距离,从老家出发的时候是她自己过的安检。今天从黄花机场回去,机场还是有点大而且人流量也多,担心她的安全,提前在航司小程序上申请了一个轮椅服务。

到机场过了防爆,有工作人员看到了老人主动过来询问,引导我到爱心服务的柜台打印登机牌,登记一下陪同人员的信息。这个柜台旁边就是休息区,奶奶就坐着等轮椅过来,我还问了一下轮椅是不是到登机口归还,他们说有工作人员全程陪着,送上飞机后工作人员自己带走,然后就是奶奶坐着轮椅走工作人员通道过安检。

我就送到了安检口,后面的情况就是姑姑给我口述的,那趟航班没有廊桥坐摆渡车过去的,工作人员全程陪同帮忙推轮椅,登机后给安排到了最前面的位置,不是我给她们值机的位置。

全程下来奶奶就走了下车到柜台的距离,后面几乎都是坐着,感觉带老人出门玩也没啥太大的负担。

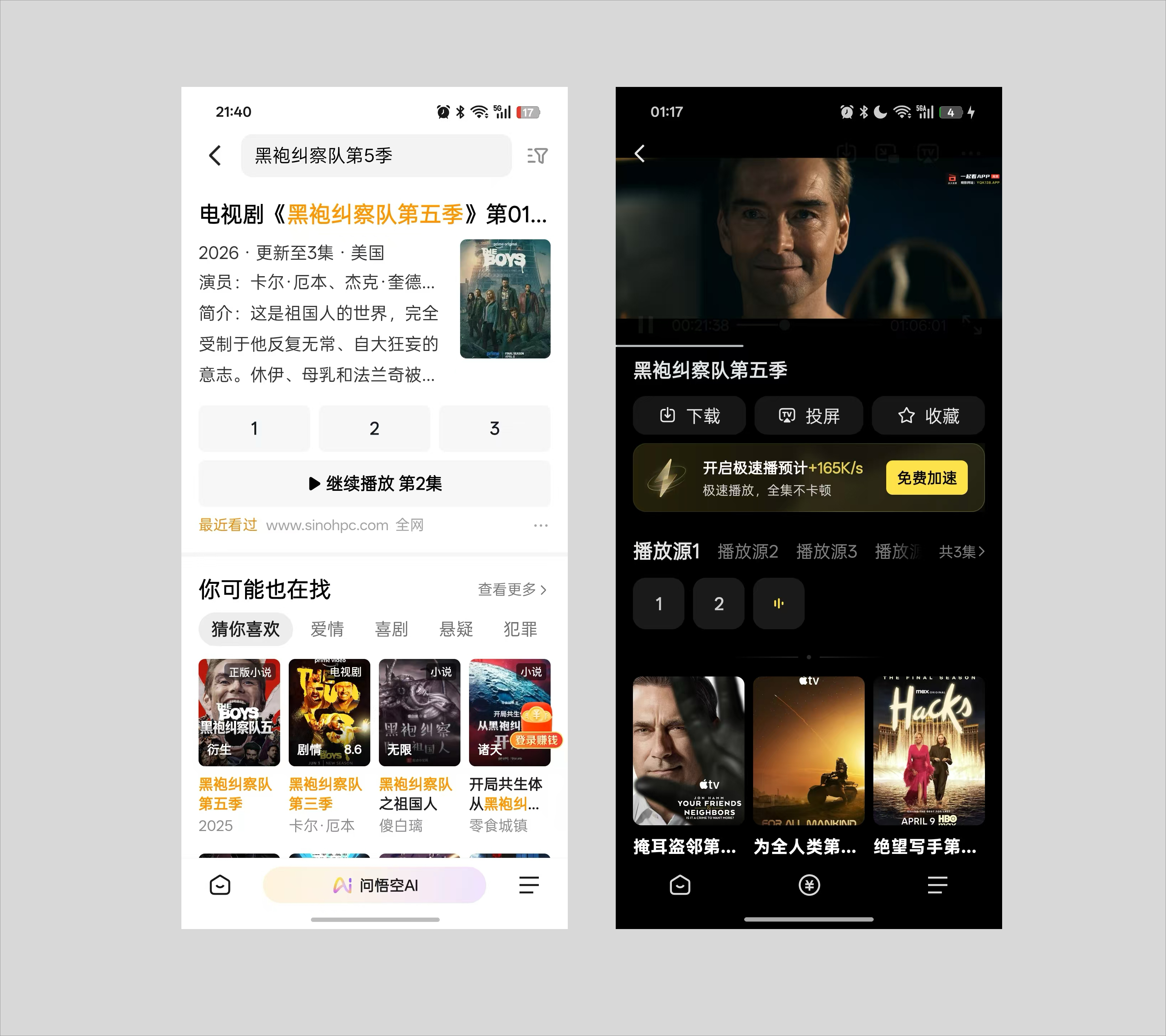

在小红书刷影视视频时

评论区总会看到有人发图片说“悟空上可看哦”。

我一开始以为是什么盗版野鸡网站,

后来总是刷到

好奇去查了下才知道他们说的是悟空浏览器

而这个浏览器还是字节跳动出品的

不得不佩服大厂推广 app 的手段也这么接地气(不要脸)……

试了下

该浏览器的最大卖点:观看盗版视频和阅读盗版小说

我搜了一下电影,排在前列的都是那些提供盗版的在线网站

而且,字节更牛的是

它将这些盗版网站封装了一层自己的播放器

把下游统统给吃掉了

你说它要是普通搜索结果吧,它明显是做了自己的调整

把这些“澳门新普京”排在前面,这不侵权吗?

有没有懂这些的同学来讲讲这背后的规则和猫腻?

按:今天是世界无线电业余日,旨在弘扬业余无线电精神。让人们不仅能够了解业余无线电在灾害救援、偏远地区联络等方面的重要作用,也希望能激发更多人参与到无线电技术学习与实践中,在不断发展的通信时代中延续开放、共享与探索的精神。

「一个漆黑的夜里,一个男人坐在窗前神色专注地发着摩尔斯电码,昏暗的灯光下电流的滴答声让他小心翼翼,此时一个声音响起,他快速的摘下耳机警觉的环顾四周……」

相信很多喜欢谍战片的朋友一定会熟悉这样的场景,儿时的我也不例外,操作电台这么酷的事情想必已经是每个男孩子的梦想,然而时过境迁,一转眼自己已经从懵懂少年开始步入中年,虽然一直在陆陆续续的查看一些关于无线电的资料,但总是因为工作与众多生活琐碎而一拖再拖,终于在24年初养病期间,通过了无线电考试成为了一个真正的「火腿」。

火腿(HAM)其实全称是业余无线电台(HAM Radio),因为英文中「火腿」有表示「业余」的含义,所以更多的时候业余无线电爱好者用火腿来称呼自己。

其实很多人一提起无线电台总是会和间谍与非法事务扯上关系,但现实中电台对于我们并非那么神秘,例如出租车里司机师傅的车台、机场指挥塔的航空塔台,收音机里的音乐广播这些都是电台,只不过因为常年的影视和宣传让人们认为除了手机、网络通讯以外的通讯都或多或少带着一丝神秘感。

在研究无线电的时候,我总会被问同样的问题:我们有手机有网络,通过微信等社交平台只需要轻松按一按就可以视频联系,业余无线电的存在还有必要么?关于这个问题其实从两方面来回答:

从国家层面无线电是一个重要组成部分,不仅在科研、军事、民防、救灾方面都会起到很大的作用,例如汶川地震时所有的通讯都进入到瘫痪状态,而正式业余无线电爱好者快速的将灾情信息传播出去,并对灾后秩序重建起了重要的作用,所以国家是鼓励业余无线电爱好技术的。

从情感上来说,网络虽然可以简化通信环节,但这百年间无线电怅然已经形成了一种文化,而文化就会有其追随者,同样也会产生一种情素,有很多人通过无线电相识,并成为了一生的好朋友,这真不是便利就能够替代的。

技术上的突破,有很多业余无线电台爱好者,本身就是极客他们在无线电业余领域的成就反向哺育了一些专业领域,而且HAM的宗旨就是提升个人技术,这对喜欢挑战科技知识与动手能力的朋友是非常合适的。

因为业余无线电本身在网络时代已经成为小众文化,目前HAM群体呈现两极分化的情况,即目前未成年的学生群体成为了新的生力军,但大多数有经验的HAM都已经是中年以上,很多甚至已经是爷爷级别,相关的资料都较少或较陈旧,汇总相关信息的资料量级比较大,我这里就先总结一些基础的流程和知识点。

频率简单来说就是你收听与发送的频点,这个如果没有电工基础的话你可以当做一个公用的电话号,如果我们选择同样的电话号就可以通联对话,当然如果非加密的情况只要是这个电话号就都可以听见。

其中频率根据工作范围分为不同的频段,如3-30兆赫为HF高频,30-300兆赫为VHF甚高频,300-3000兆赫UHF特高频,这些不同段的频率分别应对不同的工作场景。例如,本文后续所谓的UV段就是UHF和VHF中的一段分给业余无线电的频率。虽然短波就是一种传播很远的HF频率,但就不能因此否定UHF和VHF,在一些空间探索的项目中他们仍然是非常好用的频段。

举例来说我现在有个手台直连另一个手台,双方发射和接收都用438.600兆赫这个频率,那么理论上只要能够在可通讯范围里是可以直接通话的。

ps:目前国内一些地区,尤其是南方江浙地区已经开始对UHF段业余通讯进行严格管控,部分地区已经禁止使用UHF进行业余通讯。具体可以参考各个地方的无线电管理官方渠道,获取最新信息。

设备功率我们用瓦特来做为单位,有点像以前我们买的钨丝灯泡,功率越高灯泡越亮,理论上来说功率越高设备传播范围的理论值越高。

但是这个不是绝对的,有些通联环境比功率更能影响通联距离,比如城市和电磁干扰特别大的地方,高功率并不会有更好的效果,但像国际空间站这种反而功率几瓦就可以传播大部分地区,所以并不是功率越大就能通联更远。

首先,我们要做一个合法的HAM,所谓合法就是去考取一个国家指定的业余无线电操作证,这里将会根据各个环节进行讲解:

我国对无线电证分类为3类,分别是A类入门级,B类进阶级,C类专业级,其中各个类别有着设备功率和频段的使用限制,同时对操作者也有持证时间的限制。

A类作为入门级别,没有特殊时限要求,根据2024年3月的新规未成年人也可以设台,A类频段就是最简单的UV频段,设备最大功率不大于25W,这种类机器能够进行近距离通联,大家经常看见的出租车通联大多用的是A类

B类应该是正式的进入业余无线电范畴,不仅可以使用常见的UV频率,也可以使用通联更远的短波频率,根据最新2024年3月条例,30MHz以下频段需要小于15W,30MHz以上不得大于25W,并且B类证件必须保证持有A类业余电台执照6个月以上

C类可以说是最高难度的段位,由CARC(中国无线电协会)统一进行考试,C类可以从操作30MHz以下不大于1000W及30MHz以上不大于25W设备,并且需要取得B类电台执照18个月以上才可以获取

无线电考试可以在CARC官网统一报名,但是这里要注意下各地方考试因地区而异,通常一个省一个季度会有一次考试,但有的省市也会有多次,所以需要自己查看考试信息。

对于B类和C类时间频率更低,所以需要自己查看。现在协会也在推广自己的APP智谱,但是由于无线电这个对应老一辈比较多,所以智能程度不是很互联网,各位需要仔细阅读考试须知。

当然也可以联系当地的无委会来询问考试,不过这个部门相当冷门,能够找到他们说明你已经算是半个ham了。找不到的推荐拨打12345热线,通常来说考试需要1寸白底或者蓝底照片,需要填写表格,身份证需要横版拍摄等,提交后会有人进行审核,要定期去看审核结果。

注意:目前大城市报名非常难抢,要选对时间还要选对地点,异地报名要看好是不是需要本地居住工作的证明。

目前考试都是客观选择题,根据地区不同分为机考和笔试,每个类别都有自己的题库:

最新法规,A证与B证难度都有所增加,大家可以在官方在智谱app中提供了题库及模拟考试软件,如果觉得麻烦小程序也很多,并且有考点分析,A类相对来说最为简单,只要死记硬背通过率基本可以达到80~90%。

相信很多人在备考的时候就已经想上机实验了,但是又担心非法或者设备繁多不知道怎么选择,这里需要注意的是国家仅规定没有操作证不能发送信号,并没有法律条款限制收听频率,所以如果考试的时候有一个设备进行学习也是一个不错的选择。

ps:虽说不限制接收信号,但是国家规定业余无线电通讯是不能在公众场合发布,有很多的HAM喜欢监听机场塔台调度,这个原则上是不允许公布的,要注意。

根据电台的可移动性可以分为手台、车台、基地台:

这里以手台为推荐目标,手台分为数字手台与模拟手台,其中数字手台通常可以数模两用。数字手台通信方式使用数字模式配合中继使用,并且有着众多如C4、DMR、Dstar等模式,属于入门进阶使用,玩法也多。

对于绝对新手的我们比较推荐模拟机,尤其是他价格低廉,上手也非常简单,城市中模拟中继也还都算多数,非常适合入门使用。

这里需要注意的知识点是中继台,相信很多人不太懂的什么是中继台,他类似于手机的信号塔,可以让信号覆盖更广阔,也可以把他想象成一个聊天室,当你登录这个聊天室就可以在里面发布信息,相对的所有人都会收到这个信息,通常中继台会覆盖城市的行政区或几条街道的距离,可以让短距离的通讯变成更远更大范围的通联。

但是根据国家规定中继台在非必要情况不要长时间占用,所以HAM通常都会在上面简单地通联记录或者汇报信息,还请大家合理使用中继。

中继台可以在小程序中获取,注意很多城市的中继可能随着HAM的减少或是拆除或者改频,要注意甄别。

对于设备的不同通常要匹配不同的天线,天线可以对信号发射提升有着决定性作用,对于无线电通讯来说,室内以及城区会对信号衰减造成巨大的干扰。虽然一般购买的手台都配有原装的天线,但通常效果不是特别理想,建议后面升级天线会好一些。

天线分为手台的拇指天线以及车台770天线,还有玻璃钢的棒杆天线等等,根据使用范围更是五花八门,比如短距离或者移动的选择拇指天线可能就是不错的选择,在车中可能就要选择车台天线,需要注意的是购买天线要询问天线适合的机型、频率、功率、接口类型等,这里就不一一介绍,购买的时候询问店家即可,推荐的品牌有日本的钻石、台湾老鹰、国内的华鸿等等。

这里需要特殊说明的是,在没有证件的情况下不要进行通联,通联有着自身的通联规则,合格的HAM会始终坚持规范通联,在没有取得证件和呼号之前请先守听学习。

为了方便大家这里推荐两款模拟手台,分别是宝峰BF5rh与泉盛的UVK6。其中宝峰的5rh彩屏与10W功率都是卖点,而K6的质量和通联效果被誉为网红神机(有魔改版本,看成手台中的59),价格方面150元以内都可以搞定,有些渠道比这个还要便宜。这两款手台长相都是对讲机的样式,所以他会经常出现在洗浴中心和酒店、停车场、甚至是海外大片的雇佣兵身上。这里需要特别说明的是,购买设备一定要让店家提供可以验机的设备码(CMIT ID),至于是什么我们下个章节来介绍。

当你成功通过考试以后,大概等上3-5天就可以收到协会发放的操作证。这里需要注意,拥有操作证并不代表你就可以合法的使用电台,如果你购买了设备,还要去当地的无委会进行验机设台,当然也可以登录政务网站进行网络设台申请。

以上海为例,只要购买的设备拥有合法有效的CMITID,则可以直接通过随申办进行网络申请,上海地区也需要使用上海经济和信息化委员会办理网络。不出门即可申请设立电台。

这里的CMIT ID在购买设备的时候要特别询问下店家,因为有些设备国内国外都进行销售,所以有部分国外设备和新设备流入到市场中,所以部分设备是没有CMIT ID码。需要注意的是CMIT ID码是有时效的,所以注意要上网查询一下是否在有效期内。

如果你恰巧是为末日生存者,自己用废零件手搓了电台,那么就需要前往无委会进行验机,填写表格后再进行电台申请,申请一周后即可获得国家认证的电台证件。

恭喜你这时候你就可以获得一个呼号。中国的呼号是B开头,数字代表所在区域,例如我的呼号BH4GZR就代表我是中国上海地区。这个呼号就类似你的车牌号,进行通联来说没有人询问你的姓名,而呼号就是你在无线电世界的名字。

当你拥有呼号的那一刻,欢迎你来到无线电的世界。

介于篇幅问题,下一章节讲述如何设置中继等问题。HAM圈其实是一个很有礼节的群体,经常能够在频道中听到叔叔和爷爷辈的人在交流,在接触一段时间后发现HAM在技术互帮互助与交流方面都有很好的氛围,只是因为年龄与生活习惯的问题造成人们对于他们的不理解。

关联阅读:《寻找你身边的电波——如何上中继》

例如我妈在看我守听电台时总以为我在偷听敌台,这同样也造成了人们对于无线电的偏见。近年无线电的重新崛起也会让这个爱好重新回到人们的视野,有更多的学生与新鲜血液逐渐的融入在业余无线电领域,你能想象么,在一个我们看不见也听不到的空间中,有一群人正在快乐的愉快聊天与交流信息,这是一个多么有趣的事情。

2年时间过去自己已经从小白的A证变成了可以使用短波的B证HAM,但还是有很多内容需要学习,如果有说的不对的地方还请谅解,我的呼号是BH4GZR,欢迎各位通联。

> 关注 少数派小红书,感受精彩数字生活 🍃

> 实用、好用的 正版软件,少数派为你呈现 🚀

各位 V 友好,之前玩儿 QQ 斗地主明显感觉被系统操控,我一怒之下开发了一款纯粹的 TUI 斗地主,界面如下:

支持匹配、房间模式,同时支持大厅聊天。游戏没有任何控牌,享受纯粹的棋牌娱乐!

使用方式很简单,使用以下命令一键安装启动:

macOS & Linux (安装在$HOME/.local/bin)

curl -fsSL https://raw.githubusercontent.com/palemoky/fight-the-landlord/main/install.sh | bash

Windows (安装在 $env:USERPROFILE ".fight-the-landlord")

irm https://raw.githubusercontent.com/palemoky/fight-the-landlord/main/install.ps1 | iex

之后直接使用 fight-the-landlord 命令即可启动

详细信息可查看项目源代码: https://github.com/palemoky/fight-the-landlord

欢迎提交 Issue 和 PR ,欢迎 Star~

最近 chrome 卡爆了,我以为是我浏览器的问题,清缓存,改设置,都不行

没招了,扩展应用挨个禁用,然后重试

发现 bitwarden 2026.3.0 版本会导致 CPU 高占用,Chrome 直接卡爆,禁用后解决。

各位安装 bitwarden 扩展应用的可以先禁用了,不知道啥时候能修复。

本人 996 ,最近很感觉上班,生活都没有心情,很无力。不过平时也在做投资,收益还过得去。所以就想问下 V 友有一边旅居一边投资的朋友吗,体验如何,是如何安慰自己放下一切去过这种生活的。

大家好,我是 专注分享 如果你手上有自己的域名,只是想把 Cloudflare Email Routing 负责把别人发到你域名邮箱的邮件转进 Gmail。Gmail 负责从这个地址回信。 它不是完整企业邮箱,但拿来放在博客、作品集、简历、联系页、独立开发者官网上,已经很够用了。 如果你要一个看起来专业、能正常往来邮件的联系邮箱,这套很合适。你要的是团队邮箱系统,那就别省这点钱,直接上正式服务。 部分参考文档: 先做最小可用版:让别人发到 你看到的正确结果应该是这样的: 小建议:有建明确地址,不要一上来开 收件只是前半段。那怎么用对应的这个域名发出去。 注意,Cloudflare 不负责发信。它只是把邮件转进来。真正往外发信的,还是 Gmail,或者你后面换掉的别家 SMTP 服务。 Gmail 不会让你直接拿账号密码去配 SMTP。你要用的是应用专用密码。 如果找不到“应用密码”入口,可能的两个原因: 碰到第二种情况,就别死磕了。要么退出 如果 注意,如果你想要别人给你发了邮件,你想用对应的邮件回复,这一步设置是必须的。 设置下面这一项 用其他邮箱,比如 QQ,163 邮箱测试一遍 到这一步,主流程就已经跑通了。 这不是你哪里配错了,很多时候是 Gmail 这条发信链路本来就有这个边界。 你现在这套方案里: 所以在部分收件客户端里,对方可能会看到你的 Gmail 痕迹,比如 这在个人沟通、博客联系邮箱、独立开发者业务往来里通常问题不大 真要说这套配置最难的地方,也就两个:一个是别把 ImmerseAI 玩法、独立开发与AI 出海的 AGI 实践者,更多干货欢迎关注公众号 #沉浸式AI 或访问 yaolifeng.comhi@你的域名.com 用起来收发邮件,又不想每年给 Google Workspace 或 Microsoft 365 交钱,这套 Cloudflare Email Routing + Gmail 现在依然够用。主要边界

MX 记录。如果你这个域名已经在用腾讯企业邮、阿里企业邮、Google Workspace,不要直接点开通准备资料

QQ、Outlook、另一个 Gmail 都行先把收件打通

hi@你的域名.com 的邮件,能够进你的 Gmail。Email -> Email RoutingMX 和 TXT 记录。这里要认真看一眼,如果面板提示要删除旧的 MX,就代表旧邮箱服务会一起停掉Routing rules 里创建一个自定义地址。比如把 hi@你的域名.com 转发到 yourname@gmail.comCatch-all。Catch-all 很方便,但也很容易把拼错地址、垃圾邮件、爬虫乱发的邮件一起吞进来。大多数人先用 hi、contact、hello 这种固定地址就够了。再把发件打通

开 Google 两步验证,生成应用专用密码

应用专用密码Advanced Protection,Google 官方说明里明确写了,这种模式下应用专用密码不可用Advanced Protection,要么直接跳到后面的“换第三方 SMTP”方案。在 Gmail 里添加对应的发件域名

账号和导入hi@你的域名.comTreat as an alias 这个选项,默认保留勾选就行。你本来就是在给同一个人加另一个发件地址SMTP 服务器:smtp.gmail.com

端口:465

用户名:你的 Gmail 完整地址

密码:刚刚生成的 16 位应用专用密码

加密方式:SSL465 + SSL 连不上,再试一次 587 + TLS。这是 Google 官方文档里也支持的组合。配置自动选择回复邮件

测试整个流程

hi@你的域名.comFrom,确认显示的是你的域名邮箱对方为什么还会看到

via gmail.com 或者 on behalf ofvia gmail.com,或者 yourname@gmail.com on behalf of hi@你的域名.com。最容易踩的几个坑

MX 已经被 Cloudflare 接管了Advanced Protectionvia gmail.com。这通常不是配置错,是 Gmail SMTP 的边界MX 记录改糊涂,另一个是 Gmail 一定要用应用专用密码。

独家海外工作室渠道,安全可靠,当天不通过包退

可认证地区/价格

肯尼亚,孟加拉,尼日利亚,菲律宾,印度尼西亚

188 元/次

🇺🇸美国 288 元/次

欧洲,日本 还在逐步增加...(欢迎合作)

上一周都是正常响的呀,我的闹钟都是震动,不开声音的。今天唯一不同的就是,iwtach 没电了,闹钟只在页面显示个图标,但是手机没有震动。重新设置闹钟也是一样的不震动,这是为啥呀!

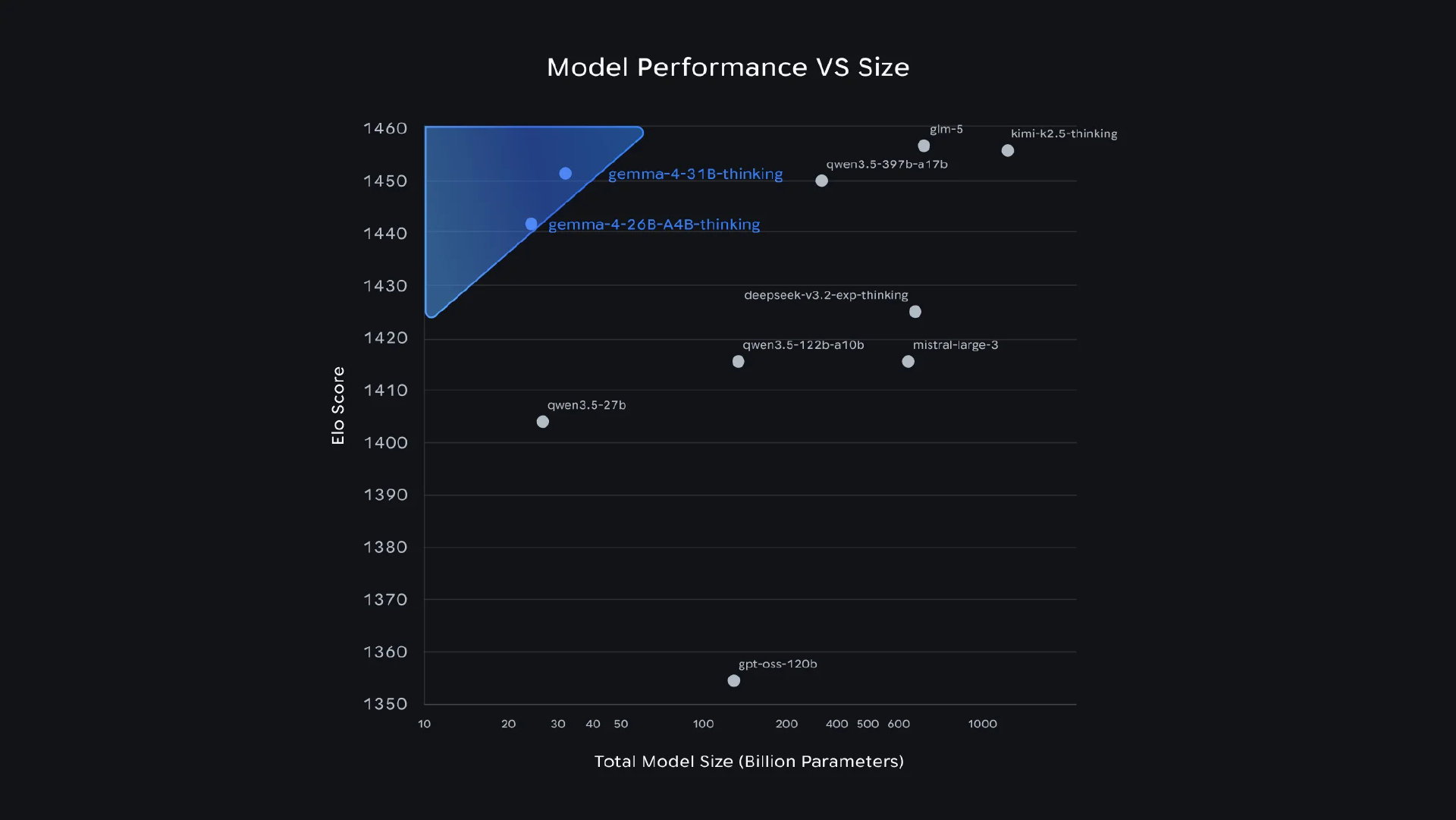

谷歌近期发布了 Gemma 4 系列开源权重模型,其中包含高效的 2B 和 4B 边缘端版本、一个 26B 混合专家(MoE)模型,以及一个 31B 稠密模型,所有模型均基于 Apache 2.0 许可开源。本次更新为全系列模型加入了原生视频与图像处理能力,小型模型还支持音频输入,上下文窗口最高可扩展至 256K 词元。基准测试结果显示,31B 稠密版本的性能已达到通常需要其三至五倍参数量级模型才能实现的水平。 该系列模型以“智能体”为核心定位,并在具体能力上得到充分体现。谷歌表示,31B 版本在 GPQA Diamond 上得分 84.3%,在 LiveCodeBench v6 上得分 80.0%。其中 GPQA Diamond 的成绩几乎是前代 Gemma 3 IT 27B 所达到的 42.4% 的两倍,体现出其在科学推理与代码生成能力上的显著提升。在工具使用方面,模型新增了对函数调用、结构化 JSON 输出与原生系统指令,这一组合旨在帮助开发者构建可与外部工具及 API 交互、并可靠执行多步骤工作流的自主智能体。 在架构方面,该系列模型同时采用稠密与稀疏两种设计。26B MoE 模型在推理时仅激活 38 亿参数,可实现高吞吐量的词元生成速度;31B 稠密版本则更适用于看重单词元成本稳定性、而非峰值参数数量的任务场景。面向内存与功耗受限的移动及物联网设备,边缘模型提供了 128K 上下文窗口;更大尺寸的模型则将上下文窗口扩展至 256K 词元,可在单次提示中处理体量较大的代码库或长文档。四款变体均支持可变分辨率的原生视频与图像处理,其中 E2B、E4B 边缘模型还新增了原生音频输入能力,支持语音识别与理解,整个系列的训练数据覆盖超过 140 种语言。 在基准测试方面,谷歌表示,31B 稠密模型的纯文本预估 LLMArena 得分为 1452,达到了通常需要参数规模大三至五倍的模型才能达到的性能水平。 来源:谷歌博客 开源模型社区的反应并未过多关注模型的原始分数,而是更多聚焦在实际可用性与新的许可协议上。Sam Witteveen 对谷歌采用了 Apache 2.0 许可表示赞赏: 这是真正意义上的 Apache 2.0 许可,意味着你可以拿到谷歌目前最优秀的开源模型,并可对其进行修改、微调、商业部署,自由使用,没有任何附加限制。 Nathan Lambert 认为 Gemma 4 的价值在于其无摩擦的集成体验,他指出: Gemma 4 的成功将完全取决于易用性,基准测试 5% 到 10% 的波动根本无关紧要。它性能足够强、体量足够小、许可友好,再加上由美国公司研发,因此会被许多企业直接采用。 本次发布的分发渠道十分广泛:模型权重可在 Hugging Face、Kaggle 获取,并可通过 vLLM、llama.cpp、Ollama、MLX、LM Studio、Unsloth、SGLang 和 NVIDIA NIM 等平台使用,此外还提供了一个基于 NVIDIA Model Optimizer 的 NVFP4 量化版 31B 模型检查点。Kaggle 正在举办 Gemma 4 Good Challenge 挑战赛,邀请开发者使用这款新模型构建能产生积极社会价值的应用产品。 【声明:本文由 InfoQ 翻译,未经许可禁止转载。】