很多佬友都想购买一个心仪的服务器,但是市面上太多了,不知道该如何下手,我就来简单推荐一些各个地区常见的线路机器 / 落地机器 / 家宽机器,包含 MJJ 常用的主流机器和评价不错的服务商,你可以通过这个来简单筛选适合自己的机器

- 线路机器:拥有 CN 大陆方向的优化线路机器,延时低稳定性高

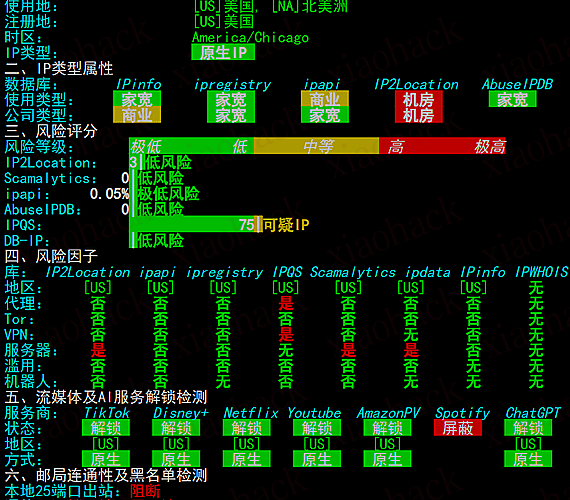

- 落地机器:国际互连优秀 / 流媒体解锁优秀的机器,注意:落地适合与否和 ip 质量并无关系

- 家宽机器:IP 质量优秀的机器,不容易被风控

叠个甲:一般说不要轻易随便给别人推荐机器,因为大家的本地网络情况大不相同,有些地区舒服的机器有些地区就是不行,这个没什么办法,网络实在是太复杂,所以这个推荐你可以看成是一个概率推荐,即最有可能最多人满意的机器,本推荐也会着重说明机器的缺点而不是优点,因为优点总是能找到的,但缺点往往是致命的、可以影响决策的。VPS 信息繁琐,这个推荐注定是要多次修改的,也欢迎大家指出问题分享体验,常看常新~

本文无 AFF,有必要说明的是:建站机器的推荐将会缺失,因为我真的不玩建站机器,什么斯巴达 /ovh/netcup 都用的不多,就不强行推荐了。当然了,如果你不知道线路 /ip 质量,或许你可以看看常见线路的科普和 IP 质量检测方法。

本文最后更新于 2026/1/11,测评与推荐结果在此日期附近有较强参考性,原文链接。

HK (香港)

HK 因为常年被 ddos 攻击,线路质量非常不稳定,防御成本高昂,绝大部分商家的 HK 线路机器都是搞的一地鸡毛,最后只剩下几家高端机器,HK 廉价线路机器基本不存在了 (除了小口子 10Mbps 这种),电信联通基本没有便宜的 HK 机器了,移动还能玩玩一些移动快乐机。不过作为亚太的中转核心,有需要的还是有必要买一台强力的 HK 线路机,拉 TW/SG 都是很好的选择。

线路机器

三网各自顶级优化 (CTGGIA/9929/CMIN2) 的 HK 线路机器,单线程轻松稳定 500Mbps + 甚至 1Gbps (移动上行 qos 严重伴随断流,下行正常),国际互连优秀;ip 质量还不错,流媒体基本解锁,完全可以直出;机器性能非常强劲,恐怖如斯。毫无疑问,如果你能接受它的价格,它就是 HK 的顶端机器。

缺点:移动上行低 (直播等需要大量上传的移动用户慎选)

常见产品线:

- HKG.Turin.Mini:2C4G 100GB 1T 单向 / 月 2Gbps 69 刀 / 月

- HKG.Pulse.Mini:2C4G 40GB 1T 单向 / 月 1Gbps 49 刀 / 月

Gomami 详细测评

三网各自优化 (高 q163/10099/CMIN2) 的 HK 线路商家,电信联通的表现都相当优秀,上下行单线程都有稳定 500Mbps+,但移动去程主干 CMI 表现相当一般,非晚高峰都 q 的厉害,长时间上行都达不到 100Mbps 还伴随断流,不适合需要上传 (直播) 的用户,回程 CMIN2 倒是极致,随便跑到 500Mbps+;ip 质量不错,直出完全够用无需落地,国际互联也很强力;7Y43 的 CPU 性能不错,较为强劲,大部分应用都能满足了。相比起 Gomami 而言,这个机器相当便宜起步价低。

缺点:移动上行低 (直播等需要大量上传的移动用户慎选)

常见产品线:

- Hong Kong (HKG):1C1G 20GB 500GB (单向)/ 月 55.92 刀 / 季

Neburst 详细测评

三网 CN2GIA 优化,电信用户很舒适,联通移动也不错 (虽然二者面临跨网延时会偏高),单线程电信用户可以跑到 300-500Mbps,联通 300Mbps+,移动也有 300-500Mbps+,速度都是比较极致的;ip 质量不错,直出完全够用无需额外落地,国际互联比较不错;机器性能较为强劲,绝大部分应用可以满足。

缺点:联通移动跨网延时可能会略微升高 + 近期被 ddos 攻击导致不稳定

常见产品线:

- HKG.Pro.Victoria (维多利亚):1C2G 60G 800G (双向)/ 月 298.88 刀 / 年

DMIT 详细测评

三网各自优化 (高 q163/10099/CMI) 的 HK 线路商家,电信相当极致,晚高峰单线程上下行 500Mbps,联通去程部分地区 (济南) 拉跨,多次测试都卡在 100Mbps,回程 400Mbps 很极致,其他地区不错,移动少部分地区拉跨 (哈尔滨 / 沈阳 / 大连 / 天津),其他地区很极致,单线程有 500Mbps,广移都有 300Mbps;ip 质量中规中矩,该解锁的都解锁;机器性能较差。

缺点:移动部分地区爆炸 + 部分地区联通上传拉跨 + 性能较差 (不是建站的选择)+ 经常被 ddos 攻击导致不稳定

常见产品线:

- HK-CO-Mini:1C1G 15GB 1.5T (双向)/ 月 18.9 刀 / 月

RFC 详细测评

ISIF 的 HK 拥有两款产品线,COM (CN2/9929/CMIN2) 和 COP (高 q163/10099/CMIN2) 系列,前者对标高端机,后者对标中端机,由于这家的详细测评并没有完成,所以此处先不评价具体到某个运营商的情况,机器已在测试中,具体情况后补。

不主流但值得一看的产品

- VMISS 的 CN.HK.BGP.DC3.Basic:20r 左右 / 月的 HK 优化 (CTGGIA/10099/CMI) 线路,虽然只有 100Mbps,虽然只有 300GB 流量,虽然联通上行 q 麻了,虽然 ip 质量一般 (甚至送中),但是只要 20r / 月啊,你看看跟上面的动辄 10 刀 30 刀的一比,是不是这些缺点都能接受了?当然了,如果你是移动单线,他家 14CAD / 年的 CN.HK.INTL 也很不错。VMISS 详细测评

- Zouter 的 HK BGP Global - Standar:9.9r / 月的移动 + 教育网快乐机器,电联完全爆炸无法直连,但是移动 + 教育快乐让他在特定情形下是个优秀的选择,毕竟只要 9.9r (最近一个月他家被同行 ddos 打的生活不能自理了,最好过段时间再买)

- YXVM 不做散户了,就不推荐了;Fxtransit 速度跑不起来,和价格有点不匹配;yunyoo 这类小水管 10M20M 的 CN2 就不推了,实在是食之无味弃之可惜;BWH 的 90 刀 / 月实在是太贵太贵,机器好是好,但是价格和配置严重不匹配了;technovm 的大小包高手不要跑出来吓我哈。

家宽机器

亚太顶级家宽服务商,提供 HKT/HKBN/i-Cable/CMHK/HGC 等的几乎所有 HK 家宽产品,顶级的家宽质量,标准化稳定产品,主要面向中高端用户。这个机器本身是几乎完美的,只要你能接受价格,那 HK 家宽就是这家了。

常见产品线:

- HKT:2C2G 8GB 500Mbps (5TB 双向) 38 刀 / 月

- i-Cable: 2C2G 8GB 1000Mbps (5TB 双向) 38 刀 / 月

港仔详细测评

HK 地区较大的 HK 家宽服务商,提供 i-Cable/HKBN/CMHK/HKT/HGC 等几乎所有 HK 家宽产品,顶级的家宽质量,这家主打的是 VDS,独享带宽无限流量,面板比较简陋,产品标准化和便捷性较差,相比起港仔没这么成熟,oneman 了一点,但是产品相对价格也会低点。

常见产品线:

- CMHK FTTx VDS - 200Mbps:1C2G 10GB 200Mbps (无限流量) 38 刀 / 月

- HKT FTTx VDS - 200Mbps:1C2G 10GB 200Mbps (无限流量) 38 刀 / 月

不主流但值得一看的产品

- Bestvm 的香港 HGC-Special-2:价格确实是便宜其他家一大截,质量也不错,平均下来 70r / 月就有一个独立 ipHGC 家宽,流量还多。

- Yinnet 的香港双 ISP 产品:同样的 HGC 家宽,搭配活动的 5 折券,竟然可以 5 刀 / 月买到一个独立 HK 家宽 ip,这个价格更是重量级,是真便宜啊,把价格战贯彻到底。不过这么便宜,ip 质量容易崩坏呢

- NAT 机器 ip 质量都挺差劲的,除了港仔的 NAT 好点 (有人数限制),其他无一例外都是超售 + 不稳定的小垃鸡,什么速达云,喵云诸如此类,我是不太推荐的。

落地机器

无优化,电信丢包绕路严重,移动联通部分地区快乐,整体还是不可直连的机器,不建议直连使用;ip 质量一般;机器性能中规中矩,大部分应用都足够使用。DMIT 有独特的超量限速不限量政策,如果流量较大的话性价比就比较高。

缺点:同段机场较多,沦为纯粹的流媒体解锁和国际互联机器,该跳盾还得跳盾

常见产品线:

- HKG.T1.WEE: 1C1G20G 1T (单向)/ 月 超量限速 50Mbps 36.9 刀 / 年

DMIT 详细测评

三网不可直连,RFC 拥有 CTC+JINX 的强力上游,国际互连优秀;ip 质量一般;机器性能一般。这家最大的特点不仅是国际优秀,而且 JINX 系列还拥有免费的 DNS 解锁和 EMBY 服务 (CTC 系列没有),性价比进一步上升。

缺点:同段机场较多,沦为纯粹的流媒体解锁和国际互联机器,该跳盾还得跳盾 + 经常被 ddos 攻击导致不稳定

常见产品线:

- T1ION-Unlimited speed-Balance:1C1G 10GB 2TB (双) 29.9 刀 / 年

RFC 详细测评

熟悉的 CTC 上游啊,国际互连很不错啊,直连电联基本爆炸,移动相当快乐,去程能跑 500Mbps,回程也有 200Mbps,虽然 CMI 晚高峰波动大,但用还是能用的,性价比一下就很不错了;ip 质量不错,合格的落地机器;机器性能比较强劲,EPYC 7663 的 CPU,IO 也不错,可惜还是配置低,1c1g 掀不起大浪。

缺点:同段机场较多,沦为纯粹的流媒体解锁和国际互联机器,该跳盾还得跳盾 + 经常被 ddos 攻击导致不稳定

常见产品线:

- Hong Kong Standard - TINY:1C1G 20GB 2TB (双) 3.99 刀 / 月

BageVM 详细测评

不主流但值得一看的产品

JP (日本)

JP 应该是亚太最难搞的区域,无论是线路还是落地,价格都相当高昂,大部分线路机器直出就是不错的选择了,落地机器大多也是主打国际互连的,没有那种很干净的非家宽落地机器,需要干净还得是家宽,但是家宽价格很高昂,就导致这个区域的 NAT 机器满天飞,各家的软银 NAT 其实质量都大差不差,也就是超售多少和价格的区别而已,如果你让我给你一个省钱建议:那就是别玩日本机器。(美西组一个优质线路 + 优质家宽的价格)*2 < 日本优质家宽的价格

线路机器

三网各自顶级优化 (CTGGIA/9929/CMIN2) 的 JP 线路机器,单线程 400Mbps+(移动上行 qos 严重,下行正常),国际互连优秀,对 ip 质量没要求的可以直出;ip 质量还行,常规流媒体基本解锁,但是日本本土网站解锁很差,DMM 倒是解锁,meta 不出意外的不能用;机器性能比较强劲。整体而言是相当优秀的建站业务机器。

缺点:ip 质量差,有需要还是要套家宽 + 移动上行低 (直播等需要大量上传的移动用户慎选)

常见产品线:

- JPN.Pulse.Nano:2C2G 40GB 500GB 单向 / 月 29 刀 / 月

Gomami 详细测评

三网优化,电信双程 163pp (高 q163) 表现比较极致,联通则是双程 10099,移动去程 CMI 回程 CMIN2。电信表现都相当优秀,上下行单线程都有稳定 300Mbps-400Mbps,联通速率偏低但也还行,移动去程主干 CMI 表现相当一般,非晚高峰都 q 的厉害,长时间上行都达不到 100Mbps 还伴随断流,不适合需要上传 (直播) 的用户,回程 CMIN2 倒是极致,可以跑到 300-500Mbps+;ip 质量不错,直出基本够用,无需落地 (解锁有点混合,ip 地区还没更新,有 US 解锁有 JP 解锁),当然很多 JP 专属的流媒体解锁失败,国际互联也很强力,无需求可以直出;机器性能比较强劲。整体而言是相当优秀的建站业务机器。

缺点:ip 质量差,有需要还是要套家宽 + 移动上行低 (直播等需要大量上传的移动用户慎选)

常见产品线:

- Tokyo (NRT):1C1G 20GB 500GB (单向)/ 月 55.92 刀 / 季

Neburst 详细测评

三网 CTGGIA 的线路 (CTGGIA 和 CN2GIA 基本无差异,CN2GT 才是比较烂的),IPV6 可以直连,电信单线程基本可以跑到 500Mbps,移动联通基本也有 300~400Mbps,三网都很不错。ip 质量中规中矩;机器性能比较强劲。

缺点:ip 质量一般,有本土流媒体需求还是要套家宽 + 联通移动跨网延时可能会略微升高 + 近期被 ddos 攻击导致不稳定

常见产品线:

- TYO.Pro.Shinagawa (品川):1C2G 60G 840G (双向)/ 月 199.99 刀 / 年

DMIT 详细测评

去程回程优化的 JP 线路,高 q163+10099+cmi,实测下来电信上行 (去程) 确实是优化,但是这个优化也仅仅到不丢包而已,去程并不算优秀,多次测试都卡在 50Mbps,下行很极致,有 400Mbps,联通上下行都很极致,单线程 400Mbps + 低重传,移动大部分地区比较优秀,单线程有 300Mbps,少部分地区拉跨,丢包丢飞了,在这些地区 (查看详细测评中的 ITDOG 可见) 的用户需要慎重考虑上车;ip 质量很差,送中 + 大量流媒体被 ban,要靠 DNS 解锁救一下了;机器性能中规中矩。

缺点:ip 质量差,有需要还是要套家宽 + 电信上行低 (直播等需要大量上传的移动用户慎选)+ 部分地区移动爆炸

常见产品线:

- JP2-CO-Micro:1C0.5G 10GB 1T (双向)/ 月 10.40 刀 / 月

RFC 详细测评

不主流但值得一看的产品

- ISIF 的 COM 系列:三网优化机器,应该是对标中端机器,经常看到 MJJ 说它家 JP 速度不行,我因为并没有长期使用,而且这家的详细测评并没有完成,所以此处先不评价具体到某个运营商的情况,先挖个坑,机器已在测试中,具体情况后补。

- Bagevm 的 Japan Standard:3.99 刀 / 月,2T 双向 / 月,本质上是一台落地机器,流媒体解锁比较完整,同段机场多导致 ip 质量差,线路方面是三网软银,神就神在这个机器联通移动基本快乐,联通可以跑 1000Mbps 上下对等,移动也有 300Mbps 上下对等,电信晚高峰爆炸丢包用不了,联通移动依旧比较快乐,作为一个落地还送线路,它真的我哭死。BageVM 详细测评

- 绿云软银:绿云三网软银线路表现和 BageVM 差不多,都是移动联通比较快乐,电信爆炸,这家的机器我没有持有过,也没有太关心,因为 MJJ 用的很多,所以加进来了,评价实在是不知道怎么评价,先空着吧…

- 小秘书的 Gen2:没有持有过,看测试和 MJJ 的评价来看是一台三网极致的高端机器,正价高昂,活动款溢价夸张,正常来说我觉得这个应该在上面,不过没有进行过详细测试而且 MJJ 持有量也并不大,不主流,所以放在这个板块里。

- Nube 的 JP 国际优化:1 刀 / 月起步的日本三网直连 + 性能强劲机器,直连的电联 IIJ + 移动 softbank,三网延时都很好看,实测下来电信基本只有 50Mbps,联通移动倒是很不错,有 200~300Mbps 的速度,值得注意的是:IIJ 和 softbank 晚高峰波动较大,时不时会断流卡住,这个机好就好在价格上,它才要 1 刀… 小流量用户福音啊。Nube 详细测评

- VMISS 的 JP.TKY.TRI:JP 地区的三网优化 (CTGGIA/10099/CMI),12CAD 也就是 60r / 月,平常有 8 折活动入手就是 50r 左右每月,口子偏小只有 100Mbps,流量倒还行,在 JP 地区三网优化这个价格很不错,个人使用完全足够,也可以作为过渡时期的机器。网络质量比较优秀,三网基本都能跑满 95Mbps,带宽冗余不错,部分地区有丢包 (例如深电),大部分地区稳定低重传;ip 质量中规中矩;机器性能较强,EPYC-Milan 的 CPU 基本够用。VMISS 详细测评

- Skyline 的 JP 产品:正价性价比一般,活动款 12.5 刀 / 年一下就很有诚意了,1T 流量 / 月联通移动快乐机 (虽然产品名叫中国路由优化,实际上电信基本用不来了的,丢包太猛),流媒体解锁基本完整,meta 送中了用不了;机器性能羸弱。

- BWH 好是好,但是 90 刀 / 月的售价未免有点太夸张了… 并非主流产品,你要是说的是那个 CMI 樱花盒子就拉倒吧

家宽机器

老牌 JP 家宽商家了,提供 Rakuten (乐天)/Biglobe/KDDI/sony 等多种家宽,包含独立 IPV4/NATIPV4 / 独立 IPV6-only 等多种产品,各种产品常年缺货,工单 /tg 响应都非常快,比较特色的是这个商家是有 SLA99 保证的,不达标会免除费用 (低于 99% 免除 50%,低于 95% 免除 100%),少数的家宽机器提供稳定性保障的商家,独立 ip 的家宽质量非常不错,但是共享 NAT 质量有点一眼难尽了,大部分都有送中的现象导致 google 系使用不了,总体而言还是非常不错的商家。

缺点:NAT 机器送中严重

常见产品线:

- 日本 A 区独立 IPV6 + 共享 NAT:1C0.5G 7GB 1T (双向)/ 月 9.99 刀 / 月

- 日本乐天独享:2C4G 30GB 20T (单向)/ 月 99 刀 / 月

也是老牌 JP 家宽商家了,提供 UCOM/NURO/Rakuten/KDDI/So-net/ 甚至还有星链等多种家宽,部分产品自带 DNS 解锁分流防止送中,产品整体价格较高,ip 质量优秀,机器性能中规中矩。你能接受价格的话,这家是个不错的选择。注:这家可以全额退款 (只要你对服务不完全满意,但不一定成功)。

常见产品线:

- NURO M Package:2C4G 20GB 10T (双向)/ 月 50 刀 / 月

- Starlink Shared Package:1C1G 10GB 1.5T (双向)/ 月 25 刀 / 月

港仔在 JP 地区的新产品线,主营 CPE 4G/5G 蜂窩網絡 Mobile 4G/5G 产品,包含 KDDI/NTT/Rakuten/SoftBank 等产品,ip 质量优秀,也是少数直接可以购买蜂窩網絡 VPS 的商家,相当不错,就是起步价格较高,面向高端用户了。

常见产品线:

- KDDI/au 5G Mobile VPS:2C2G 8GB 1T (双向)/ 月 98 刀 / 月

- Rakuten 5G Mobile VPS:2C2G 8GB 1T (双向)/ 月 98 刀 / 月

这个商家相对 oneman 一点,提供 Softbank/biglobe 的便宜量大 NAT 机器,还有樱花 / GMO 的机器代开,ss/vmess/socks5 屏蔽了国内方向,多次收到反馈说机器速度达不到标称,风评两极分化,应该是超售严重导致的,最好就不要当成直连机器了,本土内基本都跑不满,晚高峰波动严重,毕竟价格便宜,只能说是一分钱一分货了。还有,有几个大户也和我说它家独享机器速度不达标,让我怀疑到底是超售问题还是网络架构问题了… 这家机器正在测试,详细测评后补

缺点:稳定性一般,超售严重 + 速度不达标

常见产品线:

- 软银 SoftBank-nat 机:1C0.5G 3GB 1T (双向)/ 月 35r / 月

- Biglobe 家宽 nat:1C0.5G 5GB 2T (双向)/ 月 35r / 月

不主流但值得一看的产品

- AaiTR 的软银 NAT:30r / 月的 JP NAT 机器,超售相对不严重,因为要实名验证… 光看机器还是划得来的,就是这个实名有点搞…

- lala 的代开服务:有独享软银家宽产品和 GMO / 樱花 / Webarena 代开服务,就是服务费有点高,其家宽产品我没持有过,我对它家的印象只剩下它家常年通报的各种专线机器了

- tokyoonline:提供 sonet/KDDI 的家宽产品,对于小户而言价格较贵,对于大户而言就比较便宜,不过这家的 ip 长年累月的被大户蹬,现在已经不太行了

- zorocloud 的 GLBB 家宽:价格中档的 GLBB 家宽产品,也是少数几家提供 GLBB 家宽的服务商,ip 质量还行,这个是真家宽啊,不是伪家宽,测了下流媒体本土解锁不错,这个应该是所有家宽里独立 ip 最便宜的,但是延时偏高而且他家有多次被 MJJ 冲烂 IP 的前科导致 IP 不稳,所以放在这个板块里,

- AWS Wavelength:极少数人的选择,ip 池子是真干净,贵也是真贵,它是真的贵啊

落地机器

电信联通 IIJ + 移动软银线路的落地机器,直连情况下:电联晚高峰丢包严重,几乎不可用,移动相当快乐,低重传单线程能到 200~300Mbps,相互不错。这个机器的优秀之处在于国际互连,接入 IIJ + 软银 + NTT 等多线的组合相当炸裂,JP 落地互联的相当棒的选择;ip 质量出乎我意料的居然还不错,配合 DNS 解锁更好;机器性能中规中矩。

缺点:同段机场较多,沦为纯粹的流媒体解锁和国际互联机器,该跳盾还得跳盾 + 经常被 ddos 攻击导致不稳定

常见产品线:

- JP2-T1ION-Balance:1C0.5G 10GB 1TB (双) 29.9 刀 / 年

RFC 详细测评

SAKURA 上游,国际互连很不错啊,这款机器三网软银回程,JP 地区相当有性价比的回程,电信就爆炸了,但是联通移动基本快乐,联通可以跑 1000Mbps 上下对等,移动也有 300Mbps 上下对等这个机器,而且这个机器我持有很久了,相当不错啊,联通晚高峰多线程可以跑到 900Mbps,一个落地还送线路他真的我哭死,联通好机这就是;ip 质量不错,合格的落地机器;机器性能比较强劲,小型应用随便跑,CPU 不会成为瓶颈,可惜总体还是配置低,1c1g 掀不起大浪,能加到 2c4g 这就是建站神机啊。

缺点:同段机场较多,沦为纯粹的流媒体解锁和国际互联机器,该跳盾还得跳盾 + 经常被 ddos 攻击导致不稳定

常见产品线:

- Japan Standard - SMALL:1C1G 10GB 2TB (双) 3.99 刀 / 月

BageVM 详细测评

无优化线路,电信联通基本不可用,移动部分地区快乐,整体还是不可直连的机器,不建议直连使用,国际互连不错;ip 质量一般;机器性能中规中矩,大部分应用都足够使用。DMIT 有独特的超量限速不限量政策,如果流量较大的话性价比就比较高。

缺点:同段机场较多,沦为纯粹的流媒体解锁和国际互联机器,该跳盾还得跳盾

常见产品线:

- TYO.T1.WEE: 1C1G20G 1T (单向)/ 月 超量限速 50Mbps 36.9 刀 / 年

DMIT 详细测评

不主流但值得一看的产品

- Fxtransit 的大流量落地:ip 质量一搬,但是国际路由优化不错,它家的回国是个动态路由啊,有时候直有时候绕路,推荐当成纯落地用,虽然官方标注了超量限速不限量,实际上超量后基本达不到标称,如果你是看重超量后的带宽劝你慎重,不超量倒是速度倒是拉满

- yunyoo 的量大管饱 iij:10r/T 站起来蹬 (这家正在详测,测完后补其他信息)

- 想了一圈好像没啥别的特殊的落地了,backwave 的单线 GSL 国内又绕路没啥优势,Nube 的 1 刀 / 月起手 + 10r2T 流量还行,还有一批 wap/aki/alice 的便宜小拉机网路波动大,以后再慢慢补充吧

📌 转载信息

原作者:

STALK

转载时间:

2026/1/11 19:27:58

![一个多 AI 的圆桌会议项目 [V1.0]1](https://xiaohack.oss-cn-zhangjiakou.aliyuncs.com/typecho/images/2026/01/11/20260111192756_6963893cd0d63.png!mark)

![一个多 AI 的圆桌会议项目 [V1.0]2](https://xiaohack.oss-cn-zhangjiakou.aliyuncs.com/typecho/images/2026/01/11/20260111192759_6963893fcd3b5.png!mark)