大家好啊,我是甲木。

今天是 2026 年,年后复工第一天,先祝大家复工愉快(bushi

春节期间,好几个朋友问我同一个问题:「你不是搞 AI 的吗,我也想学学,从哪开始啊?」做老师的、做销售的、刚毕业的学生、创业十几年的老板,当然也包括后台经常私信我的粉丝朋友们。

背景完全不同,困惑高度一致,想用 AI 却不知从何入手。

一搜「AI 学习路线」,弹出来的东西直接劝退:线性代数、概率论与数理统计、机器学习、深度学习balabla一堆…直接从入门到放弃..

所以趁着复工第一天,我把这两年自己摸索的、观察到的、跟各路高手聊出来的经验,做一次彻底的梳理。给大家一份AI学习路线图。

先说清楚:这篇文章不是写给 AI 工程师的。 如果你是计算机科班出身,想去大厂做算法岗,传统路线图对你有用,按部就班学就好。但如果你是运营、老师、创业者、学生、自由职业者,不打算靠「造 AI」吃饭,但想把 AI「用好」,那这篇写给你。

简单说说这篇文章的构成:

全文分四个模块,按需跳读:

- Part1:方法论 摆正心态,掌握五个不会过时的学习心法

- Part2:入门篇 选工具、找场景、学会跟 AI 交互,从零上手

- Part3:进阶篇 底层逻辑、提示词进阶、Agent、Workflow、VibeCoding、信息源推荐

- Part4:洞察篇 一手信息源、资本风向、行业趋势、职业发展

公众号回复“学习清单”,获取AI学习资源包~

如果你已经在用 AI,日常有了自己的工具和习惯,可以直接跳到第三章「进阶篇」和第四章「洞察篇」,那里有更系统的方法和前沿资源信息。

如果你还没开始用 AI,或者只是偶尔试试,建议从头读起。第一章帮你建立正确心态,第二章手把手带你上手。

好,我们开始。

Part1:摆正心态、掌握心法

你不会被 AI 抛下

我知道很多小伙伴内心有一种隐隐的焦虑,FOMO心态。

朋友圈天天刷到「AI 取代 XX 职业」的标题,公司同事已经在用各种 AI 工具提效了,自己还停留在跟春晚用豆包、千问、元宝帮忙抢几个红包..这种感觉就像一列火车正在加速驶离站台,而你还在找站台入口。

但我想说,这种焦虑大可不必。

一项真正具有革命意义的技术,它的特点恰恰是,不会轻易甩下任何人。你想想电的普及。19 世纪末电灯泡刚发明的时候,普通人也不懂交流电直流电的区别,也不知道发电机的工作原理。但这妨碍你现在用电吗?你每天开灯、充手机、用电脑,从来不会停下来想「我得先搞懂电磁感应定律」。

AI 也一样。它正在变成像水和电一样的基础设施。未来你打开的每一个 App、用的每一个软件,底层都有 AI 在运转。你一直在用,但不会有明显的感知,就像你用电的时候不会去想电流是怎么从发电厂到你家插座的。

所以,随时上车都不晚。今天是 2026 年 2 月,现在开始完全来得及。说真的,AI 应用这件事一直在路上。

那问题来了:既然不需要焦虑,我应该把自己摆在什么位置?

我觉得有一个简单的三层模型可以参考:

- 底层——研发者:训练大模型的人,研究 Transformer 架构的人,OpenAI、DeepSeek 这些公司的核心算法团队。全球也就那么几万号人。

- 中间层——开发者:用大模型的 API 去搭建应用、做 Agent、写 Workflow 的人。程序员、产品经理、技术创业者居多。

- 应用层——使用者:用 AI 产品来解决自己工作和生活问题的人。绝大多数人在这一层。

绝大多数人的定位就是「应用者」,这就够了。

你不需要会训练模型,不需要会写代码,你只需要学会「跟 AI 协作」「让 AI 帮你做事」。就像你不需要会修车才能开车,不需要会做菜才能点外卖。

万维钢老师说过一句话,我印象特别深:

「我们永远不会在 AI 面前失去自我,我们不但应该,而且必须,而且可以,以'我'为主,人要比 AI 凶。」

什么意思呢?就是你别怕它、别仰视它。AI 很强,但做决策的永远是我们,是人。你得主动去驾驭它,而不是被它牵着走。

把心态摆正了,接下来聊方法。

五个学习心法:比任何工具教程都重要

工具会变,产品会迭代,今天的热门 App 明天可能就凉了,在 AI 时代尤其为甚。但方法论不会过时。这五个心法是我之前就在不同场合跟大家反复去讲,验证过的,你可以带着它们去学任何 AI 相关的东西。

心法一:动手为先

这条是我放在第一位的,因为它最重要,也最容易被忽略。

太多人的学习路径是这样的:先买本书→再报个课→看了三天视频→觉得「差不多了解了」→然后就没有然后了。

别这样。

你今天就可以打开 ChatGPT、豆包、Kimi、Claude,随便哪个都行,开始跟它聊。问它一个你工作中真实遇到的问题。让它帮你写一封邮件。让它帮你整理一份会议纪要。让它帮你翻译一篇英文报告。

就这么简单。别把它神秘化。

站在岸边永远学不会游泳。你得先跳下水,呛两口水,才知道手脚该怎么划。

刀哥之前给过一个特别实在的建议:他们公司实习生/应届生进来之后,拉一个群,推荐一款AI产品,用上一个月,之后再换其它,慢慢形成习惯。

ps. 其实你用着用着,很多原理性的东西反而自然就懂了。比「先学原理再动手」高效十倍。

心法二:场景驱动

动手是第一步,但别漫无目的地用。你得从自己的「真实需求」出发。

我见过太多人学 AI 的方式是:今天看到别人说 Midjourney 好,就去画两张图;明天看到 Suno 火了,就去生成一首歌;后天又跑去试 AI 编程。每样都浅尝辄止,最后什么都没留下。

正确的打开方式:想想你日常工作或生活中,有哪些事情是重复的、耗时的、让你头疼的。那就是你的切入场景。

- 你是学生?那你的场景可能是:论文文献整理、PPT 制作、学习笔记总结、英语写作润色。

- 你是职场人?那你的场景可能是:会议纪要、周报月报、数据分析报告、客户邮件。

- 你是内容创作者?那你的场景可能是:选题策划、文章大纲、配图生成、短视频脚本。

找到你的场景,然后针对性地去研究「AI 在这个场景下能怎么帮我」。这比泛泛地「学 AI」有效太多了。

心法三:溯源学习

这条是关于信息获取的。

现在讲 AI 的内容铺天盖地。公众号、小红书、抖音、B 站,到处都是「AI XX 教程」「十分钟学会 XX」。信息不是太少,是太多了。多到你根本分不清哪些靠谱、哪些是营销号在蹭流量。

我的原则是:尽量往信息的源头去找。

信息有一条明确的「食物链」:

官方文档 > 权威科技媒体的一手报道 > 大 V 的深度解析 > 营销号的转述

各大 AI 实验室的官方文档是源头,最准确、最全面,但不一定好读。权威科技媒体(国内的话机器之心、量子位等等,国外的话MIT Technology Review、The Verge、The Batch的原创报道等)基于一手素材做分析,会加入行业判断,信息失真很小。大 V 的深度解析是二次加工,质量取决于作者水平,好的大 V 能帮你消化复杂信息,差的可能带偏你。营销号的转述就不用说了,基本是三四手信息,能避则避。

举个例子。你想学豆包怎么用,最好的方式不是去小红书搜「豆包使用技巧」,而是先看豆包官方的使用指南和帮助文档更为系统化。

好友冷逸说过一段话,讲得特别到位:

「萃取、消化第一手知识,重视第二手知识,轻视甚至无视第三、第四手知识。」

信息经过每一次转手,都会失真一点。到了三手、四手,可能已经面目全非。养成溯源的习惯,你获取信息的质量会比大多数人高一个档次。

心法四:功利学习

这条可能听起来不那么「正确」,但我觉得特别实用。

学东西要功利一点。诺贝尔奖得主赫伯特·西蒙说过:「信息的丰富导致注意力的贫乏。」他本人就是 AI 领域的奠基人之一,同时也研究人类认知的局限性。他的结论是:人的认知资源是有限的,必须做取舍。

别因为焦虑就什么都想学。你的时间和精力是有限的,每学一样新东西都有成本。所以在决定「要不要学这个」之前,先问自己三个问题:

- 它能帮我省时间吗?

- 它能帮我赚钱(或者省钱)吗?

- 它能帮我做到之前做不到的事吗?

三个问题里如果至少有一个答案是「能」,那就值得投入精力去学。如果三个答案都是「好像不太能」或者「不确定」,那先放一放也没关系。

功利一点,学你现在用得上的。用不上的,知道有这么个东西就行了,等需要的时候再深入不迟。

心法五:输出与沉淀

前面四条都在讲「输入」。怎么开始、往哪用、去哪学、学什么。但光输入不输出,你的学习就像往一个没有底的杯子里倒水。

费曼说过一句话,大意是:如果你不能用简单的语言把一件事讲清楚,说明你还没真正理解它。

这条在 AI 学习上特别适用。你可能刷了几十篇教程、试了七八个工具、收藏了一堆「AI 神器」合集。但如果有人问你「AI 到底怎么帮到你了?」,你说不出个一二三来。

怎么破?两个字:输出。

试着把你学到的东西讲给别人听。跟同事分享一个你用 AI 提效的小技巧。在朋友圈发一条你用 AI 画的图。甚至只是在微信群里说一句「我今天发现 XX 这么用特别好」。

不用多正式。但说出来的那一刻,你会被迫把模糊的感觉整理成清晰的表达。哪里其实没想通,一讲就露馅了。这个过程本身就是最高效的学习,费曼学习法值得拥有。

而且它有一个额外的好处:你帮别人入了门,在朋友眼里你就成了「懂 AI 的那个人」。这种社交资产,是刷再多教程也换不来的。

输出之外,还有一件事同样重要:沉淀。

用到一个好的提示词?存下来。摸索出一个高效的工作流?记录下来。发现某个工具在某个场景下特别好用?标注一下。(或者前两者都可以直接沉淀为Skills方便下次复用..

这些东西单独看很小。但三个月后你打开自己的「AI 工具箱」,里面有二三十条经过验证的提示词、五六个跑通的工作流、十几个场景下的最佳实践。这时候你和那些每次都从零开始的人,差距就出来了。

AI 领域变化快,工具可能一两个月就换一茬。但你积累下来的「怎么跟 AI 协作」的经验不会作废。提示词会变,但你对「怎么把需求说清楚」的理解只会越来越深。工具会换,但你搭过的工作流逻辑可以直接迁移到新工具上。

这就是沉淀的复利效应。今天存下来的每一条经验,都在为未来的你省时间。

五个心法说完了:动手为先,场景驱动,溯源学习,功利学习,输出与沉淀。

当然还有一个就是:持续学习,这点不必多说了..

你可能注意到了,我一个具体的 AI 工具都还没教你用。别急,方法论是地基,地基不稳,上面盖什么都白搭。

地基打好了,接下来就该真正上手了。

第二章:上手就用(入门篇)

道理聊完了,该动手了。

很多人学 AI 的第一步就卡在「选哪个工具」上,打开手机应用商店一搜,几十个 AI 应用齐刷刷排在那儿,每个都说自己最强。然后就开始纠结,纠结着纠结着,一周过去了,啥也没用上。

没必要。

我的建议特别简单:随便选一个,先用起来。 用错了也没关系,又不要你签三年合同。AI 工具之间切换的成本几乎为零,你在这个上面打的字,换一个照样能打。但是你纠结的那一周,是真的浪费了。

好,那我还是帮你捋一捋,省得你连「随便选」都不知道从哪选。

2.1 先挑一个趁手的

这部分内容大家可以参考我之前写过的【2026年开年推荐的AI工具】,里面有详细的说明,

在这里简单说说,现在市面上的 AI 工具,大致可以分成这么几类:

对话类:你的日常首选

这类工具就是你跟 AI 聊天的入口。问问题、写东西、翻译、分析、头脑风暴……基本上你能想到的文字类需求,它们都能接住。

豆包、千问、Kimi、DeepSeek、ChatGPT、Claude、Gemini都可以考虑,各有各的特点。

创作类:按需选,按兴趣选

如果你对视觉创作感兴趣,AI 绘画AI视频都可以玩玩。即梦 AI 和可灵 AI 都是国内的,用着方便,效果也不错。即梦的Seedance2.0已经火爆国内外了。

AI 音乐呢,Suno 是目前最火的,你哼个旋律、写几句歌词,它就能给你生成一首完整的歌,第一次用的时候真的会有点上头。

搜索类:用过就回不去了

秘塔 AI 搜索,Kimi 的搜索模式都很好用,会帮你多轮检索、交叉验证,搜出来的内容很扎实。

用过 AI 搜索之后你会发现,传统搜索引擎那种「输入关键词 → 翻十页链接 → 自己拼凑答案」的模式,属实有点原始了。

海外工具:有条件的话值得体验

ChatGPT、Claude、Gemini,御三家,目前全球范围内综合能力最强的。

所以到底选哪个?

我的建议:先选 1 个对话类 + 1 个你感兴趣的创作类。就两个,够了。

对话类里面,豆包或者通义千问,二选一,装上就行。如果你经常需要处理长文档或者做深度搜索,再加一个 Kimi。创作类的,看你兴趣。喜欢画画就下个即梦,喜欢音乐就试试 Suno。

用上一个月,用熟了,你自然就知道自己还需要什么了。

2.2 从你自己的场景切入

工具选好了,下一个问题来了:用它干嘛?

「用它干嘛」这个问题,答案其实不在 AI 那边,在你这边。你是谁?你每天在干嘛?你有什么事情觉得烦、觉得重复、觉得耗时间?

从那里开始就对了。

如果你是学生

你可以让 AI 当你的「私人 AI 导师」。不是夸张,你想想,一个 24 小时在线、不会不耐烦、你问多少遍都不嫌烦的老师,以前得花多少钱请家教才能有这待遇?

看论文、读文献觉得头大?把 PDF 丢给 Kimi,让它帮你总结核心论点、梳理论文结构、提取关键数据。Kimi 的长文处理能力在这个场景下特别好用,几十页的论文它能一口气吃进去。

期末要做 PPT 和报告?用 AIPPT、Gamma、Dokie,给它一个主题,它能直接帮你生成一份带设计感的 PPT。当然你得自己改改内容、调调逻辑,但至少不用从一张白页开始了。

在大学这个最美好的时期,最纯真的爱情当然不能缺席。你可以让 AI 帮你写三行情诗、分析聊天记录里对方的态度(别笑,真的有用)、甚至帮你策划一个有创意的表白方案。AI 不能替你谈恋爱,但可以帮你成为一个更有趣的人。

如果你是职场人

开完会写纪要是不是很烦?千问、听悟,你开会的时候打开录音,它会自动帮你转文字、提取要点、生成会议纪要。我身边好多朋友用上之后都说回不去了。

周报月报这种东西,真的不值得你花一个小时去憋。把这周做了什么要点告诉 AI,让它帮你润色成一篇结构清晰、措辞得体的周报,五分钟搞定。你省下来的五十五分钟,用来干点真正有价值的事情不好吗?

数据分析也是。你把 Excel 表格丢给 AI,让它帮你找规律、做可视化、写分析报告,这在以前可能得专门找个数据分析师干的活儿。

如果你是创作者或自媒体人

AI 辅助写作是基本操作了。注意我说的是「辅助」,不是「替代」。让 AI 帮你列提纲、扩写段落、换个说法、找案例素材,这些都是很好的用法。但核心观点和个人风格得是你自己的,不然读者为什么要关注你而不是直接去问 AI 呢?

文章配图是个刚需。以前写公众号,找配图要么用免费图库(千篇一律),要么冒着版权风险从网上扒(别这么干),现在用 AI 画一张独一无二的配图,又好看又没版权问题。

日常生活

辅导孩子作业,你未必记得住初中数学公式,但 AI 记得。让它一步一步讲解解题思路,比你吼孩子有效多了。关键是它不会生气。

旅行规划,把你的时间、预算、偏好告诉 AI,让它帮你做攻略。比你在小红书上刷几十篇游记再自己拼凑行程效率高太多了。

说了这么多场景,我知道你可能看完有点懵。没关系,一张速查表帮你对号入座:

这个表不是标准答案,是起跑线。用着用着就会自然迭代出属于自己的工具组合。

2.3 学会跟 AI 沟通

工具有了,场景也有了,但你可能很快会遇到一个问题:怎么 AI 给我的回答这么「平庸」?

大概率不是 AI 的问题,是你「问的方式」的问题。

你跟 AI 说话的那段文字,有个专门的名字,叫「提示词」(Prompt)。说白了就是你输入给 AI 的指令。你给的指令越清晰、越具体,AI 回你的内容就越靠谱。

这跟你跟人沟通是一样的道理。你跟同事说「帮我整理一下那个东西」,对方大概率一脸问号。但你说「帮我把上周五会议的三个待办项整理成表格,列出负责人和截止日期」,对方立刻就能动手了。

AI 也是一样。就这么简单。

几个主要元素:背景、目标、要求、示例,归根结底就是要把上下文说清楚!

当然,关于 Prompt 是一门大的学问,大家可以关注下述内容再学习,这里就不展开了。

想更系统地学提示词?推荐几个资源:

- LangGPT 结构化提示词(

https://langgpt.ai/): 很实用的提示词写作框架 - 提示词工程指南(

https://www.promptingguide.ai/zh):中文提示词教程

多跟 AI 对话,用得多了,你自然就知道怎么「说话」它才听得懂。

当然这里需要注意,不要指望一次就得到完美答案,多追问,迭代几轮,效果会更好。

2.4 试试让 AI 帮你跑完全程

到这里,你已经会跟 AI 聊天了。提个需求,它给你回复,一问一答,很好。

但 AI 能做的不只是「你问我答」。

有些任务不是一个问题就能解决的?比如「帮我调研一下竞品,整理一份分析报告」。这个任务里包含搜索、筛选、对比、整理、排版好几个步骤。如果你一步步跟 AI 聊,也能做,但得来来回回好多轮。

有没有可能,你只说一句「帮我做竞品分析」,它就自己去搜、去查、去比较、去整理,最后给你一份完整的报告?

可以的,智能体(Agent)

最通俗的理解:普通 AI 对话是「你说一句它做一步」,智能体是「你交代一个任务,它自己规划步骤,帮你跑完全程」。就像你交代一个靠谱的助理「帮我订周五从北京到上海的差旅」,你不需要告诉他先查航班、再比价格、再订酒店、再填报销单,他自己就把这些全办了。

去哪儿能体验到?

最简单的方式:去逛逛智能体商店。扣子(Coze,字节做的 coze.cn)上面有大量别人做好的智能体,技能商店,各种功能都有。豆包 App 里也内置了不少智能体,打开就能聊。智谱的 GLMs 商店也类似。

一些很有意思的 AI Agent 产品也值得关注:

- Manus Agent(

manus.im): 全球首款通用型 AI Agent,你给它一个复杂任务,它会自己拆解成多个步骤去执行 - Lovart(

https://www.lovart.ai/):AI 设计平台,自动完成从概念到成品的设计流程 - OpenAI Operator(

operator.chatgpt.com):ChatGPT 内置的 Agent 模式,能帮你在网页上完成操作 - OpenClaw :开源 AI Agent,运行在你自己的设备上,通过 WhatsApp、Telegram、Slack、Signal 等聊天工具进行交互,能执行 shell 命令、浏览器自动化、邮件、日历和文件操作。

- Zapier Agents:支持用自然语言描述来创建 Agent,并可连接 8000+ 应用,非常适合跨工具自动化。

- Quizlet(

quizlet.com):AI 融入学习过程,根据你的掌握程度自动调整复习策略

代码领域的 Agent 已经相当成熟了。Claude Code、Cursor、Trae 这些工具,让你用自然语言就能写代码。这个话题展开比较深,放到后面进阶篇再聊。

你现在不需要每个都去试。知道有这么个东西就行,等你用熟了基础的 AI 对话之后,再慢慢探索 Agent 的世界。

2.5 给自己找个学习大本营

AI 这个领域变化太快了。真的是今天的新闻明天就过期的那种快。你需要一个「根据地」,能持续获取新信息、跟上节奏。

第一个要收藏的:通往AGI之路 - 飞书云文档(https://waytoagi.feishu.cn/)

WaytoAGI 知识库是目前互联网上我见过的最全面的 AI 开源知识库。从基础概念到进阶教程,从工具推荐到行业动态,分类清晰,持续更新。你如果只收藏一个网站,就收藏这个。

上面有各路 AI 英雄豪杰的最新的洞察,以及各种实操教程。

大家需要善于使用飞书的搜索功能,在上面搜索自己想要关注的内容,从而找到相关的文章。同时WaytoAGI还有免费的学习社群和免费的线下活动,非常推荐大家参与!

值得关注的博主和公众号

入门阶段,信息源不用多,但要靠谱。推荐几个我觉得质量一直在线的:量子位、机器之心、赛博禅心、歸藏的AI工具箱、数字生命卡兹克、Agent橘。这几个先关注上,日常刷刷就能保持基本的信息敏感度。更完整的推荐列表,我放在后面了。

LangGPT 知识库:feishu.langgpt.ai

里面有大量提示词模板和案例。当你想把提示词技巧再往前推一步的时候,去那里逛逛会很有收获。

好了,到这里「入门篇」差不多了。你现在已经有了工具、有了场景、有了基础的提示词技巧、知道了智能体是什么、还有了持续学习的信息源。

说实话,如果你只是想让 AI 在日常生活和工作中帮上忙,大部分人把这些用熟,效率提升就已经很明显了。

但我猜,你用了一段时间之后,一定会开始好奇更多的东西。为什么有时候 AI 说得特别好,有时候又会一本正经地胡说八道?我能不能自己搭一个智能体?能不能用 AI 写代码、做产品?

这些好奇心特别好。带着它们,我们接着往下聊。

第三章:从「会用」到「用得好」(进阶篇)

会用 AI 和用好 AI,中间隔着什么?

我觉得隔着一层「理解」。你不需要成为 AI 专家,但当你大概知道它怎么工作的、知道怎么更好地跟它协作、知道怎么把零散的用法串成体系,你会发现,同样一个工具,到了你手里,就是比别人顺。

这一章,我想和你聊五件事:AI 的底层逻辑、提示词的进阶玩法、工作流搭建、Vibe Coding,以及怎么建立你自己的 AI 信息网络。

不用怕。都是大白话。

3.1 搞懂 AI 的底层概念

很多人对 AI 有一种隐隐的不安:我天天在用它,但我完全不知道它是怎么运作的。

这种感觉很正常。你不需要去读论文、学数学,但花十分钟了解三个核心概念,会让你对 AI 的能力边界有一个更清晰的判断。知其所以然,你才知道什么时候该信它,什么时候该怀疑它。

Transformer:大语言模型的「发动机」

所有你用过的 ChatGPT、Claude、Kimi、豆包,底层都跑在同一个架构上,叫 Transformer。

一句话解释:它让 AI 学会了「注意力」——在一大段文字里,自动判断哪些词和哪些词之间关系更紧密。就像你读一篇长文章时,大脑会自动在关键信息之间建立连接,Transformer 做的事差不多,只不过它用的是数学。

想深入了解:李沐在 B 站讲的《Attention Is All You Need》论文精读https://www.bilibili.com/video/BV1pu411o7BE。原论文在这里https://arxiv.org/pdf/1706.03762.pdf。

Context Engineering:大模型时代的编程

AI 系统效果,很大程度取决于上下文设计。角色、任务规则、示例、知识与工具说明共同构成模型的工作环境。Agent、RAG、本地知识库,本质都是上下文工程。

生成模型三路线:自回归、扩散、潜空间

自回归:逐步预测下一个元素,语言模型与部分生图模型采用,结构稳定、可控性强。

扩散:从噪声逐步去噪生成图像,擅长写实与细节,Stable Diffusion、Midjourney 属此类。

潜空间(VAE/GAN):在低维表示中采样生成,是早期图像与语音生成基础。

Agent:从回答到执行

Agent 让 AI 能拆解目标、调用工具并完成任务。它依赖大模型推理与上下文工程,是系统形态升级。

理解这些,你就知道 AI 在做什么,也知道它何时可靠。

想系统学?这几门公开课够了

中文方面,李宏毅老师的课是我最推荐的,https://speech.ee.ntu.edu.tw/~hylee/GenAI-ML/2025-fall.php,当然他在 B 站有一些搬运的视频,讲底层原理讲得最透彻,而且幽默。李沐的「跟李沐学 AI」系列也非常好,他还有一套 D2L 动手学深度学习https://zh.d2l.ai,2025 版有 171 集。

英文方面,吴恩达的 [Deeplearning.ai] https://www.deeplearning.ai/courses 是经典中的经典。

但我要强调一点:这些不是必修课。你不学这些,照样能把 AI 用得很好。它们的定位是「知其所以然」,感兴趣就深入,不感兴趣,跳过这一节完全没问题。

3.2 从提示词到 Skills:让 AI 越用越顺手

入门篇里讲了提示词的基础用法:说清楚你要什么,给点背景信息,指定输出格式。

但用久了你会发现,光靠「说清楚」还不够。你开始想:有没有更系统的方法?有没有办法让我的提示词变成一种可以反复使用的东西?

有的。

提示词进阶:从「随手写」到「有结构」

如果你只学一个进阶技巧,我推荐「结构化提示词」。最典型的是 LangGPT 方法,它把一条提示词拆成几个模块:角色、背景、任务、要求、输出格式。

再往上走,有几个高级技巧值得了解:

多轮迭代优化:不要指望一次就得到完美答案。很多高手的秘诀不是提示词写得多精妙,而是他们特别会追问。

Meta-Prompting:让 AI 帮你写提示词。套娃,但有效。

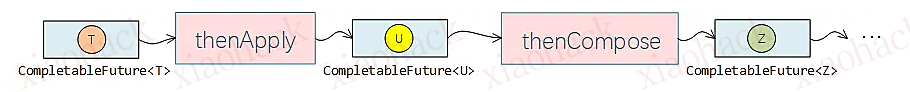

一条进化线索:Prompt → Context → Skills

大家其实会明显感觉到,圈子里的关键词换得越来越快。前几年大家讲 Prompt。后来大家讲 Context Engineering。再后来,Skills 变成了高频词。

这不是换个名字炒概念。背后有一条清晰的进化线索:

Prompt 时代,你给 AI 的是一次性的显式指令。每次对话都从零开始。

Context 时代,你开始「经营」一个信息场。不只是告诉 AI「做什么」,还把相关的背景、约束、知识一起喂给它。

Skills 时代,你把自己的经验和流程封装成一个「能力包」,让 AI 在需要的时候自动调用,稳定复用。

私以为不管是 Context 或是 Skills,都是 Prompt 的一部分,对于模型来说都是 Token。但从用户的角度看,这三者的区别在于:你和 AI 协作的颗粒度变了。从一句话,到一个场景,到一个可复用的能力单元。

Skills 到底是什么?

说得通俗一点:Skills 就是你把自己做某件事的经验和步骤,用自然语言写成一个「扩展包」,AI 在处理任务时会按需加载它。

门槛低,会写 Prompt 就会写 Skills。它比单条 Prompt 强在哪里?可复用、可分享、可迭代。

这个概念已经在国内落地了。字节的 Trae 有「技能」模块,扣子 2.0 也在往这个方向走。而且它是纯自然语言形式的,比搭积木式的 Workflow 更符合大多数人的习惯。

就这么简单。别把它神秘化。可以看之前发过的一篇文章【插入Skills文章链接】

推荐资源:

- [LangGPT 开源项目]

https://github.com/langgptai/LangGPT:结构化提示词框架 - [Prompt Engineering Guide]

https://www.promptingguide.ai/zh:最全的提示词工程中文指南 - [Anthropic 官方提示词指南]

https://www.anthropic.com/learn:写得很实在 - [GitHub - Awesome-claude-skills]

https://github.com/travisvn/awesome-claude-skills:一些很不错的ClaudeSkills

3.3 Agent & Workflow

提示词和 Skills 解决的是「单次对话怎么更好」的问题。但很快你会遇到另一个需求:我能不能把好几个步骤串起来,让 AI 自动跑完?

能。这就是 Workflow。

想象一条工厂流水线:原材料进去,经过切割、打磨、组装、质检,成品出来。Workflow 就是你给 AI 搭的一条流水线。你设定好每一步该做什么、数据怎么流转,触发之后它自动从头跑到尾。

比如:每天早上自动抓取行业新闻 → AI 总结成摘要 → 推送到你的飞书。整个过程不需要你动手,每天起床就能看到。

从哪里开始?

[扣子(Coze)] https://www.coze.cn是国内首选,拖拖拽拽就能搭。[n8n] https://n8n.io 是开源的,灵活度非常高,免费这一点也很香。Dify 更适合想做 AI 应用的人。

我的建议是:先从一个简单的场景入手。先做一个「每天自动给我推送行业新闻摘要」的小 Workflow,跑通了,你就有感觉了。

在企业的 AI 应用场景中,我们最看重的是其稳定性和确定性。

通过 Workflow 的形式,能够更好地确保 AI 运行的每个节点都不超出预期,让它完全按照我们的想法执行。

3.4 Vibe Coding:每个人都可以是创造者

接下来要聊的这个话题,我个人非常兴奋。

Collins 英语词典把「Vibe Coding」评为了 2025 年度词汇。不是什么 AI 术语、不是什么技术名词。一个关于写代码的概念,成了年度词汇。这本身就说明了一些事情。

什么是 Vibe Coding?

你不写代码。你用中文告诉 AI:「我想做一个番茄钟应用,要能设定工作时长和休息时长,界面简洁,用暖色调。」然后 AI 帮你把整个应用写出来。

就这样。你描述需求,它生成代码,你看效果,给反馈,它修改。来回几轮,一个能用的产品就出来了。

这件事最颠覆的地方在于:它模糊了「用户」和「开发者」的边界。

以前你想做一个小工具,你得学编程。学变量、学循环、学函数,怎么也得几周到几个月。现在呢?用自然语言描述你想要什么,几小时甚至几分钟,一个能跑的应用就出来了。

聊聊 Claude Code

在 Vibe Coding 工具里,我想重点聊聊 Claude Code。

Claude Code 是 Anthropic 推出的命令行 AI 编程工具。它不是一个编辑器插件,本质上是一个 Agent。你把它放到项目里,它能理解整个代码库的结构,自主规划该怎么做,然后一步步执行。

有一点技术门槛,你得会打开终端、敲命令行。如果你连终端是什么都不知道,可以先从 Cursor 或 Trae 这种有图形界面的工具开始。

但如果你有一点点基础,Claude Code 的体验是非常惊艳的。你可以跟它说「帮我把这个项目的登录功能改成支持手机号登录」,它会自己去读代码、理解架构、做修改、跑测试。

想入门的话:

- [官方中文文档]

https://code.claude.com/docs/zh-CN/overview - [awesome-claude-code]

https://github.com/hesreallyhim/awesome-claude-code(21.6k Stars) - B 站 [30 个进阶技巧]

https://www.bilibili.com/video/BV1XGbazvEuh/(12 万播放) - [刘小排 Claude Code 实战分享]

https://mp.weixin.qq.com/s/sOPO_MWq9xsiHzYapszK5Q:全球 Claude Code Token 消耗量「榜一大哥」的实操经验

Vibe Coding 工具全景

| 工具 | 公司 | 特点 | 费用 |

|---|

| Cursor | Anysphere | 最流行的 AI 编程编辑器 | $20/月 |

| Trae | 字节跳动 | 部分免费,全中文,600 万+用户 | 免费 & 收费 |

| CodeBuddy | 腾讯 | 完全免费,插件+IDE+CLI | 免费 & 收费 |

| Windsurf | Cognition | 自有模型速度是 Sonnet 的 13 倍 | 有免费额度 |

| GPT Codex | OpenAI | 可独立工作超 7 小时 | $20/月起 |

如果你在国内,入门推荐 Trae 和 CodeBuddy,免费额度、中文好、不用折腾网络。

普通人用 Vibe Coding 做了什么?

这部分是我最想写的,因为每一个案例都在打破「编程是程序员的事」这个旧观念。

CNBC 有个记者,完全没有技术背景,参加了一个 2 天的 Vibe Coding 训练营,出来的时候手里拿着一个完整的 App。两天。一个记者。

菲律宾有个叫 Pablo 的白领,直到成年才开始用电脑。他花了 2 小时,做出了一个费用管理 App。

一个做营销的女生 Maddy Osman,只有最基础的编码知识,用 Vibe Coding 独立做出了好几个产品。

创造的门槛正在被拉平。你脑子里那些「要是有这么一个工具就好了」的念头,现在真的有可能自己动手实现。

目前全球约 41% 的代码由 AI 生成。Lovable(一个 Vibe Coding 平台)上线 8 个月就达到了 1 亿美元的年化收入。

这,是一场正在发生的变革。

3.5 你的第一个「数字员工」:OpenClaw

前面聊了 Vibe Coding,你可以用自然语言造产品。接下来说说:用自然语言雇一个 24 小时在线的数字员工。

2026 年初,AI 圈有一个项目彻底出圈了,叫 OpenClaw(openclaw.bot)。GitHub Stars 飙到了 22 万+,各家云厂商争相接入,可以说是今年 Agent 领域最值得关注的现象级项目。

OpenClaw 是什么?

一句话说:它是一个开源的 AI Agent,运行在你自己的电脑或云服务器上,能通过 Discord、Telegram、飞书、WhatsApp 等聊天工具跟你交互。你在手机上发一条消息,它就在服务器上帮你干活。

跟前面 2.4 提到的那些 Agent 产品不同,OpenClaw 更像是一个你「自己养」的 AI 助手。它跑在你自己的环境里,能读文件、执行命令、浏览网页、操作各种工具,而且 7×24 小时在线。

如果说前面聊的那些 Agent 产品是"别人家的员工帮你跑腿",OpenClaw 更像是"你自己雇了一个实习生,住在你办公室里,随叫随到"。

它的灵魂在于 Skills

OpenClaw 最核心的设计是 Skills 生态。你给它装什么技能,它就能干什么活。这跟我们前面 3.2 聊的 Skills 概念一脉相承,只不过在 OpenClaw 里,Skills 变成了 Agent 的「能力包」,装上就能用。

比如你给它装上搜索 Skill,它就能帮你每天定时抓取行业新闻,整理成摘要推送给你。装上代码执行 Skill,它就能帮你写网页、跑脚本。装上金融数据 Skill,它甚至能帮你监控行情,有重大波动立刻通知你。

而且 Skills 是纯自然语言写的,会写提示词就会写 Skills。社区里已经有大量现成的 Skill 库可以直接用:

- [ClawHub Skills]

https://www.clawhub.ai/skills:官方精选 Skill 市场 - [awesome-openclaw-skills]

https://github.com/VoltAgent/awesome-openclaw-skills:社区整理的精选合集

能用它做什么?

举几个我自己跑通的场景:

- 自动新闻监控:设好关键词和信息源,它每隔一段时间自动帮你抓取、筛选、总结,推送到你的聊天工具里。起床就能看到。

- 自然语言建站:手机上发一句「帮我做个番茄闹钟的网页,要有不错的交互」,它直接在服务器上写代码、部署上线,几分钟后甩给你一个链接。

- 文件处理助手:丢给它一个 PDF 或表格,让它分析、提取、转换格式,全程不用开电脑。

- 定时任务执行:每天早上八点自动执行某个流程,周报自动生成,数据自动备份……设一次,跑很久。

为什么说它代表了一个重要趋势?

OpenClaw 最有意思的一个设计叫 Gateway——它在 Agent 和各种通讯工具之间搭了一座桥。这意味着你不需要打开电脑、不需要登录某个网站,直接在微信、飞书、Discord 这些你每天都在用的工具里,就能跟 Agent 对话,让它帮你干活。

这件事的意义在于:Agent 第一次真正融入了你的日常通讯流。它不再是一个你需要专门去访问的工具,而是像一个同事一样,住在你的群聊里,随时待命。

更深一层,OpenClaw 的 Skills 还能自举——Agent 可以在执行任务的过程中,自己发现可复用的经验,自己封装成新的 Skill,自己装上。也就是说,它会越用越好用,这跟我们前面心法五讲的「沉淀复利」是同一个道理,只不过这次沉淀经验的不是你,是 Agent 自己。

怎么开始?

【插入之前OpenClaw Kimi的文章】

- [OpenClaw 官网]

https://openclaw.ai/ - [GitHub 仓库]

https://github.com/openclaw/openclaw

一句话总结:OpenClaw 把"AI 会聊天"这件事,推进到了"AI 能干活"。 如果说 2025 年的关键词是 Vibe Coding,那 2026 年你一定会反复听到的词,就是 Agent。

而 OpenClaw,是目前这个方向上最值得体验的项目之一。

3.6 建好你的「雷达系统」:AI 信息网络

AI 领域变化太快了。你不可能靠一次性学习就一劳永逸。

你需要的不是「学完」,而是建立一个持续获取信息的网络。

下面这些是我个人关注多年、反复筛选后留下来的信源,很多都是线下的好朋友。

因为我看公众号比较多,所以大多数都是以微信生态为主的..小红书、B站了解的朋友可以评论区见!

中文博主推荐(几大分类)

① AI General

量子位、机器之心、数字生命卡兹克、赛博禅心、Agent 橘子、特工宇宙、卡尔的AI沃茨、沃垠 AI、夕小瑶科技说、张咋啦。这几个覆盖了 AI 领域大部分重要动态,选 1-2 个固定关注就够了。

② AI Prompt & Agent

宝玉AI、李继刚、云中江树、向阳乔木、一泽、云舒的AI实践日记、甲木等。还有一个必须提的是「归藏的 AI 工具箱」,信息密度极高。

③ AI Design

汗青、海辛和阿文、阿真Irene、TATALAB等,对非设计师也很有启发。

④ AI Tech

苍何、袋鼠帝、刘聪 NLP、花叔、饼干哥哥。技术含量高,但不至于看不懂。

⑤ AI Product

AI 产品阿颖、洛小山、AI 产品银海、AI产品黄叔等。

⑥ AI Tutorial

Rico 有三猫、栗噔噔、摸鱼小李、AIGC新知等,风格轻松,跟着做就能出活。

💡 关于 Claude Code 和 Vibe Coding,特别推荐看刘小排的分享

海外信息源

X(Twitter)是最快的,OpenAI、Anthropic 的重要发布基本都先在 X 上出来。YouTube 上 Lex Fridman 的深度访谈质量很高https://www.youtube.com/@lexfridman。The Information 和 TechCrunch 是产业分析的标配。

X的推荐博主,在第四章给大家列出来

「可是我英文不好怎么办?」装一个「沉浸式翻译」浏览器插件,英文网页秒变双语对照,语言不再是信息壁垒。

播客推荐

英文:Lex Fridman、20VC。中文:Founder Park、十字路口 Crossing。

最后一点:不要试图关注所有信源。

信息过载和信息匮乏一样有害。固定 1-2 个每天看的,1-2 个每周看的,其余放收藏夹,有需要的时候再翻。用 AI 帮你做信息筛选和摘要,不要跟信息流拼体力。

到这里,你已经有了一张比较完整的能力地图。但你可能已经开始想一个更深的问题了:AI 这么猛,它到底会走向哪里?钱在往哪流?我该怎么提前站位?

这些问题,我们下一章聊。

第四章:看得远——源头信息与前沿洞察(洞察篇)

前面三章,我们聊的是怎么把 AI 用起来、用好、用出花来。

但你有没有想过一个问题:你用的这些工具,半年后还在不在?你学的这些技巧,一年后还管不管用?

AI 这个领域变化太快了。你今天觉得很厉害的功能,三个月后可能变成免费标配。你今天花大力气学的某个平台,半年后可能已经被收购或者关停了。

所以光会「用」还不够。你得学会「看」。

看懂 AI 正在往哪走,你才能提前站到对的位置上。

4.1 别喝二手水:去源头获取一手信息

我有一个习惯,看到任何 AI 相关的新闻,我都会去找原始出处。

不是因为我不信媒体,而是这个领域的信息衰减太严重了。一篇论文发出来,经过英文科技媒体报道、国内媒体翻译、自媒体二次加工、短视频三次加工……到你手里的时候,可能已经面目全非。

跟对人:AI 领域值得关注的头脑

第一类是技术大佬,他们的观点值得深度消化。

图灵奖三巨头:Yoshua Bengio、Geoffrey Hinton、Yann LeCun。有意思的是,Hinton 现在是「AI 末日派」,LeCun 是坚定的「AI 乐观派」,Bengio 在中间偏谨慎。三个人经常互相怼。看他们争论,比看任何分析文章都有营养。

李飞飞和吴恩达。李飞飞对 AI 与人文的交叉思考非常有深度。吴恩达是 AI 教育界的传奇,而且他一直在一线做项目,不是那种脱离实践的学者。

Ilya Sutskever,OpenAI 的联合创始人。这个人很少公开发言,但每次说话都值得反复品味。

国内这边,梁文锋,DeepSeek 背后的人。他很少接受采访,但 DeepSeek 的技术路线本身就是他最好的表达。

第二类是商业领袖,他们的观点要带「滤镜」看。

Sam Altman、马斯克、黄仁勋、扎克伯格、李彦宏……这些名字你肯定不陌生。

但冷逸有个观点我很认同:「他们的采访都是有商业目的的,要么提高公司估值,要么寻找投资人,以及迷惑竞争对手。」

所以听他们说什么,更要看他们做什么。把钱投到哪里,比嘴上说什么诚实得多。

获取渠道推荐:

- X(原 Twitter):AI 领域最重要的信息广场,没有之一

- Lex Fridman 播客:长对话,动不动三四个小时,但深度是真的深度

- 20VC:偏投资和商业视角

官方科研博客

海外:Anthropic Research(写得最好https://www.anthropic.com/research)、OpenAI Newshttps://openai.com/news、Google DeepMindhttps://deepmind.google/research/publications、Meta AI Bloghttps://ai.meta.com/blog。

国内:Qwen 博客(通义千问团队https://qwenlm.github.io/blog/)、Seed(字节跳动https://seed.bytedance.com)、腾讯混元、Kimi/智谱/DeepSeek 的公众号。

养成习惯,每周花 20 分钟扫一遍这些源。不需要每篇都精读,扫标题就行。

还有 Reddit,国外版小红书。很多越狱提示词、时髦玩法都来自这里

https://www.reddit.com/

论文没你想的那么可怕

你不需要看懂每一个公式。你只需要知道:这篇论文在解决什么问题?效果怎么样?对我有什么影响?

而且现在有 AI 帮你。Kimi 学术搜索可以帮你快速理解一篇论文的核心内容。BabelDOC 可以把整篇论文翻译成排版精美的中文版。

如果你只读三篇论文:

- 《Attention Is All You Need》:Transformer 的开山之作,改变了整个 AI 的发展轨迹

- 斯坦福小镇(Generative Agents):让 25 个 AI 角色在虚拟小镇里自主生活

- ReAct:推理和行动结合,当前 AI Agent 框架的理论基础

4.2 想深入?这些课和书值得花时间

好消息是,全世界最顶级的 AI 课程,绝大多数都是免费的。不是打折,是真的免费。

| 课程 | 来自 | 一句话描述 | 费用 |

|---|

| Stanford CS336 | 斯坦福 | 带你从零构建一个语言模型 | 免费材料 |

| Berkeley CS294 | UC Berkeley | 高阶 LLM Agent 课程 | 免费材料 |

| DeepLearning.AI 短课 | DeepLearning.AI | 每门 1-2 小时的主题短课 | 免费 |

| Hugging Face 全家桶 | Hugging Face | 6 门课覆盖 NLP 到多模态 | 免费 |

| LangChain Academy | LangChain | 专注 Agent 开发 | 基础免费 |

| fast.ai | fast.ai | 代码优先的实践派 | 免费 |

如果你完全没有编程基础,从 DeepLearning.AI 的短课开始。如果你有一点编程基础,fast.ai 非常适合。如果你是在校学生想往 AI 方向走,Stanford CS336 和 Berkeley CS294 是天花板级别。

书单:这几本值得放在手边

- 《深度学习》 Ian Goodfellow 著。圈内人叫它「AI 圣经」。不需要从头读到尾,当工具书翻就行。

- 科普类:《这就是ChatGPT》《深度学习革命》《AI未来进行式》都挺不错

- 哲思应用类:《拐点》《人比AI凶》——万维钢《关于说话的一切》——写Prompt有帮助

- 轻度技术类:《GPT图解》《智能体设计指南》《动手做AI Agent》

- 技术进阶类:《RAG实战课》《这就是MCP》等

- llya推荐的30个阅读清单

https://arc.net/folder/D0472A20-9C20-4D3F-B145-D2865C0A9FEE

还有两本免费电子书特别推荐:黄叔的《AI 编程蓝皮书》2.0,以及姚金刚和向阳乔木的《GEO 白皮书》(21 万字)。

4.3 钱往哪里流,行业就往哪里走

这个小节,我想跟你聊点不一样的。不聊技术,聊钱。

因为资本的流向,是预判未来最诚实的信号。投资人可以在采访里说漂亮话,但他们不会拿真金白银开玩笑。

值得追踪的 AI 投资风向标

- 红杉资本(美国红杉 Sequoia Capital):

sequoiacap.com - a16z:a16z.com,每年发布的《State of AI》报告是行业必读

- Y Combinator:

ycombinator.com,每期批次里 AI 项目的比例就是行业温度计 - 奇绩创坛:

miracleplus.com,陆奇创办的,可以理解为「中国版 YC」

2026 年初,我们站在哪里?

先看钱的规模。2025 年,全球 AI 领域的私人融资总额达到了 2258 亿美元。科技四巨头 2026 年计划的资本支出合计达到 6350 到 6650 亿美元,其中大部分用于 AI 基础设施建设。六千多亿美元砸下去建数据中心和买 GPU,这种级别的投入,在人类商业史上也是罕见的。

再看企业采用。McKinsey 2025 年的报告显示,88% 的组织已经在使用 AI。但其中只有 6% 真正从 AI 中获得了显著商业价值。大多数公司还处于「用了,但没用好」的阶段。这恰恰是巨大的机会。谁能帮企业把 AI 从「用了」变成「用好」,谁就能吃到最大的红利。

Agent 方向全面爆发。2025 年 AI Agent 市场规模 78.4 亿美元,预计 2030 年达到 526 亿美元。YC 最近几期的批次里超过 80% 的项目跟 AI 相关,Agent 是最热的方向。Gartner 预测 2026 年 40% 的企业应用会嵌入 Agent。

垂直行业的渗透速度也让我很惊讶。医疗领域,医生使用 AI 的比例从 38% 飙升到 66%。法律行业,律所 AI 采用率从 19% 涨到 79%。金融领域,银行的生成式 AI 采用率从 8% 蹿到 78%。如果你在这些行业里,AI 能力已经不是加分项了,它是基本功。

国内外的差异也值得关注。目前美国占全球 AI 投资的 79%。海外侧重基础模型研发和开发者生态,国内侧重应用落地和场景创新。简单说:海外在造「发动机」,国内在造「车」。

几份报告值得收藏

- 红杉资本《AI in 2026》 (

https://sequoiacap.com/article/ai-in-2026-the-tale-of-two-ais/) - a16z《State of AI》 (

https://a16z.com/state-of-ai/) - Stanford HAI《AI Index 2025》(

https://hai.stanford.edu/assets/files/hai_ai_index_report_2025.pdf)(400+页) - McKinsey《The State of AI》(

https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai) - Anthropic《2026 Agentic Coding Trends Report》(

https://resources.anthropic.com/2026-agentic-coding-trends-report)

对普通人意味着什么?

选什么技能?看资本在追什么。Agent 开发、AI 应用集成、提示工程,这些方向在未来两三年确定性很高。

进什么行业?看 AI 在哪些垂直领域渗透最快。医疗、法律、金融、教育,这些行业的 AI 改造才刚刚开始。

做什么产品?看 YC 和奇绩创坛每期在孵化什么。它们的项目列表就是一份「未来热门方向预告片」。

4.4 职业发展:用作品说话

聊完了大趋势,回到一个很现实的问题:这些东西怎么变成我的职业竞争力?

我的建议只有四个字:用作品说话。

在 AI 领域,没人在乎你的简历上写了什么。他们在乎的是:你做了什么?

在 Coze 上打造一个爆款智能体,用户量破万。在 GitHub 上开源一个 AI 项目,拿到几百个 Star。在 ProductHunt 上发布一个 AI 小工具,被社区推荐到首页。这些事情,每一件都比任何证书有说服力。

说到证书,说句实话:目前市面上还没有一张 AI 证书是被行业真正认可的。了解一下可以,但不要把主要精力放在考证上。

与其花时间考证,不如花时间在这几个平台上建立存在感:

- X:关注行业动态,参与讨论,分享你的思考

- GitHub:你的代码作品集

- HuggingFace:AI 领域的「GitHub」,分享模型和数据集

- ProductHunt:发布你的 AI 产品,获取真实用户反馈

- 飞书:国内很多 AI 社群在飞书上,信息密度高

在一个快速变化的领域里,你的学习能力和实际产出,永远比一纸证书更有价值。

结语

写到这里,一万多字了。

如果你从头读到这儿,辛苦了。如果你是跳着读的,也完全没问题,这本来就是给不同阶段的人准备的。

你不需要从线性代数开始。你不需要学会写代码。你不需要读完所有论文。你只需要打开一个 AI 工具,开始跟它对话。

我一直觉得四个阶段:了解 AI,走进 AI,驾驭 AI,「超越 AI」。

超越不是说你比 AI 厉害。而是你知道怎么跟它协作,让 1+1 大于 2。你知道什么时候该依赖它,什么时候该相信自己。你能用它放大你的优势,而不是被它取代。

万维钢说过:「我们永远不会在 AI 面前失去自我,我们不但应该,而且必须,而且可以,以'我'为主。」

是的,以「我」为主。

AI 是工具,是伙伴,是放大器。但掌舵的那个人,始终是你自己。

人要比 AI 凶。

知易行难,从 0 到 1 最难。但开始了,路就清晰了。

如果你今天只做一件事,我的建议是:打开一个 AI 工具,跟它聊 10 分钟。随便聊什么都行。

不要等到「准备好了」再开始。没有人准备好了才开始的。都是开始了,才慢慢准备好的。

说不定下一个惊艳世界的点子,就来自你此时此刻的好奇心。

以上。

我是甲木,热衷于分享一些AI干货内容,同时也会分享AI在各行业的落地应用,我们下期再见👋🏻

参考文章与资源

行业报告

参考文章

本文由mdnice多平台发布