MetaForm 低代码引擎系列 · 第 1 篇

技术栈:PostgreSQL (JSONB) + Python FastAPI + Vue.js

一、痛点引入:无限建表的 DDL 灾难

在传统的软件开发模式中,我们的潜意识里有一条不可动摇的黄金定律:一个业务对象,就必然对应数据库里的一张物理表。

比如我们要开发一个问卷系统,很自然地会建立 Survey(问卷表)、Question(题目表)、Response(答卷表)。表里定义好具体的列:title 是 VARCHAR,score 是 INT,created_at 是 TIMESTAMP。各司其职,结构清晰。

但是,现代企业级 SaaS(比如低代码平台、灵活的 CRM 系统)面临的核心挑战是:极端的个性化诉求规模化。

设想一下,你的平台服务了成百上千个企业客户(租户):

- A 企业希望在问卷里加一个"所属行业"字段;

- B 企业希望加一个"紧急程度"字段;

- C 企业甚至想完全新建一个叫"问卷回访跟进"的新业务模块。

如果坚持"一对象一表"的传统架构,灾难接踵而至:

- DDL 风暴 (Data Definition Language Storm):上百个租户各自在界面上点击"添加字段"时,后台就要向数据库发送大量

ALTER TABLE ADD COLUMN 语句。DDL 操作会锁表(Metadata Lock),在高并发的生产数据库中等同于自杀。 - 运维的无底洞:如果为每个租户单独建表,1 万租户 × 50 张表 = 50 万张表。数据字典极度膨胀,备份、升级、统一修改都变得困难。

- 隔离性极其脆弱:多租户环境下 Schema 完全不同,一套代码体系很难处理所有边缘情况,最后陷入

if-else 的泥潭。

面对这些困难,业界诞生了一个近乎"离经叛道"的核心选择:彻底放弃让应用层直接操作数据库 Schema。

数据库退化为纯粹的数据仓库,它不关心也不知道具体的业务模型长什么样。至于"系统里有哪些表、表里有哪些字段"这种工作,被"上架"到了应用层来管理。

这就是元数据驱动架构(Metadata-Driven Architecture)的起点。

二、核心理念:通用数据字典 (UDD)

元数据 (Metadata),简单来说就是"描述数据的数据"。

如果说普通的业务数据记录的是"张三考了 95 分",那么元数据记录的就是"系统里有一个叫『问卷』的表,它有一列叫『分数』"。

管理这些元数据的系统,我们称之为 通用数据字典 (Universal Data Dictionary, UDD)。

核心思想是:既然底层数据库不让自由建表了,那就拿两张固定的表当"户口本",把用户想要的表结构"登记"在册。

meta_forms(登记"有什么表")

当你在低代码后台点击"新建表单"并命名为"问卷调查"时,底层不会执行 CREATE TABLE。系统只是在 meta_forms 中插入一行记录。

meta_fields(登记"表里有什么列")

每当你在页面上拖拽生成一个"问卷标题"的输入框,系统就在 meta_fields 表里加上一行。

理解关键点:在这个体系里,修改系统结构不再是高危的数据库操作(DDL),而变成了最简单的增删改查(CRUD)。

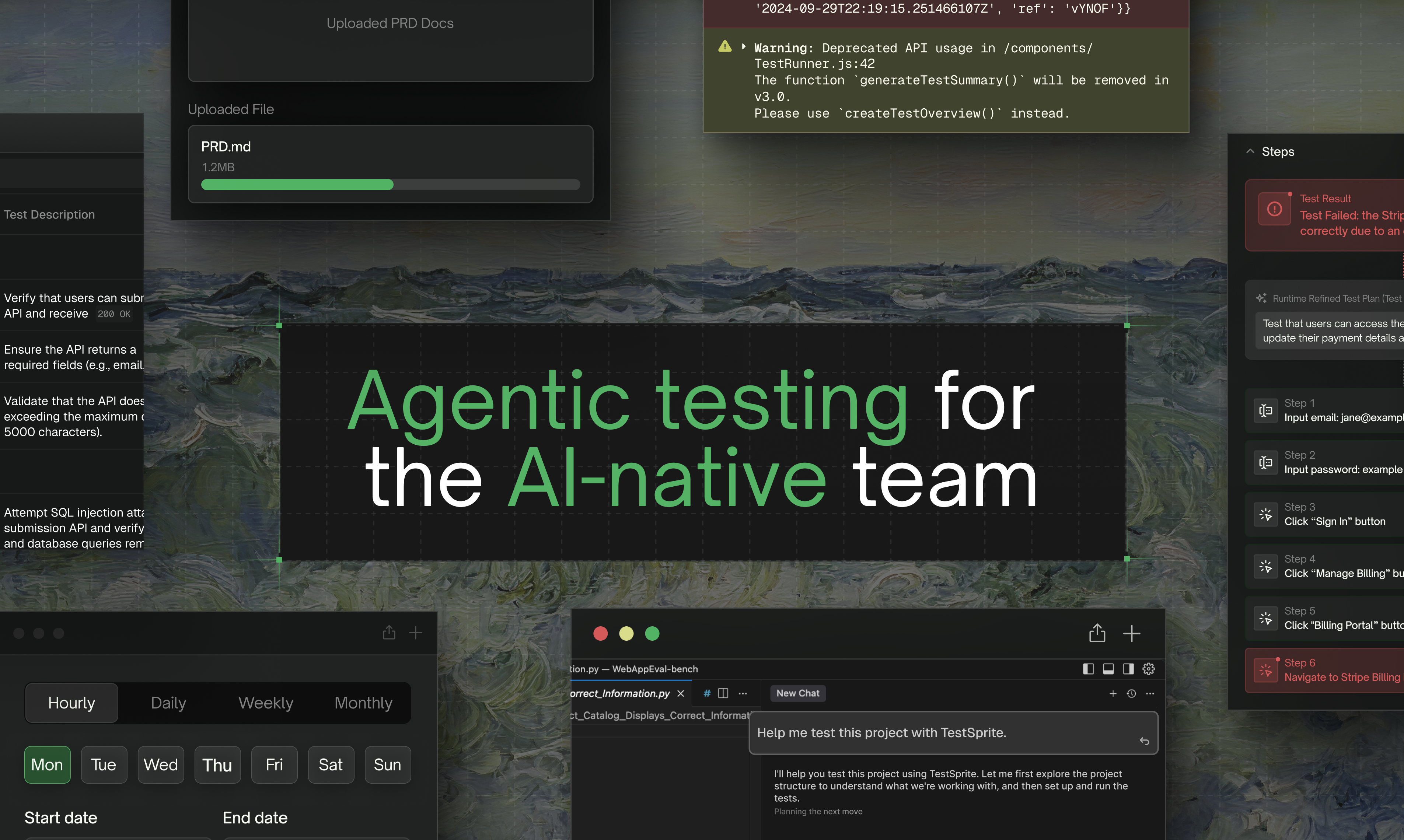

三、架构对比图解

传统架构中,每个业务对象(User、Order、Survey)都有自己独立的物理表,每次结构变更都需要 ALTER TABLE。而在 MetaForm 的元数据架构中,只有两张配置表 meta_forms 和 meta_fields 负责定义结构,所有业务数据统一落入 data_heap 的 JSONB payload 字段中。

四、技术抉择:为什么是 PGSQL + JSONB

结构定义好了,实际的业务数据存哪里?

Salesforce 早期使用了 弹性宽表 (Flex Table) 方案:建一张超级大的宽表,包含 Value0 到 Value500 共 500 个 VARCHAR(255) 列。元数据字典记录某个字段存入了哪个具体的 Slot(例如"手机号"存入 Value3)。

虽然实现了 Schema-Free,但痛点极多:

- 所有数据都被强制转为字符串,数值排序、日期过滤极度痛苦

- 空槽位造成巨大的存储浪费

- 需要维护复杂的 Slot Mapping 逻辑

在现代技术栈下,我们选择 PostgreSQL + JSONB 作为底层底座。这是一种降维打击:

CREATE TABLE data_heap (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

org_id VARCHAR(64) NOT NULL, -- 租户隔离

form_id VARCHAR(64) NOT NULL, -- 关联 meta_forms(⚠️ 绝对的隔离条件)

payload JSONB NOT NULL, -- 核心:所有业务数据打包在此

created_at TIMESTAMP DEFAULT CURRENT_TIMESTAMP

);

-- GIN 索引:加速 JSONB 内部的键值检索

CREATE INDEX idx_data_heap_payload ON data_heap USING GIN (payload jsonb_path_ops);

架构师提示(关于数据隔离的底线):由于所有的表单数据都在 data_heap 这个“大通铺”里,哪怕在单租户架构下,查询时 WHERE form_id = 'xxx' 也是绝对不可或缺的隔离条件。这就如同给数据分区,必须在后端底层DAO层强行统一带上 form_id,防止业务数据产生灾难级的越界。

### JSONB 的核心优势与 Key 映射规则

1. **天然 Schema-Free**:无论前端提交多少动态字段,直接打包成 JSON 塞进 `payload` 字段,彻底免除了维护 Slot Mapping 的痛苦。

* ** 架构提示(关于 Key 的映射)**:在设计 `meta_fields` 时,强烈建议区分**显示名 (Label)** 和 **内部标识名 (DeveloperName / API Name, 如 `age__c`)**。JSONB 内部的 Key **必须**使用不可变的 `field_api_name`,而不是可能会被业务人员随时修改的中文显示名,以此保证底层物理数据的稳定性。

2. **极速数据定位**:通过 PGSQL 的 JSONB 操作符(如 `->>`、`#>>`),可以轻松查询深层结构:

```sql

SELECT payload->>'phone_number' FROM data_heap WHERE form_id = 'frm_1001';

- GIN 索引加速:只需为

payload 建立一个 GIN 倒排索引,就能自动加速所有基于 JSON Key/Value 的检索,碾压传统的逐列 B-Tree 索引。

JSONB 存储映射透视

上方 meta_fields 定义了字段名(如 Age、Name)和类型,下方 data_heap 的 payload 列中,这些字段名直接作为 JSON 的 Key 存储。元数据定义了 JSON 内部的结构。

五、 API 设计

了解了物理底座后,来看后端的 API 接口。整个平台只需要几个元数据管理接口:

from fastapi import APIRouter, Depends, HTTPException

from sqlalchemy.orm import Session

from pydantic import BaseModel

from typing import List

import uuid

router = APIRouter(prefix="/api/meta")

class FieldCreate(BaseModel):

field_name: str

field_type: str # 'string', 'number', 'boolean', 'date'

is_required: bool = False

class FormCreate(BaseModel):

name: str

description: str = ""

fields: List[FieldCreate]

@router.post("/forms")

def create_dynamic_form(body: FormCreate, db: Session = Depends(get_db)):

"""

新建动态表单:操作元数据字典,而非 DDL 建表。

"""

form_id = f"frm_{uuid.uuid4().hex[:8]}"

# 1. 在 meta_forms 中登记"虚拟表"

db.execute(

"INSERT INTO meta_forms (form_id, name, description) VALUES (:fid, :name, :desc)",

{"fid": form_id, "name": body.name, "desc": body.description}

)

# 2. 批量登记字段定义到 meta_fields

for field in body.fields:

db.execute(

"""INSERT INTO meta_fields (field_id, form_id, field_name, field_type, is_required)

VALUES (:fld_id, :fid, :fname, :ftype, :req)""",

{

"fld_id": f"fld_{uuid.uuid4().hex[:8]}",

"fid": form_id,

"fname": field.field_name,

"ftype": field.field_type,

"req": field.is_required,

}

)

db.commit()

return {"status": "success", "form_id": form_id}

@router.get("/forms/{form_id}")

def get_form_meta(form_id: str, db: Session = Depends(get_db)):

"""

获取表单的完整元数据蓝图,前端据此渲染 UI。

"""

form = db.execute(

"SELECT * FROM meta_forms WHERE form_id = :fid", {"fid": form_id}

).fetchone()

if not form:

raise HTTPException(404, "Form not found")

fields = db.execute(

"SELECT field_name, field_type, is_required FROM meta_fields WHERE form_id = :fid",

{"fid": form_id}

).fetchall()

return {

"form_id": form.form_id,

"name": form.name,

"fields": [dict(f._mapping) for f in fields]

}

调用 POST /api/meta/forms 时,虽然在业务概念上我们"新建"了一张表,但数据库底层仅仅发生了普通的事务性 INSERT。没有任何表结构被改动,也没有触发锁。

小结

元数据驱动的核心并不是消灭了结构,而是做了一次巧妙的维度提升。 我们将传统数据库赖以生存的 Schema 从底层剥离,搬到了更高一层的"应用层数据字典"中。

在这个世界里,无论租户有多少,无论他们定义怎样千奇百怪的表单,底层物理依然是一张纹丝不动、便于统一治理和灾备的 JSONB 堆表。

下一篇预告:后端有了"JSON 蓝图",前端 Vue.js 是如何像搭积木一样将它们动态渲染成生动、可交互、带双向绑定的表单界面的?