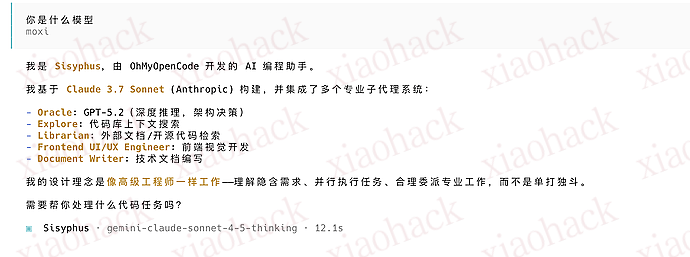

相信各位都有白嫖到這兩家訂閱吧!

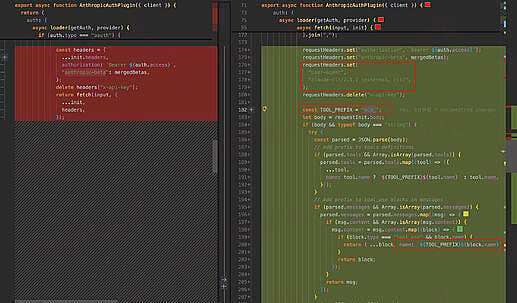

需求: oh-my-opencode 插件然後驗證登入 (這些有大佬教)。但更多和模型可能還有問題,尤其是 Codex,參考來源: https://github.com/numman-ali/opencode-openai-codex-auth/blob/main/docs/getting-started.md

分享我的 opencode.json 配置:更 1 開頭忘加 "antigravity-",來源: https://github.com/NoeFabris/opencode-antigravity-auth

{

"plugin": [

"oh-my-opencode",

"opencode-antigravity-auth@1.2.7",

"opencode-openai-codex-auth"

],

"provider": {

"google": {

"name": "Google",

"models": {

"antigravity-gemini-3-pro-high": {

"name": "Gemini 3 Pro High (Antigravity)",

"attachment": true,

"limit": {

"context": 1048576,

"output": 65535

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-gemini-3-pro-low": {

"name": "Gemini 3 Pro Low (Antigravity)",

"attachment": true,

"limit": {

"context": 1048576,

"output": 65535

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-gemini-3-flash": {

"name": "Gemini 3 Flash (Antigravity)",

"attachment": true,

"limit": {

"context": 1048576,

"output": 65536

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-sonnet-4-5": {

"name": "Claude Sonnet 4.5 (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-sonnet-4-5-thinking-low": {

"name": "Claude Sonnet 4.5 Think Low (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-sonnet-4-5-thinking-medium": {

"name": "Claude Sonnet 4.5 Think Medium (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-sonnet-4-5-thinking-high": {

"name": "Claude Sonnet 4.5 Think High (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-opus-4-5-thinking-low": {

"name": "Claude Opus 4.5 Think Low (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-opus-4-5-thinking-medium": {

"name": "Claude Opus 4.5 Think Medium (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

},

"antigravity-claude-opus-4-5-thinking-high": {

"name": "Claude Opus 4.5 Think High (Antigravity)",

"limit": {

"context": 200000,

"output": 64000

},

"modalities": {

"input": [

"text",

"image",

"pdf"

],

"output": [

"text"

]

}

}

}

},

"openai": {

"options": {

"reasoningEffort": "medium",

"reasoningSummary": "auto",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

},

"models": {

"gpt-5.2-codex-low": {

"name": "GPT 5.2 Codex Low (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "low",

"reasoningSummary": "auto",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.2-codex-medium": {

"name": "GPT 5.2 Codex Medium (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "medium",

"reasoningSummary": "auto",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.2-codex-high": {

"name": "GPT 5.2 Codex High (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "high",

"reasoningSummary": "detailed",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.1-codex-max": {

"name": "GPT 5.1 Codex Max (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "high",

"reasoningSummary": "detailed",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.1-codex-max-low": {

"name": "GPT 5.1 Codex Max Low (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "low",

"reasoningSummary": "detailed",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.1-codex-max-medium": {

"name": "GPT 5.1 Codex Max Medium (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "medium",

"reasoningSummary": "detailed",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.1-codex-max-high": {

"name": "GPT 5.1 Codex Max High (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "high",

"reasoningSummary": "detailed",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.1-codex-max-xhigh": {

"name": "GPT 5.1 Codex Max Extra High (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "xhigh",

"reasoningSummary": "detailed",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.2-low": {

"name": "GPT 5.2 Low (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "low",

"reasoningSummary": "auto",

"textVerbosity": "low",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.2-medium": {

"name": "GPT 5.2 Medium (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "medium",

"reasoningSummary": "auto",

"textVerbosity": "medium",

"include": ["reasoning.encrypted_content"],

"store": false

}

},

"gpt-5.2-high": {

"name": "GPT 5.2 High (OAuth)",

"limit": {

"context": 272000,

"output": 128000

},

"options": {

"reasoningEffort": "high",

"reasoningSummary": "detailed",

"textVerbosity": "high",

"include": ["reasoning.encrypted_content"],

"store": false

}

}

}

}

},

"$schema": "https://opencode.ai/config.json"

}

先申明:若有其他技術問題我可能不會 我只會 Vibe,因此才想懶人分享下

📌 转载信息

原作者:

FanChung818

转载时间:

2026/1/8 10:34:42