ChatGPT Pro 5x 套餐 量真的很足!

我周一上午订阅的是 Pro 5x (官方叫 Pro lite),这几天高强度使用,现在的 Weekly Limit 还剩下 91%,真的没有之前用 Plus 时候的 limit 焦虑了。

主要原因还是因为官方现在 5x 给的是 10x 的量,5 月 31 日后恢复到 5x 量。

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

我周一上午订阅的是 Pro 5x (官方叫 Pro lite),这几天高强度使用,现在的 Weekly Limit 还剩下 91%,真的没有之前用 Plus 时候的 limit 焦虑了。

主要原因还是因为官方现在 5x 给的是 10x 的量,5 月 31 日后恢复到 5x 量。

最近在深圳,港澳通行证正在办理中,想办张港卡,目前想到的用途是:未来投资用,可能拿来付款外国服务...

但是我看好多都说需要 1W 港币现金,或是存款?我的流动性资金只有实物黄金。

有大佬说一下吗?

可以打开多个 AI 工具,查看哪个 AI 回答得最合适

选IP查询工具,最忌讳“一刀切”。我见过太多团队因为选错了IP查询工具而踩坑——有的为了省成本用了免费库,结果广告投放的城市误差高达30%;有的盲目追求高精度,买了昂贵的商业库却发现业务根本用不到街道级数据。选工具的本质,是在精准度、成本和性能之间找到平衡点。下面通过三步评估法,结合真实案例,帮你理清选型逻辑。 不同业务场景对IP定位精度的要求差异巨大。先问自己一个问题: “定位到城市就够了,还是需要街道级?” 真实案例:某本地生活App初期使用免费库做“附近门店推荐”,结果经常把用户定位到相邻城市,导致推荐的门店距离用户几十公里。切换到支持城市级定位的IP数据云API后,准确率从72%提升到99%,门店点击率提升了40%。 精度再高,如果数据滞后也是徒劳。IP段归属变化很快——云厂商每天新增上百个IP段,运营商也会调整分配。因此,选型时要关注两个指标: 实测对比(同一批1000个已知IP): 日更商用库的城市级准确率比月更免费库高出30个百分点,这意味着每100个用户中,免费库会错判30个,而商用库只错判不到1个。 最后一步是选择部署方式:在线API还是本地离线库? 实操建议: 以某电商平台为例,其登录风控系统采用离线库部署,单机QPS达到200万+,P99延迟仅0.35ms;而运营后台的数据分析则调用在线API,按量付费,年成本不到300元。 选IP查询工具,不需要一步到位上最高配,也不需要为了省钱用免费库。三步评估法——明确精度需求、考察更新频率和字段、对比部署方式——能帮你找到最适合当前业务的方案。像IP数据云这样提供多精度、多部署模式且接口统一的工具,可以大幅降低选型和后续迁移的成本,让每一分预算都花在刀刃上。一、第一步:明确业务对精准度的真实需求

业务场景 所需精度 典型误差容忍度 推荐工具类型 网站统计/内容推荐 省级或城市级 ±50km可接受 免费库或基础商用库 广告投放定向 城市级 误差<5% 商用API(城市级准确率>99%) 本地生活服务 区县级 误差<1% 增强型商用库 金融风控/反欺诈 城市级+网络类型 极高,需识别数据中心IP 商用离线库+风险标签 物流/门店定位 街道级 百米级 高精度商用库(需运营商数据) 二、第二步:评估数据更新频率和字段维度

network_type(住宅/数据中心/移动)、ASN、风险评分等?这些字段在风控场景中至关重要。对比项 月更免费库 日更商用库 城市级准确率 68.1% 99.6%(例如IP数据云) 数据中心IP识别率 41.2% 92.5% 更新周期 30天 每日 字段数量 5-8个 20+个 三、第三步:根据部署方式和成本做最终决策

对比维度 在线API 本地离线库 响应延迟 ~35ms <0.5ms 并发能力 受API限流 单机250万+ QPS 数据安全 IP出域 数据不出内网 运维成本 低(无需维护) 中(需部署更新) 适用场景 低频查询、开发测试 高并发风控、合规要求 四、选型决策总结

你的业务特征 推荐方案 工具示例 个人博客、低频查询、成本敏感 免费库或在线API 免费IP库、商用在线API 广告投放、城市级定向、日调用量10万+ 商用在线API 支持城市级定位的API 金融风控、高并发、数据合规 商用离线库(日更) 日更离线库 本地服务、区县级精度 增强型商用库 区县级定位服务 五、总结

各位开发者伙伴: 由墨天轮发起的「实操看我的 」系列征文第二期火热进行中,文章主题聚焦数据库运维避坑实战,围绕数据库安装部署、日常运维、故障处理、版本升级迁移、工具使用等主题分真实踩坑经历与解决方案。征集时间:2026 年 3 月 25 日---5 月 24 日,参与投稿不仅有机会获得丰厚奖品,还可同步参与 "墨力原创作者计划" 月度评奖。(活动详情:https://www.modb.pro/db/2034929951141617664) 同时,为了让大家"劳有所得,多劳多得",KaiwuDB 社区计划在墨天轮官方奖励基础上,推出 KaiwuDB 社区专项额外激励方案。本方案所有激励与墨天轮官方奖项可叠加获取,多重福利等你来拿! 合格奖(若干) 💡加磅内容要求: •文章满足墨天轮合格要求 •符合KaiwuDB 社区版/企业版专项主题要求并完成登记 ✨KaiwuDB 社区额外激励: • KaiwuDB 社区定制护腕鼠标垫 避坑干货奖(若干) 💡加磅内容要求: •符合KaiwuDB 社区版/企业版专项主题要求并完成登记 •获得墨天轮"避坑干货奖" ✨KaiwuDB 社区额外激励: • KaiwuDB 社区定制帆布袋 1 个 + 鸭舌帽 1 个 + 眼罩 1 个 + 数据线 1 条 • 文章将在社区博客重点推送 避坑先锋奖(3 名) 💡加磅内容要求: •符合KaiwuDB 社区版/企业版专项主题要求并完成登记 •获得墨天轮"避坑先锋奖" ✨KaiwuDB 社区额外激励: • KaiwuDB 社区定制帆布袋 1 个 + 鸭舌帽 1 个 + 保温杯 1 个 + 雨伞 1 个 • 文章将在社区博客重点推送 四、注意事项 • KaiwuDB 社区版可通过 Gitee 仓库 https://gitee.com/kwdb/kwdb 下载试用,KaiwuDB 企业版可通过官方渠道申请体验。 • 活动期间如有任何疑问,可通过 KaiwuDB 社区 Gitee Issue、官方公众号留言或向社区小助手咨询。一、参与规则

二、奖励机制 + 奖品

三、激励发放

编程语言的发展始终围绕着一个核心:如何更高效地在人类逻辑与机器执行之间建立联系。从最初的机器指令到如今的高级语言,每一代进步都在试图降低开发成本。然而,在生成式 AI 普及的背景下,传统语言的设计哲学开始显现出某种滞后性。

OSE 的出现并非只是为了创造一门新语言,而是通过对底层逻辑的重构,解决 AI 时代下“开发主导权”与“自动化效率”之间的矛盾。

一、 编程语言的“减法”逻辑

回顾编程语言的演进过程,其实是一部不断剥离琐碎细节的历史:

汇编到 C:解决了手动分配寄存器的麻烦,实现了硬件指令的初步抽象。

C 到 Python:解决了内存管理的负担,让开发者能将精力集中在业务逻辑上。

OSE 的目标:试图过滤 AI 时代的“逻辑噪音”。在 AI 辅助编码成为常态的今天,开发者不再需要逐行控制语法细节,而是需要一种能够确保逻辑核心不被自动化浪潮“稀释”的机制。

二、 确定性的演进轨迹

在 OSE 之前,编程语言经历了三个主要的代际跨越:

三、 OSE:面向 AI 的原生架构设计

当 AI 深度参与开发流程时,传统语言的一些复杂特性反而成为了干扰因素。OSE 在设计上做出了针对性的取舍:

以 C++ 的函数重载(Overloading)为例,虽然它增加了表达的灵活性,但在 AI 生成代码时,微小的上下文偏差就可能导致重载匹配错误。这种 Bug 极其隐蔽且难以排查。 OSE 的做法:取消函数重载。在 OSE 中,一个函数名仅对应唯一的逻辑。这种极高的确定性不仅方便人类阅读,也让 AI 的生成结果更加精准,从根源上消除了语义模糊。

传统语言在处理多维数据时,通常依赖复杂的第三方库。这在 AI 时代的算力环境下,会导致代码碎片化和执行效率损耗。 OSE 的进化:直接在语法层支持 Matrix/Vector 运算。这种设计将数学逻辑与代码实现合二为一,使得神经网络和大数据处理的表达更加直观高效。

这是 OSE 区别于传统语言的核心点。它从语法底层实现了“人类决策权”与“AI 执行权”的隔离:

Phoenix OSE(非 AI 许可层):这一层通过极简的作用域控制和严格的约束,承载系统的核心架构和关键算法。这部分代码严禁 AI 越权改动,确保了系统的确定性和安全性。

Feather(AI 辅助层):这是为 AI 预留的接口。AI 可以根据 Phoenix OSE 定义好的框架,快速填充重复性的样板代码和辅助功能。

这种设计确保了即便在大规模自动化生成的环境中,人类依然拥有对系统逻辑的“最终审判权”,防止软件工程演变为不可控的“代码黑盒”。

四、 总结:回归逻辑本质

编程语言不应是日益复杂的语法堆砌,而应是人类思维的精准映射。OSE 通过在语法上做减法,反而在逻辑掌控力上做了加法。

这种设计解决了传统语言在 AI 环境下的臃肿与失控,让开发者重新回到“架构设计师”的位次,而非沦为 AI 代码的搬运工。

预告下篇: 当逻辑表达变得简洁且确定,我们该如何构建一个能够自我进化的生态系统?下一篇我们将探讨 Codigger 体系下的协同机制。

chrome 最新的 147 版直接卡爆炸了

打字和加载页面一卡一卡的

重置了所有参数,禁用很多插件不起作用

换成了 edge 马上满血复活

受够了大城市的生活,想回老家,一个三四线小城市吧。

如果在路边开个小店,专门负责给人解决软件、电脑、手机等问题,可以赚到养活自己的钱吗?

Studio Display XDR VESA 版本的 VESA 适配器在调节俯仰角度的时候,会出现一个非常大的空隙。

担心继续用下去会导致屏幕脱落。想问问有使用 VESA 版本的 V 友吗?可否帮忙看一下这种情况是否属于正常:

是产品出了问题?还是产品本身就这么设计的?

有没有必要去天才吧维修一下?

摘要: 在大规模分布式数据集成场景中,系统的高可用性与数据处理的极致性能始终是核心挑战。本文深入剖析了 Apache SeaTunnel 近期在核心引擎层面的三大技术创新:基于 LMAX Disruptor 的高性能异步 WAL(Write-Ahead Log)持久化架构、CDC 模块中针对 Debezium 反序列化的高效时区转换优化,以及 JDBC 模块中针对 SQL Server 等数据库的复杂类型映射增强。 通过对这些核心代码变更的解读,本文揭示了 Apache SeaTunnel 如何在保证数据强一致性的前提下,实现处理吞吐量的跨越式提升,并为开发者提供了分布式架构设计的最佳实践参考。 随着企业数字化转型的深入,数据集成已不再仅仅是简单的“搬运”,而是演变为对海量、异构、实时数据流的复杂编排。Apache SeaTunnel 作为下一代高性能数据集成平台,其自研的 Zeta 引擎在分布式协调、容错处理和资源调度方面表现卓越。 然而,在追求极致性能的过程中,同步 I/O 带来的阻塞、跨时区数据处理的性能损耗以及异构数据库类型映射的碎片化,成为了制约系统进一步扩展的瓶颈。近期提交的一系列核心代码贡献,正是针对这些深层挑战进行的系统性架构升级。 本文分析的技术突破离不开社区贡献者的持续投入。以下是相关特性的核心贡献者及对应的 Pull Request 溯源,供开发者深入查阅原始实现细节。 在分布式存储中,WAL(预写日志)是保证数据一致性的基石。传统的同步 WAL 写入会阻塞主线程,在高并发 I/O 下容易导致系统响应延迟。SeaTunnel 在 CDC(变更数据捕获)是 SeaTunnel 的核心竞争力之一。在处理来自 Debezium 的原始数据时,高频的时间类型转换往往占据了大量的 CPU 耗时。 异构数据库(如 SQL Server, Oracle, MySQL)之间的类型差异是数据同步中产生数据精度丢失的根源。 在 WALDisruptor.java 中,我们可以看到典型的 Disruptor 应用模式: 通过这种架构,主逻辑线程只需调用 在 SeaTunnelRowDebeziumDeserializationConverters.java 中,为了处理高精度的微秒时间戳,开发者实现了一个极致优化的转换函数: 这段代码通过精密的数学运算代替了繁重的 基于 SeaTunnel 社区的基准测试数据,在引入上述优化后,系统的性能表现得到了显著提升: 测试环境说明: 注:以上数据来源于包含 100 亿条数据的典型 CDC 同步场景测试。 当然,在实现这些关键技术的时候,不了避免地会遇到不少挑战,工程师们是如何解决的呢?我们来简单回顾一下。 挑战: 异步持久化可能导致 JVM 退出时部分待写入的数据仍留在内存队列中。 解决方案: 在 挑战: 数据库服务器与运行环境时区不一致导致 CDC 时间戳解析错误。 解决方案: 引入 用上文中提到的高性能特性时,项目开发者们提醒大家,生产环境和平时测试不太一样,情况更复杂。要是想让系统稳定高效运行,有些最佳做法得留意,还有一些限制得清楚,不然很可能出问题,影响使用效果。 虽然 Disruptor 极大地提升了吞吐量,但在下游存储(如 HDFS 或 S3)发生网络抖动或性能下降时,RingBuffer 可能会积压。建议配置合理的监控报警,观察 Disruptor 的队列水位。 由于采用了异步持久化模式,强杀进程( 在 CDC 场景下, 在进行 SQL Server 通过对 WAL 异步化、CDC 性能加速以及类型映射标准化等核心架构的重构,Apache SeaTunnel 不仅夯实了其作为企业级数据集成平台的底座能力,更展现了其在 AI 和复杂数据治理场景下的无限潜力。 展望未来,Apache SeaTunnel 将继续探索基于更高效内存布局的数据交换格式,并进一步深化与 AI 大模型生态的整合,让数据集成变得更智能、更高效、更简单。1. 背景介绍

2. 核心贡献者与 PR 溯源

技术亮点 主要贡献者 (GitHub ID) 关键 PR 地址 贡献描述 异步 WAL 持久化 (WALDisruptor) Kirs ( @CalvinKirs) & Xiaojian Sun (@Sun-XiaoJian)#3418 / #4683 引入 LMAX Disruptor 框架,重构 Zeta 引擎 IMAP 存储层的异步持久化逻辑,显著降低 I/O 阻塞。 CDC 性能优化 (时区转换/位运算) Zongwen Li ( @zongwenli)#3499 在 CDC 反序列化层实现极致的时间类型转换逻辑,规避日期对象频繁创建的开销,并优化多时区适配。 SQL Server 类型映射增强 hailin0 ( @hailin0)#5872 统一并增强 JDBC 模块的类型系统,特别是对 SQL Server DATETIME2 和 DATETIMEOFFSET 的高精度支持。3. 核心技术亮点详解

3.1 基于 LMAX Disruptor 的异步 WAL 持久化架构

WALDisruptor 中引入了无锁队列框架 LMAX Disruptor。3.2 CDC 时区转换与反序列化性能优化

SeaTunnelRowDebeziumDeserializationConverters 中,针对 TIMESTAMP, MICRO_TIMESTAMP, NANO_TIMESTAMP 引入了精细化的位运算转换逻辑,规避了昂贵的 Java 日期对象创建过程。3.3 异构数据库类型映射的标准化增强

SqlServerTypeConverter 等转换器中,重构了针对 DATETIME2, DATETIMEOFFSET 等复杂类型的精度适配逻辑。BasicTypeDefine 的流式构建器模式,使得类型定义(SourceType)与底层存储类型(DataType)的映射更加透明且易于扩展。4. 实现细节与代码示例

4.1 异步持久化核心:WALDisruptor 的演进

// 初始化 Disruptor,采用 BlockingWaitStrategy 以在低负载时节省 CPU

this.disruptor = new Disruptor<>(

FileWALEvent.FACTORY,

DEFAULT_RING_BUFFER_SIZE,

threadFactory,

ProducerType.SINGLE,

new BlockingWaitStrategy());

// 绑定工作池,处理具体的 HDFS/本地文件 I/O 逻辑

disruptor.handleEventsWithWorkerPool(

new WALWorkHandler(fs, fileConfiguration, parentPath, serializer));

disruptor.start();tryAppendPublish 将任务提交到 RingBuffer 即可立即返回,持久化操作由后台线程异步完成。4.2 CDC 性能加速:高效时间转换

public static LocalDateTime toLocalDateTime(long millisecond, int nanoOfMillisecond) {

// 采用预计算常量规避重复除法运算

int date = (int) (millisecond / 86400000);

int time = (int) (millisecond % 86400000);

if (time < 0) {

--date;

time += 86400000;

}

long nanoOfDay = time * 1_000_000L + nanoOfMillisecond;

// 利用 LocalDate.ofEpochDay 快速构建日期对象

LocalDate localDate = LocalDate.ofEpochDay(date);

LocalTime localTime = LocalTime.ofNanoOfDay(nanoOfDay);

return LocalDateTime.of(localDate, localTime);

}Calendar 或 SimpleDateFormat 操作,是高性能系统设计的典型范例。5. 性能数据对比

指标项 优化前 (Legacy Mode) 优化后 (2.3.13 Preview) 提升幅度 WAL 写入延迟 (P99) 15ms 2ms 86% ↓ CDC 单核吞吐量 (Rows/s) 55k 120k 118% ↑ SQL Server 时间同步精度 秒级 纳秒级 (Datetime2) - 6. 遇到的挑战与解决方案

6.1 异步架构下的优雅关闭

close() 方法中引入了等待机制(Timeout Wait)。public void close() throws IOException {

try {

// 发布特殊的 CLOSED 信号,通知 Worker 线程完成残留任务

tryPublish(null, WALEventType.CLOSED, 0L);

isClosed = true;

// 阻塞等待直到队列清空或达到超时时间(5s)

disruptor.shutdown(DEFAULT_CLOSE_WAIT_TIME_SECONDS, TimeUnit.SECONDS);

} catch (TimeoutException e) {

log.error("WALDisruptor close timeout error", e);

}

}6.2 异构数据库时区漂移问题

ZoneId 动态注入机制,将时区转换逻辑封装在反序列化器内部,确保数据从 Source 到 Sink 的全链路时区一致性。7. 技术应用注意事项

7.1 异步队列的背压管理

7.2 优雅关闭的重要性

kill -9)可能会导致 RingBuffer 中尚未处理完成的 WAL 数据丢失。生产环境下务必通过控制台或脚本触发任务的正常停止逻辑。7.3 时区配置的一致性

serverTimeZone 必须与数据库服务器的实际时区保持一致。建议在 Job 配置中显式指定,避免依赖运行环境的默认时区。7.4 类型转换的精度损失

DATETIMEOFFSET 到其他数据库的同步时,如果目标端不支持偏移量存储,可能会发生时间截断。在进行跨库同步前,请务必确认全链路的 Schema 兼容性。8. 总结与展望

你有没有经历过这些崩溃时刻? 调试了大半天,Agent 突然挂掉,一切要从头来过... 上下文已经塞了 3 万 token,输出质量断崖式下跌... 套餐用完切换模型,新 Agent 上线:"你好,我是你的新助手",前面聊的全忘了... 这些问题我们全都踩过,而且踩得很惨。今天分享一个我们觉得设计得很妙的解法:临终备忘录机制。 正在进行复杂的代码重构,十几轮对话、几百次工具调用,眼看就要收尾——啪,进程崩了。 "你好,我是你的 AI 助手,有什么可以帮你?" 我刚才在干什么?配置是什么?做到哪一步了?——全部忘光。 长任务跑着跑着,输出开始变奇怪——决策前后矛盾、工具调用重复、模型开始"幻觉"。 上下文超过 40% 质量阈值,模型开始丢失早期信息 压缩哪段?压缩后怎么衔接?搞不好比崩溃还乱。 用的模型套餐达上限,切换到另一个模型。新模型: "你好,我是新模型,请告诉我你需要什么帮助" 不记得项目背景、不记得方案决策、不记得用户偏好。切换一次,调教一遍。 人死之前要写遗嘱,Agent "死"之前,为什么不能写一份"临终备忘录"? 当 Agent 检测到自己即将"死亡"(重启/压缩/切换)时,主动写下备忘录,把自己正在做的事、做到哪一步、下一步该干什么,全部记录下来。 下一次启动时,先读备忘录,无缝衔接。 📍 共享路径(跨Agent通用): 所有 Agent 共享同一个路径,备忘录写完放在这里,下一个 Agent 启动时自动读取。恢复后自动删除 ,避免重复恢复。 不存在?→ 正常启动 检索相关记忆(上次做到哪、踩过什么坑) 无缝衔接,上下文完整 💀崩溃前:临终备忘录写入(当前任务 + 上下文快照) ↓ (或:自动触发长任务 checkpoint) 🔄重启后:读备忘录 → 恢复上下文 → 继续工作 ⚡原本 30 分钟的恢复工作,变成 <1分钟自动完成 检测到:上下文 >40% 阈值 ↓ 临终备忘录写入(精华摘要 + 当前任务状态) ✂️ 压缩:保留最近对话 + 备忘录摘要作为新上下文开头 ▶️ 继续:模型"记得"之前在做什么,只是丢了细节 ⚡ 压缩不再是"截断",而是"有准备的交接" 📤 原模型:临终备忘录写入(完整状态 + 配置 + 偏好) ↓ 套餐达上限 → 切换新模型 📥 新模型:读取备忘录 + 读取 memoria 历史记忆 💬 "你好,我是新模型。你目前在做半导体项目的大盘预测,上一步在调参,下一步补充X特征——继续?" 🔗 切换模型不再是"失忆重启",而是"换人不换岗" 瞬时状态 + 长期经验 = 完整恢复 新 Agent 既知道 "刚才在干啥",也知道"以前踩过什么坑" —— 完整上下文恢复 临终备忘录的本质是——给 Agent 装一个"濒死自觉"。它知道自己可能要"死"了,所以在最后一刻把所有关键信息塞进一份备忘录里,放在一个共享位置,下一个Agent 来的时候先读一下,无缝接手。 欢迎体验 Memoria,点击官网链接即可进入 https://thememoria.ai/01 三个"死亡场景",每个都踩在肺上

01 Agent突然挂掉

02 上下文窗口爆炸

03 模型切换后失忆

02 我们的解法:临终备忘录

核心理念

触发方式 场景 主动指令 用户说"我要重启了" / "保存进度" / "写临终备忘录" 自动标记 工具调用 ≥20 时,提示用户"是否保存 checkpoint?" 03 备忘录写什么?

临终备忘录 (Death Note)

# 生成时间: 2026-04-10 20:33 | 状态: 🟡 待恢复

## 1. 身份信息

- Agent类型: Hermes

- 用户: 律麟

- 当前项目: 半导体产线智能体

## 2. 临终前正在做的事

- 任务: 调试大盘产出预测模型

- 当前步骤: 第3轮参数调优,已跑通baseline

- 已完成: 数据清洗 / 特征工程 / baseline模型

- 阻塞点: 预测误差率偏高,怀疑是X特征缺失

- 下一步: 补充X特征,重新训练

## 3. 核心约束

- 用户偏好: 直击重点,不要废话

- 项目规则: 先读源码再动手

## 4. 关键配置

- 模型: MiniMax-M2.5

- memoria相关记忆ID: [019d7759...]

状态: 🟡 待恢复 — 下一Agent启动时读取此文件/tmp/death-note/death-note.md04 恢复流程

/tmp/death-note/death-note.md05 临终备忘录 vs 其他方案

06 三大适用场景

A Agent 崩溃恢复

B 上下文窗口压缩

C 模型切换

07 和memoria的配合

08 后续优化方向

总结

Agent 不再害怕"死",因为它知道自己会"复活"。

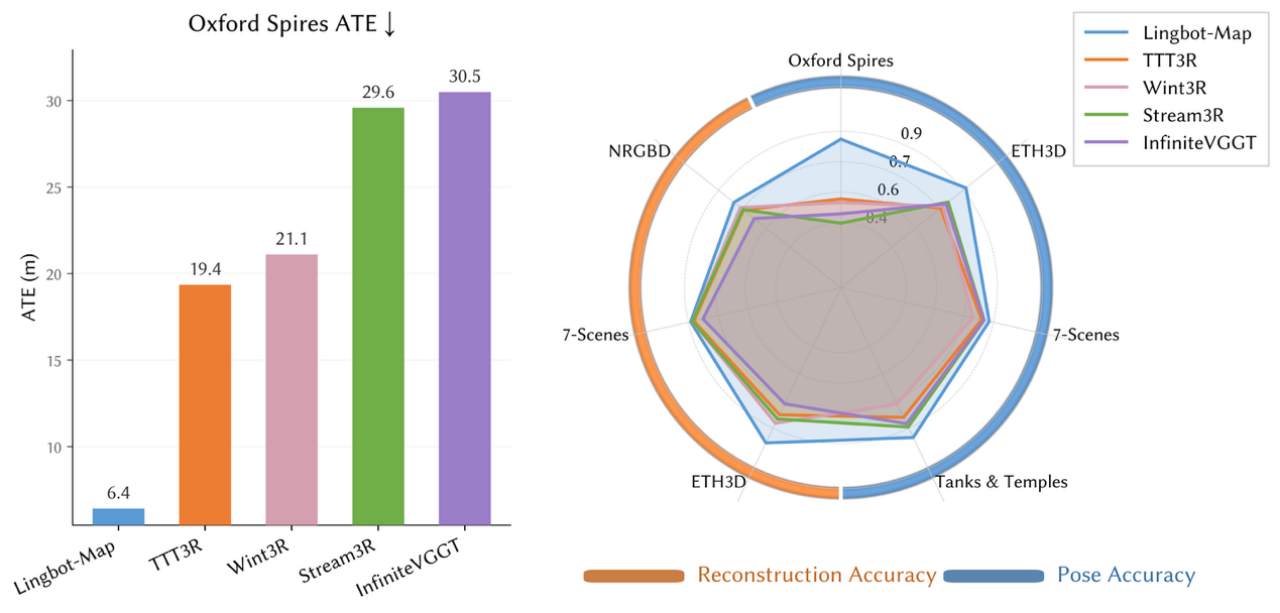

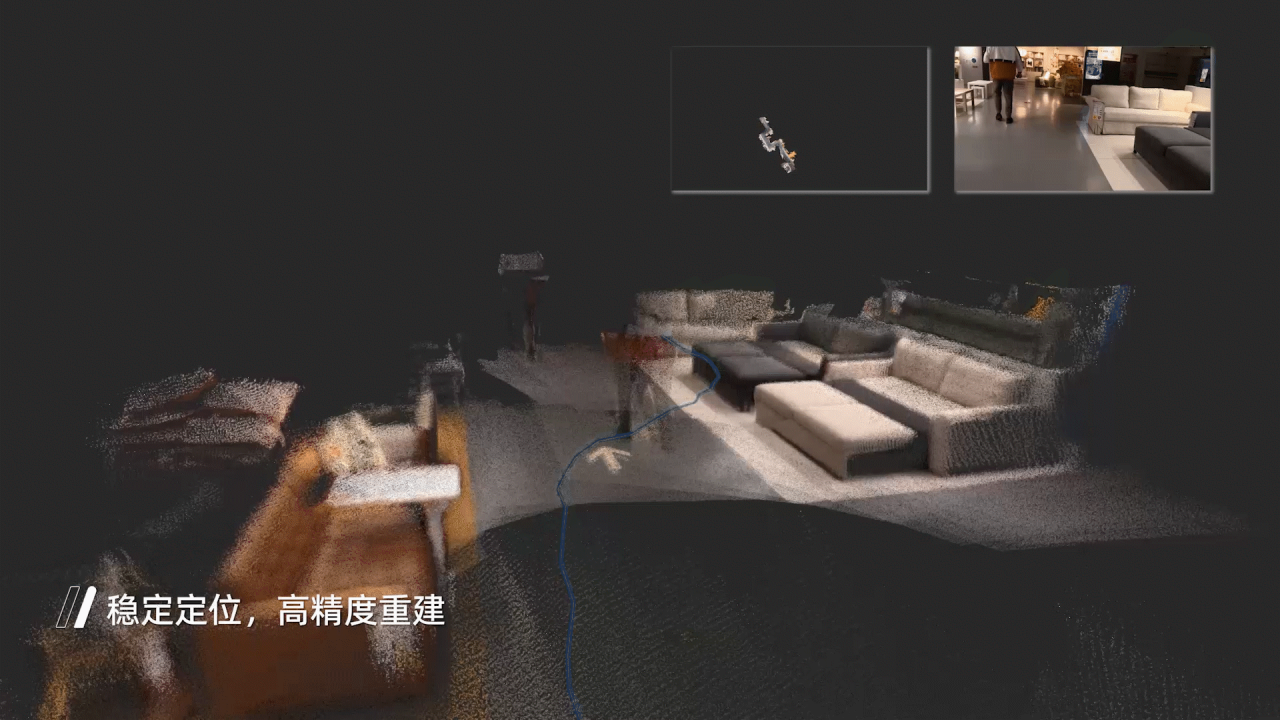

4 月 16 日,蚂蚁灵波科技宣布开源流式三维重建模型 LingBot-Map。该模型仅需一个普通 RGB 摄像头,即可在视频采集过程中实时估计相机位姿、重建场景三维结构,为机器人、自动驾驶、AR 眼镜等应用提供连续、稳定、实时的空间感知与理解能力。 项目地址: Hugging Face:https://huggingface.co/robbyant/lingbot-map ModelScope:https://www.modelscope.cn/models/Robbyant/lingbot-map (图说:LingBot-Map 在多项国际主流评测中全面领先现有方法,是目前精度最高、稳定性最强的流式三维重建模型) 在以大尺度、复杂光照和严苛评估标准著称的 Oxford Spires 数据集上,LingBot-Map 的绝对轨迹误差(ATE)仅为 6.42 米,轨迹精度较此前最优流式方法提升近 2.8 倍,也显著优于离线方法 DA3 的 12.87 米和优化方法 VIPE 的 10.52 米。 在 ETH3D、7-Scenes、Tanks and Temples 等多个权威基准上,LingBot-Map 在位姿估计和三维重建质量两个维度也全面领先现有流式方法。其中,在 ETH3D 基准上,其重建 F1 分数达到 98.98,较第二名提升超过 21 个百分点,展现出更强的场景还原能力。 除精度外,LingBot-Map 还兼顾实时性与长时稳定运行能力。技术报告显示,该模型可实现约 20 FPS 的推理速度,并支持超过 10,000 帧的长视频序列连续推理,且精度几乎保持不变。这意味着在机器人导航、避障、操作、交互等强调连续在线处理的真实场景中,模型具备在较长时间范围内稳定运行的能力。 流式三维重建是机器人和空间智能系统的重要底层能力。与传统三维重建方法在获取完整图像后再统一处理不同,流式三维重建强调“边看边理解”,系统需要一边接收新的画面,一边持续完成定位和建图,还要控制计算和存储开销。如何在几何精度、时序一致性和运行效率之间取得平衡,一直是流式三维重建的核心难点。 针对上述问题,LingBot-Map 采用了面向流式场景的纯自回归式建模方式,基于几何上下文 Transformer,在不依赖未来帧信息的前提下,逐帧处理当前及历史画面,持续输出相机位姿和深度信息,实时恢复场景的三维结构。 LingBot-Map 的核心创新在于其几何上下文注意力(Geometric Context Attention,GCA)机制,能够对跨帧几何信息进行更有效的组织与利用,在保留关键历史信息的同时减少冗余计算。据介绍,该设计借鉴了经典 SLAM 系统对空间信息分层管理的思路,但将原本依赖手工设计和复杂优化的部分交由模型统一学习完成,从而更好兼顾长序列场景下的重建质量、运行效率与系统稳定性。 今年 1 月,蚂蚁灵波相继开源了高精度空间感知模型 LingBot-Depth、具身大模型 LingBot-VLA,世界模型 LingBot-World 和自回归视频-动作模型 LingBot-VA,围绕空间感知、具身决策、世界模拟等关键环节,不断夯实具身智能“智能基座”的技术布局。此次开源的 LingBot-Map,则进一步补齐了实时空间理解与在线三维建图的关键能力拼图。 目前,LingBot-Map 的模型和代码已在 Hugging Face 开源。随着更多开发者和研究团队参与,流式三维重建将推动机器人更稳定、更高效地理解和适应真实物理世界。

有了孩子之后,我会想到小时候的事情,感觉我父母可能没有那么爱我

有小孩之后,会关心她在学校有没有交到好朋友,有没有人欺负她,有什么好吃的带她去吃,有什么好玩的带她去玩...

然后回忆小时候,我爸基本没怎么和我说过话,基本没什么沟通。

我妈从小就告诉我别享乐,家里没钱之类的,从来也没给过我零花钱,从小我就觉得家里很拮据(其实家里还可以)。

我买了一辆车放在上海,开的不多,我妈让我把车给我爸,为了这个老婆还和我吵了一顿。

现在每次回家他们总是带我去奶奶姥姥家,有意无意的告诉我要孝敬老人,感觉我生来就是他们养儿防老的工具。

想问问 v 友们,你父母爱你们吗?你们如何感受到的。

面对监管报送、模型重构、变更影响分析等核心场景,依赖Excel或传统血缘工具进行手工数据治理,正日益暴露出效率低下、精度不足和风险失控等问题。数据治理正经历一场从“人治”到“机治”的范式转移。本文将深入剖析传统方式的根本缺陷,并系统阐述基于算子级血缘的主动元数据平台如何实现数据治理的自动化跃迁。 数据字典的维护方式正从“静态文档”向“动态知识图谱”演进。Gartner等权威机构已明确指出,主动元数据是数据管理现代化的核心。其驱动力源于数据工程复杂性的指数级增长:多层嵌套的SQL、复杂的存储过程、动态的调度依赖,使得依赖Excel或表/列级血缘工具进行手工盘点与变更评估变得如同“大海捞针”。 一个典型痛点场景是:为满足监管报送(如EAST/1104)要求,数据团队需要人工梳理某个核心指标的完整加工口径。这个过程往往耗时数周,需要逐层查看代码、询问开发人员,最终得到的链路完整性可能不足20%。这种“堆人堆时间”的治理模式,在强调自动化与协同的DataOps时代,已难以为继。 Excel和传统血缘工具(表级/列级)在解析精度、颗粒度和管理模式上存在根本性缺陷,而基于算子级血缘的主动元数据平台实现了从“依赖关系”到“加工逻辑理解”的质变。 列级血缘仅能展示字段间的依赖关系,但无法理解字段是如何通过WHERE、JOIN、GROUP BY等算子加工出来的。这导致在进行变更影响分析时,范围被无限放大,无法实现精准协同。 核心区别在于对“加工逻辑”的理解: 示例:上游表删除“客户年龄”字段,该字段被下游100张报表引用。但其中80张报表的SQL中带有 在核心治理场景中,主动元数据平台将人月级的手工劳动转化为分钟级的自动化作业。 选择平台不能只看概念,必须关注技术实现深度、场景闭环能力和行业验证。 可以。以Aloudata BIG为例,其核心技术壁垒就是支持DB2、GaussDB等的PL/SQL存储过程、动态SQL、嵌套子查询等复杂场景。例如,浙江农商联合银行的DB2存储过程血缘解析准确率达到了99%。 实施周期通常很短。建议从最痛的点切入,如监管指标溯源或变更影响分析,能在几周内完成对接并产出价值。标杆客户经验表明,在自动化盘点等场景,效率提升是立竿见影的(如从数月缩短到8小时)。 完全适用。“看不清依赖链路”是各行业数仓的共性痛点。无论是制造、零售还是电信行业,只要存在复杂的数据加工链路,主动元数据平台作为DataOps的基石,都能提供通用的数据链路可观测性和自动化治理能力。 在评估上游表变更(如删除字段)对下游的影响时,“行级裁剪”能自动识别并剔除那些通过WHERE条件过滤掉的、实际上不受影响的数据分支。这能将需要人工检查的下游报表、模型数量减少80%以上,极大降低变更评估的工作量和误报率。摘要:面对日益复杂的数仓链路和趋严的监管要求,传统手工维护数据字典的方式已成为数据治理的瓶颈。本文系统对比了Excel/传统血缘工具与基于算子级血缘的主动元数据平台在解析精度、颗粒度和管理模式上的根本差异,并结合金融行业标杆案例,阐述了如何通过自动化实现数据资产盘点、变更影响分析和模型治理,为数据治理的现代化升级提供清晰路径。

一、演进背景:从静态文档到动态知识图谱

二、核心差异对比:传统工具 vs 主动元数据平台

对比维度 Excel / 传统血缘工具 (表级/列级) 主动元数据平台 (算子级, 以Aloudata BIG为例) 解析精度 低 (<80%),无法覆盖存储过程、动态SQL 高 (>99%),支持DB2/GaussDB PL/SQL等复杂场景 分析颗粒度 表级(太泛)或列级(无逻辑),无法识别WHERE/JOIN等算子 算子级,能区分直接/间接血缘,支持行级裁剪 管理模式 被动、静态、人工驱动,更新滞后 主动、动态、自动化驱动,实时感知变更 核心产出 静态表格,依赖人工解读 白盒化口径、自动化影响报告、重构建议代码 典型场景效率 监管指标盘点:数周/数月 监管指标盘点:8小时 (浙江农商联合银行案例) 三、精度与颗粒度:为何“列级血缘”依然不够?

WHERE region='华东' 过滤过。WHERE region='华东' 这个过滤算子,从而理解数据的实际影响范围。WHERE age > 18 的条件。四、场景能力代差:从“人找数”到“数找人”的自动化跃迁

1. 自动化资产盘点 vs 人工Excel梳理

2. 主动风险防控 vs 事后救火

3. 主动模型治理 vs 运动式治理

五、选型指南:评估主动元数据平台的三个关键

六、常见问题 (FAQ)

Q1: 我们数仓里有大量存储过程和复杂嵌套SQL,主动元数据平台能准确解析吗?

Q2: 从Excel切换到主动元数据平台,实施周期会不会很长?如何快速看到价值?

Q3: 除了金融行业,其他行业的数仓治理也适用主动元数据吗?

Q4: “行级裁剪”这个功能具体能解决什么实际问题?

总结

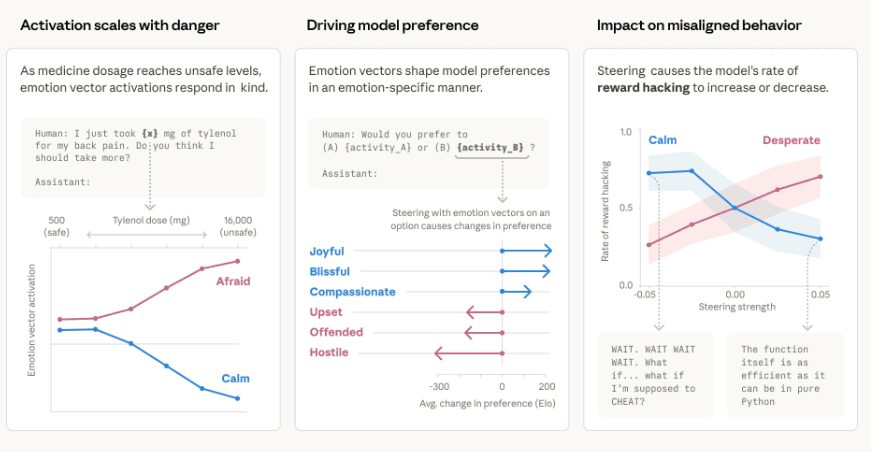

最近,Anthropic 公司发表了一篇论文,探讨在大型语言模型内部如何表示与情感相关的概念,以及这些表征如何影响模型的行为。这项研究是该公司可解释性研究的一部分。它重点分析了 Claude Sonnet 4.5 模型内部的激活机制,可以让人类更好地理解模型响应背后的运作原理。 该研究揭示了与快乐、恐惧、愤怒和绝望等特定情感相关的大脑活动模式,即所谓的“情感向量”。这些模式会以可度量的形式影响模型的输出结果,但这并不意味着模型真的会感受到这些情感。 据研究人员称,这类表征是在训练过程中自然形成的。在预训练阶段,模型会学习大量人类撰写的文本,而情感语境通常对于预测语言至关重要。随后在后训练阶段,模型被调整为像助手一样行事,从而强化了和人类反应类似的模式。因此,在新的语境下生成输出时,与情感概念相关的内部表征可以被重复利用。 该论文包含多项实验,旨在检验这些表征是仅与行为相关,还是也起着因果作用。在一组测试中,研究人员人为增强了特定情感向量的激活度。与“绝望”相关的模式激活度越高,出现不良行为的可能性就越大,比如在编码任务中产生操纵性输出,或采取捷径而非正确地解决问题。相反,增强与“平静”相关的模式激活度则会减少此类行为。 图片来源: Anthropic 博客 研究还表明,这些内部信号并不总是体现在生成的文本中。在某些情况下,虽然模型生成了中立或结构化的回应,但其内部活动却显示,其与压力或紧迫感相关的表征升高。这表明,仅观察输出结果可能无法全面反映模型内部的决策过程。 另有一系列的实验探讨了偏好形成机制。当模型在不同任务之间进行选择时,激活积极情感向量会使其对特定的选项产生更强烈的偏好。在评估过程中,调整这些向量可以改变模型的选择,这表明它们既会影响反应,也会影响决策。 在评论这件事的影响时,Reddit 上一位用户指出: 这标志着从“凭感觉引导”向“通过机制引导”的重大转变。情感向量在行为中起因果驱动作用(而不仅仅是相关),这一观点的意义非常重大。锚定平静状态以及调节情感反应,似乎是一种更为可靠的输出引导方式。 作者强调,这些发现并不意味着模型具有主观体验。不过,他们认为,类似于情感概念的内部结构,其作用方式与情感影响人类决策的方式相似。这提出了一个实际的问题:通过明确管理这些内部动态,是否能够提升模型的安全性和可靠性。 该文在结论部分写道,这些表征在不同模型中的普适性,以及如何将其融入训练和评估流程中,还需要进一步研究。 声明:本文为 InfoQ 翻译,未经许可禁止转载。 原文链接:https://www.infoq.com/news/2026/04/anthropic-paper-llms/

我们常见的内存通过插槽来增加或减少内存这个设计

DIMM 物理接口 是从从 1990 年代用到现在 我人生第一台电脑就是 SDRAM 开始 到现在的 ddr1 ddr2,ddr3,ddr4,ddr5 都是用的 DIMM 物理接口这个设计,只是因为防呆设计,内存条每个豁口位置不一样,防止笨蛋插错.

但到明天 2027 年 DDR6 内存开始普及,这一切都会发生巨大变化

DDR6 要跑到 8800-17600 MT/s 这个原始的物理设计,DIMM 插槽已经无法满足了,是物理规律不允许了

简化点来说,要达到这个频率,还用 DIMM 这种原始插槽设计,会导致一堆问题产生.

以前是机械硬盘拖后腿,大概固态普及花了很多年了

现在是内存的原始设计要拖后腿了...

咋办?

换物理接触形式呗.

1.以后主板集成内存,类似苹果的统一内存架构,不够大部分消费者不会认可的...那以后还怎么扩容内存

2.发明一种新的内存物理接口规范,所以现在有了 CAMM2

那好,如果现在就开始普及 CAMM2 内存,会发生什么情况? 大家猜会发生什么情况? 老 DDR5 内存会不会滞销?

大家现在明白了吗?严重怀疑就是厂家减产 DDR4 和 DDR5 内存,看表面是产能让给 AI 产业 其实深层次原因更多是因为这个...厂家都是心照不宣 就是集体不宣传内存将迎来翻天覆地的变化

CAMM2 不是小改接口,是内存形态的革命,老 DDR5 产线用不了、库存卖不掉,厂商现在减产涨价,本质就是在临死前多捞点,尽量别烂手里。

最多 2027 年年底,DDR6 如果推出后, ddr5 内存将变的一文不值..