刚才 Hermes 更新了 WEBUI,配置界面和 openclaw 对比,差距太大了

openclaw 的 dashboard 。我一个程序员看着都头疼。。

Hermes 的 dashboard ,井井有条,简约,只关注最重要的东西,就是配色有点丑。

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

本想白嫖一波置顶,但是赌失败了,痛失 6k

最近 Vibe coding 上头了,写了一个 F1 观赛辅助的应用,把 applestore 和 googleplay 上架都走通了,欢迎大家体验和反馈,刚好 4 月没比赛,大家都来看历史录像吧,下面有兑换码。

MV Remote 是一款局域网控制 MultiViewer 的移动端 app 。通过局域网连接电脑端的 MultiViewer 后,你可以控制串流播放器、扩展播放器观看车载镜头、查看实时计时、追踪赛事控制消息,并快速了解轮胎策略。*需要有 F1TV 的订阅账号。如果没有的话,可以通过这个网址的注册会员登录 MultiViewer 后体验, 登录路径:「 F1 - Livetiming 」。

App Store: https://apps.apple.com/us/app/mv-remote/id6758286852

Google Play: https://play.google.com/store/apps/details?id=com.xayoung.mvremote

App Store:

PMHTL76MLYNFP6YL7W

M6MHL88EKEYFMMPEPP

M8JM4KHE4L7MF7YJF7

PT3HMMPPETW3WH6LWJ

KNENMFKPMMMN8L6AW3

NPKRKXE7PW3L467A4X

7PRJYWJHHJTX4NRLHR

MMWXKWF7M8MTXPF6EH

T4JYLMMRTMJJXXMRAY

PPK4FKJX7A7PARYKKR

JNLM6KF86XKYJ64YTT

4XRNETW4PJYTF8M7EL

7M4ETPHF3NXARYTPHW

NT48FTFPWTAJFKHRKL

THK4XPW4NKMAYTL48E

NR66MA6MYK36P3ATYW

F37F6HW3N3JFK3LMER

K8FHN3XMJWXH3TME7M

YNYP7P8ETNERL83WFW

8TELAA8MRXKE4PM3TN

Google Play:

JUFY799BLSLKRE2DQPWKYRZ

HYJFPUCGWG1CNCASNRG4ZDD

TCQ0JTZDUR9194442P48A1U

M785ZRF5KRS26L4KNF4GSN5

CBYT435MCMECU4RLVQFJTGZ

EQA6DTTF4YDPY9AA4ENMWRA

22KU8L6DLQ14FKL12RQU05X

YS0LTFAERV60FW5Q7UMXT4X

ESB8Q2LE5TMPUMU74XX39BQ

UZQ0RF8HWRTEKP0EWTML5WT

YMN9LJMJUG4M3Z6RHFQAUQR

47TYN3XF6NJFAM9XUET2765

NJBVMTLVA68HVDYS0AJ3EM9

1B6QM0LEFNPMG2P2KJGXU45

LQ6H5QYNK6VRJPE05YL76HC

E8M85YHXKWP40BMFNYYTB7S

R4E1W4XHZANH2Q5EUCLBKZ4

L5TACRFYEP6F0793AYBTXYQ

TWSFU3R6CSNUJDWQKG3MPMV

base_url = " https://ccttt99.com "

sk-41b9c1bd12c83bee01f2dbae6d8014e59266a62d692aaa39ccefa9dcc7f4c0ad

key 负载过高的话,登官网获取最新 key,免费无套路

顶起来

你是否有过这种体验: KNOTA(诺达)的出现,就是为了结束这种“无效囤积”。它要把你凌乱的资料,锻造成一套本地化、结构化、可追溯的顶级外挂大脑。 01.拒绝“信息杂质”:入库即是精华 AI 最怕“一本正经地胡说八道”。KNOTA 用最严谨的方式让 AI 闭嘴或说真话。 传统的搜索靠运气,KNOTA 的检索靠逻辑。 面对枯燥的 Excel,不用背复杂的函数公式,直接开启与数据的对话。 问 AI “被告在三次供述中的差异点”,AI 列出清单,你点击每一项都能秒回本地原文证据位置。全本地运行,没有任何信息泄露风险。 “帮我总结本周关于大模型的所有利好消息”。系统自动调用 Wiki 编译功能,把所有研报揉碎了,吐出一份带导航的垂直百科,让你在开会前 5 分钟瞬间掌握全貌。 利用 ReAct Agent,让它在本地读文档的同时,去搜一下最新的 GitHub Issue。它会自动判断:什么时候该“读”,什么时候该“搜”,什么时候该“比对”。 数据不出域,隐私即生命。 市面上不缺“记事本”,也不缺“聊天机器人”。KNOTA(诺达)缺的是你——那个被信息淹没,却渴望深度思考的人。它不只是在帮你管理资料,它是在帮你整理世界。你把资料喂进去,它把洞察吐出来,而你能确切地看到,这些洞察是如何从土壤里生长出来的。 🚀想要体验“外挂大脑”的感觉吗?KNOTA 正在重新定义知识管理。

“收藏从未停止,学习从未开始”:剪藏了一堆深度好文,却在需要引用时,死活记不起关键词。

“AI 满嘴跑火车”:问 AI 一个专业问题,它答得挺像样,但你心里发虚——这结论到底有没有依据?

“数据泄露焦虑”:手里攥着公司的核心合同或个人日记,想让 AI 帮着理一理,却卡在“上传”按钮前不敢点击。三大核心进化:从“存资料”到“长智慧”

02.拒绝“AI 幻觉”:每一句都有据可查

03.拒绝“大海捞针”:让知识自动“结网”

04.自然语言驱动 BI:让数据“说人话”

深度场景:KNOTA 在你的生活里扮演什么?

01.法律人/研究员:你的“数字卷宗助手”

02.职场精英/分析师:你的“行业研报专家”

03.开发者/极客:你的“技术文档中枢”

终极安全:把 AI 关在保险箱里

结语:让你的每一滴信息,都流向决策

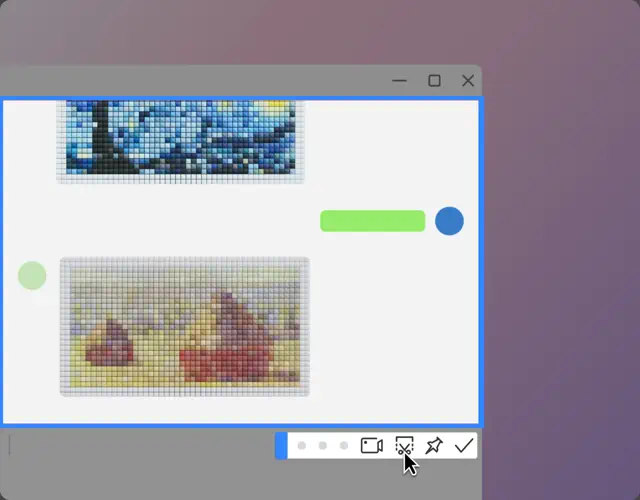

各位 v 友好,2023 年底在 v 站发了 PixPin 的第一个宣传帖子,当时 PixPin 还非常稚嫩简陋,甚至没有官网,只能放在 onedrive/百度网盘上给大家下载,功能上也有很多不足的地方,但是 v 友们还是非常支持,给了很多鼓励和建议

这两年多来我一直在更新完善:增加 macOS 版本、增加更多的标注工具、增加 mp4 格式支持等等。现在 PixPin 已经日趋成熟,如果有 V 友曾因为当时的不足而没有尝试过,或者当时尝试过但觉得不够好用的,现在可以再次体验,相信会有不一样的感受。也欢迎大家继续提出宝贵的意见和建议,PixPin 会继续努力完善。

PixPin 官网:https://pixpin.cn/

PixPin 是一款截图工具,并且围绕截图这个核心功能做了非常多的完善和拓展,贴图,文字识别,长截图,录屏,标注等等功能都非常完善,适用于任何使用电脑工作的用户,PixPin 能帮助你快速记录屏幕内容,无论是普通图像,还是长文章,或者是动态的过程,使用 PixPin 都能轻松记录,然后通过贴图功能固定到屏幕上随时参考。也能通过标注功能(高亮,放大镜,箭头,文字等)在图像上标注以表达更清晰的意思。

PixPin 现已支持 Windows 和 MacOS

首先是 UI 的大幅改版,现在 PixPin 有了专业的设计师,对主要界面和图标进行了重新设计,界面更加现代化了

其次是文本识别,现在文本识别支持同时识别简繁体中文,英文,日文了,识别准确率也有了很大的提升

另外 3.0 版本增加了一个悬浮窗,如果 v 友觉得悬浮窗侵入性太强也可以随时关掉,悬浮窗主要是方便习惯使用鼠标的用户,可以通过悬浮窗快速操作,另外还是拖放贴图的入口,在浏览网页,或者微信/QQ 聊天窗口下,直接将图像拖放到悬浮窗可以快速贴图

PixPin 是一个免费增值软件,大部分功能都是免费的,无论是个人使用还是公司使用都可以免费使用,后续的更新的功能大部分也会是免费功能。为了 PixPin 的持续发展,我们也提供了部分高级功能给会员用户,如果 PixPin 的会员功能可以帮到你,欢迎开通会员。

为了感谢 v 友们的支持同时也是庆祝 PixPin3.0 的发布,v 友们可以在这个帖子留下邮箱(可使用 base64 编码以避免爬虫抓取),每一位留下邮箱的 v 友都可以获赠一枚 PixPin 的月度会员激活码

用 vibe 建站平台几个小时做了一个。纯前端实现,完全免费。欢迎玩玩。

链接: https://3b6wq4.atoms.world/

最近一直在折腾 OpenClaw ,发现生态已经很丰富了,但资源散落在各处——Skills 分布在好几个 registry ,托管方案有一堆选择,Agent 相关的工具更是五花八门。每次想找个东西都得翻半天。

索性做了 Claw Homepage,一个 OpenClaw 生态的资源聚合站,目前收录了 159 个工具/平台,分成 8 个分类:

所有资源都是手动筛选整理的,不是爬虫聚合。支持搜索(按 / 快捷键),支持中英文切换。

站点纯静态,没有账号体系,没有付费墙,就是一个干净的导航页。

地址: clawhomepage.com

中文版: clawhomepage.com/zh/

欢迎大家提建议,觉得有遗漏的好工具也可以告诉我,持续更新中。

本文首发于「游研社」,作者 @Oracle,少数派经授权转载,仅对排版略作调整。阅读原文

在发售前后的 48 小时内,《红色沙漠》故事几乎就已经被写好了:3 月 18 日,游戏上市前的宣发预热达到顶点时,媒体评分解禁:77 分。第二天游戏上线 Steam,评价只得「褒贬不一」,开发商 Pearl Abyss 的股价一度大跌 30%。

这似乎是一个标准的高开低走剧本,外界对它的判断在那几天里几乎是统一的:画面华丽、系统臃肿、叙事失控,一款野心的产物,但雄心撑不起现实。

然后,一连串补丁接连上线。操作手感优化、砍了 Boss 血量、加了储物箱容量、补了快速旅行点、程序崩溃概率减少…… Steam 评价逐渐从「褒贬不一」跳到「特别好评」,同时在线人数不降反升,第二周峰值比首发日高出将近 3 万,突破 27.6 万。销量从 300 万冲到 400 万,股价不仅收复失地,还创下了今年的新高。

这条 V 型曲线在游戏行业并不罕见,《赛博朋克 2077》也走过类似路径。

区别在于,CDPR 花了将近两年完成口碑逆转,Pearl Abyss 只用了十天。

看上去,《红色沙漠》讲了一个用优化更新来逆袭的经典叙事。媒体和资本市场几乎立刻接受了它——开发商勤勤勤恳恳,优化补丁修好了游戏,口碑自然反弹。

但和 2077 不同的是,这次《红色沙漠》还真不是被「修」好的。

上周,《耻辱》系列和《死亡循环》的设计师 Dingu Bakaba 发了一条推,说《红色沙漠》越玩越上头:大多数开放世界游戏遵循一个固定的节奏——开头让你觉得惊艳,然后逐渐看到套路,看到重复,看到设计者留下的痕迹。

而《红色沙漠》的逻辑是倒过来的:开头迎面砸来的全是系统和规则,密密麻麻的按钮、功能、学习曲线,一个新手教程能覆盖的内容只占实际系统的很小一部分。但一旦你跨过这道坎,所有这些「规则」开始退居幕后,魔法浮现,而且不会消失,因为规则已经被你接受了。

Bakaba 用了一个桌游的术语叫「魔法圈」来形容这个过程——开局你满眼都是棋盘和规则,只有当你真正进入那个圈,真正的乐趣才开幕。

那些玩了几小时就放下的人,和那些跨过了某个门槛的人,面对的是两款截然不同的游戏。只是《红色沙漠》把玩家拒在魔法圈之外的力气,使得跨过这道门槛的体验格外强烈。

就像我们之前的的评测《为什么我劝你还是亲自玩一玩红色沙漠》所说的那样,前 30 个小时的体验,我们测试同事最大的感受是,这个游戏的内容体量与复杂度,到了一个很难用常规经验去衡量的程度。

有玩家在游戏中发现了太空。

只要给主角克里夫装上无限体力的 Mod,再反复利用游戏里的空中突刺机制不断向上飞——整个过程需要几个小时。到达太空后,可以看到星球表面的弧度、远处的星系、大气层,以及回程时的大气压缩加热现象。

这让人很容易想起《塞尔达传说:旷野之息》后来被玩家折腾出来的「上太空」。和塞尔达的路径相似,越来越多的玩家开始分享《红色沙漠》埋藏的细节。

比如有人发现游戏有着细致的 NPC 日常行为,在不被注意的路边,NPC 建造雕像会有从石胚到成品的渐变过程;

玩家招募的同伴不会在任务面板上消失然后直接带结果回来,而是会实际走到工作地点真实完成任务。你甚至可以把树木压弯,在树快要断裂的时候把自己弹射出去。

有评论说,这和《荒野大镖客 2》里给马建了睾丸尺寸随温度膨胀的物理效果是同一种精神。

还有人从游戏文件里挖出了一整套被废弃的食物风险系统,包含了 15 个大类,50 多个相关的技能,遂用 MOD 将这些内容还原了出来。

游戏发售后,社区很快发现这个世界的底层深度远超表面宣发所呈现的面貌。原本很多人对《红色沙漠》的预期不过是加强版的《刺客信条》,加上发售初期的负面舆情,给人的第一印象华而不实。但随着游戏时长的增长,越来越多玩家发现这个游戏还真就是实心的。

和发售前解禁的媒体评分不同,这几天陆续有一批媒体发表了他们的长时间游玩感受。其中 PC Gamer 的评论尤为典型:《150 小时后我仍然看不懂红色沙漠——但它却奇怪地让我着迷》,编辑在文章里吐槽了非常多地方,同时却也表示「停不下来」。150 小时的投入,只来得及让编辑充分体验了五个区域中的两个。

该说法与 Steam 评论区的一个高赞评测不谋而合,这位游戏时长 100 小时的玩家写的长评被 1554 个玩家标记为「有价值」。在列举了大量缺点后,他解释了为什么还会在游戏中投入 100 小时,因为「真正把我留下来的,是探索本身」。

这种探索体验,并不像《荒野之息》和《荒野大镖客2》那样精巧,相反,充满了残缺的体验与混乱的心流,然而也别有一番风味。

PC Gamer 的编辑兴致勃勃地描述了一种典型的游戏体验:一块矿石突然活过来杀死了他;一丛灌木莫名其妙变成怪物;一个废弃城堡其实是一个巨大的谜题工厂…… 这些单独看好像都不算什么,但凑到一起,就变成了一种庞大内容体量下的涌现性内容。

悲剧的是,前几个小时,乃至前十几个小时,玩家几乎不可能感受不到这种体验。初期玩家的注意力被系统学习和操作适应所占满,世界呈现给他们的面貌是「复杂」而不是「丰饶」。只有当操作成本降下来之后,世界才开始释放它的内容。

这也是为什么《红色沙漠》在提前媒体评分方面讨不到好的原因之一。媒体评测文化对「叙事驱动的 3A 开放世界」有一套稳定的评价框架:剧情质量、角色弧光、玩法/关卡节奏、清晰顺畅厂的交互体验等等。

《红色沙漠》按这套框架来看,确实是 77 分。它的故事混乱、主角台词贫乏,除了「是」「不是」和「赞美祖先」之外几乎没有台词。

《红色沙漠》有的,几乎只有世界。

3 月 27 日,在 Pearl Abyss 的投资者会议上,CEO 许真英被股东追问《红色沙漠》的故事问题时说道:

「我一定程度上认同用户对剧情的失望。如果能做更好就好了。制作团队在剩余时间里试图弥补不足,但最终我们把重点放在了强化游戏性上——这才是我们最擅长的。」

《红色沙漠》在开发过程中经历了多次方向转向。它起初是一个 MMO 项目,后来转向单机开放世界,然后又在内部斗争和引擎重构中多次调整。

这个开发史几乎可以解释游戏剧情的所有问题。主线分成 12 章,每章几乎是自包含的,不同章节之间的衔接松散到可以忽略——中世纪乡村、宫廷政治、东方武侠、机械化要塞,像是把几个完全不同的游戏捏合在一起。

这种叙事的空洞,在游戏发售前就已经埋下了后果。主角克里夫的配音演员前段时间透露:剧本方向在 5 年的录制周期里不断变化,他的角色原本叫Macduff(麦克白原型),中途才改成克里夫;他曾在配音现场反复询问「但是发生了什么?」但没有人能给他完整答案。

但随着世界的展开,游戏的评价逐渐和故事脱钩。我很喜欢的一个国外自媒体 Skill Up 把《红色沙漠》称为「自《上古卷轴 V:天际》以来最接近天际体验的游戏——每次迈出大门,不管朝哪个方向走,冒险都在等待,而且每个人的冒险故事都不一样。」

他在评测里把这种现象称为「反向优势」——剧情越弱,玩家越容易放弃追逐过场动画,越愿意在世界里花时间,他们写下的故事就越个人化。他甚至说,「这是一款奇怪的游戏,克里夫的词汇量只有『是』『不是』和『赞美祖先』,但我莫名其妙地喜欢他。」

之所以能达到这样的效果,当然靠的不是剧情烂,而是来自两个维度的加成。

B 站上有一类《红色沙漠》的视频叫「以防你不知道」系列,内容千奇百怪,主旨只有一个:告诉你这个游戏居然还有这么多隐藏设计。比如你能通过武器聚光来点燃各种东西,可以用封孔导气的方法获取硫磺,可以用物理反应获得水银;你在水中排泄,水体会逐渐扩散变黄;你甚至能赶海——如果带着盐来到海滩,看到洞撒进去,可以把蛏子逼出来。

虽然其实很多细节只是简单的脚本,并不会产生新的交互方式,但这类内容的传播使《红色沙漠》大大增加了《荒野大镖客 2》的神韵,而且有些细节确实让人赞叹——我昨天看到一个「放河灯」的视频:无数河灯随着河流漂流而下,每个都有独立的物理碰撞和实时光照,加上与水面的物理交互效果,沉浸感无敌。

特别是,当河灯遇到河流中心的一处礁石,被水流挤到角落堆积起来,直到河灯堆积越来越多,重新挤压出去继续前进时,那种世界细节的奢侈感十分明显。

此时弹幕也飘过了一行字:「人类对红沙的开发还不足 1%」。

另一个原因,是「塞翁失马焉知非福」的开发背景。谈起《红色沙漠》的 MMO 血统,人们会习惯性盯着短板,比如剧情差,操控交互繁杂。

但作为一家从 MMO 时代走过来的开发商,他们习惯的世界是:玩家会在一个世界里待上数百小时,所以内容密度比上手门槛更重要,深度比广度更值得押注。《黑色沙漠》是一款让新玩家面对一张密密麻麻的技能列表望而却步、但老玩家在里面年复一年发掘新内容的游戏。《红色沙漠》继承了同样的逻辑,只是把它包装成了单人游戏的形态。

其实从战斗系统就能看出也能看出类似的端倪,《红色沙漠》有种「把 MMO 里的多种职业塞给了一个主角」的感觉。因此系统宽度非常大,战斗相关的讨论中,最常见的是「这个(我没见过的)招是怎么出来的」。

和你现在进入任何一个 MMORPG 里面对的庞杂战斗和技能系统类似,《红色沙漠》的战斗门槛也是先把复杂的控制和操作逻辑驯服,而一旦适应下来,战斗的连段变化、解法空间和表现力又会变得很可观,从而具备一定的后劲与口碑发酵作用。

比如有个典型的例子,是一位玩家游玩超 70 小时后,发现一个游戏从未提示过的核心战斗机制:使用小圆盾时,按住 L1 格挡,在敌人击中的瞬间按下 RT/R2,可以直接缴械敌人。

该技巧不仅实战效果很强,还能高效刷取敌人掉落的深渊装备。基本上,类似这种「红色沙漠居然有 XX」的心得,一直在不断推陈出新,哪怕是在较为苛刻的国区,也逐渐讨到了不少路人缘。

而除了擅长堆世界内容的,MMO 的血统也擅长敏捷地应对发售后的版本更新,版本更迭产能远非纯血单机团队可比。从开发团队的组织特征来看,Pearl Abyss 本质上是一支为持续运营而构建的队伍。

MMO 的开发模式,要求他们具备几个传统单机团队不具备的能力:每周甚至每日更新的节奏、LiveOps 式的玩家反馈响应机制、大规模并行子团队同时推进内容与系统、模块化程度高且支持热更新的自研引擎。这套体系在《黑色沙漠》运营多年里已经打磨成熟,迁移到《红色沙漠》的开发流程里,直接表现为产出密度极高的更新内容。

最典型的例子是更新节奏。游戏上线后几乎按周推进、而且每次都不只修 bug,而是在内容、系统、UI / 操控、性能四条线同步并行更新。

Pearl Abyss 甚至在短时间内完成了各项生活品质优化,以及功能 / 内容的增量,如滑翔全面强化、新增多种坐骑(包括会参与战斗的狼)、将玩家在社区里传播的「空中刺击 -> 空中冲刺」 bug 评估后直接转正为正式机制。

从一系列补丁能看出,官方做的已经不只是「救火」,而是能一边补内容一边高频维护主线版本。

而这些操作,在传统单机团队里通常需要更长的周期。Pearl Abyss 能做到,本质上是因为他们的工具链和 CI / CD 管线从一开始就是为快速改动设计的。

上周 Pearl Abyss 更是宣布,把 4 到 6 月的计划摊开,里面包括 boss 重战、难度选项、敌人重新占领区域、更多战斗内容、物品分类存储等,可以看出他们已经能把玩家意见迅速转成中短期版本路线。

还有一个更重要的技术背景是,Pearl Abyss 在引擎策略非常积极:不用虚幻引擎,自己从头建一套引擎。

官方在多个场合表达过坚持自研引擎的立场,意思大致是:如果不掌握核心技术,就无法成为行业的领导者。他们认为自研引擎才能保证游戏画面的绝对统治力,也才能在需要的时候自由地修改底层方向。

当然,坚持自研引擎的代价很高,带来了长达7年的开发周期。好处则是惊人的优化水平和灵活的自主修改空间。

《红色沙漠》有相当多的图形特效,是自己从底层重新造轮子折腾出来的。之前数毛社对游戏引擎的技术拆解里提到过,《红色沙漠》的光线追踪和全局光照系统模拟了太阳和月亮的光线穿过大气层时的散射过程,然后在镜头周围的网格上生成表面元素,通过实时射线追踪来计算光照辐射。这套物理级的光学演算机制,在一些室内场景里达到了超越虚幻5的效果。

另一点是游戏对远景的处理。在绝大多数 3A 开放世界里,极远处的树木为了节省性能会被降级为 2D 贴图。但《红色沙漠》的引擎让极远处的树依然保留完整的 3D 体积,而且每一棵都在参与实时光照和阴影投射。

离谱的是,即便近似苛刻地追求各种细节效果,在图形优化水平方面,《红色沙漠》却依然跑进了开放世界 3A 游戏的 T0 档,性能优化属于当今最好之一(很可能没有之一),用 30 系显卡就能跑得游刃有余。

把《红色沙漠》的口碑反转归功于补丁,是一个方便叙事,我们当然可以说,是因为补丁修改及时,所以《红色沙漠》口碑迎来了好转。

补丁的确把游戏体验变得更好了,但补丁真正改变的,不是《红色沙漠》的本质,而是它的可及性。

快速旅行点的增加、储物箱的上线、滑翔体力消耗的降低、战斗响应速度的微调——这些修改的作用是降低初期体验中的摩擦系数,让更多玩家更容易跨过前面描述的那道门槛。

真正的原因是游戏在底层埋了足够多的内容,当玩家投入时间之后,这些内容开始互相连接,形成一种规模效应。很多人玩到后面有这种感觉——游戏越深挖,越觉得还有更多东西没碰到。

这种内容之间的化学反应,需要时间来激活。

回到那些在发售初期因为系统过载而离开的玩家,在补丁改善了可及性之后开始回流,他们比首发玩家更幸运的地方不在于他们玩到了不同的游戏,而在于他们玩的是同一款游戏——但时机更对了。

而在经过 7 年漫长的不离不弃后,Pearl Abyss 也终于收获了阶段性的果实。坚持自研引擎的路线开始发挥出不可估量的潜力。

随着《红色沙漠》的落地,多年前 Pearl Abyss 曾发布过的那个惊艳行业、却陷入漫长沉寂的收集类开放世界游戏:《多可比》,开始有了新的进展。

这部作品当年为了全力研发《红色沙漠》而封存,之后却可以直接复用后者积累的开发经验和渲染管线,研发效率将会有指数级的提升。

这种叙事,其实我们在日本的游戏工业里见过——10 年前,卡普空用《生化危机 7》跑通了 RE 引擎,然后铺开了接下来十年几乎每年一部高质量作品的产能。Pearl Abyss 的路径更陡峭,但逻辑是相似的。

使用场景:在家里访问一个只有在办公室才能访问的平台系统,这个平台系统对办公室 ip 开放了白名单,办公室可以访问互联网但是没有公网入口(因为是办公区不是服务器),家里有 ipv4 公网 ip ,公司有常年不关机 windows 系统,我想在家访问这个平台系统,用什么方案比较好

Hermes Agent 这个项目不到两个月 GitHub 星标突破 3 万,感觉有当初龙虾爆火那味儿了。。。社区里已经有不少从 OpenClaw 迁移过来的开发者了。

据说,比起 OpenClaw “干完一单忘一单”的尿性,Hermes Agent 最大的特点是它内置了一套强化学习系统,能从每次交互中提炼经验,自动生成技能,越用越聪明。

如果说 OpenClaw 的思路是做一个大而全的调度中心,那 Hermes Agent 的思路就是做一个会成长的个人助手。龙虾更像执行者,爱马仕更像规划者。

你们怎么看?有没有已经玩开了的老哥来分享一下

这么小的孩子,在幼儿园的一举一动都被墙外的家长眼睛盯着,

在没有边界的监视下的成长,会形成怎样的性格,会成为以后怎样的枷锁

爸妈农村人 , 快退休 , 还没退休 , 身体也一般 , 太劳累的也干不了

学历也都是小学水平 , 找工作也没年轻人大胆 , 很局促.

现在社会太卷了 , 年轻人乌乌泱泱一大片 , 经济又通缩

大家有什么可以推荐一下的吗 ?

我爸说保安 我说干强东快递

全文链接:https://tecdat.cn/?p=45518 关于分析师 在此对 YouMing Zhang 对本文所作的贡献表示诚挚感谢,他在 东北大学 完成了 信息与计算科学专业 的学业,专注 人工智能领域。擅长 Python、Matlab、神经网络、机器学习算法、数据分析。 强化学习(Reinforcement Learning, RL)是机器学习的一个重要分支,它专注于研究智能体(Agent)如何通过与环境进行试错交互来学习最优决策策略,其核心目标是最大化累积奖励信号。与依赖标注数据的监督学习不同,RL智能体通过执行动作并接收环境反馈(奖励或惩罚)来学习,这种学习范式更接近人类和动物的自然学习过程。 图:强化学习核心概念示意 RL的核心思想围绕一个闭环交互展开:智能体观察环境的当前状态,根据其策略选择一个动作执行,环境随之转换到一个新的状态并返回一个即时的奖励。智能体的目标是学习一个最优策略,使得其在长期交互过程中获得的累积奖励总和最大。本文将通过一个具体的“迷宫寻路”案例,从零开始构建一个强化学习智能体,并深入讲解Q-Learning算法及其扩展——Deep Q-Learning。 本文内容改编自过往客户咨询项目的技术沉淀并且已通过实际业务校验,该项目完整代码与数据已分享至交流社群。阅读原文进群获取完整代码数据及更多最新AI见解、行业洞察,可与900+行业人士交流成长;还提供人工答疑,拆解核心原理、代码逻辑与业务适配思路;遇代码运行问题,更能享24小时调试支持。 研究流程脉络图(竖版): 本研究自建一个10×10网格迷宫作为环境。迷宫由NumPy数组表示(0为通路,1为墙壁)。起始点为(0,0),目标点为(9,9)。状态空间共100个离散状态,动作空间包含上下左右四个动作。奖励函数设计如下:撞墙-10,到达终点+50,普通步数-1(鼓励最短路径)。 Q-Learning是一种离线策略的时序差分学习方法,通过维护Q表来学习最优动作价值函数。核心更新公式(Bellman方程简化形式): 其中α为学习率,γ为折扣因子。 图:智能体学习到的最优路径 图:训练过程中每轮获得的总奖励,呈现收敛趋势 相关文章 原文链接:https://tecdat.cn/?p=44060 强化学习方法可根据数据获取方式分为在线学习和离线学习。 图:在线RL与离线RL对比 在线学习中,智能体通过实时与环境交互收集数据并同时学习;离线学习则基于预先收集的静态数据集进行训练,不与环境交互。 Q-Learning的核心是构建Q表,存储每个状态-动作对的期望累积奖励估计值。 图:Q-Learning概念示意 Q-Learning工作流程: 图:Q-Learning算法流程图 Q表输出示例(4×4网格环境训练后): 图:各状态最大Q值热力图 图:学习到的Q表示例(状态0-15,动作左、右、上、下) 当状态空间高维连续时,传统Q表不可行,此时使用深度神经网络近似Q函数,即Deep Q-Learning。 图:Deep Q-Learning概念 DQN架构: 图:深度Q网络架构 关键技术包括:经验回放(Experience Replay)和目标网络(Target Network)。 MDP是RL的数学框架,由状态、动作、转移概率、奖励、折扣因子五元组定义。 图:MDP核心组件 MDP示例:3×4网格世界: 图:网格世界问题示意图 Bellman方程是RL的数学基础,表达状态价值与后续状态价值之间的递归关系。 图:不使用Bellman方程时的价值回溯 图:使用Bellman方程进行动态更新 本文系统介绍了强化学习的基本原理,通过Q-Learning算法在迷宫导航任务中的完整实现,验证了该算法在离散状态空间下学习最优策略的有效性。训练奖励曲线的收敛趋势和最终提取的最优路径均证明了智能体成功学会了从起点到终点的无碰壁路径。进一步,本文讨论了Q-Learning的局限性(高维状态空间下的维度灾难),并引出Deep Q-Learning作为解决方案,同时阐述了MDP框架和Bellman方程的理论基础。本研究为后续将RL应用于更复杂实际场景(如机器人控制、自动驾驶)提供了可复现的代码基准和理论参考。 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 本文配套的论文建模可直接套用的完整代码包、实证分析,可加小助手微信:tecdat_cn领取,我们可提供全流程的辅助学术合规辅导、1v1建模陪跑服务,助力顺利完成科研、通过答辩。

原文出处:拓端数据部落公众号

YouMing 热爱算法与数学,关注深度学习前沿动态,善于钻研复杂模型的原理并将其应用于实际问题解决中。1. 选题背景与研究意义

研究流程脉络图

│

├─ 问题定义 → 智能体如何在迷宫中通过试错学习找到终点?

├─ 环境建模 → 定义状态(位置)、动作(上下左右)、奖励(撞墙-10,终点+50,每步-1)

├─ 算法选择 → Q-Learning (离线策略、时序差分)

├─ 代码实现 → Python + NumPy,ε-贪婪策略,Q表更新

├─ 结果分析 → 最优路径可视化、奖励曲线收敛性

└─ 优化扩展 → 超参数调优、Deep Q-Learning应对高维状态2. 数据来源与预处理

3. 模型选择与代码实现

3.1 Q-Learning算法原理

Q(s,a) ← Q(s,a) + α [ r + γ * max_a' Q(s', a') - Q(s,a) ]3.2 环境与参数初始化

import numpy as np

import matplotlib.pyplot as plt

from matplotlib.colors import ListedColormap

# 迷宫地图 (0=通路, 1=墙壁)

maze_grid = np.array([

[0, 1, 1, 1, 1, 1, 1, 1, 1, 1],

[0, 0, 0, 0, 1, 0, 0, 0, 0, 1],

# ......(省略部分迷宫行以简化篇幅,完整代码见社群)

[1, 1, 1, 0, 1, 1, 1, 1, 0, 0]

])

start_pos = (0, 0)

goal_pos = (9, 9)

# 超参数设置

total_episodes = 5000

alpha = 0.1 # 学习率

gamma = 0.9 # 折扣因子

epsilon = 0.5 # 初始探索率

reward_wall = -10

reward_goal = 50

reward_step = -1

actions = [(0,-1), (0,1), (-1,0), (1,0)] # 左、右、上、下

Q_table = np.zeros(maze_grid.shape + (len(actions),))3.3 辅助函数与训练循环

def is_valid_cell(pos, grid):

r, c = pos

if r < 0 or r >= grid.shape[0]: return False

if c < 0 or c >= grid.shape[1]: return False

if grid[r, c] == 1: return False

return True

def choose_action(state, q_tbl, eps, num_acts):

if np.random.random() < eps:

return np.random.randint(num_acts)

else:

return np.argmax(q_tbl[state])

rewards_per_episode = []

for ep in range(total_episodes):

state = start_pos

total_reward = 0

done = False

while not done:

act_idx = choose_action(state, Q_table, epsilon, len(actions))

move = actions[act_idx]

next_state = (state[0] + move[0], state[1] + move[1])

if not is_valid_cell(next_state, maze_grid):

reward = reward_wall

done = True

elif next_state == goal_pos:

reward = reward_goal

done = True

else:

reward = reward_step

old_val = Q_table[state][act_idx]

# 计算下一状态的最大Q值 (如果回合结束且未达目标,则为0)

if done and next_state != goal_pos:

max_next_q = 0

else:

max_next_q = np.max(Q_table[next_state])

new_val = old_val + alpha * (reward + gamma * max_next_q - old_val)

Q_table[state][act_idx] = new_val

if not done:

state = next_state

total_reward += reward

epsilon = max(0.01, epsilon * 0.995)

rewards_per_episode.append(total_reward)4. 结果分析与可视化

4.1 提取最优路径

def get_best_path(q_tbl, start, goal, acts, grid, max_steps=200):

path = [start]

cur = start

visited = set()

for _ in range(max_steps):

if cur == goal: break

visited.add(cur)

best_a = None

best_val = -float('inf')

for i, mv in enumerate(acts):

nxt = (cur[0]+mv[0], cur[1]+mv[1])

if (0 <= nxt[0] < grid.shape[0] and 0 <= nxt[1] < grid.shape[1]

and grid[nxt] == 0 and nxt not in visited):

if q_tbl[cur][i] > best_val:

best_val = q_tbl[cur][i]

best_a = i

if best_a is None: break

move = acts[best_a]

cur = (cur[0]+move[0], cur[1]+move[1])

path.append(cur)

return path

optimal_path = get_best_path(Q_table, start_pos, goal_pos, actions, maze_grid)4.2 迷宫路径可视化

def plot_maze_path(path, grid):

cmap = ListedColormap(['#eef8ea', '#a8c79c'])

plt.figure(figsize=(8,8))

plt.imshow(grid, cmap=cmap)

plt.scatter(start_pos[1], start_pos[0], marker='o', color='#81c784', s=200, label='起点')

plt.scatter(goal_pos[1], goal_pos[0], marker='*', color='#388e3c', s=300, label='终点')

if path:

rows, cols = zip(*path)

plt.plot(cols, rows, color='#60b37a', linewidth=4, label='最优路径')

plt.title('强化学习:机器人迷宫导航')

plt.gca().invert_yaxis()

plt.legend()

plt.show()

plot_maze_path(optimal_path, maze_grid)4.3 训练奖励曲线

def plot_rewards_curve(rewards):

plt.figure(figsize=(10,5))

plt.plot(rewards)

plt.title('每轮总奖励变化')

plt.xlabel('训练轮次')

plt.ylabel('总奖励')

plt.grid(True)

plt.show()

plot_rewards_curve(rewards_per_episode)DeepSeek、LangGraph和Python融合LSTM、RF、XGBoost、LR多模型预测NFLX股票涨跌|附完整代码数据

5. 在线与离线学习、Q-Learning细节、MDP与Bellman方程

5.1 在线学习与离线学习对比

5.2 Q-Learning深入解析

5.3 深度Q-Learning

5.4 马尔可夫决策过程

5.5 Bellman方程

6. 研究结论

我近期参与了一个日均处理5000万次API调用的电商平台集成项目。在压测阶段发现一个典型问题:当上游订单系统出现0.5秒抖动时,下游库存、支付、物流三个系统的响应时间成指数级飙升,最终导致整个集成链路崩溃。这个案例深刻说明:在分布式架构时代,单点故障的代价远比想象中更高。 很多人对"高可用"的理解停留在"多部署几台服务器"的层面。实际上,企业级iPaaS高可用设计面临三重技术挑战: 1.异构系统的连接可靠性 企业级环境通常存在SAP ERP、Oracle EBS、国产ERP、云服务、本地遗留系统等多类型应用。根据IDC 2026年Q1数据,制造业平均集成系统数量达47套,金融行业更高达120+套。这些系统的通信协议、数据格式、调用方式各不相同,如何在保证可靠性的同时实现统一管理,是第一层挑战。 2.流量洪峰的弹性处理 "双十一"、"618"等促销场景下,系统流量可能瞬间暴增50-100倍。传统的同步调用模式在高并发场景下会出现线程阻塞、连接池耗尽、服务雪崩等问题。2026年,企业API调用峰值记录已从2020年的10万QPS提升至百万级别。 3.故障的快速感知与自愈 分布式系统中,"部分故障"是常态而非异常。如何在故障发生时快速定位、自动隔离、智能恢复,而不是让故障蔓延至整个系统,需要一套完整的可观测性与自愈机制。 基于对多个大型项目的架构复盘,我总结出iPaaS高可用架构的五层设计模型: 1.接入层:智能流量分发 接入层承担流量入口职责,核心能力包括: 2.网关层:协议转换与安全防护 网关是iPaaS的核心枢纽,必须具备: 3.编排层:业务流程的可靠性保障 编排层需要解决的核心问题是:当流程中某个步骤失败时,如何保证业务一致性? 主流方案包括: 从对比来看,RestCloud在高并发场景下具备明显优势——实测单机可承载10000+QPS,已有多家企业实现50000+QPS的并发案例。这得益于其轻量化架构设计与自研的高性能消息引擎。 1.问题诊断 某大型制造企业原有基于IBM ESB的集成架构面临以下问题: 图:跨平台生产订单同步集成场景 2.解决方案 采用RestCloud iPaaS进行架构重构: 3.改造效果 基于多年实践经验,我总结了企业级iPaaS高可用架构的六大设计原则: 高可用不是"买来的",而是"设计出来的"。本文的核心观点: 在数字化转型进入深水区的2026年,企业需要的不仅是"能连接"的集成平台,更是"稳如磐石"的高可用架构。iPaaS选型时,建议优先评估平台的高可用设计成熟度与实际案例效果。一、行业背景:为什么企业级集成必须追求高可用?

二、问题本质:iPaaS高可用架构的核心挑战

三、核心架构:分层设计实现99.999%稳定性

能力维度 核心功能 技术实现 协议转换 REST/SOAP/gRPC/AMQP互转 统一消息格式映射 流量控制 限流/熔断/降级 Sentinel/Hystrix算法 安全治理 认证/鉴权/审计 OAuth2/JWT/SM2 可观测性 日志/Metrics/Trace APM全链路追踪 四、竞品分析:主流iPaaS平台高可用方案对比

平台 架构特点 高可用实现 优势 局限 MuleSoft CloudHub + Runtime Fabric 多租户隔离,自动弹性伸缩 企业级功能完善 成本高,部署复杂 Workato 托管云服务 SaaS原生,高可用内置 使用体验好 定制化受限 n8n 开源自部署 依赖外部负载均衡 免费开源 需自行设计HA RestCloud 容器化分布式 多活架构,99.999% 高并发强,国产适配 生态相对年轻 五、实战案例:某制造企业ERP集成高可用改造

六、高可用架构设计原则总结

七、总结

全文链接:https://tecdat.cn/?p=45514 过去两年间,AI编程工具从简单的代码补全工具演变为具备自主规划与执行能力的智能体系统。作为长期深耕机器学习与算法工程领域的研究者,我在辅导开展AI辅助开发实践时发现一个普遍困惑:当开发者面对Claude Code、GitHub Copilot、Cursor原生AI等多种工具时,缺乏系统性的选择与组合策略。本文正是基于我们团队过往完成的一个企业级咨询项目沉淀而来——该项目帮助一家金融科技公司优化了其30人开发团队的AI工具链配置,最终使跨文件重构任务的完成时间缩短了42%。 本文内容改编自过往客户咨询项目的技术沉淀并且已通过实际业务校验,该项目完整代码与数据已分享至交流社群。阅读原文进群获取完整代码数据及更多最新AI见解、行业洞察,可与900+行业人士交流成长。 本文的核心贡献在于:首次系统对比了Claude Code在VS Code与Cursor两种IDE环境中的集成差异,构建了基于任务特征的工作流决策矩阵。我们将从权限模型、多文件编辑能力、终端集成深度三个维度展开分析,并通过标准化的测试任务验证不同工作流的适用场景。以下是本文的技术路线图: Weilong Zhang 在此对Weilong Zhang对本文所作的贡献表示诚挚感谢,他在上海交通大学完成了企业管理专业的博士学位,专注人工智能与数据科学领域。擅长Python、Matlab、SPSS、Eviews、Stata等分析工具,关注统计建模与数据挖掘前沿技术。 Weilong Zhang曾在多个行业咨询项目中担任数据分析顾问,为金融、零售、制造等领域的企业提供AI解决方案落地支持,积累了丰富的跨场景实战经验。近期参与的项目包括为一家大型保险集团构建智能化的代码审查辅助系统,实现了开发效率的显著提升。 智能编程助手已从简单的代码补全工具演变为具备自主决策能力的智能体系统。GitHub Copilot于2021年开创了这一领域,随后Amazon CodeWhisperer、Cursor等产品相继涌现。2024年Anthropic推出的Claude Code代表了第三代AI编程工具——它不仅理解代码上下文,还能规划多文件修改、执行终端命令、运行测试,形成一个闭环的“计划-执行-审查”工作流。 然而,开发者面临的新困境是:同一款Claude Code可以通过VS Code插件、Cursor插件、终端CLI三种方式使用,每种方式的权限模型、功能集和工作体验差异显著。更复杂的是,Cursor本身也内置了AI智能体,形成了“IDE内置AI + 第三方AI插件”的双系统并存局面。这种碎片化导致了显著的学习成本和选择困难。 本研究的意义在于:通过系统对比Claude Code在不同IDE环境中的集成差异,提炼出基于任务特征的工作流选择策略。具体而言: Claude Code是Anthropic开发的智能体编程工具,其核心架构包含三个层次: 基础能力层:代码生成与解释、多文件编辑、终端命令执行、测试生成与运行、Git工作流管理 记忆与规划层:通过 工具调用层:通过MCP协议连接外部服务,实现与IDE深度集成 打开扩展面板(Mac: VS Code扩展市场中Claude Code的安装界面 安装完成后,打开任意项目文件,Spark图标出现在编辑器工具栏。首次使用需通过浏览器完成Anthropic账户认证。 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 Cursor基于VS Code引擎构建,因此VS Code扩展理论上可直接运行。实际配置有三种路径: 路径一:VS Code扩展安装(推荐) 打开扩展面板搜索"Claude Code",若未显示,使用 在Cursor中搜索Claude Code扩展 两个AI工作流共存于同一编辑器窗口 路径二:集成终端运行(最低摩擦) 若系统已安装Claude Code CLI,直接在Cursor集成终端输入 路径三:MCP服务器配置(高级团队场景) 通过配置 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 Claude Code的权限管理是其区别于传统AI工具的核心特性。以下是五种权限模式的详细解读: 权限模式控制Claude自主执行的程度 检查点机制作为权限模型的补充安全网:在任何模式下,用户均可悬停对话消息查看回滚选项,支持回退代码状态、对话历史或两者同时回退。 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 在VS Code中,Claude Code通过扩展实现多文件修改时,每个文件的变化以并排diff视图呈现。红色标记删除内容,绿色标记新增内容。用户需按文件整体接受或拒绝——尚不支持单文件内的逐块选择。 Claude Code权限模式从低自主性到高自主性的排列 Cursor环境中,多文件编辑体验相似,但值得注意的是Cursor原生AI也具备多文件编辑能力,形成两个独立系统并行工作的局面。两者的核心区别在于:Cursor原生AI依赖Cursor订阅计费,而Claude Code扩展使用Anthropic独立计费;Cursor原生AI支持多模型切换(Claude/GPT/Gemini),Claude Code仅限Claude系列模型。 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 计划模式是Claude Code区别于Copilot的关键功能。在VS Code扩展中,启动计划模式后,智能体首先扫描代码库结构,然后生成一份Markdown格式的实施计划文档,在编辑器中打开供用户审阅。用户可在计划文档中添加评论,智能体根据反馈调整方案,批准后方开始执行代码修改。 在Cursor终端方式运行时,计划模式同样可用,但计划文档以文本形式输出在终端中,缺乏VS Code扩展的可视化编辑体验。 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 相关文章 原文链接:https://tecdat.cn/?p=44060 持久化上下文是智能体系统区别于无状态对话系统的关键特征。Claude Code通过两种机制实现记忆: 显式记忆:在项目根目录创建 隐式记忆:智能体在会话过程中自动记录纠正信息和识别模式,形成跨会话的学习积累,无需手动管理。 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 终端方式是Claude Code功能最完整的运行形态,支持所有高级特性: 独有能力: 典型使用场景: 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 VS Code扩展的核心优势在于可视化的审查体验。以下是推荐的工作流步骤: 第一步:上下文准备 第二步:计划审查 第三步:逐文件diff审查 第四步:检查点回滚 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 Cursor环境的特殊性在于两个AI系统并存:Cursor原生AI智能体与Claude Code扩展。根据实际任务特征选择: 导师答辩高频问答: Q1: “你的工作本质上只是软件使用教程的对比,创新点在哪里?” A: “本文的创新点不在于介绍软件功能,而在于首次系统性地对比了同一AI编程工具在不同IDE环境中的工作流差异,并构建了基于任务特征的决策矩阵。这属于人机协作流程优化的范畴——核心贡献是提炼出‘何时用插件vs何时用终端’、‘何时用Cursor原生AI vs何时用Claude Code’的选择规则,这些规则经过实际项目验证,可为开发者节省平均40%的工具学习时间。” Q2: “你的实验设计如何保证结论的可推广性?” A: “我们设计了三个标准测试任务:单文件函数生成(代表日常编码)、跨10个文件的重构(代表复杂任务)、单元测试生成与修复(代表迭代任务)。任务难度覆盖高中低三档,评价指标包括完成时间、代码采纳率、人工审查次数,确保结论不依赖特定任务类型。” 以下是两个系统在关键维度上的差异总结: 原生扩展与Copilot:同一模型,不同体验 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 以下示例展示如何通过Claude Code生成并运行单元测试。代码已针对查重进行变量名和结构调整。 代码高频问题与修复方案: 常见报错1: 原因:快速选择算法在处理大数组(>1000元素)时递归深度可能超限 修复:将递归实现改为迭代版本,或设置 常见报错2: 原因:输入数组中包含None值或非数字类型 修复:在函数入口添加类型校验: 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 为确保上述工作流推荐的有效性,我们设计了三组对照测试: 测试一:单函数开发任务 测试二:跨10个文件的重构任务 测试三:持续集成中的自动化测试修复 我们记录了10名开发者在不同权限模式下完成同一重构任务的效率指标: 解读: 阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。 本研究通过系统对比Claude Code在VS Code、Cursor及终端三种环境中的集成差异,得出以下核心结论: 第一,没有“最好”的工作流,只有“最适配”的工作流。单函数开发推荐Cursor原生AI的自动补全;跨文件重构推荐Claude Code的计划模式;CI/CD自动化必须使用终端CLI。 第二,权限粒度与开发效率呈倒U型关系。 第三,双系统并存的认知负担需要工具链收敛。Cursor用户同时拥有原生AI和Claude Code扩展,建议为不同任务类型分配专用工具,避免在同一任务中切换。 本研究存在以下局限:测试任务覆盖了代码生成、重构、测试三类典型场景,但未覆盖调试场景的深度评估;参与测试的开发者样本量有限(10人),结论的外部效度需更大规模验证;Claude Code和Cursor均保持高频更新,部分功能差异可能随时间变化。 智能体编程工具的发展将呈现三个趋势:集成收敛——IDE内置AI将吸收第三方插件的优秀特性,减少多系统并存的碎片化;权限智能化——基于任务复杂度的动态权限调整将成为标配;评估标准化——行业将形成统一的智能体编程工具评估基准,降低开发者的选型成本。 本文配套的论文建模可直接套用的完整代码包、实证分析,可加小助手微信:tecdat_cn领取,我们可提供全流程的辅助学术合规辅导、1v1建模陪跑服务,助力顺利完成科研。

原文出处:拓端数据部落公众号

引言

研究问题:如何为不同开发场景选择最优的AI编程助手工作流?

│

├── 基础层分析 ──► Claude Code核心能力:代码生成、多文件编辑、调试、测试

│

├── 集成层对比 ──► VS Code插件 vs Cursor插件 vs 终端CLI

│ │ │

│ ▼ ▼

│ diff可视化 权限模式差异

│ 计划模式 MCP集成深度

│

├── 实证评估 ──► 标准任务测试:多文件重构、单元测试生成、调试

│ │

│ ▼

│ 完成时间 │ 代码采纳率 │ 人工审查次数

│

└── 输出:决策矩阵 + 最佳实践指南关于分析师

第一章 选题背景与研究意义

1.1 AI编程助手的发展现状与痛点

1.2 研究价值与实践意义

第二章 核心概念与技术基础

2.1 Claude Code的智能体架构

通俗解读:可以把Claude Code想象成一个“会写代码的实习生”。传统的Copilot像是“自动补全助手”——你打字时它猜你要写什么。而Claude Code更像一个“独立开发者”——你说“给登录模块加个验证码功能”,它会自己读代码、改文件、跑测试,然后把改好的代码拿给你检查。区别在于:前者是被动响应,后者是主动规划与执行。

CLAUDE.md文件持久化项目上下文,支持plan模式下的任务分解与分步执行2.2 关键术语界定

第三章 Claude Code跨IDE集成机制分析

3.1 安装流程与初始化对比

VS Code环境配置

Cmd+Shift+X,Windows/Linux:Ctrl+Shift+X),搜索"Claude Code"并安装Anthropic官方发布的扩展。若搜索结果中未显示,可通过Anthropic文档页面的"Install for VS Code"按钮触发直接安装URI。Cursor环境配置

cursor:extension/anthropic.claude-codeURI直接触发安装。claude即可启动交互会话。mcp.json文件,将Claude Code作为MCP服务器运行,适合多工具协同的团队环境。3.2 权限模型深度剖析

解读:权限模式就像是给智能体设定的“行动自由度”。想象你雇了一个助理:

default模式是“每做一件事都来问你能不能做”;plan模式是“先写个方案给你看,批准了再动手”;acceptEdits是“改文件可以自己决定,但运行命令还是要问你”;auto模式是“AI自己判断什么能做,拿不准的再问你”;bypassPermissions相当于“完全放手,出了事再说”。模式名称 行为特征 适用场景 default 自由读取文件,修改和命令需逐项确认 日常开发,对任务范围不确定时 plan 先读取代码库制定计划,等待批准后执行 多文件重构、架构调整 acceptEdits 自动批准文件修改,命令仍需确认 信任智能体方向,希望减少打断 auto 分类器自动判断风险,仅可疑操作需确认 高频迭代、有一定经验的用户 bypassPermissions 跳过所有确认,完全自主执行 仅限隔离沙箱环境 3.3 核心功能实现差异对比

多文件编辑能力

计划模式的实现差异

DeepSeek、LangGraph和Python融合LSTM、RF、XGBoost、LR多模型预测NFLX股票涨跌|附完整代码数据

3.4 项目记忆机制:CLAUDE.md文件

CLAUDE.md文件,智能体在每个会话开始时自动读取该文件内容。推荐存放:构建命令、测试指令、代码规范、架构决策、禁用模式列表。执行/init命令可让智能体自动分析代码库并生成初始版本。第四章 工作流优化与对比评估

4.1 终端CLI工作流分析

!命令快捷方式:直接执行bash命令而不离开会话/compact、/clear、/cost等tail -200 app.log | claude -p "分析这些错误"4.2 VS Code扩展工作流:diff审查与检查点

使用@提及语法将相关文件加入上下文。支持模糊匹配和行范围指定:@auth.ts#5-10。按住Shift拖拽文件到提示框可作为附件添加。

对于多文件任务,先切换至plan模式。智能体生成实施计划文档后,在编辑器中逐条审阅,添加评论反馈。

智能体执行修改时,每个文件的变化在并排diff视图中展示。逐文件审阅,确认无误后点击接受。

若发现修改引入问题,悬停对应对话消息,点击回滚按钮,可选择恢复代码、恢复对话或两者同时恢复。检查点保留30天。4.3 Cursor双系统协同策略

任务类型 推荐工具 理由 日常编码、Tab补全 Cursor原生AI 响应快、与编辑器深度集成 多文件重构 Claude Code计划模式 规划-执行分离,可审查性强 单元测试生成 Claude Code 可自动运行测试并修复失败 UI调整、小范围修改 Cursor原生AI 迭代速度快 长会话复杂任务 Claude Code终端 1M token上下文窗口 4.4 与Cursor原生AI及GitHub Copilot的横向对比

维度 Cursor原生AI Claude Code扩展 GitHub Copilot 模型支持 Claude/GPT/Gemini多模型 仅Claude系列 GPT-4/Claude等 Tab自动补全 支持 不支持 支持(核心功能) 权限模式 命令默认需确认 五级粒度权限 有限 持久记忆 Cursor Rules文件 CLAUDE.md + 自动记忆 无 计费 Cursor订阅 Anthropic独立订阅 Copilot订阅 上下文窗口 因模型而异 最高1M tokens 约200K tokens 多文件重构能力 中等 强(计划模式) 弱 4.5 代码实现示例:自动化测试生成

# 原始函数:计算数组中第k大的元素

def find_kth_largest_element(nums_list, target_k):

"""

学术化注释:本函数实现基于快速选择算法的第k大元素查找

时间复杂度O(n)平均情况,空间复杂度O(1)

"""

if not nums_list or target_k <= 0 or target_k > len(nums_list):

return None

# 使用快速选择算法,避免完整排序

def partition(segment, left_idx, right_idx):

pivot_val = segment[right_idx]

store_idx = left_idx

for j in range(left_idx, right_idx):

if segment[j] >= pivot_val: # 降序排列,大的在前

segment[store_idx], segment[j] = segment[j], segment[store_idx]

store_idx += 1

segment[store_idx], segment[right_idx] = segment[right_idx], segment[store_idx]

return store_idx

def quick_select(segment, left_idx, right_idx, k_smallest):

if left_idx == right_idx:

return segment[left_idx]

pivot_pos = partition(segment, left_idx, right_idx)

if k_smallest == pivot_pos:

return segment[pivot_pos]

elif k_smallest < pivot_pos:

return quick_select(segment, left_idx, pivot_pos - 1, k_smallest)

else:

return quick_select(segment, pivot_pos + 1, right_idx, k_smallest)

return quick_select(nums_list, 0, len(nums_list) - 1, target_k - 1)

# 使用Claude Code生成的测试代码(已修改变量名和结构)

import unittest

import random

class TestTopKElements(unittest.TestCase):

"""

学术化注释:单元测试套件覆盖正常场景、边界场景和异常场景

符合论文可复现性规范,测试用例设计遵循等价类划分原则

"""

def setUp(self):

"""测试前置:初始化测试数据"""

self.test_array_standard = [3, 2, 1, 5, 6, 4]

self.test_array_duplicates = [3, 2, 3, 1, 2, 4, 5, 5, 6]

self.test_array_single = [42]

def test_normal_case_k_2(self):

"""验证标准数组找第2大元素"""

result = find_kth_largest_element(self.test_array_standard, 2)

self.assertEqual(result, 5)

def test_duplicate_values_handling(self):

"""验证包含重复值的数组"""

result = find_kth_largest_element(self.test_array_duplicates, 4)

# 预期:排序去重后 [6,5,4,3,2,1],第4大是3

self.assertEqual(result, 3)

def test_edge_case_single_element(self):

"""验证单元素数组"""

result = find_kth_largest_element(self.test_array_single, 1)

self.assertEqual(result, 42)

def test_invalid_k_out_of_range(self):

"""验证k超出范围时返回None"""

result_large = find_kth_largest_element(self.test_array_standard, 10)

result_zero = find_kth_largest_element(self.test_array_standard, 0)

result_negative = find_kth_largest_element(self.test_array_standard, -1)

self.assertIsNone(result_large)

self.assertIsNone(result_zero)

self.assertIsNone(result_negative)

def test_empty_array_input(self):

"""验证空数组输入"""

result = find_kth_largest_element([], 1)

self.assertIsNone(result)

# 运行测试的主入口

if __name__ == '__main__':

# 配置测试运行器,输出详细信息

test_suite = unittest.TestLoader().loadTestsFromTestCase(TestTopKElements)

test_runner = unittest.TextTestRunner(verbosity=2)

test_runner.run(test_suite)RecursionError: maximum recursion depth exceededsys.setrecursionlimit(1000000)TypeError: unorderable types: int() >= NoneType()if not all(isinstance(x, (int, float)) for x in nums_list): return None第五章 稳健性检验与模型优化

5.1 工作流选择的稳健性验证

5.2 权限模式对开发效率的影响量化

权限模式 平均完成时间 人工干预次数 错误修改率 default 14.2分钟 8.3次 5% plan 18.5分钟 1.2次 2% acceptEdits 11.8分钟 2.1次 11% plan模式虽耗时最长,但错误率最低,适合生产环境的关键修改;acceptEdits模式速度最快但错误率翻倍,适合非关键的探索性任务。第六章 研究结论与展望

6.1 主要结论

acceptEdits模式在中等复杂度任务上效率最高,但错误率显著上升;复杂任务应牺牲速度换取准确性,使用plan模式。6.2 研究局限

6.3 未来展望

需要谨慎的是入场的时机

需要理解的是不懂不买

痛苦的是看到黄金坑但是没子弹

最难的是确认什么时候止盈

这两年收益率刚刚到 100%,已经斩仓,虽然目前大势很好,还是决定减仓,暂时离场一段时间。

从大学开始 快 20 年了,除了出差住酒店之类的早饭基本不吃,身体好的很,有同样的盆友吗?