Android移动安全第四章_ContentProvider安全

登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!

登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!

登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!

登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!登录吧!不然什么都看不到的!

一、概述总结 定位打卡引流活动系统是一款基于微信生态开发的LBS(基于位置服务)营销工具,专为需要线下引流、实地打卡、位置验证的商业场景设计。 该系统通过GPS定位技术,提前在后台设置多个打卡点位,引导用户前往指定地点完成打卡任务,最终兑换礼品或权益,实现从线上到线下的精准流量转化。系统支持微信小程序和抖音小程序双端部署,是微擎应用商城官方认证的商业级解决方案。 核心价值主张:将虚拟互动与实体场景深度融合,用"游戏化打卡"重塑线下获客模式,让每一次打卡都成为品牌与用户的真实触点。 二、功能介绍 ️ 1. 智能点位管理系统 三、适用场景与行业价值 ️ 核心适用场景 场景类型 具体应用 价值体现 旅游景区 景点打卡集章、景区寻宝活动、文化地标探访 提升游客停留时长,带动二次消费 连锁门店 多店联动打卡、新店开业引流、会员日专属活动 均衡各门店客流,提升到店率 商业地产 商场集章送礼、品牌联动打卡、节日主题活动 增加商场人气,促进租户销售 党建政务 红色教育基地打卡、社区服务签到、文明实践活动 创新党建形式,提升参与度 展会活动 展位打卡集点、演讲会场签到、互动体验区引流 优化人流分布,收集潜在客户 教育培训 校区探访打卡、线下课程签到、实践活动记录 增强家校互动,验证到课率 行业价值分析 对商家/运营方: 对用户/消费者: 四、技术参数与部署说明 项目 说明 适用平台 微信认证服务号、微信小程序 部署方式 微擎系统在线交付,源码加密保护 环境要求 支持PHP 5.4/5.5/5.6/7.1 隐私合规 获取用户信息(昵称、头像、性别、地区)、位置信息、相册权限 五、常见问题解答(Q&A) Q1:这个系统适合什么类型的企业使用? Q2:如何防止用户用虚拟定位作弊打卡? Q3:可以设置多少个打卡点位?有没有数量限制? Q4:用户打卡后如何兑换礼品?支持哪些核销方式? Q5:系统是否支持定制开发?比如加入AR打卡或AI识别? Q6:数据安全性如何保障?用户隐私是否符合法规? Q7:如果活动进行中需要临时增加打卡点位,可以实时修改吗?A:适合所有需要将用户从线上引导到线下实体场景的企业,包括旅游景区、连锁零售、商业地产、教育机构、政务单位等。特别适合有多点位布局、需要均衡客流或验证用户到场的场景。

A:系统采用多重防作弊机制:①原生GPS定位+基站定位双重验证;②可设置最小打卡停留时长;③异常定位行为风控拦截;④结合现场Wi-Fi或Beacon蓝牙辅助验证(高级定制)。

A:标准版本支持设置多个打卡点位,具体数量取决于服务器配置。一般建议单活动设置3-10个点位,既能形成任务链又不至于让用户疲劳。如需超大规模点位(如全城百店联动),可联系定制开发。

A:系统内置积分商城和核销系统,支持:①线上兑换线下核销(生成核销码到店出示);②直接发放微信卡券/优惠券;③积分抽奖;④邮寄实物礼品(填写收货地址)。核销方式支持扫码核销、密码核销、后台手动核销。

A:支持。基础版本提供标准定位打卡功能,如需AR实景导航、人脸识别打卡、AI场景识别等高级功能,可联系官方进行定制开发,根据需求评估开发周期和费用。

A:系统严格遵循《个人信息保护法》和微信平台规范:①仅获取必要的用户信息(昵称、头像、位置);②数据传输加密;③支持隐私协议自定义配置;④提供数据导出和删除功能,满足合规要求。

A:可以。后台支持实时增删改打卡点位,修改后用户端立即生效,无需重新发布小程序。但建议活动前充分测试,避免频繁变动影响用户体验。

一、概述总结 在线培训预约小程序系统是一款专为中小型培训机构量身打造的数字化管理解决方案,支持微信小程序和抖音小程序双平台部署。该系统整合了在线预约、视频教学、音频学习、作业打卡、会员管理等核心功能,帮助培训机构实现从招生引流到课程交付的全流程数字化运营。 系统采用PHP技术栈开发(支持PHP5.3-7.1),提供完整的前端用户端、教师端以及强大的后台管理系统,让机构管理者、教师和学员三方实现高效协同。 二、功能介绍 功能模块 详细说明 在线预约 学员可在线预约试听课程或正式课程,支持选择老师和时间段 在线视频 支持付费和免费视频课程,非会员可观看部分免费内容 在线音频 提供音频学习资源,满足碎片化学习需求 新闻活动 发布机构动态、活动通知、优惠信息等 今日教案 学员可实时查看当日课程教案内容 作业打卡 学员在家即可上传作业,支持图片、视频等多种形式 会员在线约课 成为会员后可预约专属课程,系统自动分配老师 课程到店核销 会员到店后扫码核销,支持线上/线下两种核销方式 数据统计看板: 核心管理模块: 模块 功能描述 系统设置 基础配置、短信设置、轮播图、栏目、公告、新闻、广告管理 平台课程 课程类型管理、普通课程发布、线上课程设置 会员管理 普通会员列表、到期会员提醒、会员开通/续费 老师管理 教师信息管理、权限分配 会员课程 会员专属课程设置与分配 课程评价 学员评价管理与展示 预约管理 预约记录查询、状态管理 作业打卡 作业审核、打卡记录统计 小票打印 打印模板设置、打印记录查询 三、适用场景与行业价值 适用场景 行业领域 典型应用场景 艺术培训 音乐、美术、舞蹈等艺术课程的在线预约与教学 语言培训 英语、小语种等语言课程的预约与音视频学习 K12教育 学科辅导课程的预约管理和作业打卡 职业技能 IT培训、职业资格认证等成人教育场景 体育健身 私教课程预约、团体课管理 兴趣教育 烘焙、摄影、手工等兴趣课程的预约服务 行业价值 对培训机构: 对教师: 对学员/家长: 四、常见问题解答(FAQ) Q1:这个系统适合什么规模的培训机构使用? Q2:非会员和会员有什么区别? Q3:如何实现课程核销?支持哪些方式? Q4:学员如何提交作业? Q5:系统是否支持多门店管理? Q6:系统对服务器环境有什么要求? Q7:教师如何帮助学员代约课程? Q8:系统如何提醒学员上课?A:系统专为中小型培训机构设计,无论是单店工作室还是拥有3-5家分校的连锁机构都能适用。后台支持多门店管理,可灵活扩展。

A:非会员可以浏览机构信息、观看免费视频内容、预约试听课程;成为会员后,可享受专属课程预约、完整视频库访问、作业打卡反馈等全部功能。

A:系统支持两种核销方式:(1) 线上核销 - 学员出示预约二维码,教师手机端扫码完成;(2) 线下核销 - 对接365云小票打印机,自动打印签到小票作为凭证。

A:学员通过小程序"作业打卡"功能,可直接上传图片、视频等形式的作业内容,教师在线查看并给予反馈,实现家校无缝连接。

A:是的,后台支持添加多个门店,设置各门店地址、经纬度坐标,学员预约时可选择就近门店上课。

A:系统基于PHP开发,支持PHP5.3/5.4/5.5/5.6/7.1版本,需要获取用户基本信息(微信昵称、头像、性别、地区)和位置信息用于门店定位。

A:教师端具备代客预约功能,教师可直接在手机上为会员选择课程、时间并完成预约,适合不熟悉手机操作的学员或家长。

A:预约成功后,系统会自动发送短信和微信模板消息双重提醒,同时在会员即将到期时也会发送续费提醒,有效降低爽约率和流失率。

Go 1.25 悄悄带来了一个实验性的新垃圾回收器,代号 Green Tea。在 Google 内部的生产环境中,多数服务的 GC CPU 开销降低了 10%,部分服务降低了高达 40%。Go 团队计划在 Go 1.26 将其设为默认 GC。 这篇文章从头讲清楚:现有 GC 为什么慢,Green Tea 改了什么,以及这个看似简单的想法背后藏着多少工程细节。 Go 的 GC 只关心两件事:对象(object) 和 指针(pointer)。 对象是堆上分配的内存块,指针是引用这块内存的数字地址。GC 的任务是找出哪些对象还在被程序使用,把剩下的回收掉。 Go GC 使用的是经典的 标记-清扫(mark-sweep) 算法,分两个阶段: 标记阶段(Mark):从一组"根"出发——全局变量、goroutine 栈上的局部变量——沿着指针向外遍历整个对象图,把访问过的对象全部标记为"存活"。这本质上就是一次图的广度/深度优先搜索。 清扫阶段(Sweep):遍历堆上所有对象,把没有被标记到的对象的内存标记为可用,供分配器复用。 算法本身并不复杂。但实际情况是,Go 程序可能有 20% 甚至更多的 CPU 时间花在 GC 上,这笔开销实在不小。 标记-清扫:从根出发遍历对象图,未访问的对象即为垃圾 对 GC 开销做分解分析,可以得到两个关键数据: 后者才是真正的根子。 图泛洪的工作模式决定了它在内存访问上的随机性: 两个相互引用的对象,在内存里未必相邻,往往差了几 KB 甚至几 MB。每次跳转,CPU 都要等待新地址的数据从主存加载进来。现代 CPU 的 L1 缓存命中只需 4 个时钟周期,而主存访问可能需要几百个周期——差了将近 100 倍。 更糟的是,每次扫描的工作量很小,而且高度依赖上一次的结果(得到指针之后才知道下一步去哪),CPU 的乱序执行和预取机制完全无法发挥作用。一位 Go 团队的工程师把这种情况直接称为"微架构灾难"。 L1 缓存与主存之间的延迟差距可达 100 倍 让人担忧的是,这个问题随着硬件发展在持续恶化: NUMA(非均匀内存访问):内存与 CPU 核心的亲和性越来越强,跨 NUMA 节点的内存访问比本地访问慢很多,而图泛洪无法感知这一点。 内存带宽下降:虽然 CPU 核心数不断增加,但单核可用内存带宽在下降,随机访问的代价更高了。 核心数增加:标记阶段是并行的,多个 goroutine 同时往一个共享的"待扫描对象队列"里放和取,队列竞争成为瓶颈。 向量指令无法利用:AVX-512 等向量指令擅长处理规整、连续的数据,而每次只处理一个大小不固定的对象,完全无法利用这类硬件加速。 Go 团队给出的解法只有一句话: 以页(page)为单位追踪和扫描,而不是以对象为单位。 Go 运行时中,页(page)是 8 KiB 的连续对齐内存块,同一页内的对象大小相同。这个特性,是 Green Tea 一切优化的基础。 原始 mark-sweep 的工作列表里放的是对象,Green Tea 的工作列表里放的是页。 同时,每个对象的元数据从 1 bit 变成 2 bit: 扫描流程变成: 关键变化在于:同一页内的多个对象被集中在一次工作流中处理,而不是每发现一个对象就立刻去追它的指针。工作列表使用先进先出(队列)而非先进后出(栈),目的是让页在队列中等待时,能尽量积累更多待扫描对象,从而在一次处理中扫更多内容。 博客里用了一个很形象的比喻: 原来的图泛洪像是在城市里开车——不断地转弯、停红灯、躲行人,引擎永远无法提速。 Green Tea 则是驶上高速公路——更少的转弯,更长的直线,CPU 终于可以连续地处理一段内存,让缓存预取机制发挥作用。 原始 mark-sweep 在上面的示例堆中需要 7 次独立扫描,频繁在不同页之间跳跃;Green Tea 只需 4 次扫描,多次在同一页内连续处理多个对象。 堆越大,这种效果越显著——因为同一页内积累的待扫描对象会更多。 Green Tea 还带来了另一个传统 GC 完全无法实现的能力:用向量指令批量处理整页的扫描元数据。 同一页内的所有对象大小相同,因此页内的所有元数据(seen bits、scanned bits、指针位图)都有固定的格式和规律。现代 x86 CPU 上的 AVX-512 提供 512 bit 宽的向量寄存器,恰好可以一次性容纳整页的元数据。 扫描内核的核心步骤大致如下: 这套流程几乎全部在 CPU 寄存器内完成,不需要随机访问内存,每次循环处理 64 字节。其中最关键的是 AVX-512 的 512 位宽寄存器,恰好可以容纳整页的元数据 对于传统的图泛洪,因为每个对象大小不同,元数据格式不固定,这条路完全走不通。Green Tea 以页为单位的设计,天然解决了这个前提条件。 根据 Go 团队公开的数据: 换算成整体 CPU 开销:如果一个服务原本有 10% 的时间在跑 GC,那么 10%~40% 的 GC 改善意味着整体节省 1%~4% 的 CPU。在大规模生产环境中,这是非常可观的数字。 Green Tea 已经在 Google 内部大规模上线,结果与基准测试一致。 不过,也有例外情况。Green Tea 的核心假设是"同一页内可以积累到足够多的待扫描对象"。如果程序的对象图非常稀疏,每次只能在同一页内扫到 1~2 个对象,那么 Green Tea 积累等待的开销反而会超过收益。Go 团队对这种情况做了特殊处理(单对象页直接走简化路径),但尚未完全消除这类场景下的回退。 Go 1.25(实验性,无向量加速): Go 1.26(计划成为默认,含向量加速): Go 团队目前正在收集反馈。如果遇到了性能回退或者看到了明显提升,建议在 GitHub Issue #73581 上回复,帮助团队改进 Go 1.26 的正式版本。 Green Tea 的"以页为单位"核心思想,看起来简单,实际上是 Go 团队多年探索的结果。 最初的想法可以追溯到 2018 年——有趣的是,团队里没有人记得到底是谁最先提出的,大家都以为是别人的主意。 2024 年,Austin Clements 日本四处寻觅咖啡馆,喝了无数抹茶,并由此构思出了早期版本的原型!这个原型证明了绿茶的核心理念是可行的。从此,便开始了绿茶的研发之路。GC 的代号"Green Tea",就是这样来的。2025 年,Michael Knyszek 完成了完整的实现和生产化,各种细节在过程中也不断演化调整。 从一个想法到可以大规模使用,中间有大量"行不通的中间方案"和"必须搞清楚的工程细节"。 上图 是Go 团队在博客里的一张时间线图,列出了 2018 年以来尝试过但被放弃的各种中间方案。 Green Tea GC 的核心改变,用一句话概括: 这个改变让 GC 的内存访问模式从随机跳跃变成连续扫描,进而让 CPU 缓存能够真正发挥作用,并且首次为 GC 标记阶段引入了 AVX-512 向量加速。 对于大多数 Go 服务来说,不需要改一行业务代码,只需要升级到 Go 1.25 并设置一个环境变量,或者等待 Go 1.26 正式发布,GC 开销就能有可见的改善。 参考资料:现有 GC 是怎么工作的

对象与指针

标记-清扫算法

问题出在哪里

随机跳跃的图泛洪

扫描对象 A → 发现指针 → 跳到内存某处的对象 B → 发现指针 → 跳到另一处的对象 C → …硬件趋势让问题越来越严重

Green Tea 的核心思想

具体改了什么

用公路比喻

扫描路径的直观对比

AVX-512 向量加速

VGF2P8AFFINEQB 这条指令——它来自 x86 的"Galois Field New Instructions"扩展,可以高效完成步骤 3 中的 bit 展开,只需几个 CPU 周期。实测效果

场景 GC CPU 开销降低 典型工作负载(众数) 约 10% 部分工作负载 最高 40% 向量加速(预期,Go 1.26) 额外再降 10% 如何启用

GOEXPERIMENT=greenteagc go build ./...# 不需要任何额外设置,默认即是 Green Tea

# 如需回退:

GOEXPERIMENT=nogreenteagc go build ./...这个想法从何而来

总结

把"追着对象跑"改成了"把一页内的事情做完再走"。

梗概: 在消费电子行业(如智能穿戴、IoT设备、智能家电)的实际项目中,项目管理往往面临着“软硬结合”的巨大挑战。一个完整的智能硬件项目,不仅包含软件代码的迭代,更涉及开模、打样、BOM(物料清单)评审、供应链验证等重度实体交付环节。 从一线团队反馈来看,传统的敏捷任务管理工具往往在此水土不服。核心痛点集中在: 在应对这些具有强实体属性的制造业痛点时,底层数据模型的设计决定了工具的承载上限。 我们从制造业项目的核心诉求出发,对飞书项目、Worktile、Ones 进行横向能力拆解。 飞书项目:底层为高度可配置的数据模型,原生支持复杂的业务流与状态机,对 IPD 流程的映射度极高。(评级:强) Ones:深耕研发工程管理,对代码库、测试用例的关联做得非常扎实,更偏向纯软件工程域。(评级:中) Worktile:轻量级、通用型的通用项目协同工具,任务看板体验流畅,适合中小团队或偏营销/运营类的项目。(评级:弱) 核心能力对比矩阵: 在复杂场景下差异明显体现在日常的执行细节中,以下是一线项目团队视角的实测反馈: 在实际的项目落地经验中,项目管理工具往往会经历从“任务分配器”到“流程卡点器”,再到“企业协同中枢”的演进。 对于轻量级互联网产品,基础的看板工具已然足够;而对于代码驱动的纯软件研发,深耕工程域的工具也有其一席之地。但在消费电子这样软硬交织、流程极重、容错率极低的行业,管理的本质是对确定性的追求。飞书项目不止是一个协同工具,其底层灵活的数据结构与强约束的流程引擎,展现出了构建复杂业务系统的底座能力,在应对消费电子项目的严苛要求时,表现出了更高的业务契合度与管理纵深。 如果你正在为团队寻找合适的硬件研发管理路径,建议参考以下真实落地案例及开箱即用的最佳实践模板:

消费电子行业正面临极短的研发周期与复杂的跨域协同挑战。本文基于多款企业级项目管理工具的落地经验,深度拆解飞书项目、Worktile与Ones在制造业硬件研发场景下的实际表现。从需求链到交付物管理,带你还原真实业务痛点,寻找最契合复杂硬件生命周期的管理底座。一、行业背景及项目管理痛点

二、核心能力拆解

能力维度 飞书项目 Ones Worktile IPD门径与强管控机制 强(支持复杂规则引擎与卡点) 中(偏软件状态流转) 弱(偏向基础任务检查项) 软硬件跨域协同流转 强(支持多类型工作项互联) 中(侧重研发域内部协同) 中(通用任务流转) 复杂制造业字段自定义 强(对象级自定义,自由度极高) 中(支持基础自定义字段) 弱(基础表单拓展) 三、实际使用体验(重点模块)

四、典型实践场景

场景一:NPI(新产品导入)阶段的 Stage-Gate 评审

场景二:软硬件联合 Debug 溯源

五、总结

六、推荐阅读

https://project.feishu.cn/

https://project.feishu.cn/home/template

保密说明:为保护该组织及其客户的隐私与安全,本案例以匿名形式发布。以下内容基于真实项目实践整理。 该项目由一支长期从事企业管理与流程系统实施的团队负责。团队在企业管理、石油石化等行业积累了丰富经验,熟悉流程复杂、需求多变、交付环境受限的企业级项目。 过去,团队主要采用传统定制开发方式,类似规模的项目从调研到交付通常需要接近 1 年。 本次项目中,客户提出了明确的约束条件: 在此基础上,系统还需要具备良好的环境兼容性,能够稳定承载复杂 OA 场景下的流程、数据与系统集成。 在这些约束下,团队需要一个既满足私有化与自主可控要求,又能支持快速交付、持续迭代和后续扩展的技术底座。 最终,他们选择了 NocoBase。 项目第一阶段,项目团队先从客户最核心、最迫切的行政与财务管理场景入手,将原本依赖纸质表单流转的流程逐步迁入系统。 围绕日常行政管理,团队陆续完成了接近 60 个模块的建设,把原来分散在线下、依赖纸面和人工传递的流程,纳入了统一的电子化管理体系。 在具体实现上,团队并非简单“表单上云”,而是对流程进行了结构化重构: 基于 NocoBase 的能力,团队最终完成了复杂 OA 流程的系统化落地,使流程可以长期稳定运行。 此前,客户的预算管理主要依赖 Excel,各部门预算分散,通常只能事后统计与监管,难以在申请阶段进行有效控制。 项目团队结合过往财务与流程项目经验,将预算与出差、审批、报销等流程打通,帮助客户建立了一套完整的预算管理机制。 系统上线后,不同角色都可以实时查看预算使用情况,并在申请阶段完成额度控制与校验: 预算不再是一个独立模块,而是嵌入到业务流程中。基于 NocoBase 的流程配置能力,预算管理从“事后统计、事后监管”,转变为“事前控制 + 过程管控 + 实时校验”的完整机制。 在报销流程与用友 ERP 的打通过程中,团队通过定制插件实现了业务单据与财务系统的自动对接。 基于内置的转换引擎,系统会将 NocoBase 中的前置单据信息(如出差、借款、税费等)自动转换为符合财务规则的数据结构。该引擎支持处理复杂的分录逻辑,包括: 处理完成后,系统自动生成财务凭证并推送至总账系统。 这一过程替代了财务人员每月约 1400 张单据的手工录入。 相比接口对接本身,真正的难点在于业务逻辑的结构化。团队基于 NocoBase 的数据模型与插件机制,将原本依赖人工判断的财务规则转化为系统规则,实现了前端业务单据与后端财务处理的稳定衔接。 为支撑后续更多业务系统接入,团队首先完成了统一身份体系的整合。通过对接统一身份认证系统,并以 NocoBase 作为用户管理中心,统一处理用户的新增、修改和删除,同时确保认证信息在各系统之间保持一致。 在消息协同方面,团队额外部署了私有化 IM 平台,对系统原有的消息提醒机制进行了补充: 这使得待办处理路径明显缩短,也提升了系统的实际使用效率。 在客户“内网隔离、物理断网”的环境下,团队采用“外部开发 + 内网部署”的方式推进项目:在互联网环境完成插件开发与逻辑验证,再通过 NocoBase 专业版的迁移工具,将配置整体部署到内网生产环境。 这种“配置即应用”的方式,避免了在隔离环境中反复开发与调试的成本,使系统在严格安全限制下仍能保持每周甚至更短周期的迭代速度。 这一能力依赖于 NocoBase 的配置迁移机制,也使团队能够在复杂交付环境中维持稳定的迭代节奏。 项目整体推进节奏如下: 在部署环境受限、流程复杂且涉及多系统打通的前提下,这样的节奏已经相当高效。 自 1 月起,客户进入新旧流程并行阶段,团队根据实际使用情况持续优化与调整。项目团队提到,NocoBase 在流程变更、字段调整和交互修改上的灵活性,是支撑快速迭代的关键。 整体来看,团队在保证业务复杂度的前提下,通过更短周期的持续迭代,不断逼近业务的真实运行状态。 第一阶段上线后,客户开始推进智能化能力的扩展,主要集中在两个方向: 项目团队正在探索低成本私有化模型与 NocoBase 的结合方式,将 AI 能力嵌入现有业务系统。 基于 NocoBase 2.0 的插件架构与 AI 能力,系统可以在现有流程与数据结构上逐步引入智能化处理,使 AI 更容易在具体业务场景中落地。 在本次项目中,项目团队借助 NocoBase ,仅用 3 个月时间就完成了从需求确认到财务、行政全模块上线的全过程。这种 75% 以上的时间压缩,不仅降低了复杂项目的人力投入,也让团队具备了同时承接多个高标准项目的能力。 这个案例说明了一点:对于真正复杂的企业管理场景,平台能力固然重要,但能否把复杂流程梳理清楚、把系统打通、把业务逻辑沉淀下来,同样取决于实施团队本身的理解深度和交付经验。 而 NocoBase 提供的,正是这样一种可能性:让有行业经验、有复杂项目能力的团队,可以更高效地把方案落到客户现场,并持续支撑后续的业务演进与智能化升级。 接下来,项目团队也计划进一步加入 NocoBase 的合作伙伴生态,将这套经过实践验证的交付方式,复制到更多客户项目中。 更多 NocoBase 的用户故事:项目背景

交付成果

1. 行政与财务流程管理

2. 预算管理

3. 报销审批与 ERP 打通

4. 系统打通

5. 物理隔离环境下的敏捷迭代

交付时间大幅压缩

为系统引入 AI 能力做准备

结语

很多亚马逊卖家都经历过同一个模式:认认真真用工具做了市场调研,上架之后发现货就是卖不动,最终以清仓告终。这个现象背后,有一个被严重低估的技术根因——选品所依赖的数据体系,在质量上存在系统性缺陷:时效性滞后、维度封装、无法定制分析、与内部系统割裂。 本文将从技术角度拆解亚马逊选品失败的完整原因链路,并介绍如何通过 Pangolinfo Scrape API 构建实时、可扩展的选品数据管道,以及在 AI Agent 时代如何进一步大幅降低数据获取的工程门槛。 要诊断失败,先要还原完整流程: 阶段1:市场扫描 阶段2:竞品分析 阶段3:供应链评估 阶段4:进货上架 整条链路,从选品决策到上架往往需要 2~5 个月,而你选品时看到的市场数据,可能已经是这套供应链周期之前的状态。这就是"选品与市场节奏错位"的结构性根因。 大多数订阅制选品工具的数据刷新机制: 当你看到一个月销量3000、TOP 3评论数均在200条以下的"低竞争蓝海"时,这个数据描述的可能是一个月到一个半月前的市场状态。而亚马逊市场的动态节奏,72小时内就可以因为一次大型促销让整个类目翻天覆地。 解决方案:使用实时 API 接口,建立自己的时间序列数据库,追踪 BSR 日度变化曲线而不是月级快照。 选品SaaS的设计逻辑是"最大化通用性",因此提供的是标准化指标集:月销量、BSR、评论数、评分均值。这些指标足以应付通识性判断,但无法回答精细化问题,例如: 这些问题的答案,需要的不是工具里预设的指标,而是对原始数据的定制化查询。 很多卖家看评论只看总分和数量,偶尔扫几条差评。真正有效的评论分析,需要: 这种级别的分析,需要能实时批量获取评论数据的 API,而不是工具里预设的评论快照。 以下是支撑科学选品决策的六维数据框架: 六个维度共同指向一个要求:数据必须足够实时,足够可定制,并且能够跑出时间序列而不只是时间点快照。 Pangolinfo Scrape API提供亚马逊全品类公开数据的实时结构化采集能力,覆盖商品详情、热卖榜单、新品榜、关键词搜索、SP广告位、评论、Customer Says等核心数据类型,输出标准化JSON格式。 在 AI Agent 广泛普及的今天,调用 Pangolinfo API 的门槛已经接近于零。 操作流程: 示例 Prompt: AI 会直接生成完整可运行的代码,包括异常处理和数据格式化。你不需要会写代码,AI 帮你把"数据想法"翻译成"数据现实"。 更进一步,Pangolinfo 还专门为 AI 生态开发了 Amazon Scraper Skillreferrer=csdn_amz)(符合 MCP 协议),可以直接作为工具插件集成到支持 MCP 的 Agent 框架(Dify、Coze、n8n等),无需额外编写 API 调用代码。 Q:调用频率有限制吗? Q:如何处理反爬返回失败? Q:数据存储建议? 亚马逊选品失败的根本原因,是决策质量的问题,而决策质量取决于数据基础设施的质量。 传统订阅制选品工具能解决"有数据"的问题,但解决不了"实时性"和"定制性"的问题。Pangolinfo Scrape API 提供了一套可以随业务需求任意扩展的实时数据采集能力,配合 AI Agent 的代码生成能力,让真正数据驱动的选品体系对所有规模的团队都触手可及。本文标签:

亚马逊 选品 Python API 数据采集 电商前言

一、亚马逊选品流程全景

二、选品滞销的12个根本原因(技术视角)

2.1 数据时效性问题(最高危)

数据爬取 → 模型估算 → 聚合存储 → 平台展示

(这个链条的总延迟:通常 14-45 天)2.2 数据维度的封装限制

2.3 评论数据的浅层分析

三、科学选品需要的实时数据体系

维度 核心数据需求 刷新频率要求 市场需求 关键词12个月搜索量曲线、季节性分解 日级 竞争格局 Top 20竞品的BSR日变化、促销频率历史 日级/小时级 定价结构 90天价格历史、Buy Box构成 日级 用户需求 差评高频词、Customer Says、Q&A 按需实时 广告竞争 核心词CPC历史、SP广告位占坑率 日级 供给侧 新品入场速度、竞品库存消耗信号 日级 四、Pangolinfo Scrape API:构建实时选品数据管道

4.1 快速接入示例

import requests

import json

import os

API_KEY = os.environ.get("PANGOLINFO_API_KEY")

BASE_URL = "https://api.pangolinfo.com/v2"

def fetch_bestseller(node_id: str, country: str = "US", page: int = 1) -> dict:

"""

抓取亚马逊热卖榜单数据

:param node_id: 类目节点ID

:param country: 站点(US/UK/DE/JP等)

:param page: 页码(每页约50个ASIN)

"""

payload = {

"api_type": "amazon_bestseller",

"country": country,

"node_id": node_id,

"page": page,

"output_format": "json"

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

response = requests.post(

f"{BASE_URL}/scrape",

headers=headers,

json=payload,

timeout=30

)

response.raise_for_status()

return response.json()

def fetch_product_detail(asin: str, country: str = "US") -> dict:

"""

获取单个ASIN详细数据:价格、BSR、评分、主要广告位

"""

payload = {

"api_type": "amazon_product",

"country": country,

"asin": asin,

"output_format": "json"

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

response = requests.post(

f"{BASE_URL}/scrape",

headers=headers,

json=payload,

timeout=30

)

response.raise_for_status()

return response.json()

def fetch_reviews(asin: str, country: str = "US", pages: int = 5) -> list:

"""

批量抓取评论数据,用于差评关键词分析

"""

all_reviews = []

for page in range(1, pages + 1):

payload = {

"api_type": "amazon_reviews",

"country": country,

"asin": asin,

"page": page,

"output_format": "json"

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

resp = requests.post(f"{BASE_URL}/scrape", headers=headers, json=payload, timeout=30)

if resp.status_code == 200:

reviews = resp.json().get("result", {}).get("reviews", [])

all_reviews.extend(reviews)

return all_reviews

# 使用示例

if __name__ == "__main__":

# 1. 抓取宠物用品热卖榜 Top 50

pet_node = "2619533011" # Amazon US 宠物用品类目

data = fetch_bestseller(pet_node, country="US", page=1)

products = data.get("result", {}).get("products", [])

print(f"获取 {len(products)} 个榜单产品")

# 2. 对 Top 5 ASIN 抓取详情

for product in products[:5]:

asin = product.get("asin", "")

if asin:

detail = fetch_product_detail(asin, country="US")

print(f"ASIN {asin}: {json.dumps(detail, ensure_ascii=False)[:200]}...")

# 3. 对目标竞品批量抓取评论(用于差评分析)

target_asin = products[0].get("asin", "") if products else ""

if target_asin:

reviews = fetch_reviews(target_asin, pages=3)

# 过滤低分评论

low_star = [r for r in reviews if r.get("rating", 5) <= 2]

print(f"\n{target_asin} 共获取 {len(reviews)} 条评论,其中低分评论 {len(low_star)} 条")4.2 构建按日调度的数据管道

import schedule

import time

from datetime import datetime

def daily_bsr_snapshot(watchlist: dict) -> None:

"""每日定时抓取监控列表的 BSR 数据并存储时序"""

timestamp = datetime.utcnow().isoformat()

for label, node_id in watchlist.items():

data = fetch_bestseller(node_id, country="US", page=1)

products = data.get("result", {}).get("products", [])

# 写入数据库或 JSON 文件(示例用 JSON)

snapshot = {

"timestamp": timestamp,

"category": label,

"node_id": node_id,

"bsr_top50": [

{

"asin": p.get("asin"),

"rank": p.get("rank"),

"title": p.get("title"),

"price": p.get("price"),

"reviews": p.get("reviews_count")

}

for p in products

]

}

filename = f"bsr_{label}_{timestamp[:10]}.json"

with open(filename, "w", encoding="utf-8") as f:

json.dump(snapshot, f, indent=2, ensure_ascii=False)

print(f"[{timestamp[:19]}] 已保存 {label} 类目 BSR 快照 → {filename}")

WATCHLIST = {

"pet_supplies": "2619533011",

"home_kitchen": "1055398",

"sports_outdoors": "3375251"

}

# 每天早上 8:00(UTC)执行一次

schedule.every().day.at("08:00").do(daily_bsr_snapshot, watchlist=WATCHLIST)

print("BSR 监控任务已启动,等待执行...")

while True:

schedule.run_pending()

time.sleep(60)五、AI Agent 时代:自然语言驱动的亚马逊数据抓取

我有一个 Pangolinfo Scrape API key,文档在 https://docs.pangolinfo.com/

请帮我写一个 Python 脚本,用于:

1. 抓取亚马逊美区宠物用品类目(node_id: 2619533011)前100名的BSR数据

2. 对其中排名前10的ASIN,分别抓取最新的50条评论

3. 对这50条评论做简单的情感统计:1-2星比例、高频负面关键词Top10

4. 把结果输出成带时间戳的CSV文件

API Key: [你的key]六、常见问题与最佳实践

A:Pangolinfo API 采用并发配额管理,而非单纯的请求频率限制。对于批量任务,建议使用异步并发调用以最大化吞吐量:import asyncio

import aiohttp

async def fetch_asin_async(session: aiohttp.ClientSession, asin: str, api_key: str) -> dict:

payload = {"api_type": "amazon_product", "country": "US", "asin": asin, "output_format": "json"}

headers = {"Authorization": f"Bearer {api_key}", "Content-Type": "application/json"}

async with session.post("https://api.pangolinfo.com/v2/scrape", json=payload, headers=headers) as resp:

return await resp.json()

async def batch_fetch(asins: list, api_key: str, concurrency: int = 10) -> list:

results = []

async with aiohttp.ClientSession() as session:

semaphore = asyncio.Semaphore(concurrency)

async def bounded_fetch(asin):

async with semaphore:

return await fetch_asin_async(session, asin, api_key)

tasks = [bounded_fetch(asin) for asin in asins]

results = await asyncio.gather(*tasks, return_exceptions=True)

return results

A:Pangolinfo 在服务端处理了亚马逊的反爬机制,用户侧只需处理标准 HTTP 错误码和简单的指数退避重试即可。

A:推荐用 DuckDB(轻量级)或 PostgreSQL 存储时间序列数据,配合 Grafana 或 Metabase 做可视化。总结

在三维设计协作流程里,查看三维图纸是推动项目进展的关键环节。然而,不同软件格式的兼容性问题常常给工作带来诸多阻碍。浩辰CAD看图王凭借其强大的功能,支持多种三维图格式,为三维设计协作带来了极大的便利。

主流格式随心开,原生体验超畅快浩辰CAD看图王支持打开SolidWorks(.slddrw)和CATIA的三维工程图格式,这一特性为众多使用者打开了便捷之门。对于基层工作者而言,以往面对客户发来的SW工程图,由于没有安装专业软件,只能望图兴叹。如今,只需在自己的电脑上直接双击,就能轻松查看三维格式图纸,无需再为软件安装问题发愁。不仅如此,当大家收到对方发来的各种三维工程图时,不会再因“打不开”而抱怨连连。浩辰CAD看图王能够兼容绝大多数市面上主流格式的文件,真正实现了“一软件在手,多图随心看”。而且,它所提供的打开方式并非简单的图片预览,而是原生的CAD数据呈现。用户可以对图纸进行缩放、平移操作,还能精准测量尺寸,图纸中的大部分信息都能完整、清晰地保留下来,为用户提供了近乎专业软件的使用体验。

聚焦痛点精准破,高效协作无阻碍除了强大的格式支持能力,浩辰CAD看图王还深入洞察三维览图过程中的实际痛点,并给出了切实有效的解决方案,让三维览图不再仅仅是“看图”,而是成为助力高效协作的强大工具。装配体零件查找:结构树助力秒定位在处理复杂模型时,常常会遇到上千个零件的情况。手动在众多零件中翻找所需部件,不仅效率低下,还容易出错。浩辰CAD看图王的结构树功能,将所有零件清晰罗列,用户还可以通过输入零件名进行快速搜索,能够迅速定位到目标零件,大大节省了查找时间,提高了工作效率。

壁厚测量:精准快捷一键搞定以往测量壁厚时,工作人员要么需要跑到现场使用卡尺进行测量,要么只能等待设计部门提供相关数据,过程繁琐且耗时较长。浩辰CAD看图王有壁厚测量功能,让壁厚测量变得轻松简单。用户只需选取需要测量的两个面,软件就能自动计算出壁厚,精准又快捷,为工作带来了极大的便利。

剖切状态测量:分析过程不中断许多软件在剖切状态下无法进行尺寸测量,这使得用户在分析模型时不得不中断操作,影响了工作的连贯性和效率。浩辰CAD看图王支持在剖切状态下直接进行测量,用户可以在剖切模型的同时获取所需的尺寸信息,确保分析过程不中断,让工作更加流畅高效。

PMI信息显示:灵活控制清晰呈现在使用其他软件查看图纸时,PMI信息的显示常常不尽如人意。要么看不到公差标注等重要信息,要么满屏都是信息导致模型难以看清。浩辰CAD看图王允许用户单独控制每个零件或整体模型的PMI信息显示,用户可以根据实际需求灵活调整显示内容,使图纸信息更加清晰、易读,为准确理解模型提供了有力保障。

浩辰CAD看图王以其出色的格式支持能力和对实际痛点的精准解决,成为了三维设计协作流程中不可或缺的得力助手,为推动三维设计领域的高效协作发挥了重要作用!

4 月14 日,由全球智慧物联网联盟鸿蒙生态推委会主办的“质领未来・生态共融”2026鸿蒙SDK交流会在成都顺利召开。作为华为鸿蒙生态的重要合作伙伴,每日互动(个推)受邀出席本次大会,并凭借旗下开发者服务全栈产品的高质量鸿蒙适配与生态落地成果,荣获鸿蒙首批SDK评测认证,同步入选鸿蒙首批64款SDK名单,彰显了公司在鸿蒙生态建设中的领先技术实力与核心生态价值。 作为国内开发者服务领域的先行者,个推自2010年起便深耕开发者服务赛道,持续为数十万APP客户提供专业的SDK产品与全链路运营增长解决方案。截至2025年6月,公司开发者服务SDK累计安装量已突破1200亿。自鸿蒙生态启动建设以来,个推始终紧跟生态发展步伐,积极投入专业团队开展鸿蒙系统适配探索,持续深化与华为的技术协同与生态联动。依托十余年的技术沉淀,个推率先完成旗下消息推送、用户运营、一键认证等全系SDK的HarmonyOS适配,以安全、高效、智能的专业产品和服务,为海量鸿蒙原生应用提供关键支撑。 从首批进行鸿蒙系统适配探索,到如今首批通过官方评测认证,个推一步步完成了从 “适配兼容” 到 “深度融合” 的跨越,成为鸿蒙生态中兼具技术实力与落地经验的重要伙伴。目前,个推已在鸿蒙生态中为电商、金融、出行、社交、新闻资讯等多个重点行业的应用提供专业可靠的技术和服务支撑,助力开发者快速实现鸿蒙应用的开发、适配与高效运营,加速鸿蒙原生应用规模化落地。 未来,个推将继续紧跟鸿蒙生态发展节奏,深耕开发者服务技术创新,持续优化产品性能与适配能力,为鸿蒙生态的高质量发展注入更多动能,与行业伙伴携手共建开放、繁荣、高质量的鸿蒙生态体系。PS:个推已支持华为情景感知、实况窗、应用内通话消息VoIP等最新能力,欢迎联系我们开通,共创鸿蒙新玩法!

▲个推开发者服务全系产品通过鸿蒙首批SDK评测认证

2026鸿蒙SDK交流会以“标准共建・协同深耕・赋能创新”为核心,聚焦鸿蒙SDK全链条发展关键议题,搭建集技术研讨、资源对接、经验分享于一体的行业交流平台,旨在推动鸿蒙生态从“规模普及”迈向“高质量深耕”。大会现场,官方正式发布鸿蒙首批SDK评测证书与首批64款SDK名单,从合规性、个人信息保护、网络安全、生态贡献度及开发者体验等多维度进行综合评定,为鸿蒙生态高质量发展树立行业标杆。

构建高性能、可靠的后端系统时,Rust 的标准库为了保持精简,并没有内置 Web 框架、数据库驱动或复杂的序列化工具。这种设计将选择权交给了开发者。经过社区多年的迭代,一些库已经脱颖而出,成为生产环境的事实标准。 以下是开发 Rust 后端项目时建议优先考虑的 9 个核心库,太夯了。 数据在网络中流动通常需要转换格式。Serde 采用零成本抽象的设计,在编译阶段生成序列化与反序列化代码,避免了运行时的反射开销。配合 如果使用 Axum 这种 Web 框架,Tower-http 是不可或缺的组件。它提供了一系列现成的中间件,用来处理跨域、请求压缩、超时控制等常见的 HTTP 逻辑。 它可以通过组合不同的层(Layer)来增强服务功能。例如,开启压缩支持和跨域策略只需要几行配置。 Sea-ORM 是一个基于 SQLx 构建的异步 ORM 框架。对于习惯了动态语言 ORM(如 Django 或 ActiveRecord)的开发者,Sea-ORM 提供了更友好的链式查询接口。它支持自动生成实体类,并且能很好地处理复杂的关联查询,同时保留了异步执行的优势。 在无状态的 REST API 中,JWT 是身份验证的主流方案。这个库实现了 JWT 的签名与验证逻辑,支持 HS256、RS256 等多种算法。它配合 Serde 使用,可以将自定义的 Claims 直接映射为 Rust 结构体。 存储用户密码时,安全哈希算法的选择非常关键。Argon2 是目前推荐的现代算法,它通过增加内存成本和计算开销来抵御暴力破解。Rust 的 可观测性是生产环境的要求。 后端服务经常需要处理定时任务,比如每日结算、清理过期缓存等。这个库将 Cron 表达式集成到了 Tokio 异步运行时中,允许在不阻塞主线程的前提下,按照预设的时间表触发异步函数。 如果需要构建 GraphQL 接口, 测试是保证代码质量的基础。 配置 Rust 开发环境有时会涉及环境变量、编译器版本以及相关底层库的安装,如果用 ServBay 进行一键部署Rust,就不用管这些乱七八糟的东西了。 ServBay 是一款专为开发者设计的本地开发环境管理工具。它集成了对 Rust 环境的直接支持,直接在图形界面中快速安装 Rust 编译器以及配套的数据库环境,比如 PostgreSQL、Redis等等。 上面的 9 个库涵盖了从数据处理、身份认证到运维监控的完整链路,开发中所需要的基本都能涵盖了。省时省力又省心。1. Serde 与 Serde\_json

serde_json,处理 JSON 数据会变得非常自然。use serde::{Deserialize, Serialize};

#[derive(Serialize, Deserialize)]

struct UserProfile {

#[serde(rename = "username")]

name: String,

// 忽略空字段,保持输出整洁

#[serde(skip_serializing_if = "Option::is_none")]

nickname: Option<String>,

}

fn handle_json() {

let data = r#"{"username": "rust_dev"}"#;

let user: UserProfile = serde_json::from_str(data).expect("解析失败");

let output = serde_json::to_string(&user).unwrap();

}2. Tower-http

use tower_http::{cors::Any, cors::CorsLayer, compression::CompressionLayer};

use ax_router::Router; // 假设使用 axum

let app = Router::new()

.route("/", get(|| async { "ok" }))

.layer(CorsLayer::new().allow_origin(Any))

.layer(CompressionLayer::new());3. Sea-ORM

use sea_orm::{entity::*, query::*, Database};

// 查找状态为激活的所有用户

async fn get_active_users(db: &DatabaseConnection) -> Vec<user::Model> {

user::Entity::find()

.filter(user::Column::Status.eq("active"))

.all(db)

.await

.unwrap_or_default()

}4. JSONWebToken

use jsonwebtoken::{encode, Header, EncodingKey};

use serde::{Serialize, Deserialize};

#[derive(Debug, Serialize, Deserialize)]

struct TokenClaims {

sub: String,

exp: usize,

}

fn create_token(user_id: &str) -> String {

let claims = TokenClaims { sub: user_id.to_owned(), exp: 10000000000 };

encode(&Header::default(), &claims, &EncodingKey::from_secret("secret".as_ref())).unwrap()

}5. Argon2

argon2 库易于使用,能有效防止彩虹表攻击。use argon2::{Argon2, PasswordHasher, PasswordVerifier, password_hash::SaltString};

use argon2::password_hash::rand_core::OsRng;

fn secure_password() {

let pwd = b"my_password";

let salt = SaltString::generate(&mut OsRng);

let argon2 = Argon2::default();

let hash = argon2.hash_password(pwd, &salt).unwrap().to_string();

// 验证逻辑

let parsed_hash = argon2::PasswordHash::new(&hash).unwrap();

assert!(argon2.verify_password(pwd, &parsed_hash).is_ok());

}6. Prometheus

prometheus 库允许在代码中埋点,收集请求耗时、并发数、错误频率等指标。这些数据可以被 Prometheus 抓取并在 Grafana 中展示,帮助开发者掌握系统的运行状态。use prometheus::{Counter, Registry};

lazy_static::lazy_static! {

static ref HTTP_REQUESTS: Counter = Counter::new("http_requests", "请求总数").unwrap();

}

fn track_metric() {

HTTP_REQUESTS.inc();

}7. Tokio-cron-scheduler

use tokio_cron_scheduler::{Job, JobScheduler};

async fn start_scheduler() {

let sched = JobScheduler::new().await.unwrap();

sched.add(Job::new("0 0 1 * * *", |_, _| {

println!("每天凌晨1点执行清理");

}).unwrap()).await.unwrap();

sched.start().await.unwrap();

}8. Async-graphql

async-graphql 是目前的首选。它利用 Rust 的类型系统来定义 Schema,能够自动生成文档,并支持强大的 Subscription 功能(基于 WebSocket 的实时数据推送)。它能无缝集成到 Axum 或 Actix-web 中。use async_graphql::{Object, Schema, EmptyMutation, EmptySubscription};

struct Query;

#[Object]

impl Query {

async fn version(&self) -> &str { "v1.0" }

}

fn build_schema() {

let schema = Schema::build(Query, EmptyMutation, EmptySubscription).finish();

}9. Mockall

mockall 可以为 Trait 生成 Mock 对象,这在单元测试中非常有用。通过模拟外部 API 或数据库行为,可以实现真正的隔离测试,确保逻辑分支被完整覆盖。use mockall::{automock, predicate::*};

#[automock]

trait ExternalApi {

fn fetch_data(&self, id: u32) -> String;

}

#[test]

fn test_business_logic() {

let mut mock = MockExternalApi::new();

mock.expect_fetch_data()

.with(eq(10))

.returning(|_| "mocked_value".to_string());

assert_eq!(mock.fetch_data(10), "mocked_value");

}总结

在日常开发中,我们经常需要从互联网上获取资源文件,尤其是 PDF 文档。无论是自动备份在线报告、批量下载电子发票,还是获取动态生成的合同文件,能够高效、稳定地将远程 PDF 保存到本地都是一项实用技能。 本文将介绍如何使用 Spire.PDF for .NET 库,结合 C# 语言,从指定 URL 下载 PDF 文档并保存到本地。Spire.PDF 提供了丰富的 PDF 操作功能,而不仅仅是下载和保存。 首先,你需要在项目中安装 Spire.PDF for .NET。可以通过 NuGet 包管理器控制台执行: 或者通过 .NET CLI: 该库支持 .NET Framework 4.0 及以上、.NET Core 3.1、.NET 5.0 及更高版本。 以下是完整的代码示例: 将字节数组包装到 借助 Spire.PDF,你可以在下载 PDF 后立即进行其他操作,例如: 本文演示了如何使用 C# 和 Spire.PDF for .NET 从 URL 下载 PDF 并保存到本地。整个过程简洁高效,仅需几行核心代码即可完成。Spire.PDF 不仅提供了文档加载与保存功能,更是一个强大的 PDF 处理工具集,值得深入探索。 希望这篇文章对你有所帮助。如果你有任何问题或更好的实现方式,欢迎交流讨论!准备工作

Install-Package Spire.PDFdotnet add package Spire.PDF实现代码

using System.IO;

using System.Net;

using Spire.Pdf;

namespace DownloadPdfFromUrl

{

class Program

{

static void Main(string[] args)

{

// 创建 PdfDocument 对象

PdfDocument doc = new PdfDocument();

// 创建 WebClient 对象,用于下载网络资源

WebClient webClient = new WebClient();

// 从 URL 下载 PDF 数据,并保存到内存流

using (MemoryStream ms = new MemoryStream(

webClient.DownloadData("http://www.example.com/sample.pdf")))

{

// 将流中的 PDF 数据加载到 PdfDocument 对象

doc.LoadFromStream(ms);

}

// 将 PDF 文档保存到本地文件

doc.SaveToFile("result.pdf", FileFormat.PDF);

// 释放资源

webClient.Dispose();

doc.Close();

}

}

}代码解析

1. 创建 PdfDocument 对象

PdfDocument 是 Spire.PDF 的核心类,代表一个 PDF 文档实例。我们用它来承载从网络下载的 PDF 数据。2. 使用 WebClient 下载数据

WebClient 是 .NET 中简单易用的 HTTP 下载类。DownloadData 方法直接返回 byte[] 数组,表示 PDF 文件的原始二进制内容。3. 利用 MemoryStream 作为桥梁

MemoryStream 中,是为了方便调用 doc.LoadFromStream(ms) 方法。这样做避免了先将文件保存到磁盘再读取的低效操作,实现了全内存处理。4. 加载流并保存

LoadFromStream 方法将内存流解析为可操作的 PDF 文档。最后,SaveToFile 将文档持久化到本地磁盘,文件名为 result.pdf。注意事项

try-catch 块处理网络超时、URL 无效、PDF 格式错误等异常。WebClient 和 PdfDocument 都实现了 IDisposable 接口,务必及时释放资源。上述代码已使用 using 语句处理 MemoryStream,但也建议对 webClient 和 doc 进行显式释放或也使用 using。WebClient.DownloadDataTaskAsync 或改用 HttpClient 的异步方法,避免阻塞 UI 线程。扩展应用

总结

随着AI时代的快速到来,无论是模型的训练推理,还是各行各业在AI场景中的探索、试点与推广,都对数据提出了全新的要求。而这些数据能否顺利落地,很大程度上依赖于底层数据平台或数据底座的能力。 袋鼠云在数据中台领域已深耕超过十年。结合AI时代对数据的新需求,本篇我们将重点探讨在AI时代,企业为什么要重新思考数据底座? 当前业内主流大模型(如豆包、通义千问、DeepSeek等)的泛化能力与推理表现,均高度依赖数据的质量与丰富度。而在上层AI应用(如问数系统、知识库等)中,若要从Demo或个人使用迈向企业级生产应用,同样离不开高质量数据集的支撑。 然而在实际落地过程中,企业普遍面临数据不完整、质量参差甚至存在错误等问题,大量未经治理的数据被直接输入模型,进而引发“幻觉”等不稳定现象。在生产环境下,这类数据难以直接支撑业务应用,往往需要投入大量人工进行校验与处理,显著增加了落地成本,也制约了企业在AI方向的深入探索与规模化推广。 为了配套支持AI应用的快速落地,国家近年来连续发布了多项政策,推动AI与各行业深度结合: 在国家密集政策的持续推动下,市场上已涌现出一批高质量数据集建设项目,尤其在政企领域表现尤为突出。 那么,什么才算是“高质量数据集”?2025年中国国际大数据产业博览会正式发布的《高质量数据集建设指引》给出了明确标准:高质量数据集应具备准确性、完整性、一致性、时效性、相关性、代表性与无偏性等关键特征。 以“准确性”为例,企业内部虽拥有海量数据,但由于跨部门口径不一,数据冲突现象较为常见,因此在建设高质量数据集时,必须优先保障数据结果的准确可靠。再看“完整性”,在问数等应用场景中,一旦问题超出知识库覆盖范围,系统便难以给出有效答案,这就要求企业对字段维度与系统范围进行系统化梳理与补全,确保数据体系的全面性。 高质量数据集的落地,极其考验底层平台的能力,主要包括: ·自动化的工具链:高质量数据的形成需要将企业各业务系统的数据、公网爬取的数据、接口调用的数据以及本地文件(文档、音频、视频)统一采集、整合、处理。整个链路需要自动化工具链来完成数据采集、清洗、人工或自动标注以及质量检查。 ·治理平台:围绕自动化工具链之上,需要一套治理平台来管理数据之间的血缘关系、数据滚动的校验以及质量监控,实现日常管控和运营。 ·数据安全与隐私:高质量数据最终要支撑各种AI应用和大模型,因此平台必须支持跨域联邦学习、数据可用不可见、数据脱敏加密,以及表级、文件级的精细权限管控。 ·多模态存储与计算:高质量数据集的来源包括文本、图像、音频、视频等,平台需要具备多模态的存储、计算和管控能力。 在企业建设各种数据应用的过程中,需要用到内部私有数据,这就需要将企业知识库和各种数据灌入Data Agent相关应用中。然而,这些数据是否存在违规、跨域或跨权限访问的问题,面临较大挑战。实际落地中存在四大痛点: ·数据孤岛与滥用:数据来自CRM、OA、财务等不同系统,存储在企业知识库、网盘甚至个人电脑上,分散存储形成烟囱,难以管控。 ·严苛的合规压力:随着《数据安全法》的颁布,个人隐私数据有明确的安全要求。如果通过公有云大模型调用,数据传输到互联网上存在较大安全隐患。 ·细粒度的权限管控缺失:大量数据整合后,需要明确哪些部门可以访问哪些数据。例如财务数据仅限管理层和财务部门,人力数据仅限人力部门。缺乏细粒度管控会导致数据被越权访问,引发内部风险。 ·溯源与审计困难:一旦发现数据违规使用,需要全链路数据流转追踪和事件定责的工具。 为此,构建可信数据空间成为必要,具体包括: ·智能治理:通过AI自动化数据治理,实时监控数据链路和资产价值。 ·统一的连接器:适配各种异构系统,实现多元异构数据的安全接入与高效交换。 ·多模态能力:面向各类文件、音频、视频及系统数据,提供高性能的计算和处理能力。 ·数据安全:实现测试数据与生产数据隔离,最小授权粒度,关键数据可用不可见、可用不可出,支持精细化的细粒度权限管控。 当前市场上出现了各种Data Agent,如问数Agent、营销Agent、数据洞察Agent等。这些Agent本质上都需要搭建一套知识库(RAG),将企业各类数据利用起来,并通过TextSQL等技术降低数据使用门槛,让非技术人员(如运营、销售、行政等)也能通过自然语言快速获取数据价值。 然而实际落地中面临诸多问题: ·术语与指标难以理解:AI很难理解企业自定义的术语和指标,例如“爆款”“3C”“6C”“大客户”等,每个企业的定义不同。 ·数据质量与可信度:即使AI生成的语法和图表正确,但由于数据质量问题或模型环节问题,最终结果可能是错误的,导致管理人员无法直接用于决策。 ·基础设施瓶颈:多模态数据(文件、音频、视频)纳入后,数据量级从几个TB升级到PB级别。海量数据的处理需要GPU支撑,传统CPU难以胜任。 同时,非结构化数据的管理方式不同于结构化数据,以往的元数据管理(如Hive表结构)已经失效。 除了高质量数据集和可信数据空间,还有大量数据应用需要底层多模态数据平台的支撑: ·医疗诊断:整合患者就诊数据、拍片数据、健康体检数据,形成智能诊断方案。 ·内容创作:整合作者以往的写作数据和偏好,通过AI辅助生成创作内容。 ·智能客服:整合客户咨询记录、偏好、购买记录以及产品知识库、问答知识库,实现智能客服。 ·智能制造:通过生产车间的摄像头和传感器采集生产环节数据,结合生产系统数据,实现智能制造。 ·金融风控:整合用户借款记录、还款记录、消费习惯及关系网络,支撑金融风控场景。 ·教育、自动驾驶等场景同样涉及多模态数据平台的要求。 为了支撑这些场景,多模态平台需要采集企业内部外部的结构化与非结构化数据,让数据从单一系统维度走向多模态、多维化,使数据应用更加丰富和完善。 以往的传统数据平台在支撑上述应用时,存在以下问题: ·数据类型汇聚不统一:传统平台主要采集结构化数据(如Oracle、MySQL、SQL Server等),对于非结构化数据(文本、图片、音频、视频)采集能力缺乏,需要不同技术工具,存储在不同位置(文件服务器、对象存储),形成割裂局面。 ·多模态语义搜索能力不足:传统平台主要支持结构化数据的二维表形式,搜索多采用关键词索引,难以支持向量化语义搜索。非结构化数据的处理需要专业算法人员(如图片关键词提取、文档切分、视频内容提取),上手门槛高。 ·元数据管理不统一:传统平台管理MySQL、Hive等元数据,而文件、视频、音频等可能存储在网盘、FTP、语雀、钉钉等不同平台,元数据无法打通,权限不一致,带来安全风险。 ·Data与AI流程割裂:传统数据平台主要为数仓而生,支持BI图表和仪表盘;而AI应用对非结构化数据要求高,两者技术栈和团队不同,开发和运维流程割裂。 基于以上问题,新型多模态平台需要具备以下能力: ·多模态数据的统一采集:无论结构化、半结构化还是非结构化数据,无论存储在何处,都可以通过统一平台采集,实现技术栈和操作习惯的统一,避免数据孤岛。 ·统一的治理能力:通过GPU相关算子处理非结构化数据,并与结构化数据做关联或联邦计算,形成有价值的数据资产或数据集。 ·语义化搜索与知识构建:支持关键词、语义化、索引化搜索,统一管理元数据。用户可以在权限范围内查看结构化和非结构化数据(文件、音频、图片、系统表等),并进行统一搜索。 ·智能化的多模态数据处理与标注:平台内置大量处理算子,通过低代码方式快速解析文件、图片、音频,支持智能标注或人工标注,降低数据清洗成本,提高效率。 在实施过程中,通过平台与方法的结合,可以落地高质量数据集和可信数据空间,支撑AI应用的快速发展和生产上线。我们总结出两种模式: 通过采集、清洗、标注、增强、评估等关键技术,为各种AI应用提供高质量的数据语料,最终保证产出的数据干净且可用,从而降低大模型的幻觉率,提高指标问数、ChatBI等AI应用的准确率。 利用AI技术提高数据集处理和多模态数据形成过程中的效率。例如,传统治理需要人工逐个建立采集任务、清洗任务(从ODS层到DWD层等),并手动维护。而AI可以自动化建模、标注、数据约束和管控,大大提升数据治理效率。 通过 Data for AI 和 AI for Data 的双轮驱动,可以使多模态数据落地过程效率大幅提升,降低实施周期和成本。 基于多模态数据平台和治理方法论,未来有三大核心演进方向: ① 数智一体化:以往数据治理和AI是两套平台建设。未来,数据平台、数据治理和AI平台应合二为一,在平台中内置AI能力(如向量搜索、智能问答、知识库),整合大模型、向量库、搜索引擎等技术组件,通过一道平台满足治理自动化、标注和向量化要求。 ② AI自动化治理:基于数智一体平台,将大量重复性、有规则性、可定义SOP的治理工作交给AI完成,例如自动生成数据标准、自动检测不符合标准的数据、自动生成数据模型和ETL任务等。只要可以明确定义并有足够语料,AI就可以执行,从而降低实施工作量、成本和上线周期。 ③ 数据安全内置:在平台的存储、加工各环节内置数据安全组件,包括文件/表的权限控制、数据脱敏加密、数据质量管控等,达到数据合规和最小颗粒度使用。 基于上述理解,袋鼠云研发了多模态数据平台,产品架构如下: 左侧数据来源:包括各种关系数据库(Oracle、MySQL等)、MPP数据库、Hadoop体系数据,以及半结构化/非结构化数据(日志、网页、文档、图片、音视频等)。 统一数据集成:将上述数据采集到平台存储。存储层:内置对象存储(MinIO、S3)、数据湖、向量库、图数据库等多样化组件,满足不同数据的存储和使用需求。 模型服务层:提供模型管理和服务能力,可对接DeepSeek、通义千问、豆包等第三方模型,进行管理、微调和推理。 统一元数据管理:通过Graphine等多模元数据管理组件,将非结构化和结构化数据的元数据统一管理。 调度层:实现CPU和GPU混合调度,特别是GPU调度支持非结构化数据的并发解析识别。计算层:提供离线计算、实时计算、机器学习等处理能力。 开发治理层:统一的开发UI界面,支持低代码开发、数据质量检测、数据血缘、数据安全等能力。 AI应用:为问数Data Agent、智能客服、企业知识库、资产门户、知识图谱、高质量数据集等提供统一的数据能力。 多模态数据平台产品架构图 通过这一平台,企业可以快速构建AI应用所需的所有底层数据。 以往的数据平台核心是提供结构化数据整合能力,最终支撑BI报表、分析报表或门户等应用。但在AI时代,许多企业在建设AI应用时发现:问数、知识库、搜索不准或错误,准确率不高。回归问题本质,核心还是底层数据集和平台能力不够——数据不全面、语义度不高,导致AI应用难以在生产环境中发挥作用。 在AI时代,数据已从以往的辅助决策、辅助资源,升级为核心生产资料。企业AI能否落地,核心依赖于底座的高质量数据集能做到什么程度,平台能否支持高质量数据集的快速落地和效果呈现。 因此,我们总结未来产品的几大形态: ① 构建统一底座:抛弃以往数仓仅解决结构化数据孤岛的思路,多模态平台要将结构化和非结构化数据全域接入、灵活处理。 ② AI Native 的智能流水线:通过AI能力处理多模态数据,加速实施落地周期,提高资产转化效率。 ③ 可信数据空间构建:平台上承载了企业所有数据(结构化和非结构化),数据的管控颗粒度和权限便捷度是核心生命线。需要构建可信数据能力,统一管控各类数据,方便、安全地供下游应用使用。 ④ 敏捷智真创新:AI技术快速演进,数据来源快速膨胀。结构化数据在企业中可能只占10%甚至5%,而非结构化数据将占到90%甚至95%以上。这对大规模存储、处理、搜索提出了更高要求。平台需要支持海量数据存储管控计算,快速集成新组件,支持敏捷创新,如多模态数据存储和CPU/GPU混合调度。 本篇主要分享了在AI时代,企业探索和构建数据应用的过程中,为什么需要一个新的数据底座,以及新数据底座需要具备哪些能力,结合底座之上如何做治理和实施。除了本次分享,后续还安排了两期分享,感兴趣的朋友可以点击下面的预约卡片。视频号直播预约卡片获取更多资料:《数栈·多模态数据智能中台产品白皮书》可扫描下方二维码,快速获取,无需等待~一、高质量数据集:AI应用落地的基石

二、政策驱动:国家大力支持AI与数据要素融合

三、高质量数据集对平台的核心要求

四、可信数据空间:破解数据孤岛与合规难题

五、Data Agent与RAG落地的挑战与应对

六、多模态数据的广泛应用场景

七、传统数据平台的“能力天花板”VS“多模态平台多维融合”

九、双轮驱动:Data for AI 与 AI for Data

Data for AI · 数据供给侧

AI for Data · 治理智能化

十、未来三大演进方向

十一、袋鼠云多模态数据平台产品架构

十二、多模态数据平台的终极形态

结语

苹果签名是iOS应用实现安装、运行的核心前提,本质是苹果生态的安全认证机制,通过数字证书确认应用来源合法、内容未被篡改,保障设备使用安全。不同场景下,开发者和企业对签名的需求差异较大,市面上主流的苹果签名类型各有适配场景,本文将以实用视角,拆解各类签名的核心特点、使用场景及注意事项,帮你快速选对适合自己的类型。

首先是个人开发者签名,核心服务于个人开发者的真机调试需求,依托苹果个人开发者账号生成,年费相对亲民。这类签名的核心限制的是设备绑定数量,单账号最多可绑定100台设备,且需提前录入设备UDID,适合应用开发初期的自我测试、小范围种子用户试用。它的优势的操作便捷,无需复杂审核,通过常规开发工具即可完成签名打包;不足在于设备限制严格,且签名有效期较短,需定期续签,不适合大规模分发。

其次是企业开发者签名,专为企业内部分发需求设计,基于苹果企业开发者账号搭建,无设备数量限制,无需绑定UDID,用户下载后只需在设备管理中信任对应证书即可使用。无论是企业内部的协作工具、培训应用,还是面向内部员工的专属服务软件,都能通过这种签名快速部署。但需注意,企业签名的稳定性与证书使用方式相关,共享证书因多人共用,易触发苹果风控导致掉签,独享证书稳定性更高,适合有长期内部分发需求的企业。

第三种是超级签名,属于个人开发者签名的优化升级版本,借助技术手段实现UDID自动绑定,用户安装时无需手动提供设备信息,体验更流畅。它的核心优势是稳定性极强,单设备独立签名,掉签概率极低,且无需用户手动信任证书,适合对稳定性要求高的小范围测试、小众付费应用分发。但短板也较为明显,成本随设备数量递增,单设备收费模式导致大规模分发时性价比偏低,更适合小体量、高精度的分发需求。

最后是TF签名(TestFlight签名),作为苹果官方认可的测试签名方式,合规性和稳定性拉满。应用需经过苹果简易审核(1-3天),通过后可邀请最多1万名外部测试用户,用户通过TestFlight应用即可下载安装,测试有效期为90天。这种签名零掉签风险,无需用户手动信任,适合金融、医疗等对安全性要求极高的行业,或需要公开测试、收集广泛用户反馈的应用,不足是有审核门槛,且测试期限有限,不适合长期正式分发。

很多人会混淆各类签名的用途,其实核心原则很简单:个人调试选个人开发者签名,企业内部分发选企业签名,小范围稳定测试选超级签名,合规公开测试选TF签名。选择时结合自身预算、分发规模和稳定性需求,避开低价共享证书的坑,就能实现应用的安全、高效分发,兼顾体验与合规。

「龙蜥大讲堂」精彩预告来了,点击下方海报抢先了解。欢迎扫描海报二维码提前进群,立即预约锁定这场 AI 关键技术分享! 直播时间:2026 年 04 月 15 日 (周三)16:00-17:00 本次直播带大家了解异构推理的工作机制,掌握不同类型模型上的性能优化技巧,以及分享异构推理的基本过程和存在问题,分析在基于龙蜥操作系统的硬件资源受限场景下,稠密模型和 MoE 模型在 CPU 端的卸载技术。 适合人群: 研发工程师、运维工程师。 讲师介绍: Rongfei Xu,浪潮信息系统软件架构师。博士毕业于北航计算机学院计算机软件与理论专业,研究领域为服务器操作系统、大模型推理等系统优化技术。目前从事异构推理的性能提升工作。异构场景下的大模型优化技术

直播内容:

随着大模型技术迈向深化应用与规模部署的新阶段,AI 基础设施的效能、成本与可靠性已成为推动产业突破的关键。4 月 28 日,由龙蜥智算联盟主办、浪潮信息承办的以「聚力前行—智算时代的基础设施创新」为主题的 MeetUp 将在北京举办。本次活动聚焦 AI Infra 产学研用全链路最新技术趋势与产业动态,涵盖 LLM 推理性能诊断、GPU 复用技术、CXL 池化内存应用、分布式推理建模框架、边缘 AI 高效 GPU 架构等热点话题,从技术原理到落地实践,全方位解析 AI 基础设施创新路径。 除此之外,活动现场将举行 CXL 接口库发布仪式,由阿里云、浪潮信息、中国科学技术大学、上海交通大学等生态伙伴共同参与,见证 AI 基础设施领域的重要里程碑。 时间:4 月 28 日(周二)14:00-17:30 地点:北京海淀区朗丽兹西山花园酒店-华夏 AB 厅 报名链接:https://openanolis.mikecrm.com/eoV0ryn

在企业落地 AI 应用的过程中,团队往往面临一个尴尬的现实:AI 模型和能力已经就绪,但从"能用"到"团队都能用"之间,还横亘着一道部署与管理的鸿沟。每个成员想跑一个 AI 应用,都得理解底层资源配置、网络拓扑、权限体系,这显然不是高效的协作方式。 阿里云 PolarDB 推出的 PolarClaw 企业级 SaaS 服务,正是为解决这一问题而来。它将 AI 应用的创建、管理和分发流程高度产品化,让团队可以像使用 SaaS 工具一样,轻松管理 PolarClaw 应用的全生命周期。 PolarClaw SaaS 是一个部署在用户专有网络(VPC)内的 Web 服务,核心定位是"集中创建和管理 PolarClaw 应用的统一入口"。 简单来说,它把原本分散在控制台各处的 PolarClaw 应用管理操作,收敛到一个独立的 Web 界面里。管理员可以在这里预设应用模板、管控权限,而团队成员则可以通过企业账号一键登录,基于模板快速创建自己的 PolarClaw 应用实例,全程无需接触底层的数据库、网络和资源配置细节。 这种架构的好处很直接:AI 能力的使用门槛被大幅降低,而安全性和可管理性并不因此打折。应用部署在用户自己的 VPC 内,数据不出网,管理员对配置模板拥有完全的控制权。 核心能力:三大功能解决团队 AI SaaS 管理应用的能力可以归纳为三个核心维度。 一、模板化部署,一键创建应用 这是 PolarClaw SaaS 最核心的价值所在。管理员可以在后台预先定义好 PolarClaw 应用的配置模板,包括模型来源(ModelFrom)、模型 API Key 等关键参数。团队成员登录后,只需选择模板并点击创建,即可获得一个完整可用的 PolarClaw 应用实例。 对于需要频繁创建 AI 应用的团队而言,这意味着:不再需要每次都走一遍完整的资源申请和配置流程;不再需要每个成员都具备云资源管理的知识背景;也不再需要管理员逐一手动配置每个应用实例。整个过程就像在企业内部应用商店里"安装"一个应用一样简单。 二、企业级统一认证,安全无缝接入 PolarClaw SaaS 管理应用与企业办公应用深度集成,目前已支持飞书组织架构的对接。团队成员使用企业飞书账号即可完成安全登录,无需额外注册或维护独立的账号体系。 这种集成方式带来了几个实际好处。 账号管理成本归零:员工入职、离职的权限变更自动跟随企业通讯录; 三、集中化权限管控,管理员统一运维 SaaS 服务的超级管理员拥有对配置模板的完全管理权限。这意味着管理员可以精确控制团队成员能创建什么类型的应用、使用哪些模型资源、调用哪些 API 接口。 在实际使用场景中,这种管控能力非常关键。比如,管理员可以为不同业务团队配置不同的模板,控制模型调用的成本和范围;也可以随时调整模板参数,统一升级所有基于该模板创建的应用配置。整体的管理模式是"管理员定义规则,团队成员在规则内自主使用",既保证了灵活性,也确保了可控性。 实操指南:四步完成 PolarClaw SaaS 部署 第一步:创建 SaaS 管理应用 登录阿里云 PolarDB 控制台,进入"PolarDB AI → PolarClaw → SaaS 配置"标签页。在此页面中,需要填写以下关键配置信息: 阿里云 AccessKey ID 和 AccessKey Secret(建议使用专用 RAM 用户,按最小权限原则配置);VPC 网络、可用区及交换机; 第二步:配置网络访问能力 SaaS 应用默认仅支持 VPC 内网访问。如果需要公网访问能力,需在应用所在的 VPC 和交换机下创建公网 NAT 网关,并配置 SNAT 条目(VPC 粒度),绑定弹性公网 IP。随后在 SaaS 应用详情页申请开通公网访问地址。 需要注意的是,开通公网访问将产生 NAT 网关及公网流量相关费用,建议根据实际需求评估是否开通。 第三步:配置飞书回调地址 从 SaaS 应用详情页复制"飞书重定向 URL",前往飞书开放平台,在应用的安全设置中完成两项配置:添加重定向 URL,以及将 SaaS 应用的出口 IP 加入 IP 白名单。 特别提醒:在飞书开放平台添加权限后,务必点击"确认"按钮保存变更,否则配置不会生效。同时,飞书应用发布时需将可用范围设置为"全部成员",以确保团队所有人都能正常登录。 第四步:访问与使用 一切就绪后,配置好访问白名单(公网出口 IP 或 VPC 内客户端 IP),通过私网或公网地址访问 SaaS 管理界面。 以管理员身份登录后,进入"账号管理"模块,创建 PolarClaw 应用模板,指定模型来源、ModelFrom 和 ModelApiKey 等参数。模板创建完成后,团队成员即可基于模板一键创建自己的 PolarClaw 应用实例,整个过程通常只需几秒钟。 通过配置应用模板“一键开虾”[向下] 写在最后 PolarClaw SaaS 管理应用的设计理念很务实:不追求花哨的功能堆砌,而是聚焦于"让团队高效、安全地使用 AI 应用"这个核心命题。PolarClaw SaaS 几乎是零额外学习成本的能力升级,熟悉的控制台、熟悉的网络架构、熟悉的企业账号,加上一套简洁直观的模板化管理机制,就构成了完整的 AI 应用管理闭环。 如果你的团队正在探索如何让 AI 能力更高效地落地到日常业务中,PolarClaw SaaS 管理应用值得一试。 如有相关问题,欢迎使用钉钉搜索“175205010586”加入 PolarClaw 技术交流群咨询。 点击“阅读原文”查看完整配置步骤[向下]

什么是 PolarClaw SaaS?

登录体验一致:用户使用熟悉的企业账号,无学习成本;

安全合规有保障:基于企业应用账号的标准认证流程,认证信息由企业自建应用掌控。

安全组(注意必须放行 TCP 8080 端口,否则服务将无法访问);

飞书自建应用的 App ID 和 App Secret(用于实现企业账号登录,需在飞书开放平台创建自建应用并开通用户信息相关权限)。

https://help.aliyun.com/zh/polardb/polardb-for-postgresql/use...

Google Cloud介绍了 他们近期对 PostgreSQL 的技术贡献,重点在逻辑复制、升级流程和整体系统稳定性方面进行改进。此次更新体现了与上游社区的持续合作,核心引擎增强旨在解决可扩展性、复制和运维方面的挑战。 本次更新汇总了 2025 年 7 月至 12 月的工程工作,重点推进逻辑复制向 active-active 架构演进。其中一项关键改进是引入自动冲突检测,使数据库在复制过程中可自动识别行级冲突,无需人工干预。这解决了多节点写入场景中长期存在的问题,此前冲突更新可能导致复制中断。 向 active-active 复制方向的演进也在社区引发了关于一致性模型权衡的讨论。Franck Pachot如此评论: 将带冲突解决的双向逻辑复制与 Oracle RAC 或 CockroachDB、YubyteDB 等分布式 SQL 进行比较,是对数据库一致性的误解。一种是最后写入胜出,另一种则是 ACID。 与此同时,也有人认为这一进展标志着 PostgreSQL 在企业环境中持续进化。Janardhan Korapala写到: 重大的里程碑。当超大规模云厂商将 active-active 复制这类企业级特性贡献到上游时,说明 PostgreSQL 已成为无可争议的企业默认选择。 其他改进将逻辑复制的范围从表数据扩展到序列,减少了迁移或版本升级时手动同步的需求。团队还修复了订阅管理中的自死锁(self-deadlock)的问题,该问题在复制命令尝试访问同一服务器上的锁定资源时可能发生。 工作的另一重点是提升升级的可靠性与性能。对 pg_upgrade 的优化改进了大对象管理,缩短了大规模部署的升级时间。其他的更新会通过在升级期间保留必要的 WAL 数据、确保模式约束被正确保留来提高系统韧性。 除复制与升级外,Google Cloud 工程师还提交了多项漏洞修复以提升健壮性,包括处理诊断工具中的无效索引页、解决从嵌套路径加载扩展的问题,以及强化 WAL 刷写逻辑以确保极端场景下的数据持久性。 该公司还透露了正在进行的未来功能研发,包括复制结构化冲突日志、pg_dump 并行数据导出优化,以及大规模数据处理能力的增强。 查看英文原文:Google Cloud Highlights Ongoing Work on PostgreSQL Core Capabilities

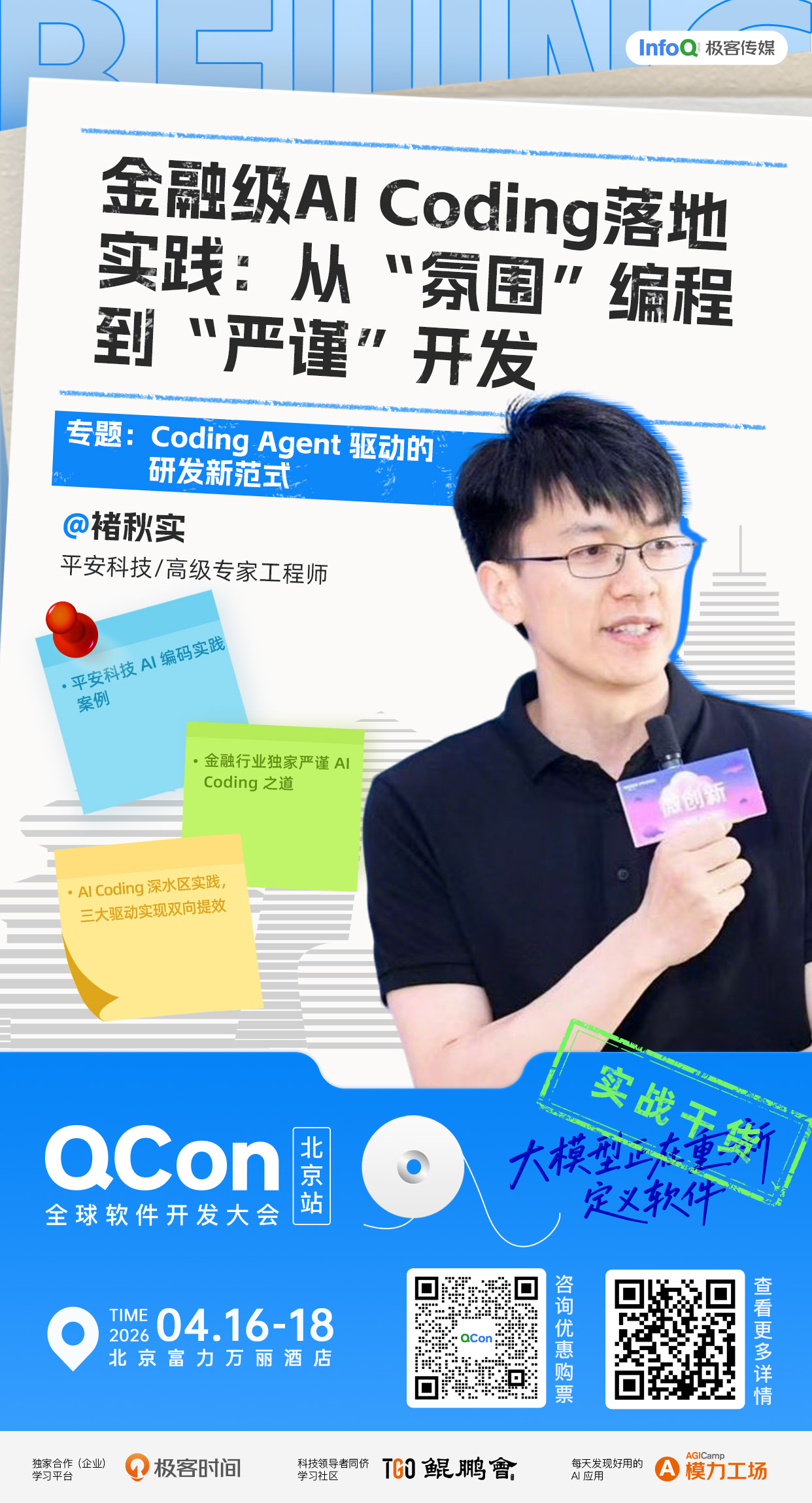

从「AI For What」到「Value From AI」,100+可落地实践案例打通 AI 实战最后一公里! 4 月 16 日-4 月 18 日,QCon 全球软件开发大会将在北京举办。本届大会锚定 Agentic AI 时代的软件工程重塑,聚焦 Agentic AI、多智能体协作、算力优化、技术债治理、多模态和 AI 原生基础设施等前沿话题,邀请来自腾讯、阿里、百度、华为、蚂蚁、小米、网易等企业技术专家,带来百余项真实落地案例,系统性分享前沿洞察与实战干货,以技术共创探索 AI 落地新路径。 平安科技高级专家工程师褚秋实已确认出席 “Coding Agent 驱动的研发新范式” 专题,并发表题为《金融级 Al Coding 落地实践:从“氛围”编程到“严谨”开发》的主题分享。随着大模型与 Coding Agent 的推理和执行能力持续迭代增强,平安科技研发团队在 AI Coding 落地方面已迈入深水区。AI 具有极强的可塑性,他们通过对实际项目工程的持续探索与实践,在试点的高频迭代复杂业务系统中,AI 入库代码占比已达 60%。同时,平安科技研发团队也对 AI 如何驱动业务平台开发形成了新的解读:即通过“设计+规范”、“知识+工具”、“模式+流程”三大驱动,实现 AI 模型与工具的能力增强与研发团队工程优化的双向管齐下与双向奔赴。 褚秋实,平安科技专家工程师,长期担任核心业务平台研发负责人,先后负责过传统金融业务平台如车险报案理赔业务、寿险保全业务;互联网金融平台如贷前贷后业务;以及创新业务 AI 区块链应用等项目开发,积累了丰富的架构设计,研发管理,敏捷及工程实践的实战经验。在 AI Coding 兴起以后,带领团队持续在实际项目中探索 AI Coding 实践,形成集团内标杆示范案例。他在本次会议的详细演讲内容如下: 演讲提纲 平安爱码:平安科技上万开发者的 Coding Agent,研效提升的"曲率引擎" 平安爱码 Agent 的形态和能力概述 2025 年平安爱码赋能研效提升成果 2. 核心实践:金融级“严谨”AlCoding 的四大支柱 规范驱动:核心实践构是建提质提效的 AI 规范驱动开发,我们在大型业务平台系统工程落地 AI Coding 的过程中,开展了两大规范驱动实践: 首先,沉淀 AI 开发指导规范:针对前后端业务功能及技术任务细分,体系化梳理形成开发指南,作为 AI Agent 产能释放的关键,有力支撑了 60%的 AI 代码占比。 其次,实现代码质量强约束与 AI“自愈”:借助 AI 将项目私域的架构设计与代码规范批量转化为 Lint、ArchUnit、P3C 等 CI 工具,无论是人工还是 AI 产出的代码,均须通过强制校验,将无形规范转化为有形约束,显著提升人机协作的代码一致性。 知识工程:核心实践是如何沉淀一个大型业务系统的结构化私域知识,大型业务系统代码库动辄百万行,涉及大量企业私域的业务概念与规则,通用大模型难以精准理解。我们通过“软件项目知识银行“的实践,将一个软件系统关键知识利用图数据库、向量数据库及文档数据库等针对性结构化存储,并通过 MCP 将知识外挂赋能 Coding Agent,补齐模型的私域业务认知短板。 上下文工程:核心实践是分场景精准管理上下文,确保 Coding Agent 在每次大模型请求时携带任务相关的精准上下文。基于一线研发实践,我们将核心任务场景划分为三类:项目功能开发、项目理解分析、项目开发质量保障,每一大类上下文又进一步细分。通过细分场景所需的具体规范、知识与工具,实现高质量私域上下文的精准加载。 人机异步协作:打造“睡后编程”人机流程,我们 AI Coding 研发的先锋团队已开始全面转型异步协作模式,开发人员在工作日一定时段会调整工作重点(每日下午后两小时及周五下午)从传统开发转向布置 AI 异步开发任务,挖掘夜间及周末等非工作时间价值。通过实施 How-to/To-do 两阶段异步开发模式,最大化研发时间的利用率提升人机异步产出。 3. 总结与展望:Coding Agent 持续演化 过去是,等等指令的"实习生" 当前是,只认文档的"外包团队" 下一步,主动规划的"技术合伙人" 这样的技术在实践过程中有哪些痛点? 很多项目的开发架构缺乏 AI 亲和严重制约了 AI Coding 在项目上的落地和发挥效果。开发架构在 AI 时代会异常重要,我们也在持续探索什么样的代码工程结构和代码组织方式是比较有利于 AI 开发的?比如 单体、微服务、模块化宏服务,前后端分离与前后端整合等怎么来提升 AI Coding 的效果? AI Coding 的编程推理模型持续在迭代能力越来越强,但是模型和项目代码库之间的隔阂全靠 coding Agent 的上下文来对齐,上下文窗口一直在扩展但是也是有限的,如何在有限的上下文上支持研发过程中多个种场景的 AI 提效,如项目理解场景、功能开发代码生成场景、质量保障场景等? 我们也在推动开发人员在 AI 加持下面的角色左移和右移,希望打造既懂业务又懂技术的前线交付工程师,全流程端对端怎么搭建稳定高效的 agentic 工作流?目前我们有一些局部尝试断点较多,特别在行业属性合规和准确要求高的要求下如何在端到端的 AI 开发上发力? 演讲亮点 平安科技 AI 编码实践案例 金融行业独家严谨 AI Coding 之道 除此之外,本次大会还策划了Agentic Engineering、多模态理解与生成的突破、记忆觉醒:智能体记忆系统的范式重塑与产业落地、具身智能与物理世界交互、Agent Infra 架构设计、AI 重塑数据生产与消费、AI 原生基础设施、AI 驱动的技术债治理、小模型与领域适配模型、大模型算力优化、Agent 可观测性与评估工程、AI for SRE等 20 多个专题论坛,届时将有来自不同行业、不同领域、不同企业的 100+资深专家在 QCon 北京站现场带来前沿技术洞察和一线实践经验。 大会日程已 100%上线,更多详情可扫码或联系票务经理 18514549229 进行咨询。

感觉现在很多领域, 品牌的审美都不如从前: