引言

在目前的现代异步编程中,取消操作是一个看似简单却极其复杂的问题。JavaScript 的 AbortController API 作为 Web 标准和 Node.js 环境中的统一解决方案,不只是解决了异步操作的可取消性难题,更体现了一种深刻的设计哲学:协作式取消(Cooperative Cancellation)。

今天我们从底层原理出发,深入剖析 AbortController 的工作机制,对比浏览器与 Node.js 的实现差异,并横向对比其他编程语言的中断机制设计,最终揭示这一 API 背后的语言特性与设计思想。那我们开始吧!

第一部分:AbortController 的底层原理

1.1 核心架构:信号-控制器分离模式

AbortController 的设计遵循信号-控制器分离模式(Signal-Controller Separation Pattern)。这种设计将"控制"与"监听"两个职责进行分离:

// 核心架构示意

class AbortController {

constructor() {

// 控制器持有信号对象的引用

this.signal = new AbortSignal();

}

abort(reason) {

// 控制器触发信号的中止状态

this.signal._abort(reason);

}

}

class AbortSignal extends EventTarget {

constructor() {

super();

this.aborted = false;

this.reason = undefined;

}

_abort(reason) {

if (this.aborted) return; // 幂等性保证

this.aborted = true;

this.reason = reason ?? new DOMException("Aborted", "AbortError");

// 触发中止事件,通知所有监听器

this.dispatchEvent(new Event("abort"));

}

}

为什么这样设计?

- 单一职责原则:控制器负责"触发",信号负责"传播"。这种分离使得一个控制器可以控制多个信号,或者多个消费者可以共享同一个信号。

- 不可变性保证:

signal 对象一旦创建,其引用关系就固定下来。消费者只能监听信号,无法重新赋值或篡改控制器的状态。 - 传播语义清晰:信号作为

EventTarget 的子类,天然支持事件订阅机制,符合 JavaScript 的异步编程范式。

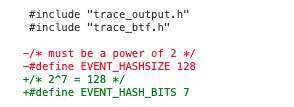

1.2 事件驱动机制:从信号到执行中断

AbortSignal 继承自 EventTarget,这意味着它使用事件驱动模型来传播取消信号。当调用 controller.abort() 时,内部执行以下步骤:

关键设计点:

- 幂等性:多次调用

abort() 不会产生副作用,确保信号状态的一致性。 - 同步触发:

abort() 的调用是同步的,事件处理也是同步执行的,这保证了取消信号的即时性。 - 不可撤销:一旦信号被中止,就无法"恢复",这符合"取消"的语义——取消是一个不可逆的操作。

1.3 底层资源释放:从信号到系统调用

AbortController 的真正威力在于它能够触发底层资源的释放。以 fetch 请求为例:

const controller = new AbortController();

fetch("/api/data", { signal: controller.signal });

// 触发取消

controller.abort();

当 abort() 被调用时,浏览器会执行以下操作:

- TCP 连接中断:浏览器向服务器发送 RST(Reset)包,强制关闭 TCP 连接。这不是"忽略响应",而是真正意义上的连接终止。

- 资源回收:释放与该请求相关的内存缓冲区、文件描述符、事件监听器等资源。

- Promise 拒绝:

fetch 返回的 Promise 被 reject,抛出 AbortError。

这种分层取消机制确保了从应用层到系统层的完整资源释放,避免了内存泄漏和资源耗尽问题。

1.4 AbortSignal.any():信号组合的设计智慧

AbortSignal.any() 是 AbortController API 的一个重要扩展,它允许将多个信号组合成一个 "或" 关系的新信号:

const timeoutSignal = AbortSignal.timeout(5000);

const userCancelSignal = new AbortController().signal;

// 任一信号触发,组合信号就触发

const combinedSignal = AbortSignal.any([timeoutSignal, userCancelSignal]);

fetch("/api/data", { signal: combinedSignal });

实现原理:

// 简化版实现示意

class AbortSignal {

static any(signals) {

const controller = new AbortController();

for (const signal of signals) {

if (signal.aborted) {

// 如果任一信号已中止,立即触发

controller.abort(signal.reason);

return controller.signal;

}

// 监听每个信号的 abort 事件

signal.addEventListener(

"abort",

() => {

controller.abort(signal.reason);

},

{ once: true },

);

}

return controller.signal;

}

}

设计要点:

- 竞态处理:如果传入的信号中已经有一个是

aborted 状态,立即触发新信号的中止。 - 原因传递:触发时传递原始信号的

reason,保持错误信息的完整性。 - 内存管理:使用

{ once: true } 确保事件监听器在触发后自动清理,避免内存泄漏。 - WeakRef 优化:实际实现中使用

WeakRef 和 FinalizationRegistry 来管理信号之间的依赖关系,防止循环引用。

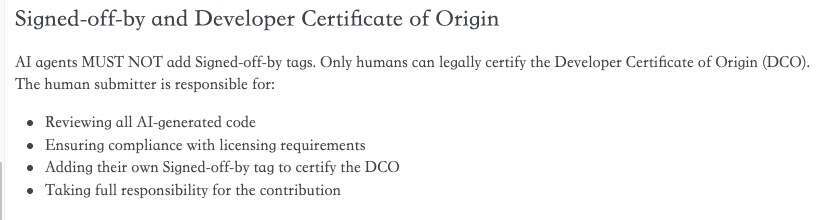

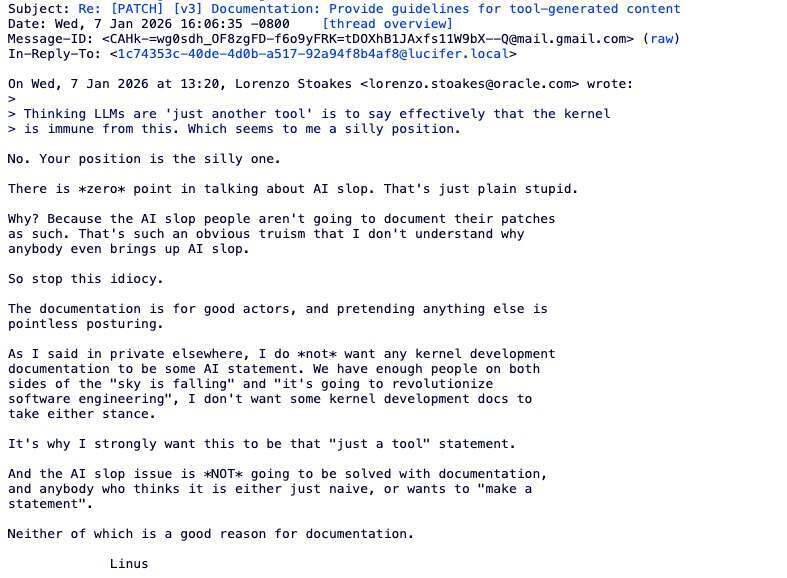

第二部分:Node.js 与 Web 实现的异同

2.1 实现层面的差异

虽然 Node.js 的 AbortController 遵循与浏览器相同的 WHATWG DOM 标准,但在底层实现上存在显著差异:

| 特性 | 浏览器(Blink/V8) | Node.js (libuv/V8) |

|---|

| 事件循环 | 基于渲染事件循环 | 基于 libuv 事件循环 |

| 网络层 | Chromium Network Stack | libuv + 系统调用 |

| 信号传播 | 通过 Blink 的绑定层 | 通过 Node.js 的 C++ 绑定 |

| 文件系统 | 受限的 File System Access API | 完整的 fs 模块支持 |

| 子进程 | 不支持 | 支持 child_process 模块 |

| Worker 线程 | Web Workers | Worker Threads |

2.2 Node.js 特有的扩展

Node.js 对 AbortController 进行了多项扩展,使其更适用于服务端场景:

2.2.1 定时器支持

import { setTimeout } from "node:timers/promises";

const controller = new AbortController();

setTimeout(1000, "value", { signal: controller.signal })

.then((value) => console.log(value))

.catch((err) => {

if (err.name === "AbortError") {

console.log("Timer aborted");

}

});

// 5秒后取消

setTimeout(() => controller.abort(), 500);

底层实现:Node.js 的定时器模块内部维护了一个 AbortSignal 到定时器句柄的映射。当信号触发时,调用 clearTimeout() 清除定时器。

2.2.2 文件系统操作

import { readFile } from "node:fs";

const controller = new AbortController();

readFile("/path/to/file", { signal: controller.signal }, (err, data) => {

if (err?.name === "AbortError") {

console.log("Read aborted");

}

});

// 取消读取

controller.abort();

重要限制:根据 Node.js 文档,文件系统的取消不会中止底层的操作系统请求,而只是中止 Node.js 内部的缓冲操作。这意味着:

这与浏览器中 fetch 的取消(可以终止 TCP 连接)有本质区别,反映了服务端 I/O 与客户端网络请求的不同特性。

2.2.3 子进程控制

import { spawn } from "node:child_process";

const controller = new AbortController();

const child = spawn("node", ["script.js"], {

signal: controller.signal,

});

child.on("error", (err) => {

if (err.name === "AbortError") {

console.log("Child process aborted");

}

});

// 终止子进程

controller.abort();

实现机制:Node.js 在子进程模块中监听 AbortSignal 的 abort 事件,触发时向子进程发送 SIGTERM 信号。如果子进程未在超时内退出,则发送 SIGKILL 强制终止。

2.3 行为一致性与边界情况

2.3.1 事件触发时序

浏览器和 Node.js 在事件触发时序上保持一致:

const controller = new AbortController();

const signal = controller.signal;

// 注册多个监听器

signal.addEventListener("abort", () => console.log("Listener 1"));

signal.addEventListener("abort", () => console.log("Listener 2"));

controller.abort();

console.log("After abort");

// 输出顺序:

// Listener 1

// Listener 2

// After abort

事件监听器是同步执行的,这保证了取消操作的即时性。

2.3.2 已完成的操作

如果操作已经完成,取消信号会被忽略:

const controller = new AbortController();

fetch("/api/data", { signal: controller.signal }).then((response) => {

console.log("Request completed");

});

// 延迟触发取消(假设请求已经完成)

setTimeout(() => {

controller.abort(); // 不会产生任何效果

}, 1000);

这种行为是协作式取消的核心体现:消费者决定如何响应取消信号,包括选择忽略它。

第三部分:跨语言对比——中断机制的设计哲学

3.1 协作式取消 vs 抢占式取消

不同编程语言对"取消操作"的设计哲学可以分为两大类:

3.2 Go:Context 模式

Go 语言的 context 包提供了与 JavaScript AbortController 类似的协作式取消机制:

// Go 的 Context 模式

ctx, cancel := context.WithCancel(context.Background())

defer cancel()

// 启动 goroutine

go func(ctx context.Context) {

select {

case <-ctx.Done():

// 收到取消信号

fmt.Println("Cancelled:", ctx.Err())

return

case <-time.After(5 * time.Second):

fmt.Println("Work completed")

}

}(ctx)

// 触发取消

cancel()

与 JavaScript 的对比:

| 特性 | Go Context | JavaScript AbortController |

|---|

| 信号类型 | Channel(<-ctx.Done()) | Event(addEventListener) |

| 传播方式 | 显式传递 ctx 参数 | 通过 signal 属性传递 |

| 超时支持 | context.WithTimeout() | AbortSignal.timeout() |

| 值传递 | 支持 ctx.Value() | 不支持(专用设计) |

| 组合能力 | 可以嵌套传递 | AbortSignal.any() 组合 |

设计差异分析:

Go 的 context 不仅是取消信号,还承担了请求作用域数据传递的职责(通过 ctx.Value())。这种设计在微服务架构中非常有用,可以传递请求 ID、用户信息等。JavaScript 的 AbortController 则专注于单一职责:取消信号传递。

3.3 C#:CancellationToken 模式

.NET 的 CancellationToken 是一个成熟的协作式取消机制:

// C# 的 CancellationToken 模式

using var cts = new CancellationTokenSource();

CancellationToken token = cts.Token;

try {

await Task.Run(async () => {

while (!token.IsCancellationRequested) {

// 执行任务

await Task.Delay(100);

}

}, token);

} catch (OperationCanceledException) {

Console.WriteLine("Operation cancelled");

}

// 触发取消

cts.Cancel();

关键特性:

- 轮询与回调双模式:既可以通过

IsCancellationRequested 属性轮询,也可以通过 Register() 方法注册回调。 - 链接令牌:

CreateLinkedTokenSource() 可以将多个令牌链接成一个,任一令牌取消都会触发整体取消。 - 异常类型:取消时抛出

OperationCanceledException,与 JavaScript 的 AbortError 对应。

与 JavaScript 的对比:

⚖️ 核心差异对照表

| 对比维度 | C# CancellationToken | JS AbortSignal |

|---|

| 类型系统 | struct(值类型) | class(引用类型) |

| 传递语义 | 按值复制(快照式) | 按引用共享(同一实例) |

| 取消检测 | 轮询 .IsCancellationRequested | 监听 'abort' 事件 |

| 异常类型 | OperationCanceledException | DOMException("AbortError") |

| 资源释放 | 需手动 .Dispose() CTS | GC 自动回收 |

| 超时内置 | cts.CancelAfter() | AbortSignal.timeout() (ES2024) |

| 多信号合并 | CreateLinkedTokenSource() | AbortSignal.any() (ES2024) |

| 与 fetch 集成 | ❌ 不适用 | ✅ 原生支持 |

| 与 async/await | ✅ 原生支持 | ✅ 原生支持 |

3.4 Java:Future.cancel() 与线程中断

Java 提供了两种取消机制:

3.4.1 Future.cancel()(协作式)

ExecutorService executor = Executors.newSingleThreadExecutor();

Future<?> future = executor.submit(() -> {

while (!Thread.currentThread().isInterrupted()) {

// 执行任务

}

});

// 尝试取消

future.cancel(true); // true = 允许中断运行中的线程

3.4.2 线程中断(抢占式)

Thread workerThread = new Thread(() -> {

try {

Thread.sleep(10000);

} catch (InterruptedException e) {

// 收到中断信号

Thread.currentThread().interrupt(); // 重新设置中断标志

}

});

workerThread.start();

workerThread.interrupt(); // 发送中断信号

关键区别:

Java 的 Thread.interrupt() 并不会强制停止线程,而是设置一个中断标志。线程需要主动检查这个标志(通过 isInterrupted())或在可中断的阻塞操作(如 sleep(), wait())中捕获 InterruptedException。

这与 JavaScript 的 AbortController 非常相似,都是协作式的。但 Java 还保留了 Thread.stop()(已废弃)这样的抢占式方法,反映了早期 Java 设计中对抢占式取消的探索。

3.5 Kotlin:协程的取消机制

Kotlin 协程的取消是结构化并发(Structured Concurrency)的核心特性:

import kotlinx.coroutines.*

fun main() = runBlocking {

val job = launch {

try {

repeat(1000) { i ->

println("Job: I'm working $i ...")

delay(500L)

}

} finally {

// 清理资源

println("Job: I'm running finally")

}

}

delay(1300L)

println("main: I'm tired of waiting!")

job.cancelAndJoin() // 取消并等待完成

println("main: Now I can quit.")

}

关键特性:

- 挂起点的取消检查:Kotlin 协程只在挂起点(suspension points)检查取消状态。如果协程处于 CPU 密集型计算中,不会立即响应取消。

- 异常传播:取消时抛出

CancellationException,这是一种特殊的异常,不会被视为错误。 - 父子关系:子协程的取消会传播给所有子协程,形成树状的取消传播。

与 JavaScript 的对比:

3.6 Python:asyncio.Task 的取消

Python 的 asyncio 提供了任务取消机制:

import asyncio

async def worker():

try:

while True:

print("Working...")

await asyncio.sleep(1)

except asyncio.CancelledError:

print("Cancelled!")

raise # 必须重新抛出

async def main():

task = asyncio.create_task(worker())

await asyncio.sleep(2)

task.cancel()

try:

await task

except asyncio.CancelledError:

print("Task cancelled")

asyncio.run(main())

设计特点:

- 异常驱动:取消通过抛出

CancelledError 实现,任务需要捕获并重新抛出。 - 异步清理:

finally 块中可以执行异步清理操作(使用 async 语法)。 - 取消传播:父任务取消时,子任务会自动收到取消信号。

与 JavaScript 的对比:

Python 的 asyncio.CancelledError 与 JavaScript 的 AbortError 类似,都是异常驱动的取消机制。但 Python 的取消更依赖异常传播,而 JavaScript 更依赖事件监听。

3.7 Rust:异步取消与 Drop 语义

Rust 的异步取消机制与众不同,它利用了所有权和 Drop trait:

use tokio::time::{sleep, Duration};

#[tokio::main]

async fn main() {

let handle = tokio::spawn(async {

sleep(Duration::from_secs(5)).await;

println("Task completed");

});

// 取消任务

handle.abort();

match handle.await {

Ok(_) => println!("Task finished normally"),

Err(e) if e.is_cancelled() => println!("Task was cancelled"),

Err(e) => println!("Task panicked: {:?}", e),

}

}

核心概念:

- Future 的 Drop:在 Rust 中,当一个

Future(异步任务)被 drop(丢弃)时,任务就被取消了。这是通过所有权系统实现的。 - 取消安全性(Cancel Safety):Rust 强调"取消安全性",即任务在被取消时不会留下不一致的状态。这通常要求使用特定的模式(如

select! 宏)。 - Async Drop:Rust 正在讨论引入

AsyncDrop trait,允许在 drop 时执行异步清理操作。

与 JavaScript 的对比:

第四部分:设计哲学与最佳实践

4.1 为什么协作式取消是主流?

从上述跨语言对比可以看出,协作式取消已成为现代异步编程的主流设计。原因如下:

- 资源安全:协作式取消允许任务在退出前执行清理操作(关闭文件、释放锁、回滚事务等),避免资源泄漏。

- 状态一致性:任务可以在安全点(挂起点或检查点)响应取消,确保数据结构处于一致状态。

- 可预测性:取消的时机和行为是确定的,不会出现抢占式取消的"任意点中断"问题。

- 组合性:多个取消信号可以组合(如

AbortSignal.any()),形成复杂的取消策略。

4.2 AbortController 的设计原则总结

根据 WHATWG DOM 规范和各实现的设计文档,AbortController 遵循以下核心原则:

分离原则(Separation)

- 控制器(Controller)负责触发

- 信号(Signal)负责传播

- 消费者(Consumer)决定如何响应

幂等性原则(Idempotency)

- 多次调用 abort() 无副作用

- 信号一旦中止,状态不可变

即时性原则(Immediacy)

- abort() 调用是同步的

- 事件处理是同步的

- 保证取消信号的即时传播

不可撤销原则(Irreversibility)

组合性原则(Composability)

- 支持多个信号的组合(any, race)

- 支持信号链的传播(dependent signals)

资源安全原则(Resource Safety)

- 提供清理算法的注册机制

- 支持自动解订阅(unsubscription)

4.3 实际应用中的最佳实践

4.3.1 始终传递 Signal

// ✅ 好的实践:函数接受 signal 参数

async function fetchData(url, options = {}) {

const { signal } = options;

// 立即检查

signal?.throwIfAborted();

const response = await fetch(url, { signal });

// 中间检查

signal?.throwIfAborted();

return response.json();

}

// ❌ 不好的实践:忽略 signal

async function fetchDataBad(url) {

return fetch(url).then((r) => r.json()); // 无法取消

}

4.3.2 正确清理事件监听器

async function someOperation(signal) {

const cleanup = new AbortController();

// 使用嵌套 signal 确保清理

signal?.addEventListener(

"abort",

() => {

cleanup.abort();

},

{ once: true },

);

try {

await doWork({ signal: cleanup.signal });

} finally {

// 确保清理

cleanup.abort();

}

}

4.3.3 区分取消错误与其他错误

async function robustFetch(url, signal) {

try {

return await fetch(url, { signal });

} catch (error) {

if (error.name === "AbortError") {

// 取消是预期的行为,不需要上报

console.log("Request cancelled");

return null;

}

// 其他错误需要处理

throw error;

}

}

4.3.4 使用 AbortSignal.timeout() 设置超时

// ✅ 推荐:使用内置的超时信号

const signal = AbortSignal.timeout(5000);

// ❌ 不推荐:手动实现

const controller = new AbortController();

setTimeout(() => controller.abort(), 5000);

4.3.5 组合多个取消条件

// 组合用户取消和超时

const userController = new AbortController();

const timeoutSignal = AbortSignal.timeout(10000);

const combinedSignal = AbortSignal.any([userController.signal, timeoutSignal]);

fetch("/api/data", { signal: combinedSignal }).catch((err) => {

if (err.name === "AbortError") {

// 判断是哪种取消

if (timeoutSignal.aborted) {

console.log("Timeout");

} else {

console.log("User cancelled");

}

}

});

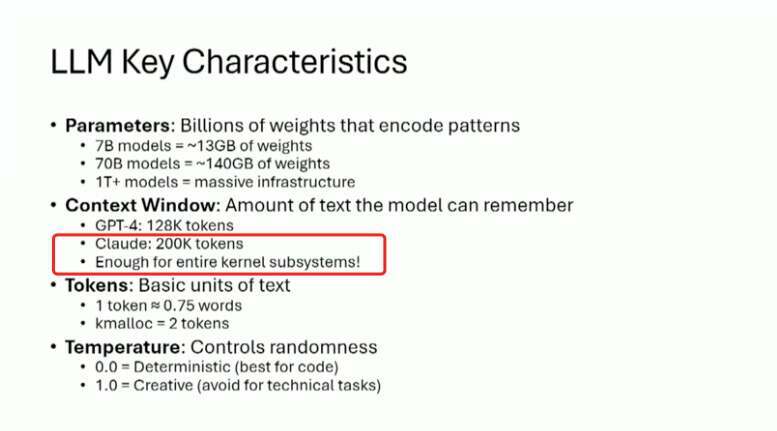

第五部分:深入思考——语言特性对设计的影响

5.1 JavaScript 的事件驱动本质

AbortController 的设计深深植根于 JavaScript 的事件驱动(Event-Driven)本质。JavaScript 作为单线程语言,无法使用抢占式中断(如线程信号),必须通过事件循环机制来传播信号。

这种设计使得 AbortController 与 JavaScript 的异步模型(Promise、async/await、EventTarget)无缝集成。

5.2 单线程模型的限制与优势

JavaScript 的单线程模型限制了取消机制的设计空间:

- 无法强制中断:无法像操作系统信号那样强制中断执行中的代码。

- 必须协作:任务必须主动检查信号并响应。

但这种限制也带来了优势:

- 避免竞态条件:没有抢占式中断的"任意点中断"问题,状态一致性更容易保证。

- 简化并发模型:单线程 + 事件循环使得取消信号的传播路径清晰可预测。

5.3 对比其他语言的设计选择

不同语言的中断机制设计反映了它们的运行时特性:

| 语言 | 运行时模型 | 取消机制 | 设计选择 |

|---|

| JavaScript | 单线程 + 事件循环 | AbortController | 事件驱动,协作式 |

| Go | M:N 协程调度 | context.Context | Channel 驱动,协作式 |

| C# | 线程池 + Task | CancellationToken | 轮询 + 回调,协作式 |

| Java | OS 线程 | Future.cancel() + 中断 | 混合式(协作为主) |

| Kotlin | 协程(挂起/恢复) | Job.cancel() | 挂起点检查,协作式 |

| Rust | 异步 Future + 轮询 | Drop 语义 | 所有权驱动,协作式 |

| Python | 事件循环 + 协程 | Task.cancel() | 异常驱动,协作式 |

核心点:

所有现代语言都选择了协作式取消,这不是偶然,而是对资源安全和状态一致性的共同追求。不同语言的实现方式反映了它们的核心抽象模型:

- JavaScript 的 EventTarget → 事件驱动

- Go 的 Channel → 通信顺序进程(CSP)

- Rust 的 Ownership → 编译时安全

- Kotlin 的 Structured Concurrency → 父子作用域

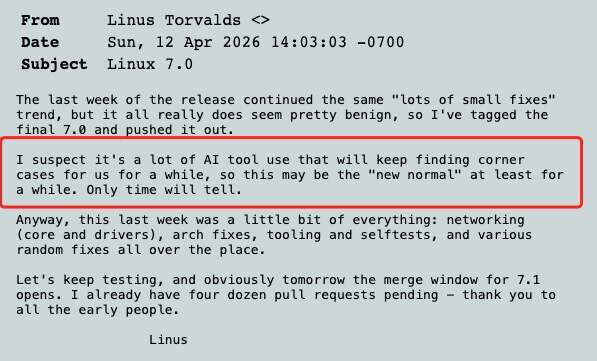

结论

AbortController 不仅是一个 API,更是 JavaScript 异步编程哲学的集中体现。它的设计遵循了以下核心思想:

- 协作优于强制:通过信号机制让任务自主决定如何响应取消,保证资源安全和状态一致性。

- 分离优于耦合:控制器与信号的分离使得取消逻辑可以灵活组合和传播。

- 事件驱动优于轮询:利用 JavaScript 的事件循环机制,实现即时、可靠的信号传播。

- 组合优于继承:

AbortSignal.any() 等组合操作使得复杂的取消策略可以用简单的原语构建。

跨语言对比揭示了一个行业共识:协作式取消是现代异步编程的最佳实践。无论是 Go 的 Context、C# 的 CancellationToken、Kotlin 的协程取消,还是 Rust 的 Drop 语义,都在用各自语言的核心抽象表达同一个理念——让取消成为一等公民,但绝不以牺牲安全为代价。

理解 AbortController 的底层原理,不仅能帮助我们写出更健壮的异步代码,更能让我们洞察语言设计背后的深层思考:好的设计不是增加复杂性,而是在约束条件下找到最优雅的解决方案。

本文由mdnice多平台发布