开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement) 领域内「有话题的技术」、「有亮点的产品」、「有思考的文章」、「有态度的观点」、「有看点的活动」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@瓒an、@鲍勃

01 有话题的技术

1、Apple 以 20 亿美元收购 Q.ai:通过面部微表情识别「无声对话」指令

在 AI 上日渐落后的苹果,最近几个月加紧了前进步伐。抛弃 OpenAI,携手 Google Gemini 后,苹果近日又有新动作。

当地时间 1 月 29 日,苹果公司完成了一项近 20 亿美元的收购,目标是以色列 AI 初创公司 Q.ai。

这是苹果自 2014 年以 30 亿美元收购 Beats 以来,规模第二大的交易。

据《金融时报》等多家媒体报道,Q.ai 的核心技术在于分析面部微表情和肌肉运动,从而解读「无声对话」(Silent Speech),即用户无需发出声音,仅通过嘴部动作即可被设备识别意图。

这项技术被认为有望集成到未来的 AirPods、iPhone 乃至传闻中的 AI 眼镜中,实现更私密、无障碍的人机交互。

Q.ai 的创始团队背景显赫,联合创始人 Aviad Maizels 此前创立的 PrimeSense 公司在 2013 年被苹果收购,其技术后来成为 iPhone Face ID 的原型。

此次收购在苹果发布强劲财报的同一天公布,凸显了公司在 AI 硬件竞赛中补短板的急迫性。

(@极客公园)

2、商汤开源 SenseNova-MARS:8B/32B 双版本 Agentic VLM,多模态搜索得分 69.74 超越 GPT-5.2

1 月 29 日,商汤正式开源多模态自主推理模型 SenseNova-MARS(8B/32B 双版本),其在多模态搜索与推理的核心基准测试中以 69.74 分超越 Gemini-3-Pro(69.06 分)、GPT-5.2(67.64 分)。

SenseNova-MARS 是首个支持动态视觉推理和图文搜索深度融合的 Agentic VLM 模型,它能自己规划步骤、调用工具,轻松搞定各种复杂任务,让 AI 真正具备「执行能力」。

在 MMSearch、HR-MMSearch、FVQA、InfoSeek、SimpleVQA、LiveVQA 等基准测试中,SenseNova-MARS 取得开源模型中的 SOTA 成绩,还超越 Gemini-3.0-Pro、GPT-5.2 等顶级闭源模型,在搜索推理和视觉理解两大核心领域全面领跑。

在具体的评测数据方面,SenseNova-MARS 在图文搜索核心评测 MMSearch 榜单中以 74.27 分登顶,优于 GPT-5.2 的 66.08 分;在高清细节搜索评测 HR-MMSearch 中以 54.43 分领先。

简单说,无论是需要「查遍全网」的知识密集型任务,还是需要「火眼金睛」的细粒度视觉分析,它都是当前的「全能冠军」。

SenseNova-MARS 拥有「自主思考+多工具协作」的能力,能够自动解决「细节识别 + 信息检索 + 逻辑推理」复杂任务,帮助实现工作效率提升。

- 图像裁剪:能精准聚焦图片上的微小细节,哪怕是占比不到 5%的细节——比如赛车手衣服上的微小 logo、赛事照片里观众席的标语,都可通过裁剪放大清晰分析。

- 图像搜索 :能在看到物体、人物或场景,的瞬间自动匹配相关信息——比如识别出赛车手的身份,或是某款冷门设备的型号。

- 文本搜索:能快速抓取精准信息——无论是公司成立年份、人物出生年月,还是最新的行业数据,都能秒级获取。

技术上,SenseNova-MARS 采用分阶段训练:第一阶段利用多模智能体数据合成引擎,结合细粒度视觉锚点与多跳检索构建高逻辑链条数据,并通过自洽性校验去除幻觉;第二阶段引入强化学习与 BN-GSPO 算法,采用双阶段归一化的优雅机制有效平滑了动态工具调用返回分布多样性带来的优化波动并确保了学习信号分布的一致性,从而成功解决了跨模态多步多工具智能体训练过程中的收敛性难题。,培养出稳定的「工具使用直觉」。

目前,商汤日日新 SenseNova-MARS 的模型、代码及数据集已全部开源。

技术报告:

https\://arxiv.org/abs/2512.24330

Github:

https\://github.com/OpenSenseNova/SenseNova-MARS

(@商汤科技 SenseTime)

3、阶跃星辰发布 Step 3.5 Flash:为 Agent 而生的开源「轻骑兵」

阶跃星辰(StepFun)于 2026 年 2 月 2 日正式上线并开源了其最新基座模型 Step 3.5 Flash。该模型定位为具备强大推理能力与 Agent 智能的「Agent 大脑」,强调在性能与模型尺寸之间取得平衡。

据官方介绍,Step 3.5 Flash 的核心特点在于「更快、更强、更稳」。在单请求代码类任务中,其推理速度最高可达 350 TPS;在 Agent 场景和数学任务上,其表现可媲美闭源模型;同时具备处理复杂、长链条任务的能力。相关数据显示,该模型在开启 Parallel Thinking(并行思考)后性能有进一步增强。

为了实现高响应速度与可控成本,Step 3.5 Flash 采用了以下技术架构:

- 稀疏 MoE 架构:拥有 1960 亿总参数,但每个 token 仅激活约 110 亿参数。

- MTP-3 技术:支持模型一次预测 3 个 Token,使效率翻倍。

- 混合注意力机制:采用 3:1 滑动窗口与全局注意力(SWA + Full Attention)混合架构,在长文本中聚焦重点以显著降低计算开销,支持高效处理 256K 上下文。

在实际应用案例中,Step 3.5 Flash 展示了多维度的能力:

在计算场景下,它能快速处理复杂的等差数列及高阶数学运算。

在智能体编程方面,模型基于文字提示自动构建了一个气象情报仪表盘,该可视化平台搭载定制 WebGL 2.0 引擎,可实时处理超过 15,000 个动态节点及 WebSocket 遥测数据流。

此外,在端云结合的演示中,该模型作为「云端大脑」将 Mac Mini M4 的全网比价需求拆解为针对淘宝、京东和拼多多的具体子任务,指导本地 Step-GUI 执行数据抓取并汇总出最低价平台,体现了云端协同对本地执行难度的降低。

此外,阶跃星辰透露已启动 Step 4 模型的训练,并邀请社区共同参与下一代 Agent 基础模型的定义。

官方网页:

https\://www.stepfun.com/

GitHub:

https\://github.com/stepfun-ai/Step-3.5-Flash/tree/main

HuggingFace:

https\://huggingface.co/stepfun-ai/Step-3.5-Flash

(@阶跃星辰)

02 有亮点的产品

1、韩国客服 AI Agent 构建与运营商 TeamKai 获种子轮融资:AI 智能体实现 60% 无人干预任务处理与趋零幻觉率

据 2026 年 2 月 1 日消息,客户服务 AI Agent 构建与运营商 TeamKai 宣布获得来自 Sparklabs 和 Murex Partners 的种子轮融资。 公司方面未披露具体的融资金额。

这家初创公司成立于 2024 年,由 Doa Kim 创立。Doa Kim 曾在韩国头部旅游平台 Myrealtrip 担任首席运营官,拥有十年客户服务运营经验,期间处理过包括机票预订、酒店预订及旅游套餐在内的各类复杂业务支持场景。

TeamKai 的差异化优势在于其采取的综合性服务模式。 该公司不仅提供 AI Agent,还负责从实施咨询到直接对接客户内部系统,乃至提供全套客户服务外包等环节。其 AI Agent 能够承担人类客服代表所处理的全方位任务。

在过去一年中,TeamKai 拓展了旅游、电子商务和消费品领域的客户,年度经常性收入(ARR)已接近 6.8 万美元(约 1 亿韩元)。投资方 Sparklabs 对 TeamKai 的技术能力表示认可,数据显示其 AI Agent 可在无人干预的情况下完成超过 60% 的任务,且幻觉率正趋近于零。投资方认为这些指标赋予了 TeamKai 在全球范围内竞争的潜力。在 Sparklabs 投资后,TeamKai 还成功入选了韩国中小企业和初创企业部的技术孵化项目 TIPS。

TeamKai 计划利用这笔资金进一步推动技术发展,提升 AI Agent 处理查询的成功率,并吸纳更多客户。Sparklabs 首席执行官 Yujin Kim 评价称,TeamKai 洞察了客户服务中的实际痛点并正在系统性地修复这些问题,有望将 AI 联络中心从成本消耗中心转变为提升客户体验和效率的引擎。TeamKai 首席执行官 Doa Kim 表示,AI 正在彻底改变客户服务外包的经济模式,她专注于创造让 AI 真正主导运营的环境,并对结果负责。

( @WOWTALE)

2、消息称乐奇 Rokid 将推新一代 AI「智能体」眼镜,联合国内头部大模型公司打造

今天上午,《科创板日报》援引接近乐奇 Rokid 的行业资深人士信息称,Rokid 正与「国内头部大模型公司」合作,研发专属端侧多模态模型,下一代 AI 眼镜产品聚焦生成式 AI 以及 AI Agent 为驱动的全新操作系统和 UI。目前 Rokid 眼镜日销量大约为 1200 副,线上和线下各占半。

今年早些时候,乐奇 Rokid 携史上最大面积 AI 眼镜展台登陆 CES 2026 主会场中心,带来核心产品乐奇 AI 眼镜(Rokid Glasses)。

此外,Rokid 还推出了行业首个智能体商店。用户无需繁琐操作,仅凭语音指令就能唤起覆盖各行各业的 AI 专家:既能解决高铁车次查询、食物热量计算等日常刚需,也能体验班味检测、高情商聊天等趣味功能。

据 IT 之家此前报道,乐奇 AI 眼镜深度整合了包括 DeepSeek、通义千问、豆包、智谱在内的多款 AI 大模型,并与高德地图、支付宝、京东科技等国内伙伴达成生态合作。在海外市场,Rokid Glasses 已与谷歌地图、微软翻译等国际巨头建立合作。

(@IT 之家)

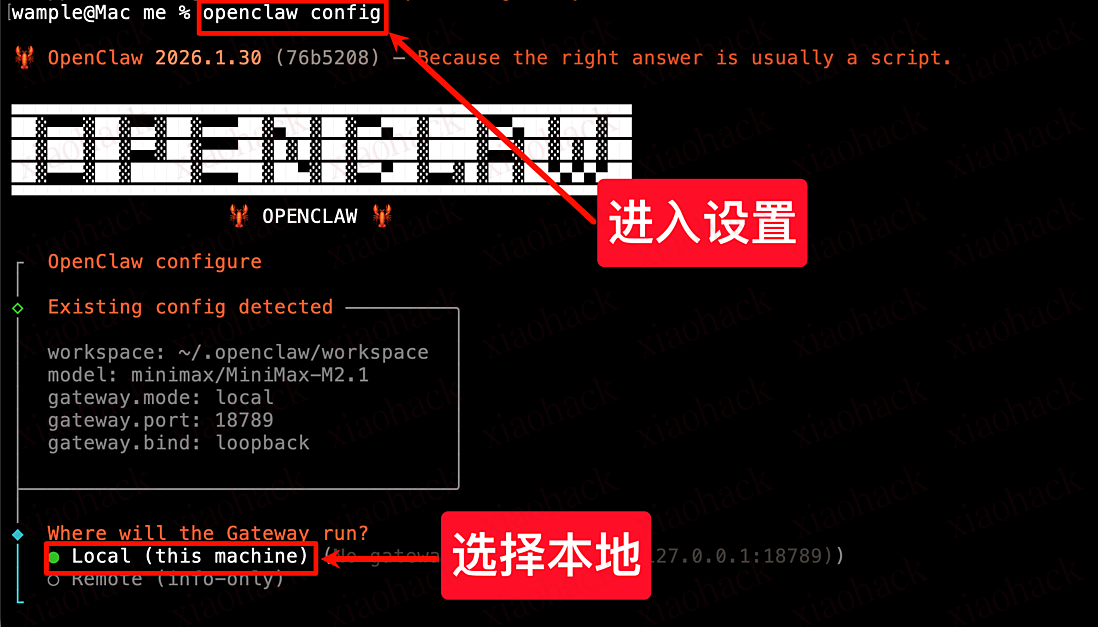

3、两个 95 后华人打造「硬件版 OpenClaw」:售价 1700 元,支持硬件 Vibe Coding

硅谷初创项目 Pamir 近期推出了一款名为 Distiller Alpha 的硬件设备,被市场称为「硬件版 OpenClaw」。该设备售价 250 美元(约合人民币 1700 元),是一款软硬件一体化的本地 Agent 产品。

Distiller Alpha 本质上是一台微型 Linux 电脑,其核心计算模块基于树莓派 CM5,配置为 8GB 内存和 64GB 存储。在硬件形态上,该设备集成了墨水屏、麦克风、扬声器、摄像头及 LED 灯带,整体尺寸小于手机。系统预装了 Agent 环境,支持开机即用,用户通过扫描墨水屏上的二维码即可进入交互界面。

该产品的一个核心应用场景是「Vibe coding」,即支持开发者通过手机远程编写代码。 与纯软件方案不同,Distiller Alpha 能够直接连接并控制物理硬件。用户可以将设备连接至开发板、蓝牙设备或打印机,通过自然语言指令让 Agent 自动编写驱动代码、进行逆向工程或统一管理智能家居设备,实现了从代码生成到硬件烧录的闭环。

Pamir 联合创始人叶天奇在采访中指出,虽然 Mac mini 等通用电脑性能强大,但并非为 Agent 原生设计,缺乏底层的执行与回滚机制。相比之下,Distiller Alpha 定位为「原生 Agent 硬件」,在系统层面进行了针对性设计:

- 交互逻辑:去除了传统的桌面与屏幕系统,通过内网直连或硬件指示灯(如 LED 状态)进行交互,更适合 Agent 的全天候后台运行。

- 自修复机制:内置 Watchdog(看门狗)系统,当 Agent 修改代码导致系统崩溃时,设备可自动检测并完成系统回滚与修复。

- 安全性:硬件层面植入加密芯片存储 Agent ID,配合物理隔绝属性,形成物理沙盒以保护敏感数据。

在实际应用中,该设备被不同类型的用户定义了多层级的使用方式:

- 智能存储:作为具备理解能力的移动硬盘,帮助律师等知识工作者处理大量文档或直接修改 U 盘文件。

- 自动化代理:代替用户执行网页浏览、餐厅预订等操作,模拟真实人类行为以规避反爬虫检测。

- 知识资产托管:程序员或安全专家将个人的经验整理为 SOP,让 Agent 24 小时运行进行漏洞挖掘或辅助工作。

Pamir 的创始团队由两位 95 后华人叶天奇和张城铭组成。项目早期曾尝试 To B 的端侧 AI 业务,后转型 To C 市场。团队认为,未来 Agent 将需要独立的计算设备而非寄生于现有电脑屏幕。叶天奇表示,相比于单纯的软件竞争,系统层与硬件层的深度集成(涵盖供应链、能耗控制及安全机制)将构建起更稳固的护城河,其长期目标是探索一种不再以屏幕为核心的个人计算新形态。

(@量子位)

4、AI 玩具品牌 FoloToy 连获数千万元融资:深创投参投,2025 年国内销量增长 5 倍

FoloToy 近日宣布连续完成数千万元 Pre-A 轮及 Pre-A+ 轮融资。本轮投资方为深创投和南山战新投,老股东火火兔持续跟投,指数资本担任独家财务顾问。据悉,融资资金将主要用于扩大品牌影响力及渠道建设。

FoloToy 成立于 2023 年,核心团队由「极客奶爸」王乐和郭兴华组成。公司致力于为儿童提供「高质量、会聊天、有深度」的 AI 陪伴玩具,其出发点在于将旧玩具转化为具备对话能力的伙伴。

目前,FoloToy 采取 C 端与 B 端并行的策略,推出了经典陪伴、成长伴学、创新文旅及企业定制等产品线,并与各大 IP 方建立了深度研发合作。指数资本分析认为,FoloToy 在 IP 合作上具备独特的差异化思路:

- 技术赋能 IP:利用 AI 机芯 Magicbox(魔匣)让 IP 角色「活过来」。不同于简单的形象授权,FoloToy 能够让角色配合故事更新,支持分龄互动、千人千面及多玩具互联,使传统静态 IP 转化为鲜活的对话角色。

- 设计师挖掘:提前挖掘并培育有潜力的设计师与艺术家。

- 公共 IP 绑定:抢占如「AI 泰迪熊」等公共 IP 的心智,使其与品牌形成强关联。

在市场表现方面,FoloToy 透露其 2025 年国内销量较 2024 年增长五倍。 在海外市场,产品已进入美国、瑞典、德国、日本等地,并正在布局北美及欧洲市场。

当前 AI 玩具赛道正处于快速增长期。 据 Facts & Factors 预测,到 2032 年玩具市场规模将达到 500 亿美元,且大模型技术的发展可能加速这一进程。指数资本指出,在 3-9 岁儿童 AI 陪伴玩具领域,存在需求验证与供给空白的交叉机会。尽管需求侧对安全、可控且具备情绪价值的产品需求明确,但供给侧缺乏集 AI 技术、IP 运营、玩具制造与教育内容于一体的「四合一」产品。目前该赛道尚未出现市占率超过 5% 的品牌。

针对这一市场现状,FoloToy 已形成清晰的商业化路径:

- C 端消费市场:推出 AI 仙人掌、AI 向日葵、AI 小熊等伴学哄娃产品,内置自研儿童对话模型,支持中英双语及实时内容过滤。

- B 端企业定制:与大型企业联名合作,如联合招商银行推出培养财商的「金小葵」,联合飞鹤奶粉推出主打早教的「鹤小小」。

- 行业场景创新:提供行业解决方案,例如为博物馆开发的互动剧本「AI 猫馆长」,以及为教育机构提供的「八爪鱼」AI 学习套件。

行业观察认为,目前的 AI 玩具市场仍处于早期「IP+AI」同质化发展阶段,未来将进入产品验证期,安全性、可玩性与实用性将成为竞争核心。

(@多知)

03 有态度的观点

1、扎克伯格:AI 是社媒的未来

据 The Verge 消息,Meta CEO 扎克伯格日前在财报电话会上表示,人工智能(AI)将会是社交媒体的未来。

扎克伯格指出,AI 将会使得社交媒体的内容更加沉浸。「社媒的最初形态是文字,然后在手机具备摄像功能后转向照片,接着再移动数据网络足够快时进入视频时代。很快,我们将看到全新的媒体形态爆发。」

其还补充表示,目前的社媒大多使用推荐内容的算法,但这种情况将发生改变,未来 Meta 的应用将以 AI 迎接客户,这些 AI 将能够「理解」用户并提供他们喜欢的内容,还能够生成出色的个性化内容。

会上,扎克伯格还提到到,AI 接入社媒后,用户将能够通过一段提示词(prompt)来创造一个虚拟世界或游戏,并且能与好友分享,甚至连视频在未来也将成为可以互动的形式。

值得一提的是,Google 近期正式推出了世界模型 Genie 3,用户只需要简单的提示词以及一张图片,便可以生成能够互动游玩的实时交互内容。

( @APPSO)

阅读更多 Voice Agent 学习笔记:了解最懂 AI 语音的头脑都在思考什么

写在最后:

我们欢迎更多的小伙伴参与 「RTE 开发者日报」 内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

作者提示: 个人观点,仅供参考