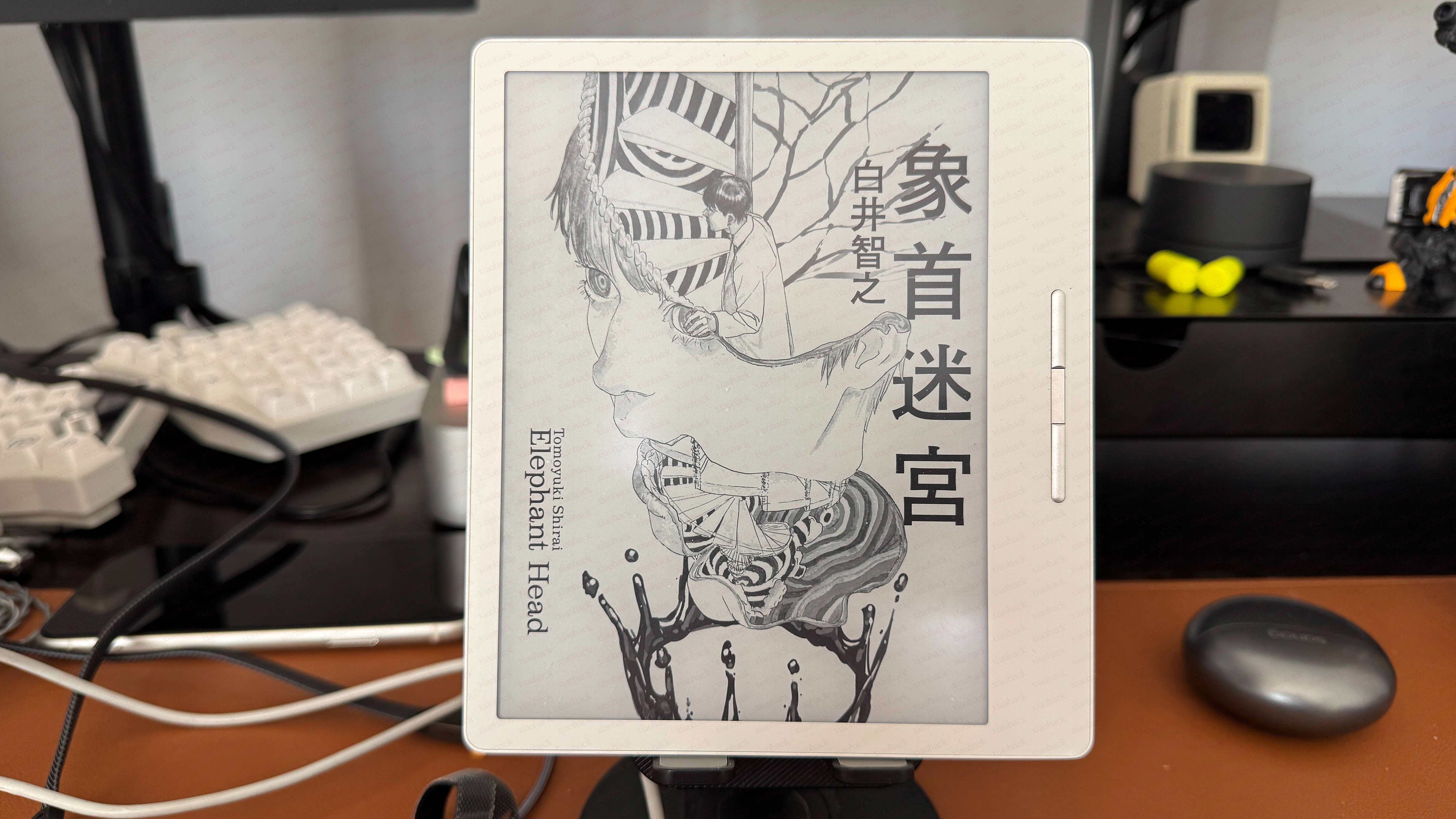

【开源】外星科技 一键对鼠标下图片文本进行 OCR 智能捕获文本框,拼接,并用大模型清理输出。 还在手动框选? 你 out 啦~~

外星科技

一键对鼠标下图片文本进行 OCR

智能捕获文本框,拼接,并用大模型清理输出。

还在手动框选? 你 out 啦~~

核心库:文本检测模块 - PaddleOCR

xiaohack博客专注前沿科技动态与实用技术干货分享,涵盖 AI 代理、大模型应用、编程工具、文档解析、SEO 实战、自动化部署等内容,提供开源项目教程、科技资讯日报、工具使用指南,助力开发者、AI 爱好者获取前沿技术与实战经验。

外星科技

一键对鼠标下图片文本进行 OCR

智能捕获文本框,拼接,并用大模型清理输出。

还在手动框选? 你 out 啦~~

核心库:文本检测模块 - PaddleOCR

Reddit 是欧美年轻人扎堆的兴趣社区,类似国内贴吧,但更垂直。用户以 24-44 岁男性为主,爱科技、游戏、亚文化,消费力强且反感硬广。出海人可通过创建兴趣小组(Subreddit)、发干货帖子、办 AMA 问答活动自然引流,但需长期互动,避免直接推销

PRAW (Python Reddit API Wrapper) 是一个 Python 库,它封装了 Reddit 的 API, 让我们能够轻松地与 Reddit 进行交互。使用 PRAW, 我们可以获取帖子、评论,甚至可以发布内容或管理 subreddit。PRAW 不仅简化了 Reddit API 的使用,还提供了许多便利功能,使得 Reddit 数据抓取变得轻而易举。

参考: https://blog.csdn.net/m0_73693562/article/details/147905146

核心功能

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 系统入口 │

│ python run_agent.py "业务创意" │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 环境配置与初始化 │

│ ┌─────────────┐ ┌─────────────┐ ┌─────────────┐ ┌─────────────┐ │

│ │ Config │ │ Context │ │ MCP Clients │ │ Storage │ │

│ │ Manager │ │ Store │ │ │ │ Server │ │

│ └─────────────┘ └─────────────┘ └─────────────┘ └─────────────┘ │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ Orchestrator Agent 启动 │

│ ┌─────────────────────────────────────────────────────────────────────────┐ │

│ │ 任务: validate_business_idea │ │

│ │ 业务创意: "用户输入的业务创意" │ │

│ └─────────────────────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 1. 数据抓取阶段 (Scraper Agent) │

│ ┌─────────────────────────────────────────────────────────────────────────┐ │

│ │ 任务: scrape_data │ │

│ │ - 使用业务创意作为搜索关键词 │ │

│ │ - 通过 Reddit MCP Server 抓取 Reddit 帖子和评论 │ │

│ │ - 保存 checkpoint: scraping_complete.json │ │

│ └─────────────────────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 2. 数据分析阶段 (Analyzer Agent) │

│ ┌─────────────────────────────────────────────────────────────────────────┐ │

│ │ 任务: analyze_data │ │

│ │ ├── analyze_posts: 分析帖子内容,提取用户痛点和需求 │ │

│ │ ├── analyze_comments: 分析评论情感和用户反馈 │ │

│ │ ├── comments_tag_analysis: 评论标签分析 │ │

│ │ └── combined_analysis: 综合分析生成市场验证评分 │ │

│ │ 保存 checkpoint: analysis_complete.json, comments_tag_analysis_complete.json│ │

│ └─────────────────────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 3. 报告生成阶段 (Reporter Agent) │

│ ┌─────────────────────────────────────────────────────────────────────────┐ │

│ │ 任务: generate_and_save_report │ │

│ │ ├── generate_html_report: 生成 HTML 格式报告 │ │

│ │ ├── save_report: 保存报告到 reports/ 目录 │ │

│ │ └── 保存 checkpoint: report_saved.json │ │

│ └─────────────────────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 4. 结果输出与存储 │

│ ┌─────────────────────────────────────────────────────────────────────────┐ │

│ │ 输出文件: │ │

│ │ ├── reports/{business_idea}_{timestamp}.html │ │

│ │ ├── agent_context/checkpoints/{run_id}/ │ │

│ │ │ ├── scraping_complete.json │ │

│ │ │ ├── analysis_complete.json │ │

│ │ │ ├── comments_tag_analysis_complete.json │ │

│ │ │ ├── combined_analysis_complete.json │ │

│ │ │ └── report_saved.json │ │

│ │ └── 小提示: 相关资料请到 agent_context/checkpoints/{run_id}/ 目录下查看 │ │

│ └─────────────────────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────────────────────────┐

│ 任务完成 │

│ 返回 TaskResult 包含执行结果 │

└─────────────────────────────────────────────────────────────────────────────────┘

目前还未结合已有自动交易逻辑,暂时只能通过生成的图片来手动交易。

效果图:

欢迎大家交流。

DecoTV - 开箱即用的影视聚合播放器

▎项目介绍:一个影视聚合播放器前端,提供统一影视资源搜索入口、在线播放、影视详情展示、观看记录与收藏同步等功能,支持多端设备响应式浏览与 PWA 安装体验。

它支持多源聚合搜索、流媒体播放集成、可选用户注册系统、跨设备观看进度同步和收藏,支持自动跳过部分广告片段、无数据库模式、本地存储降级以及 CMS 代理扩展。

▎项目地址:GitHub - Decohererk/DecoTV: 基于最新版 LunaTV 二次开发的一个开箱即用的、跨平台的影视聚合播放站。【原 KatelyaTV】

https://cn-sec.com/archives/4880863.html

https://dailydarkweb.net/asml-alleged-data-leak-154-databases-published-online/

威胁行为者 “1011” 在暗网社区 BreachForums 上发布帖子,声称已成功入侵荷兰半导体设备巨头 ASML Holding N.V.(asml.com)的数据库系统,并正在泄露约 154 个数据库文件。该事件被标注为一起中等严重程度(

Medium )的数据泄露事件,相关数据据称已以 .SQL 格式公开下载。

https://www.reuters.com/business/asml-says-social-media-hacking-claims-are-untrue-2026-01-07/

公司在声明中表示:“ASML 已知悉 2026 年 1 月 6 日在 BreachForums 发布的一条帖子,声称公司信息被曝光。”

https://cybernews.com/security/fake-asml-nordvpn-data-breach-claims/

看了 12/15 号,Claude Code 项目负责人 Boris Cherney 的访谈

http://youtu.be/AmdLVWMdjOk?si=P2jFiV2qwq7ujDEs

自己的感受:

Claude 技巧:建议先用 Plan Mode 对齐思路再让它干活。厉害的人会同时启动多个 Agents 并行处理任务,自己负责统筹方向,效率起飞。

增强生产力:核心是 “拒绝机械重复” automat e toil 。把琐碎的 “体力活” 扔给 AI,把脑子留给核心逻辑。少开会,多实干,保持常识判断和对一线的直觉,这才是最高效的状态。

看这个访谈最有趣的一点是,Boris 竟然没正经上过计算机课。他大学学的是经济,中途辍学去搞创业了,所有的编程技能都是在实战中 “打怪升级” 练出来的。

Ashampoo LocaLingo 许可证密钥 免费下载

产品名称:Ashampoo LocaLingo

许可证类型:终身

平台: Windows

各位佬们好,

之前在版里分享过一个叫 Raw Alchemy 的小工具,主要用来解决 “想把视频的 S-Log/F-Log LUT 套在 RAW 照片上,结果颜色不对” 的问题。

当时那个版本虽然也能用,但界面比较 “直男”(见下图 1),只能算是个功能性软件,选图、对比都不太方便,甚至有点简陋。

听取了大家的建议,这段时间我把整个软件重写了!

带来了全新的 Raw Alchemy Studio 。

先看对比:

以前的版本 (功能单一,界面简陋):

现在的版本 (暗色模式,现代化管理,支持选片):

这次更新了什么?

不再只是一个单纯的 “格式转换器”,它现在是一个完整的选片 + 基础调色工作台 :

抛弃了以前那种分离的窗口设计,改成了类似 Lightroom/Capture One 的暗色系集成界面 。

增加了文件库管理 ,左侧可以直接浏览文件夹缩略图,不需要再一张张 “打开文件” 了。

如果你是双修党,手里的 S-Log3、F-Log2、LogC4 视频 LUT,现在可以在这个软件里精准 地套用在 RAW 照片上。

底层逻辑是把 RAW 解码为 Linear 空间后,通过数学模型伪装成 Log 信号,色彩还原度吊打直接在 PS 里硬套。

支持空格键对比 (原图 vs LUT 后)。

增加了 Tag (标记) 功能,可以快速过一遍片子,打上标,然后一键 “导出所有标记图片”。

高光保护测光 :自动曝光时优先保护高光不溢出。

镜头矫正 :内置 Lensfun,自动修正畸变。

直方图 :实时的 RGB 直方图,不再盲调。

下载地址 (GitHub):

https://github.com/shenmintao/Raw-Alchemy/releases/tag/studio-v0.1.0

(Releases 里有打包好的 exe,开箱即用,无需安装环境)

这次改版主要是为了解决 “好用” 的问题。以前那是为了 “能用”,现在终于像个正经的后期软件了。

代码完全开源,免费使用。欢迎各位老哥下载体验,如果是索尼、富士、松下用户,一定要试试把你拍视频用的 LUT 套进去看看,效果绝对不一样。

有 Bug 欢迎反馈,觉得好用求个 Star!

之前我每个月都会有一篇周记来总结当月的下载量和收入,也就是不管怎么流水账,每个月总有一篇是有内容的,内容就是下载量和收入的分析和总结。但是今年四月份的时候参加了一次独立开发者线下聚会活动,当时有人劝我不要再公开产品的下载量和收入,因为这确实带了一些小麻烦,从那以后我就没再写月度的数据总结,这回趁着年终总结,就写一个总体数字吧,以后每年就公布这一次。

本文虽然写于 2026 年,但是会用“今年”来代指 2025 年,“去年”代指 2024 年。

App Store 终于止住了连续四年的下降,小幅提升了一下。Google Play 连续两年超过 50% 的下降,虽然总下载量突破了 400 万,但也快完犊子了。国内安卓市场也是连续两年下降,幅度只比 GP 小一点点。

App Store 的提高可能归功于年初时的一个改动,就是 App 在下载后第一次打开走完 Onboarding 流程后立刻展示 Paywall ,这个策略让收入短时间大幅上涨,甚至达到了 RevenueCat 的收费门槛,但是好景不长,收入趋势很快就下降到了之前的水平。

Google Play 和 Admob 是绑在一起的,下载量的大幅下降也必然导致收入的大幅下降。虽热新 App 也接入了 Admob ,但是那部分收入完全可以忽略不计。

国内安卓市场今年收入的上涨完全依赖于极简日记,极简日记在 3 月份被大 V 带了一下流量,收入猛增,从那以后就立刻改变了国内安卓市场的收入结构,原来大部分都是极简时钟,现在改成了极简日记。问题是极简日记的下载量太少了,和极简时钟差了一个数量级,如果下载量能提高一些就好了。

2025 年的第一季度收入暴涨让我开心了半个多月,但是从那以后就一直下降,这一年也不怎么开心,我一直以为 2025 的总收入会不及 2024 年,可没想到年终一求和,居然比 2024 年还多,总体提高了 20%。扣除各种分成,到手的收入居然还突破 20 万,但也只突破了一丢丢,21 万左右。

除了迭代已有的 App 外,今年还开发了几个新产品(但是都不赚钱),也拓展了新渠道(也不赚钱)。

除了来自于 APP 的直接收入,今年又多了几个收入来源,虽然不多,但是也是看到了其他赚钱的方法。

这些收入来自于 Youtube 广告、知乎致知计划、公众号流量主,可以看出来,这些都属于内容创作。与 APP 的被动收入不同,这些收入必须持续投入,不断产出新内容才可以维持收入。

YouTube 我今年只发了一个视频,不过这个视频也没有对收入有多少贡献,主要的贡献还是好多年前的一个视频。我是去年才开通了 YPP ,今年唯一一次打款是攒了一年才达到了打款门槛。知乎和公众号发的都是我的周记,知乎的收益只能靠浏览量产生的盐粒来兑换,今年也只兑换了一次。公众号这边的收入主要靠广告还有零星的打赏(今年的打赏比去年少太多的),周记写了将近三年,订阅数终于突破了一万,广告收入多的时候这个公众号的收益就相当于一个 20 万左右的货币基金。

查了一下今年给自己的消费记录,没有什么大的开销,超过一千块的只有下面几个,而且感觉都很物有所值,没花什么冤枉钱。

另外有一系列开销,可能加起来还不足一千,但却是我今年花费心力最多的,那就是养了仓鼠,一儿一女。养过仓鼠的人都知道,笼子里的东西七七八八,最便宜的就是仓鼠本身(除非是名贵的波利)。这一年里这两个小东西给我带来了很多快乐,白天自己一个人在家也不再孤单了。

先来看一下去年年终总结里的 Flag:

- 减重 15 斤!必须完成!

- MRR 达到 600 美元。现在是 500 ,花一年时间提高 100 ,应该可以达到吧。

- 出三个新 App ,一个健康类,一个效率类,一个学习类

- 继续完善 Nut Goals ,并用这个 app 存下一笔钱

- 尤克里里能够指弹一首歌

来对一下吧:

看下来连 50% 都没有完成,这样也不好再立新目标了啊。这么一看,年度目标太遥远太笼统了,前半年拖一拖,后半年就会发现根本无法完成。有志者立长志,无志者常立志,于是每年都这样,立了也白立。年度目标应该拆解为月目标和周目标,再加上进度追踪、励志提醒和专家辅导。

嘿,又一个 App 点子产生了!

总的来说,今年很焦虑,大部分时间里是那种无能为力的感觉。

今年上半年参加了独立开发者线下聚会,确实大开眼界。从那之后,我打算每周都找一个独立开发者进行线上聊天交流,但是只聊了五个人后就搁置了。希望 2026 年能够向更多的开发者请教,特别是岁数比我大的。

唉,马上就四十岁了,希望可以不惑。

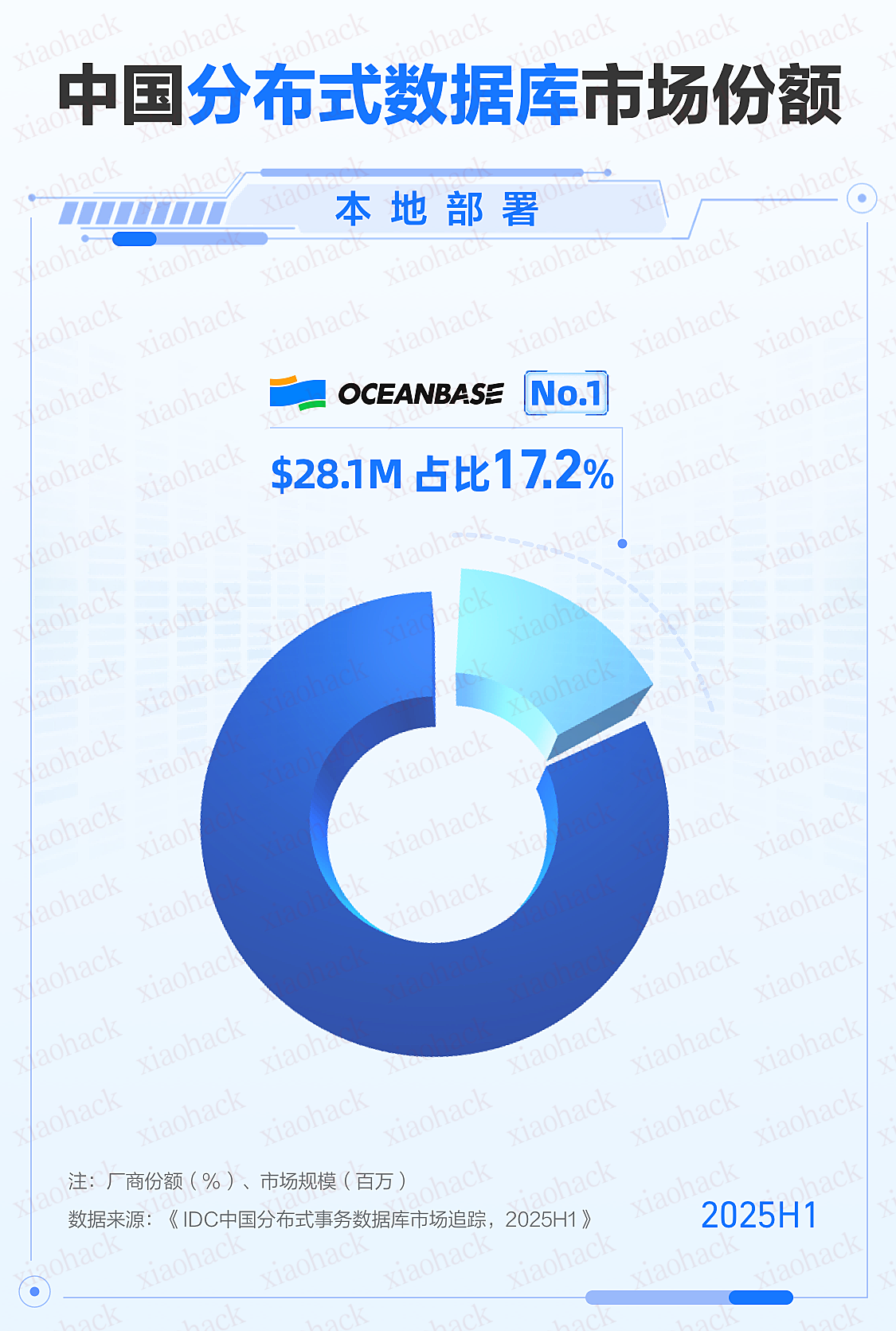

近日,全球权威机构 IDC 发布的《IDC 中国分布式事务数据库市场追踪,2025H1》报告显示,2025 上半年,原生分布式数据库厂商 OceanBase 以 2810 万美元营收,居中国分布式事务数据库本地部署市场第一。这是继 2024 年下半年后,OceanBase 连续两次在该细分市场拔得头筹。 同时,在包含公有云的整体市场中,OceanBase 以 4060 万美元营收位列独立厂商第一、整体第四,持续领跑国产数据库阵营。 IDC 统计,2025 上半年,中国分布式事务数据库市场规模达 4.2 亿美元,同比增长 19.6%。其中,本地部署市场增速高达 24.9%,显著高于公有云部署模式,预计 2024-2029 年复合增长率将达 24.2%。分布式数据库正加速向金融、政务等核心系统渗透,在性能、稳定性与综合成本上比肩甚至超越国际产品。 IDC 同时认为,当前市场集中度持续提升,前五大厂商已占据 82.5%的市场份额。随着国家数据库测评名单的发布和政策深入推进,具备核心技术能力与成熟实践案例的厂商优势凸显。 据了解,OceanBase 是蚂蚁集团 100%自研的原生分布式数据库。IDC 在报告中指出,OceanBase 凭借原生分布式、原生多租户、HTAP、高级数据压缩等技术特性,成为分布式交易型数据库的代表厂商。其“单机分布式一体化”设计,可在同一产品体系下灵活支撑企业从初创到超大规模增长的全周期需求。 自 2020 年商业化以来,OceanBase 客户数突破 4000 家,连续 5 年年均增速超 100%,广泛应用于金融、政务、能源、通信、医疗等关键领域。面向 AI 时代,OceanBase 加速“Data xAI”融合,先后发布 4.4 一体化融合版本、AI 原生混合搜索数据库 seekdb 等产品,通过 AI 原生混合搜索、多模融合、TP/AP/AI 一体化等前沿能力,服务数十家头部企业智能化应用。 在金融领域,OceanBase 服务全部政策性银行、5/6 国有大行,覆盖超 100 家资产规模千亿级以上银行,支撑 190+核心系统、1000+关键业务,并成功落地汇丰、澳门大丰、老中银行、三井住友等国际金融机构。其中,老中银行在老挝上线基于 OceanBase 的新一代核心系统,性能提升 20 倍、批量处理缩至 30 分钟,成本仅为同类方案 20%,实现中国自研数据库海外银行核心系统的首单落地。 在政务与央国企领域,OceanBase 支撑全国约 1/3 省级人社系统、12123 交管平台、北上广深地铁票务系统及多家三甲医院 HIS 系统,并深度服务中国移动、中国联通、中国电信、国家电网、中国石化、中国航信、中国南方航空等大型央国企。 在海外支持方面,OceanBase 多云数据库 OB Cloud 已运行于阿里云、AWS、Azure 等七大主流云平台,支持“一套架构、全球运行”,服务 GCash、2C2P、PalmPay 等 50 余家海外客户。

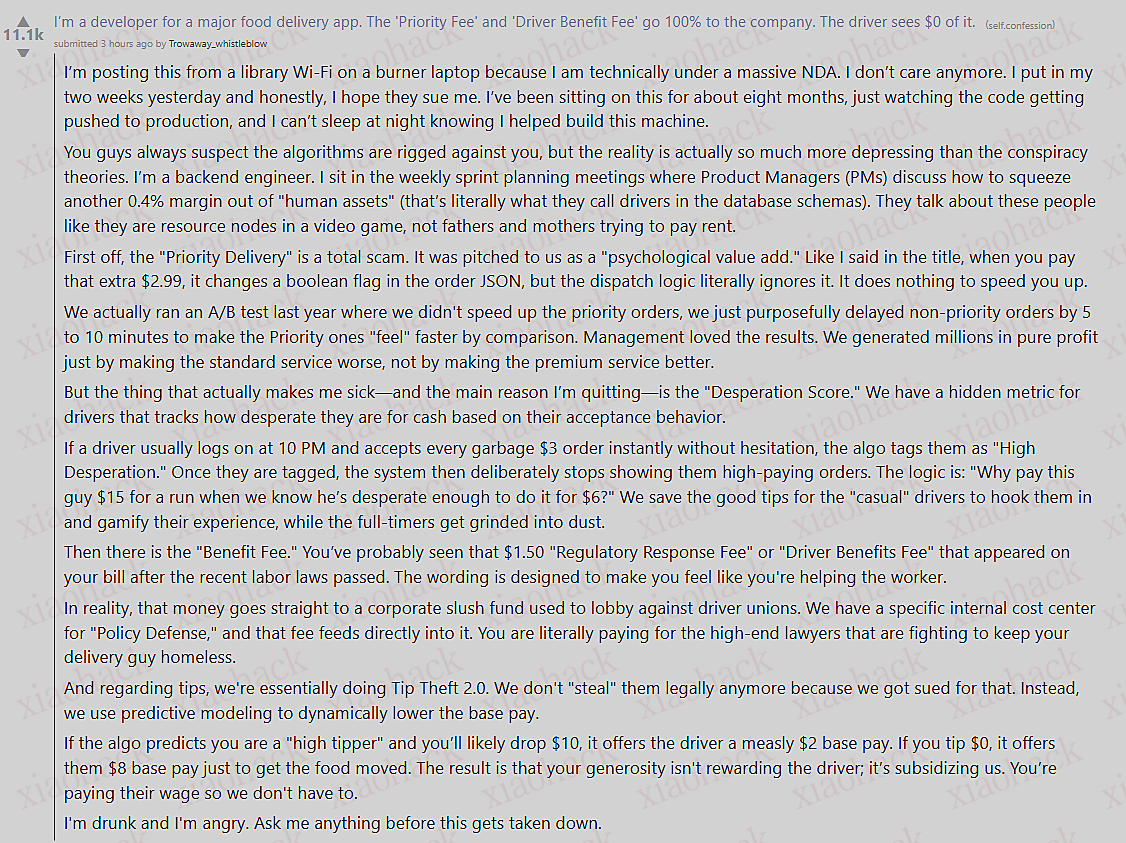

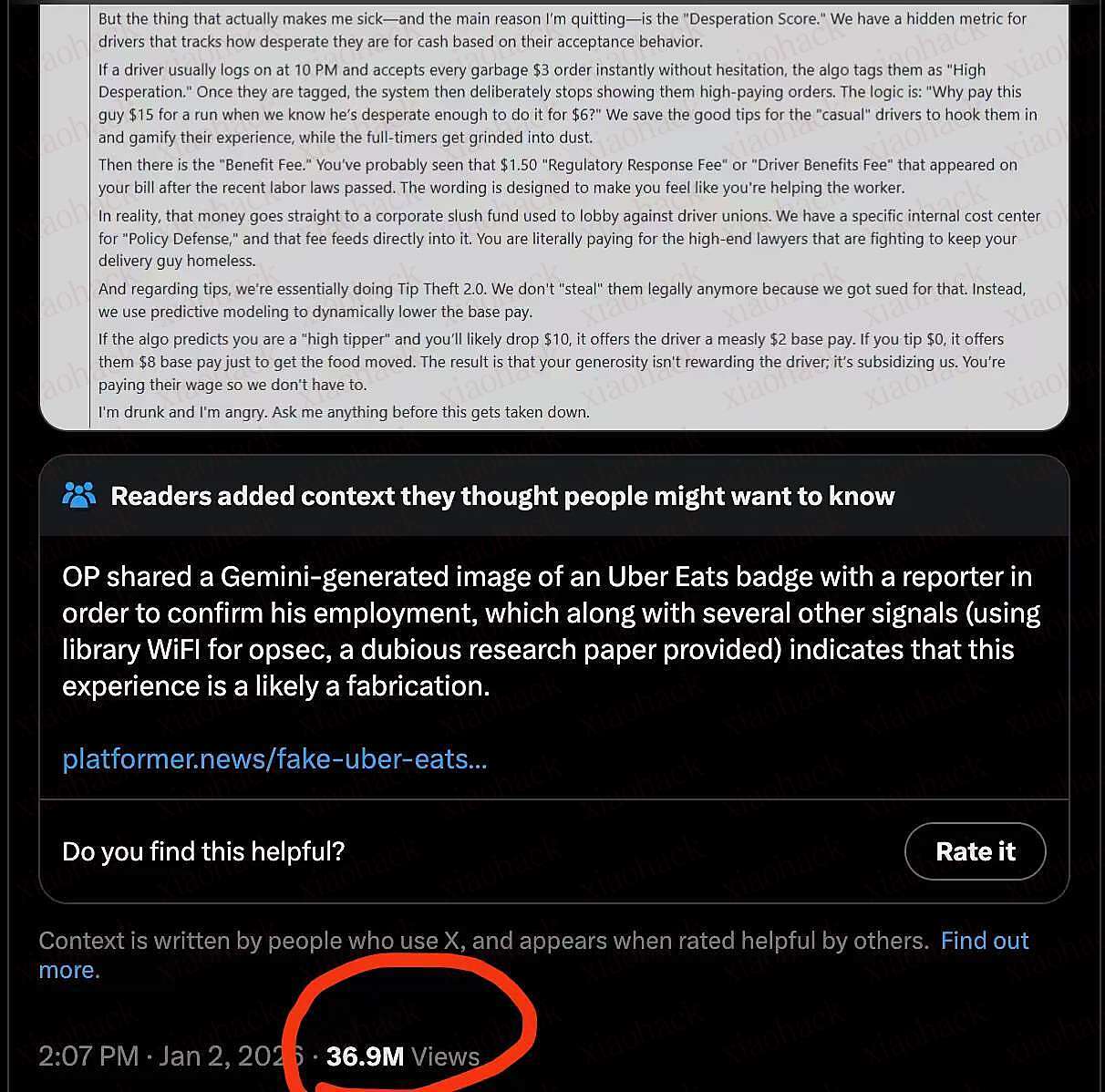

去年,一部由徐峥主演的电影《逆行人生》,将外卖骑手在数字时代下的生存状态推至公众视野的中心。影片刻画了骑手们在车流中穿梭的日常,以一种犀利而写实的方式,揭开了平台算法背后那只看不见的手——它如何无声地主宰着骑手的收入、节奏甚至命运。 由此,一个曾经隐藏在订单推送与时限倒计时背后的算法和数据相关议题,逐渐发酵成为当时国内的热门话题。在海外,这一话题同样反复引发争议。 近日,一名自称外卖平台“内部举报人”的 Reddit 用户被证实为造假者,其编造的故事曾在全球社交平台引发巨大传播。 事件始于 Reddit 上发布的一篇“举报帖”。一名 ID 名为 Trowaway_whistleblow 的用户发帖,自称自己是一位即将离职的 Uber Eats 软件工程师,长期目睹公司通过算法系统系统性剥削外卖员与消费者。他在帖子中写道:“你们总是怀疑算法在暗中对付你们,但现实远比阴谋论更令人沮丧。” 该用户声称,自己在醉酒状态下,于图书馆使用公共 Wi-Fi 写下了这篇“长篇檄文”,详细指控公司如何利用法律漏洞,从司机报酬和消费者支出中“无声抽成”。 帖子详细描述了该公司如何操纵平台,损害顾客和外卖员的利益:例如,故意放慢普通订单的配送速度,人为地让优先订单看起来更快;以及收取所谓的“监管响应费”,并以此为由游说反对司机工会。 这篇帖子中最令人震惊的指控或许是,平台内部有一个从不对外公开的指标,用来评估骑手有多缺钱。该平台会根据司机接单的时间和频率计算他们的“绝望指数”,这也是举报人辞职的主要原因。该用户写道: “如果一个司机通常晚上 10 点上线,毫不犹豫地接受所有 3 美元的垃圾订单,算法就会将他标记为‘极度渴望赚钱’。一旦被标记,系统就会故意停止向他推送高价订单。逻辑是:‘既然我们知道他渴望赚钱到愿意接 6 美元的单子,为什么还要付他 15 美元呢?’我们把高额小费留给‘兼职’司机,以此吸引他们并让他们的游戏体验更加有趣,而全职司机则被榨干最后一滴油水。” 这篇帖子最终获得了 8.6 万个赞,登上了 Reddit 首页,浏览量可能达到数百万。用户们向这位举报人赠送了超过 1000 枚 Reddit 金币,这些金币可以用来购买高级功能。该帖子在 X 网站上的截图浏览量超过 3600 万次。 这篇帖子之所以具有高度传播力,并非偶然。在美国,外卖平台确实存在过被法律确认的不当行为。以 DoorDash 为例,该公司曾因挪用司机小费遭到起诉,最终在美国支付了 1675 万美元的和解金。这一真实案例,使公众更容易相信“平台算法系统性压榨劳动者”的叙事。 同时,在影视作品中,算法被具象化为一种无法逃脱的“系统命运”。在徐峥参与的相关题材电影中,外卖员被描绘为即便拼尽全力,也难以突破平台算法设定的收入上限。这类艺术表达虽非纪实,却强化了公众对“算法不可抗力”的直觉认知。 正是在这一现实与情绪背景下,这名 Reddit 用户的爆料被迅速视为“终于有人站出来说实话”。 但如今,该帖现已被发布人删除。 科技媒体 Platformer 的记者凯西·牛顿(Casey Newton)注意到了这篇帖子,并尝试对其真实性进行核实。 在取得联系后,Newton 与这名自称“举报人”的 Reddit 用户进行了约半小时的交流。 Newton 在报道中写道,对方与许多声称掌握内部信息的爆料者一样,最关心的问题是如何保持匿名。他表示愿意进一步分享所谓的内部材料,但同时强调,已有“其他大多数新闻机构”联系过他,并提出了他认为“风险过高”的身份核实要求,因此选择拒绝合作。 在交流过程中,Newton 注意到一个明显的异常:这名用户在即时通讯中的拼写和用词错误频繁出现,甚至将“information”(信息)拼写错误,而这些语言层面的失误,在其最初发布、广泛传播的 Reddit 长文中几乎不存在。 这一前后差异,成为 Newton 心中逐渐浮现的疑点之一。 Newton 向对方明确表示,自己会尽力保护其匿名性,但作为记者,仍需要对其身份进行基本核实。对此,这名用户提出,可以提供一张经过模糊处理、隐藏姓名的员工证照片作为证明,并询问“这样是否可以”。Newton 同意后,对方随即发送了一张照片。 这张图片看起来像是一张 Uber Eats 的员工证件,在形式上具备公司标识和员工信息布局,但其真实性仍有待进一步核验。正是从这一步开始,Newton 逐渐意识到,自己正在接触的,可能并非一名真正的内部人士,而是一场精心设计的伪装。 一张疑似 Uber Eats 员工证件的照片 此外,他还提供了一份长达 18 页的“内部文件”,称文件详细描述了公司如何利用人工智能系统,为每一位司机计算所谓的“绝望程度评分”,并据此动态调节派单、报酬和激励机制。 所谓的“内部 PDF 文件”截图 这些材料在形式上高度专业,包含大量技术细节与市场分析。Newton 后来在 Platformer 的文章中写道,在他多年职业生涯中,这类文件“看起来非常可信”,因为其制作成本极高,逻辑完整,很难让人相信只是为了戏弄记者。 “谁会花时间精心制作一份长达 18 页、关于市场动态的详细技术文件,仅仅为了骗人?” Newton 写道,“谁又会费尽心思伪造证件?” 然而,在进一步核查过程中,Newton 逐步发现这些“证据”经不起验证。文件中的部分技术描述与 Uber Eats 实际业务逻辑存在明显不符,所谓的内部术语和流程也无法在任何可靠渠道得到印证。员工证件的格式与真实样式存在差异,其来源亦无法追溯。 最终,Newton 确认,这名所谓的“举报人”并非 Uber Eats 员工,其爆料内容完全是编造的故事。整套“内部材料”极有可能借助生成式人工智能工具完成——这也解释了为何文件在语言风格、结构完整度和技术细节上显得异常成熟,却缺乏真实组织内部文件应有的可核查痕迹。 这起事件并未否认平台经济中真实存在的问题。相反,它凸显了一个更复杂的现实:当算法的不透明性已经成为普遍焦虑,当平台过往确实存在侵害劳动者权益的案例,虚假信息反而更容易披上“合理外衣”。 正如 Newton 在报道中所指出的那样,这次经历并非一次普通的谣言,而是一场具有技术时代特征的信任测试——它考验的不只是平台,也考验每一个信息传播者与接收者。 随着“Uber Eats 举报人”事件被媒体披露为造假,一部分网友并没有完全接受调查结论,相关讨论迅速在社交平台上分化。 在 Reddit 上,有用户对举办贴里面提到的内容深表赞同。他评论道: “外卖平台他们会根据你的使用习惯来判断你对收入的渴望程度,知道你的底线,所以会给你安排你不愿意接的最糟糕的活儿。因此,越不急于赚钱的人反而能接到更好的送货任务。” 有用户指出,将事件简单归因为“人工智能造假”本身并不严谨。在他们看来,即便在生成式人工智能出现之前,互联网上就早已充斥着虚假信息,一个逻辑自洽、情绪饱满的长帖,并不需要依赖 AI 工具,普通人在短时间内同样可以完成。 有用户猜测,将所谓的“内部文件”定性为 AI 生成,可能只是平台方的危机公关策略之一,目的是削弱爆料内容的影响力,而非对事实本身作出独立、透明的澄清,该用户评论道: “或许这是 Uber Eats 为了平息事态而采取的反举报策略。或许最初的帖子是真的,但他们这么做是为了制造足够的疑点,让我们最终都释怀。” 此外,还有声音对媒体调查的权威性持保留态度。一些网友表示,仅凭记者判断材料“疑似由人工智能生成”,并不足以比原始爆料更具说服力。他们指出,生成式人工智能本身也存在大量错误和不稳定性,因此仅以“AI 痕迹”为依据,仍难以完全证明图片或文件的真实来源。 “仅因为某个“记者”发现它是人工智能生成的,并不能比原帖更有说服力。我并非不尊重记者他们的工作,但人工智能经常出错,所以我们怎么知道这张图片真的是人工智能生成的呢?” 另一位网友也在质疑媒体的报道。他认为发帖者并不能确定是 AI,因为人们也经常会用 AI 来给自己想说的话润色,但润色不代表他说的话就是 AI 捏造的。 这类观点认为,围绕“是否由 AI 生成”的争论被过度放大,反而模糊了对内容本身真实性的判断。 这些分歧性的反应表明,在平台经济、算法治理与人工智能高度交织的语境下,即便面对被揭穿的虚假举报,公众对平台、媒体以及技术本身的信任裂痕依然存在,事件所引发的争议并未随着事实澄清而完全消散。 参考链接: https://www.platformer.news/fake-uber-eats-whisleblower-hoax-debunked/ https://www.reddit.com/r/confession/comments/1q5gl9j/removed_by_moderator/事件回溯

一场 AI 生成的骗局?

网友怎么看?

历经两个半星期,终于迎来 v1.16 版本啦,现在支持时钟修改颜色了。

GitHub 地址 -> https://github.com/teojs/clock-dashboard

在线预览 -> https://teojs.github.io/clock-dashboard/

花费了好几天迭代优化,自用感觉可以了,给大家分享一下,送 50 个永久激活码。

截图:

官网:https://subflowai.nocmt.com/

功能:

文档地址(包含软件下载):https://www.yuque.com/u5007695/za0zmx/kaecw73nq7pmgbpr?singleDoc# 《实时字幕翻译软件配置指南》 密码:hsyu

兑换地址:https://redeem.ym.si/IUYUSL

兑换状态:

[小红书文章链接] http://xhslink.com/o/9TgssCFrIsB

[哔哩哔哩] https://b23.tv/8TScjKT

欢迎点赞、评论、转发,谢谢。

另外也推荐一下我做的跨平台同步剪贴板软件 --烽翎,都快饿死了~~ :(

项目主页: https://001sms.dev

从运营商朋友那里淘来的临期卡,正好适合拿来接码的场景。所有号码都是实体卡/eSIM ,没有 VoIP 号码,所以能过很多有 VoIP 限制的验证。站点 1 刀起充,用多少充多少。

已经适配了 Google, Google Voice, Claude 等常见的接码场景。

下面每个充值码都可以为账号充值$3

4U4YJDDATSVMN33A

EX7SXQ9BG6DBWC9M

UPEMR6JNFJACGZKT

Y57TR3UMDDTHAHR9

9JUTEFR3KVQMXWU5

SSQ7UHP3MPYEKBNY

BBFW8QFYYBBRXJRQ

ET48PCF322KAECD4

X27EEA6P24B6AC2V

H8A7YPABNBM9XJ56

3RUQUV6UFQPSEU58

NTNR4HYG28FG6PD2

W3SJN278EXGC8KZX

6BFS5TXSNZG6DD2G

WXGZE6C9SEB7XT4C

N4G3EPMNRA7EQDB5

Y7YEG5BEVMZBM7JK

JAGMDBBFQHBJ7V3Q

CAN2RXE9S6TAWGX7

UB733DV343PHUN35

Repo 地址,欢迎 Fork,Star。

我发现新的有意思的 prompt 的或者发现目前 prompt 有优化空间都会第一时间 push 上去

用于问答的增强 prompt

使用方法:问问题的时候直接把 prompt 贴在原 prompt 结尾即可

这个 prompt 配合这个插件使用更方便

PromptHelper - 跨平台 AI 助手油猴脚本,支持 ChatGPT/Claude/Gemini 等 8 大平台的模板管理

一个用于收集和整理优质 Prompt 的个人仓库。这里汇集了我自己设计的以及从互联网各处发现的有趣、实用的提示词。

prompts/

├── 实用工具/ # 日常实用场景的提示词(健康、学术、问答等)

├── 越狱破限/ # 用于绕过 AI 限制的各类越狱提示词

├── 角色扮演/ # 角色扮演、虚拟人格相关的提示词

├── 写作辅助/ # 翻译、内容创作、文生图等写作相关提示词

├── 元提示词/ # 用于生成或优化其他 Prompt 的元提示词

└── NSFW/ # 成人内容生成相关提示词 https://linux.do/t/topic/1365022

今天看到一个佬的 X 上信息流筛选折腾感觉思路还不错,但是佬说都是一个一个手动操作的,我觉得还是太麻烦了,自己也折腾发现 grok fast api 也是可以获取的,只是数量获取的少,但是没事,用 grok2api 多个账号并发速度也不慢!

所以自己今天也折腾了一个全自动版,简单使用了一下感觉还行,所以直接拿出来给佬们用用

grok 我是用 grok2api 逆向的 Grok 4 Fast,记得自己多备账号(我是从佬们分享的 grok 一堆账号所以可以随便造)

具体使用过程就是根据佬提供的思路获取到关注的 csv,然后运行好项目有直接把 csv 上传后等待跑完就能直接看了,也实现了历史功能,能看之前的 csv 集合。

其他的自己去试试,很简单的逻辑。

开源链接:X Feed Digest(GitHub - ChineseLsh/x-feed-digest: Transform your X/Twitter following list into AI-curated daily digest)

最近了解到了有 alphaXiv 这个论文交流平台,个人觉得上面每篇文章的点赞数还是挺有参考价值的,获赞多的文章往往有不错的亮点。

如果能在 arXiv 搜索页展示 alphaXiv 的点赞数,阅览论文时咱就能一眼看到哪些文章可能更值得去读了。

于是咱就写了这样一个简单的小脚本,可以在 arXiv 摘要页以及搜索页展示 alphaXiv 上的点赞数,并附带有跳转链接:

希望能帮助到大家!

增加了一个检索功能,现在只要输入关键词,就会自动检索相应的视频(综合排序前 5 个,可自定义),并自动评估、总结。

这样就可以知道可以深入看哪个视频了!

这是 github 地址:tiandaren/video-quick-eval: AI 总结 B 站、youtube 视频,实现快速转写、评估、总结。

小工具,希望佬们给个 star。

做了一个视频总结的小工具,纯后端、轻量化、自动转写、评估、总结 - 开发调优 - LINUX DO

最初用 Adguard Home 部署,近期又接触了 Mosdns-x,又是一番折腾

完整的 mosdns-x 配置在最底下,有配套的数据看板

(需要 Mihomo 完整配置文件,其实写的一坨,想 “欣赏” 的可以留言 )

客户端说明:

ns:默认使用 NextDNS 与谷歌 dns 作为上游

m-cn:主要用于解析国内域名

m-psn:国内外上游,主要用于 proxy-server-nameserver

(m-psn,是因为之前用宝可梦,他家机场部分域名用国外 dns 获取不到结果,所以单独整了个 adgh 客户端用于 proxy-server-nameserver)

pure:纯净 dns,未开启广告拦截,使用 NextDNS 与谷歌 dns 作为上游

m-ad:为了方便看 adgh 的拦截日志,搞的客户端,上游同 ns(配置时使用 ns 就行)

两台 US 服务器部署:US2、US3

- https://us2.tls.vlo.cc/alicia/m-ad - https://us2.tls.vlo.cc/alicia/ns - https://us2.tls.vlo.cc/alicia/m-cn - https://us2.tls.vlo.cc/alicia/m-psn

- https://us3.tls.vlo.cc/alicia/m-ad - https://us3.tls.vlo.cc/alicia/m-psn - https://us3.tls.vlo.cc/alicia/m-cn - https://us3.tls.vlo.cc/alicia/ns

mihomo 配套的配置模板,使用 redir-host 模式

并不是最优配置,且这两个模块都引用了规则集:rule-set:,请替换为自己配置文件的规则集或者删除。

# 流量嗅探 sniffer: enable: true force-dns-mapping: true parse-pure-ip: true override-destination: false sniff: HTTP: ports: [80, 8080-8880, 2052, 2082, 2086, 2095]

override-destination: true TLS: ports: [443, 8443, 2053, 2083, 2087, 2096]

QUIC: ports: [443, 8443, 2053, 2083, 2087, 2096]

skip-domain: - "rule-set:DW_Private,qiufeng_domain,Advertising,Tracking,MX_FCM" skip-src-address: - "rule-set:DW_PrivateIP,Advertising_IP" - 169.254.10.100/32 - febf:ffff:ffff:ffff:ffff:ffff:ffff:ffff/128 skip-dst-address: - "rule-set:DW_PrivateIP,Advertising_IP" - 169.254.10.100/32 - febf:ffff:ffff:ffff:ffff:ffff:ffff:ffff/128 - "rule-set:LL_TgIP,Skk_TgIP" # hosts模块

hosts:

'*.alicia.moe': 127.0.0.1

'alicia.moe': 127.0.0.1

'us3.tls.vlo.cc': 38.246.246.231

'us2.tls.vlo.cc': 154.37.208.14

'tls-us-2.vlo.cc': 38.244.62.224

'tls-us-1.vlo.cc': 154.37.208.14

'cn-09.api.vlo.cc': 38.244.62.224

'cn-05.api.vlo.cc': 154.37.208.14

# dns模块

dns:

enable: true

cache-algorithm: arc

prefer-h3: false

use-hosts: true

use-system-hosts: false

listen: 0.0.0.0:1053

ipv6: false

respect-rules: false

enhanced-mode: redir-host

fake-ip-range: 10.20.0.1/16

default-nameserver:

- quic://223.5.5.5

- tls://1.12.12.12

nameserver:

- https://us3.tls.vlo.cc/alicia/ns

- https://us2.tls.vlo.cc/alicia/ns

nameserver-policy:

"rule-set:mydns_domain,myblack_domain,qiufeng_domain,Advertising,Tracking":

- https://us2.tls.vlo.cc/alicia/m-ad

- https://us3.tls.vlo.cc/alicia/m-ad

"rule-set:MX_SteamCN,DW_GamesCN,Skk_Direct,Skk_Domestic,DW_CN,LL_China":

- https://us2.tls.vlo.cc/alicia/m-cn

- https://us3.tls.vlo.cc/alicia/m-cn

proxy-server-nameserver:

- https://us2.tls.vlo.cc/alicia/m-psn

- https://us3.tls.vlo.cc/alicia/m-psn

直接在 mosdns-x 进行分流的。

AI 搓出来的数据面板:https://api.520924.xyz

同样在两台 US 服务器部署

- https://cn-05.api.vlo.cc/tls-cx - https://cn-09.api.vlo.cc/tls-cx

mihomo 配置:同样使用 redir-hosts 模式

# 流量嗅探 sniffer: enable: true force-dns-mapping: true parse-pure-ip: true override-destination: false sniff: HTTP: ports: [80, 8080-8880, 2052, 2082, 2086, 2095]

override-destination: true TLS: ports: [443, 8443, 2053, 2083, 2087, 2096]

QUIC: ports: [443, 8443, 2053, 2083, 2087, 2096]

skip-domain: - "rule-set:DW_Private,qiufeng_domain,Advertising,Tracking,MX_FCM" skip-src-address: - "rule-set:DW_PrivateIP,Advertising_IP" - 169.254.10.100/32 - febf:ffff:ffff:ffff:ffff:ffff:ffff:ffff/128 skip-dst-address: - "rule-set:DW_PrivateIP,Advertising_IP" - 169.254.10.100/32 - febf:ffff:ffff:ffff:ffff:ffff:ffff:ffff/128 - "rule-set:LL_TgIP,Skk_TgIP" # hosts模块 hosts: '*.alicia.moe': 127.0.0.1 'alicia.moe': 127.0.0.1 'us3.tls.vlo.cc': 38.246.246.231 'us2.tls.vlo.cc': 154.37.208.14 'tls-us-2.vlo.cc': 38.244.62.224 'tls-us-1.vlo.cc': 154.37.208.14 'cn-09.api.vlo.cc': 38.244.62.224 'cn-05.api.vlo.cc': 154.37.208.14 # dns模块 dns: enable: true cache-algorithm: arc prefer-h3: false use-hosts: true use-system-hosts: false listen: 0.0.0.0:1053 ipv6: false respect-rules: false enhanced-mode: redir-host fake-ip-range: 10.20.0.1/16 default-nameserver: - quic://223.5.5.5 - tls://1.12.12.12 nameserver: - https://cn-05.api.vlo.cc/tls-cx - https://cn-09.api.vlo.cc/tls-cx proxy-server-nameserver: - https://us2.tls.vlo.cc/alicia/m-psn - https://us3.tls.vlo.cc/alicia/m-psn 自我感觉,自建 Adguard Home DoH 如果是搭配代理软件使用,可以在代理软件分流。

Adguard Home 可以配置不同客户端的上游,这让其在 mihomo 搭配使用时方便很多,毕竟直接在 Adguard Home 分流会很复杂且不易维护

如果你也在使用 Adguard Home + Mihomo,也可以尝试这样操作

MosDNS-X:

配置很复杂… 搞这个纯属折腾(确实是很折腾),配置文件抄的 easymosdns 的,然后用 Gemini Pro 网页版又搓了好久的数据面板:https://api.520924.xyz/

# EasyMosdns v3.5(Final Release)

# https://apad.pro/easymosdns

log:

file: "./mosdns.log"

level: error

data_providers:

- tag: miaoerwlist

file: ./rules/miaoerwlist.txt

auto_reload: true

- tag: chinalist

file: ./rules/china_domain_list.txt

auto_reload: true

- tag: cnlistA

file: ./rules/cnlistA.txt

auto_reload: true

- tag: cdncn

file: ./rules/cdn_domain_list.txt

auto_reload: true

- tag: cdnnocn

file: ./rules/cdn_no_cn.txt

auto_reload: true

- tag: gfwlist

file: ./rules/gfw_domain_list.txt

auto_reload: true

- tag: gfwlistA

file: ./rules/gfwlistA.txt

auto_reload: true

- tag: chinaip

file: ./rules/china_ip_list.txt

auto_reload: true

- tag: cniplistA

file: ./rules/cniplistA.txt

auto_reload: true

- tag: gfwip

file: ./rules/gfw_ip_list.txt

auto_reload: true

- tag: adlist

file: ./rules/ad_domain_list.txt

auto_reload: true

- tag: miaoerblock

file: ./rules/miaoerblock.txt

auto_reload: true

- tag: ads

file: ./rules/ads.txt

auto_reload: true

- tag: ecscn

file: ./ecs_cn_domain.txt

auto_reload: true

- tag: ecsnoncn

file: ./ecs_noncn_domain.txt

auto_reload: true

- tag: hosts

file: ./hosts.txt

auto_reload: true

plugins:

# 数据统计插件

- tag: "metrics_data"

type: "metrics_collector"

# 广告拦截统计

- tag: "metrics_ad_blocked"

type: "metrics_collector"

# 本地上游统计

- tag: "metrics_local_up"

type: "metrics_collector"

# 本地备用上游统计

- tag: "metrics_localB_up"

type: "metrics_collector"

# 远程上游统计

- tag: "metrics_remote_up"

type: "metrics_collector"

# 远程备用上游统计

- tag: "metrics_remoteB_up"

type: "metrics_collector"

# 限制 EDNS0 UDP 缓冲大小的插件

- tag: udp_bufsize_limit

type: bufsize

args:

size: 1232 # 限制为 512 字节,强制大包回落到 TCP

# 缓存的插件

# [lan|wan]

- tag: cache_lan

type: cache

args:

size: 65536

compress_resp: true

#redis: "redis://127.0.0.1:6379/0"

lazy_cache_ttl: 86400

cache_everything: true

lazy_cache_reply_ttl: 1

- tag: cache_wan

type: cache

args:

size: 131072

compress_resp: true

#redis: "redis://127.0.0.1:6379/0"

lazy_cache_ttl: 86400

cache_everything: true

lazy_cache_reply_ttl: 5

# Hosts的插件

- tag: hosts

type: hosts

args:

hosts:

- "provider:hosts"

# 获取ECS的插件

- tag: ecs_auto

type: ecs

args:

auto: true

force_overwrite: false

# 指定ECS的插件

# [local|global]

- tag: ecs_local

type: ecs

args:

auto: false

ipv4: "101.6.6.0"

ipv6: "2001:da8::"

force_overwrite: false

- tag: ecs_global

type: ecs

args:

auto: false

ipv4: "168.95.1.0"

ipv6: "2001:b000:168::"

force_overwrite: false

# 匹配ECS的插件

- tag: ecs_is_local

type: query_matcher

args:

ecs:

- "101.6.6.0/24"

- "2001:da8::/48"

- tag: ecs_is_lan

type: query_matcher

args:

ecs:

- "0.0.0.0/8"

- "10.0.0.0/8"

- "100.64.0.0/10"

- "127.0.0.0/8"

- "169.254.0.0/16"

- "172.16.0.0/12"

- "192.0.0.0/24"

- "192.0.2.0/24"

- "198.18.0.0/15"

- "192.88.99.0/24"

- "192.168.0.0/16"

- "198.51.100.0/24"

- "203.0.113.0/24"

- "224.0.0.0/3"

- "::1/128"

- "fc00::/7"

- "fe80::/10"

- tag: ecs_is_cn

type: query_matcher

args:

ecs:

- "provider:chinaip"

- "provider:cniplistA"

# 调整TTL的插件

# [1m|5m|1h]

- tag: ttl_1m

type: ttl

args:

minimal_ttl: 60

maximum_ttl: 3600

- tag: ttl_5m

type: ttl

args:

minimal_ttl: 300

maximum_ttl: 86400

- tag: ttl_1h

type: ttl

args:

minimal_ttl: 3600

maximum_ttl: 86400

# 匹配TYPE12类型请求的插件

- tag: qtype12

type: query_matcher

args:

qtype: [12]

# 匹配TYPE65类型请求的插件

- tag: qtype65

type: query_matcher

args:

qtype: [65]

# 匹配TYPE255类型请求的插件

- tag: qtype255

type: query_matcher

args:

qtype: [255]

# 匹配RCODE2的插件

- tag: response_server_failed

type: response_matcher

args:

rcode: [2]

# 屏蔽请求的插件

- tag: black_hole

type: blackhole

args:

rcode: 0

ipv4: "169.254.10.100"

ipv6: "febf:ffff:ffff:ffff:ffff:ffff:ffff:ffff"

# 匹配无效域名的插件

- tag: query_is_non_domain

type: query_matcher

args:

domain:

- "keyword::"

# 匹配本地域名的插件

- tag: query_is_local_domain

type: query_matcher

args:

domain:

- "provider:chinalist"

- "provider:cnlistA"

# 匹配污染域名的插件

- tag: query_is_non_local_domain

type: query_matcher

args:

domain:

- "provider:gfwlist"

- "provider:gfwlistA"

# 匹配CDN域名的插件

- tag: query_is_cdn_cn_domain

type: query_matcher

args:

domain:

- "provider:cdncn"

- tag: query_is_cdn_no_cn_domain

type: query_matcher

args:

domain:

- "provider:cdnnocn"

# 匹配白名单域名的插件

- tag: query_is_whitelist_domain

type: query_matcher

args:

domain:

- "provider:miaoerwlist"

# 匹配广告域名的插件

- tag: query_is_ad_domain

type: query_matcher

args:

domain:

- "provider:adlist"

- "provider:miaoerblock"

- "provider:ads"

# 匹配强制本地解析域名的插件

- tag: query_is_cn_domain

type: query_matcher

args:

domain:

- "provider:ecscn"

# 匹配强制非本地解析域名的插件

- tag: query_is_noncn_domain

type: query_matcher

args:

domain:

- "provider:ecsnoncn"

# 匹配本地IP的插件

- tag: response_has_local_ip

type: response_matcher

args:

ip:

- "provider:chinaip"

- "provider:cniplistA"

# 匹配污染IP的插件

- tag: response_has_gfw_ip

type: response_matcher

args:

ip:

- "provider:gfwip"

# 转发至本地服务器的插件

- tag: forward_local

type: fast_forward

args:

upstream:

- addr: "h3://dns.alidns.com"

dial_addr: "223.5.5.5"

- addr: "tls://dot.pub"

dial_addr: "1.12.12.21"

bootstrap: "121.4.4.95"

enable_pipeline: true

max_conns: 3

# 转发至远程服务器的插件

- tag: forward_remote

type: fast_forward

args:

upstream:

- addr: "tls://8.8.8.8"

enable_pipeline: true

max_conns: 4

- addr: "tls://dns.nextdns.io"

bootstrap: "8.8.8.8"

enable_pipeline: true

max_conns: 4

# 转发至分流服务器的插件

- tag: forward_localReserve

type: fast_forward

args:

upstream:

- addr: "quic://dns.alidns.com"

dial_addr: "223.6.6.6"

- addr: "tls://dot.pub"

dial_addr: "1.12.34.56"

bootstrap: "121.4.4.95"

enable_pipeline: true

max_conns: 3

- tag: forward_remoteReserve

type: fast_forward

args:

upstream:

- addr: "tls://8.8.4.4"

enable_pipeline: true

max_conns: 4

- addr: "tls://dns.nextdns.io"

bootstrap: "8.8.8.8"

enable_pipeline: true

max_conns: 4

# 主要的运行逻辑插件

# sequence 插件中调用的插件 tag 必须在 sequence 前定义

# 否则 sequence 找不到对应插件

- tag: main_sequence

type: sequence

args:

exec:

- metrics_data

# 域名映射IP

- hosts

# 屏蔽TYPE65与无效类型请求

- if: "[qtype65] || (query_is_non_domain)"

exec:

- _new_nxdomain_response

- _return

# 优化PRT与ANY类型请求

- if: "[qtype12] || [qtype255]"

exec:

- _no_ecs

- forward_local

- ttl_1h

- _return

# 缓存ECS

- ecs_auto

- _edns0_filter_ecs_only

- udp_bufsize_limit

- if: ecs_is_lan

exec:

- cache_lan

- _no_ecs

else_exec:

- cache_wan

# 强制用本地服务器解析

- if: query_is_cn_domain

exec:

- forward_local

- ttl_5m

- _return

# 强制用非本地服务器解析

- if: query_is_noncn_domain

exec:

# 优先返回ipv4结果

- _prefer_ipv4

- ecs_global

- primary:

# 默认用分流服务器

- forward_remote

secondary:

# 超时用远程服务器

- forward_remoteReserve

fast_fallback: 2500

always_standby: false

- ttl_5m

- _return

# 已知的白名单域名用本地服务器解析

- if: query_is_whitelist_domain

exec:

# 默认用本地服务器

- metrics_local_up

- forward_local

- ttl_1m

# 预防已知的本地域名临时污染

- if: response_has_gfw_ip

exec:

- metrics_remote_up

- ecs_local

- forward_remote

- _return

# 屏蔽广告域名

- if: query_is_ad_domain

exec:

- metrics_ad_blocked

- black_hole

- ttl_1h

- _return

# 已知的本地域名或CDN域名用本地服务器解析

- if: "(query_is_local_domain) || (query_is_cdn_cn_domain)"

exec:

# 默认用本地服务器

- metrics_local_up

- forward_local

- ttl_1m

# 预防已知的本地域名临时污染

- if: response_has_gfw_ip

exec:

- metrics_remote_up

- ecs_local

- forward_remote

- _return

# 已知的非大陆CDN域名

- if: query_is_cdn_no_cn_domain

exec:

# 优先返回ipv4结果

- _prefer_ipv4

- primary:

# 默认用分流服务器

- metrics_remote_up

- forward_remote

secondary:

# 超时用远程服务器

- metrics_remoteB_up

- forward_remoteReserve

fast_fallback: 2500

always_standby: false

- ttl_5m

- _return

# 已知的污染域名用分流服务器或远程服务器解析

- if: query_is_non_local_domain

exec:

# 优先返回ipv4结果

- _prefer_ipv4

- ecs_global

- primary:

# 默认用分流服务器

- metrics_remote_up

- forward_remote

secondary:

# 超时用远程服务器

- metrics_remoteB_up

- forward_remoteReserve

fast_fallback: 2500

always_standby: false

- ttl_5m

- _return

# 剩下的未知域名用IP分流

# 优先返回ipv4结果

- _prefer_ipv4

- primary:

# 默认用分流服务器

- metrics_remote_up

- ecs_local

- forward_remote

- if: "(ecs_is_cn) && (response_has_local_ip) || [response_server_failed]"

exec:

- metrics_localB_up

- forward_localReserve

- _return

secondary:

# 超时用本地分流器

- metrics_remote_up

- forward_remote

- if: response_has_local_ip

exec:

- metrics_localB_up

- forward_localReserve

- _return

fast_fallback: 2500

always_standby: false

- ttl_5m

servers:

- exec: main_sequence

timeout: 10

listeners:

- protocol: http

addr: "0.0.0.0:9053"

url_path: "/tls-cx"

get_user_ip_from_header: "X-Forwarded-For"

kernel_tx: true

kernel_rx: true

api:

http: "127.0.0.1:9080"

如果需要 mosdns-x 面板文件的,https://api.520924.xyz/mosdns-x-webui.zip 可以下载,根据自己配置文件修改,或者扔给 Gemini 修改

搭建的都是 US 服务器,应该都有 9929 线路,可以直连(域名不要搞得像机场域名那种二级域名格式,带 tls、us 这些,可能会被阻断域名)

欢迎留言使用体验 我自己是用不出来 Adguard Home 与 Mosdns-x 搭建的在使用上的性能区别,总体还是 Adguard Home 方便

最近在开发 Flutter,由于是新项目,就想使用 Freezed 格式的实体类,但是试了试 vscode 中一些已有的扩展,都不太好用,就决定自己编写一个扩展来满足要求,在 claude 和 codex 的帮助下实现的目前需要的主要功能。目前仅支持 Freezed 格式的实体类,就开放出来,有喜欢的佬友可以试试。(已上架 vscode 扩展商城)

注意如果需要使用 Freezed 格式的实体类,仅在 Flutter 项目中支持,在 Flutter 项目中任意文件夹点击右键,选择 JsonToDart (Freezed) 选项就会出现配置界面,同时需要在依赖文件里面配置如下的类似内容,版本不一定需要一致。

dependencies: flutter: sdk: flutter freezed_annotation: ^3.1.0 json_annotation: ^4.9.0 # The following adds the Cupertino Icons font to your application. # Use with the CupertinoIcons class for iOS style icons. cupertino_icons: ^1.0.8 dev_dependencies: flutter_test: sdk: flutter flutter_lints: ^6.0.0 build_runner: ^2.10.4 freezed: ^3.2.4 json_serializable: ^6.11.3 点击生成后会自动生成如下的文件

文件内容大概如下

首次使用插件生成代码会自动生成如下文件

内容预览如下,里面有几个基本类型的转换器。

项目源码 github 地址:GitHub - wqjuser/GFDMFJFF